Declaration officielle

Autres déclarations de cette vidéo 22 ▾

- □ Pourquoi la position moyenne de Search Console ne reflète-t-elle pas un classement théorique mais des affichages réels ?

- □ Peut-on encore se permettre d'attendre qu'un classement instable se stabilise tout seul ?

- □ Faut-il vraiment produire plus de contenu pour améliorer son SEO ?

- □ Où placer son sitemap XML pour optimiser son crawl ?

- □ Faut-il vraiment utiliser l'outil d'inspection d'URL pour indexer un nouveau site ?

- □ Combien de temps faut-il attendre pour voir les backlinks dans Search Console ?

- □ Pourquoi les données Search Console et Analytics ne concordent-elles jamais vraiment ?

- □ Search Console collecte-t-elle vraiment toutes les données sur les gros sites e-commerce ?

- □ Faut-il vraiment préférer noindex à disallow pour contrôler l'indexation ?

- □ Les produits en rupture de stock peuvent-ils vraiment être traités comme des soft 404 par Google ?

- □ Les outils de test Google crawlent-ils vraiment en temps réel ou utilisent-ils un cache ?

- □ Google utilise-t-il des algorithmes différents selon votre secteur d'activité ?

- □ Google compte-t-il vraiment les clics sur les rich results comme des clics organiques ?

- □ L'ordre des liens dans le HTML influence-t-il vraiment la priorité de crawl de Google ?

- □ Faut-il vraiment éviter les URLs avec paramètres pour le SEO ?

- □ Pourquoi robots.txt bloque le crawl mais n'empêche pas l'indexation de vos pages ?

- □ Les produits en rupture de stock nuisent-ils au classement global de votre site e-commerce ?

- □ Le contenu dupliqué partiel pénalise-t-il vraiment vos pages ?

- □ Pourquoi Google refuse-t-il d'indexer plusieurs versions d'une même page malgré une canonicalisation correcte ?

- □ Comment Google choisit-il réellement quelle URL canoniser parmi vos contenus dupliqués ?

- □ Les mentions de marque sans lien ont-elles une valeur SEO ?

- □ Pourquoi un lien sans URL indexée ne sert strictement à rien ?

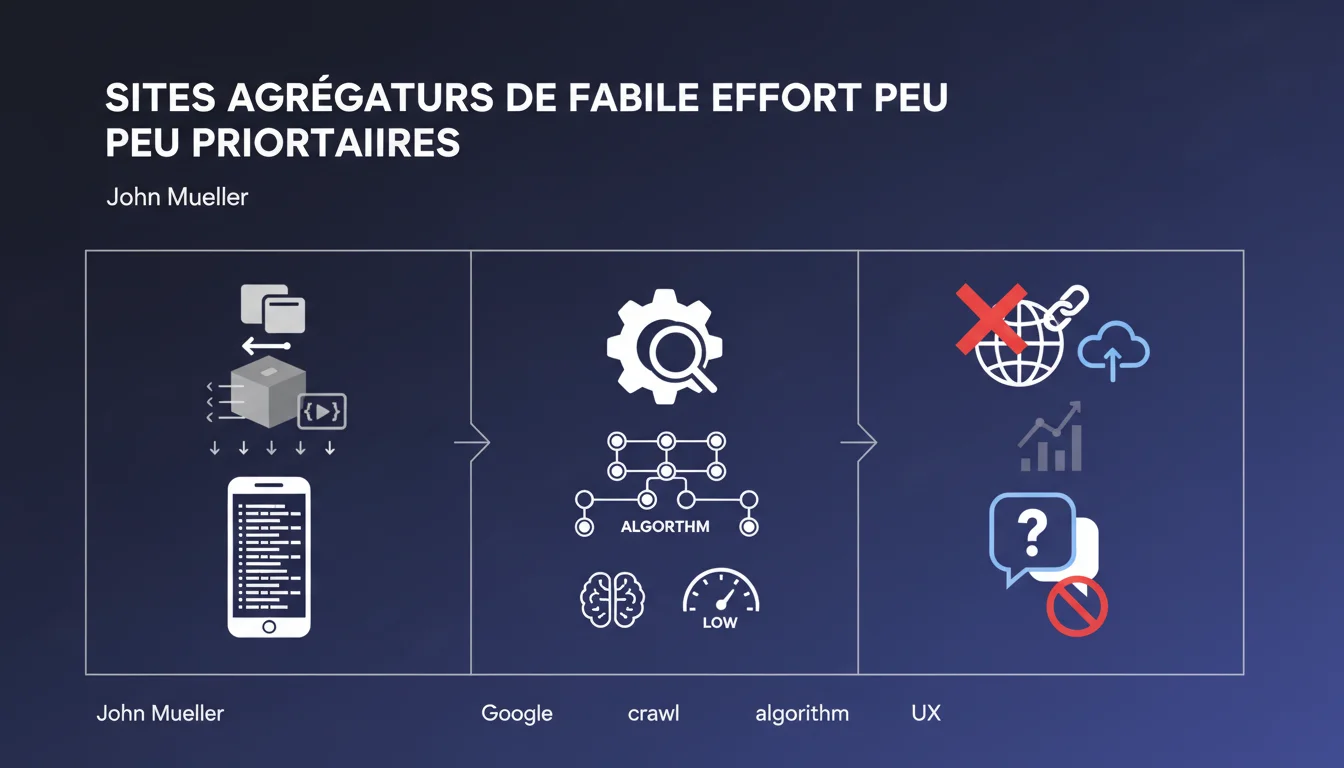

Google ne priorise pas le crawl et l'indexation des sites agrégateurs qui republient simplement des flux de contenu déjà disponibles ailleurs. La position est claire : si votre plateforme se contente de dupliquer du contenu sans ajout de valeur, vous ne serez pas dans les priorités algorithmiques. Cela impacte directement le budget de crawl et la visibilité organique.

Ce qu'il faut comprendre

John Mueller confirme une réalité que beaucoup d'agrégateurs découvrent à leurs dépens : Google n'investit pas de ressources pour crawler et indexer du contenu déjà présent ailleurs sur le web. Cette déclaration vise spécifiquement les sites qui automatisent la récupération de flux RSS, API ou scraping sans enrichissement éditorial.

Le terme « faible effort » mérite attention. Il ne s'agit pas uniquement de duplication technique, mais d'une évaluation qualitative du traitement du contenu. Un agrégateur peut techniquement modifier un flux tout en restant dans cette catégorie si l'intervention humaine ou algorithmique reste minimale.

Qu'est-ce qu'un agrégateur de faible effort selon Google ?

Google cible ici les plateformes qui republication automatiquement du contenu provenant de sources tierces sans traitement significatif. Cela inclut les sites d'annonces immobilières qui dupliquent des flux MLS, les portails emploi récupérant des offres depuis des APIs, ou encore les comparateurs de prix affichant des fiches produits identiques à celles des e-commerçants sources.

Le critère décisif reste l'apport de valeur unique. Si votre contenu est interchangeable avec la source originale, vous êtes dans la zone rouge. La simple restructuration visuelle ou l'ajout d'un filtre de recherche ne suffit pas à sortir de cette catégorie.

Comment Google détecte-t-il ces sites ?

Les signaux combinés permettent cette identification : analyse de similarité textuelle à grande échelle, patterns de publication (volumes massifs en temps réel), absence de comportement utilisateur distinctif, faible taux de rafraîchissement éditorial hors flux automatisés.

Les algorithmes mesurent également la distance sémantique entre votre version et les sources. Un simple spin ou paraphrase automatique ne trompe personne — les modèles linguistiques de Google détectent ces manipulations depuis des années.

Quelles sont les conséquences concrètes pour l'indexation ?

Concrètement, votre site voit son budget de crawl drastiquement réduit. Google passe moins souvent, indexe moins de pages, et même les URLs indexées bénéficient d'une faible priorité de rafraîchissement. Vous constatez des délais d'indexation de plusieurs semaines voire mois pour du nouveau contenu.

L'effet cascade touche aussi le positionnement. Même indexées, vos pages perdent systématiquement face aux sources originales dans les SERPs. Google préfère systématiquement renvoyer l'utilisateur vers le créateur du contenu plutôt que vers un intermédiaire sans valeur ajoutée.

- Budget de crawl limité pour les agrégateurs sans différenciation

- Priorisation systématique des sources originales dans les résultats

- Détection basée sur similarité textuelle et patterns de publication

- Le simple reformatage visuel ne constitue pas une valeur ajoutée suffisante

- Impact mesurable sur les délais d'indexation et la fréquence de crawl

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Totalement. On observe depuis des années que les agrégateurs peinent à maintenir leur visibilité organique, surtout dans les verticales compétitives. Les sites d'annonces immobilières, portails emploi ou comparateurs prix subissent une érosion progressive de leur trafic organique s'ils ne proposent pas de couche éditoriale substantielle.

La nuance importante : certains agrégateurs performent encore, mais ils investissent massivement dans la curation, les avis utilisateurs, les comparatifs éditorialisés, les guides d'achat. Ils ne se contentent pas de republier — ils transforment et contextualisent. La différence entre Leboncoin (qui fonctionne) et un scrapers lambda (qui stagne) tient à cette couche de valeur.

Quelles zones grises subsistent dans cette affirmation ?

Mueller ne précise pas le seuil minimal de transformation pour sortir de la catégorie « faible effort ». Combien de mots originaux faut-il ajouter ? Quelle proportion du contenu doit être unique ? Ces métriques restent floues. [À vérifier] : les équipes de Google n'ont jamais communiqué de ratio précis, ce qui laisse les opérateurs dans l'incertitude.

Autre point trouble : la distinction entre agrégation et syndication autorisée. Certains éditeurs distribuent volontairement leur contenu via des partenaires avec balises canonical ou licence. Google traite-t-il différemment ces cas ? La pratique montre que même avec canonical, un site qui ne fait que republier reste pénalisé en visibilité — seule l'indexation est déduplicata, pas le ranking.

Dans quels cas cette règle ne s'applique-t-elle pas complètement ?

Les agrégateurs verticaux à forte audience bénéficient parfois d'un traitement différent. Google semble tolérer davantage la duplication quand le site présente des signaux d'engagement forts : temps de session élevé, taux de rebond faible, navigation multi-pages. Le moteur interprète ces comportements comme une validation de l'utilité malgré le contenu dupliqué.

Les plateformes avec fonctionnalités interactives (calculateurs, simulateurs, outils de comparaison dynamiques) échappent aussi partiellement à cette logique. Même si le contenu textuel reste dupliqué, l'outil en lui-même constitue une valeur différenciante que Google semble prendre en compte dans ses critères de priorisation.

Impact pratique et recommandations

Que faut-il faire concrètement si vous opérez un agrégateur ?

Première priorité : auditer le ratio contenu original vs dupliqué sur vos pages stratégiques. Identifiez les templates où vous republiez des flux sans modification. Ces pages sont vos points de vulnérabilité principaux. Mesurez le pourcentage de texte unique réellement créé par votre équipe ou vos utilisateurs.

Ensuite, enrichissez systématiquement chaque entrée de contenu agrégé. Ajoutez des avis utilisateurs vérifiés, des comparatifs éditorialisés, des analyses de prix historiques, des guides contextuels. L'objectif : faire en sorte que votre version apporte 30-40% de contenu additionnel minimum par rapport à la source.

Si votre modèle économique repose sur de gros volumes automatisés, repensez votre architecture d'information. Créez des pages de catégories avec du contenu éditorial fort, des hubs thématiques originaux, des ressources exclusives. Laissez les pages produits individuelles en noindex si elles sont purement dupliquées, et concentrez le budget de crawl sur les URLs à valeur ajoutée.

Quelles erreurs éviter absolument ?

Ne tombez pas dans le piège du spinning automatisé. Remplacer des synonymes ou restructurer des phrases via IA générative sans supervision humaine ne trompe pas Google — et dégrade souvent la qualité perçue. Les algorithmes détectent ces manipulations et peuvent durcir leur traitement de votre site.

Évitez également de bloquer le crawl des sources originales en espérant devenir la référence par défaut. Google considère cela comme une manipulation et peut appliquer des sanctions manuelles. Plusieurs cas documentés montrent des pénalités pour ce type de pratique.

Ne négligez pas les signaux utilisateurs. Un agrégateur avec un taux de rebond de 80% et un temps de session de 15 secondes confirme à Google que votre version n'apporte rien. Investissez dans l'UX, la navigation, les fonctionnalités qui incitent à rester et explorer.

Comment vérifier que votre site n'est pas catégorisé comme agrégateur de faible effort ?

Surveillez votre taux d'indexation dans la Search Console. Si vous publiez 1000 nouvelles URLs par jour mais que seulement 10% sont indexées après un mois, c'est un signal d'alarme. Comparez la vitesse d'indexation de vos pages éditoriales originales vs vos pages agrégées — l'écart révèle le traitement algorithmique.

Analysez la distribution de votre trafic organique. Si 90% de vos visites proviennent de 5% de vos pages (les pages éditoriales), pendant que vos millions de fiches agrégées ne génèrent rien, vous avez confirmation du problème. Google vote avec ses clics.

Testez la fraîcheur de crawl sur des échantillons représentatifs. Modifiez des éléments sur des pages agrégées et mesurez le délai avant que Google reflète ces changements. Des délais supérieurs à 2-3 semaines sur des pages théoriquement importantes indiquent une faible priorité algorithmique.

- Mesurer le ratio contenu unique vs dupliqué sur chaque type de page

- Enrichir systématiquement les contenus agrégés avec analyses, avis, comparatifs

- Restructurer l'architecture pour concentrer le crawl sur les pages à valeur ajoutée

- Éviter absolument le spinning automatisé sans supervision humaine

- Surveiller le taux d'indexation et les délais de crawl comme KPI prioritaires

- Investir dans les signaux utilisateurs : temps de session, navigation, engagement

- Privilégier les fonctionnalités interactives qui créent une différenciation réelle

La transformation d'un agrégateur classique en plateforme à valeur ajoutée demande une refonte stratégique profonde : réorganisation éditoriale, investissement technique dans des outils différenciants, restructuration de l'architecture d'information. Ces chantiers peuvent rapidement devenir complexes, surtout quand il faut maintenir les revenus existants pendant la transition.

Beaucoup d'opérateurs sous-estiment l'ampleur des changements nécessaires pour sortir de la catégorie « faible effort ». L'accompagnement par une agence SEO spécialisée dans les problématiques d'agrégation permet d'éviter les faux pas coûteux et d'accélérer la transformation vers un modèle durable aligné avec les attentes algorithmiques de Google.

❓ Questions frequentes

Un agrégateur peut-il utiliser du contenu dupliqué si les sources donnent leur autorisation ?

Combien de contenu original faut-il ajouter pour sortir de la catégorie faible effort ?

Les avis utilisateurs suffisent-ils comme valeur ajoutée sur un agrégateur ?

Faut-il mettre en noindex les pages agrégées sans contenu unique ?

Comment Google distingue-t-il un agrégateur d'une marketplace légitime ?

🎥 De la même vidéo 22

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 28/03/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.