Declaration officielle

Autres déclarations de cette vidéo 22 ▾

- □ Pourquoi la position moyenne de Search Console ne reflète-t-elle pas un classement théorique mais des affichages réels ?

- □ Peut-on encore se permettre d'attendre qu'un classement instable se stabilise tout seul ?

- □ Faut-il vraiment produire plus de contenu pour améliorer son SEO ?

- □ Où placer son sitemap XML pour optimiser son crawl ?

- □ Faut-il vraiment utiliser l'outil d'inspection d'URL pour indexer un nouveau site ?

- □ Combien de temps faut-il attendre pour voir les backlinks dans Search Console ?

- □ Pourquoi les données Search Console et Analytics ne concordent-elles jamais vraiment ?

- □ Search Console collecte-t-elle vraiment toutes les données sur les gros sites e-commerce ?

- □ Faut-il vraiment préférer noindex à disallow pour contrôler l'indexation ?

- □ Les produits en rupture de stock peuvent-ils vraiment être traités comme des soft 404 par Google ?

- □ Les outils de test Google crawlent-ils vraiment en temps réel ou utilisent-ils un cache ?

- □ Google utilise-t-il des algorithmes différents selon votre secteur d'activité ?

- □ Pourquoi Google ignore-t-il les sites agrégateurs de faible effort ?

- □ Google compte-t-il vraiment les clics sur les rich results comme des clics organiques ?

- □ L'ordre des liens dans le HTML influence-t-il vraiment la priorité de crawl de Google ?

- □ Faut-il vraiment éviter les URLs avec paramètres pour le SEO ?

- □ Pourquoi robots.txt bloque le crawl mais n'empêche pas l'indexation de vos pages ?

- □ Les produits en rupture de stock nuisent-ils au classement global de votre site e-commerce ?

- □ Pourquoi Google refuse-t-il d'indexer plusieurs versions d'une même page malgré une canonicalisation correcte ?

- □ Comment Google choisit-il réellement quelle URL canoniser parmi vos contenus dupliqués ?

- □ Les mentions de marque sans lien ont-elles une valeur SEO ?

- □ Pourquoi un lien sans URL indexée ne sert strictement à rien ?

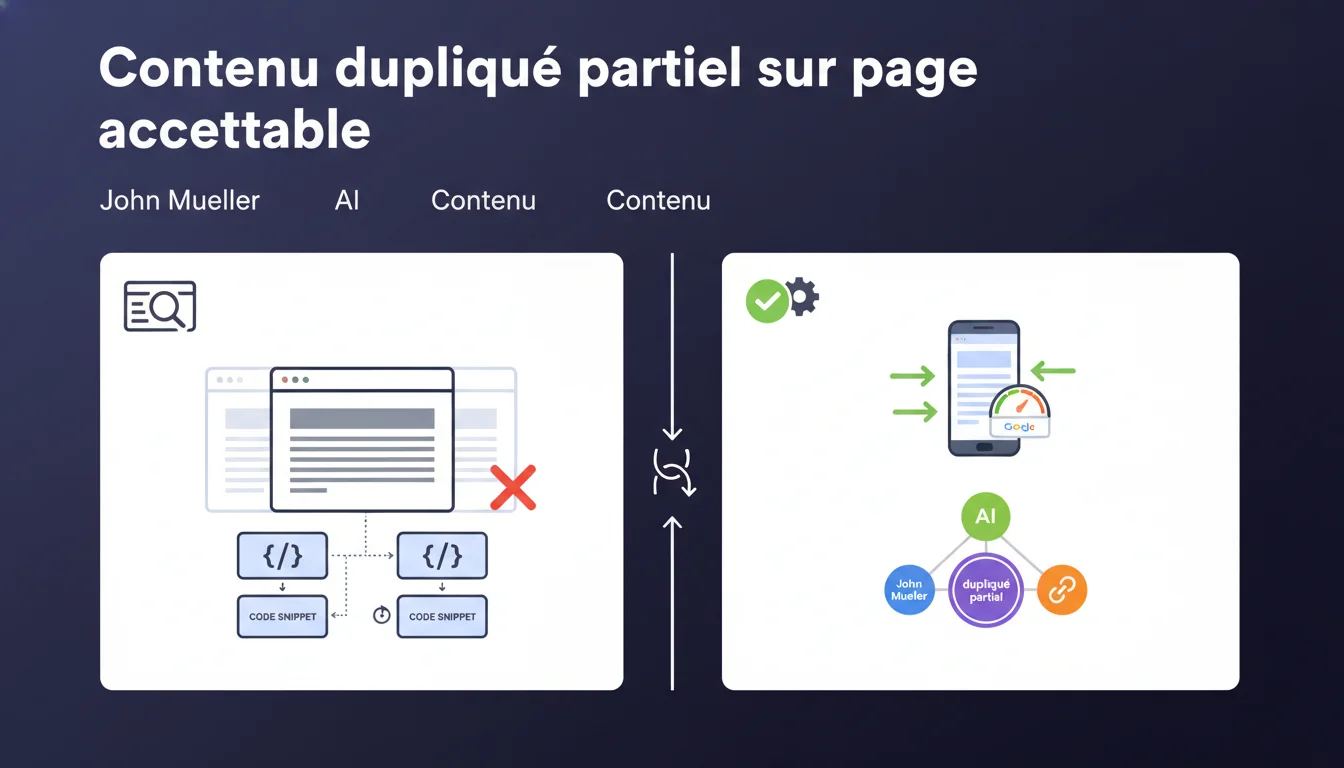

Google confirme que la duplication partielle de contenu sur une page n'est pas pénalisante. Les éléments récurrents comme des snippets de code, des citations ou des éléments de structure partagés entre pages similaires sont parfaitement acceptables selon John Mueller.

Ce qu'il faut comprendre

Que signifie exactement « contenu dupliqué partiel » dans cette déclaration ?

Mueller parle ici de portions de contenu identiques présentes sur plusieurs pages d'un même site ou entre sites différents. Concrètement : des blocs de code, des définitions récurrentes, des tableaux de données comparatives, des mentions légales standardisées.

La nuance est importante — il ne s'agit pas de pages entièrement dupliquées, mais d'éléments structurels ou informationnels qui se répètent naturellement. Google admet que cette répétition fait partie de la logique éditoriale de certains contenus techniques ou verticaux.

Pourquoi Google tolère-t-il cette duplication partielle ?

Parce que l'algorithme est censé faire la différence entre duplication manipulatrice et duplication fonctionnelle. Un snippet de code Python expliquant la même fonction sur 10 tutoriels différents n'a aucune raison d'être pénalisé si le reste du contenu apporte une valeur différenciée.

Google cherche à identifier l'intention éditoriale. Si la répétition sert l'utilisateur — comparaison produits, documentation technique, exemples pratiques — elle n'est pas considérée comme spam. C'est la logique derrière cette tolérance.

- La duplication partielle (blocs récurrents) est tolérée si elle a un sens éditorial

- La duplication totale ou quasi-totale reste problématique pour le classement

- Google évalue le contexte global de la page, pas juste la présence de segments identiques

- Les éléments techniques (code, formules, données) bénéficient d'une tolérance particulière

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui et non. Dans les faits, beaucoup de sites avec des blocs récurrents massifs — fiches produits avec descriptions génériques, pages de catégories avec intros standardisées — ne subissent aucune pénalité visible. Mais nuançons : certains secteurs ultra-compétitifs voient leurs pages cannibalisées ou désindexées malgré une duplication « acceptable » selon cette logique.

Le problème, c'est que Mueller ne donne aucun seuil quantitatif. 10% de duplication partielle ? 30% ? 50% ? Impossible de savoir où Google trace la ligne. [À vérifier] : cette tolérance s'applique-t-elle uniformément à tous les secteurs ou Google est-il plus strict sur des niches saturées (finance, santé, e-commerce) ?

Quelles sont les zones grises que Google évite d'aborder ?

Mueller ne parle pas des pages techniques générées automatiquement — pensez aux sites immobiliers avec 5000 fiches ville suivant le même template. Techniquement, c'est de la duplication partielle. En pratique, Google les tolère… jusqu'à un certain point qui reste flou.

Autre angle mort : la duplication cross-domaine. Si vous republiez le même snippet de code sur votre blog et Medium, est-ce aussi « acceptable » ? La déclaration ne le précise pas. L'expérience montre que Google favorise souvent la source originale, mais pas systématiquement.

Impact pratique et recommandations

Que faut-il faire concrètement avec vos contenus récurrents ?

Auditer la proportion de contenu unique reste la priorité. Même si Google tolère des blocs partagés, une page avec 70% de contenu dupliqué et 30% d'unique aura toujours moins de poids qu'une page avec 80% d'unique. Utilisez des outils comme Copyscape ou Siteliner pour mesurer le taux de similarité.

Pour les éléments techniques — code, formules, définitions —, pas de paranoïa. Mais ajoutez du contexte différencié autour : cas d'usage spécifiques, explications complémentaires, variations d'implémentation. C'est ce contexte qui fait basculer la page du côté « valeur ajoutée ».

Quelles erreurs éviter absolument ?

Ne vous cachez pas derrière cette déclaration pour justifier des pages paresseuses. « Google dit que c'est OK » ne compense pas un contenu qui n'apporte rien de nouveau. Si vos 20 pages régionales suivent le même schéma avec juste le nom de ville qui change, vous êtes dans la zone rouge — duplication partielle ou pas.

Évitez aussi de dupliquer les éléments SEO critiques : title, meta description, H1, premier paragraphe. Ces zones ont un poids disproportionné dans l'évaluation de la pertinence. Même si le corps de texte partage des segments, ces éléments doivent être uniques.

- Mesurer le ratio contenu unique / contenu partagé sur vos pages stratégiques

- Identifier les blocs récurrents légitimes (code, données, citations) vs les duplications paresseuses

- Enrichir systématiquement le contexte autour des éléments partagés

- Garantir l'unicité des zones SEO à fort impact (title, H1, intro, meta)

- Surveiller les performances des pages avec duplication partielle : perte de positions = signal d'alerte

- Tester l'impact de la réécriture progressive des blocs partagés sur des pages test

❓ Questions frequentes

Un snippet de code identique sur 50 pages techniques peut-il pénaliser mon site ?

Quel pourcentage de duplication partielle est acceptable ?

La duplication partielle cross-domaine est-elle tolérée de la même manière ?

Dois-je utiliser rel=canonical sur des pages avec duplication partielle ?

Les pages avec blocs récurrents sont-elles moins bien classées ?

🎥 De la même vidéo 22

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 28/03/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.