Declaration officielle

Autres déclarations de cette vidéo 18 ▾

- □ Canonical seul ne suffit pas pour bloquer le contenu syndiqué dans Discover : faut-il vraiment ajouter noindex ?

- □ Deux domaines pour un même pays : où commence vraiment la manipulation ?

- □ Les failles JavaScript de vos bibliothèques font-elles chuter votre positionnement Google ?

- □ Peut-on vraiment empêcher Google de crawler certaines parties d'une page HTML ?

- □ Faut-il encore perdre du temps à soumettre son sitemap XML ?

- □ Pourquoi les données structurées Schema.org ne suffisent-elles pas toujours pour obtenir des résultats enrichis Google ?

- □ Les en-têtes HSTS ont-ils vraiment un impact sur votre référencement ?

- □ Sitemap HTML vs XML : pourquoi Google insiste-t-il sur leur différence de fonction ?

- □ Les données structurées avec erreurs sont-elles vraiment ignorées par Google ?

- □ Les chiffres dans vos URLs pénalisent-ils vraiment votre référencement ?

- □ L'index bloat existe-t-il vraiment chez Google ?

- □ Comment bloquer définitivement Googlebot de votre site ?

- □ Google délivre-t-il vraiment des certifications SEO officielles ?

- □ Plusieurs menus de navigation nuisent-ils vraiment au SEO ?

- □ Les host groups indiquent-ils vraiment une cannibalisation à corriger ?

- □ Peut-on désavouer des backlinks toxiques en ciblant leur adresse IP ?

- □ Faut-il supprimer la balise meta NOODP de vos sites Blogger ?

- □ Comment obtenir une vignette vidéo dans les SERP : qu'entend Google par « contenu principal » ?

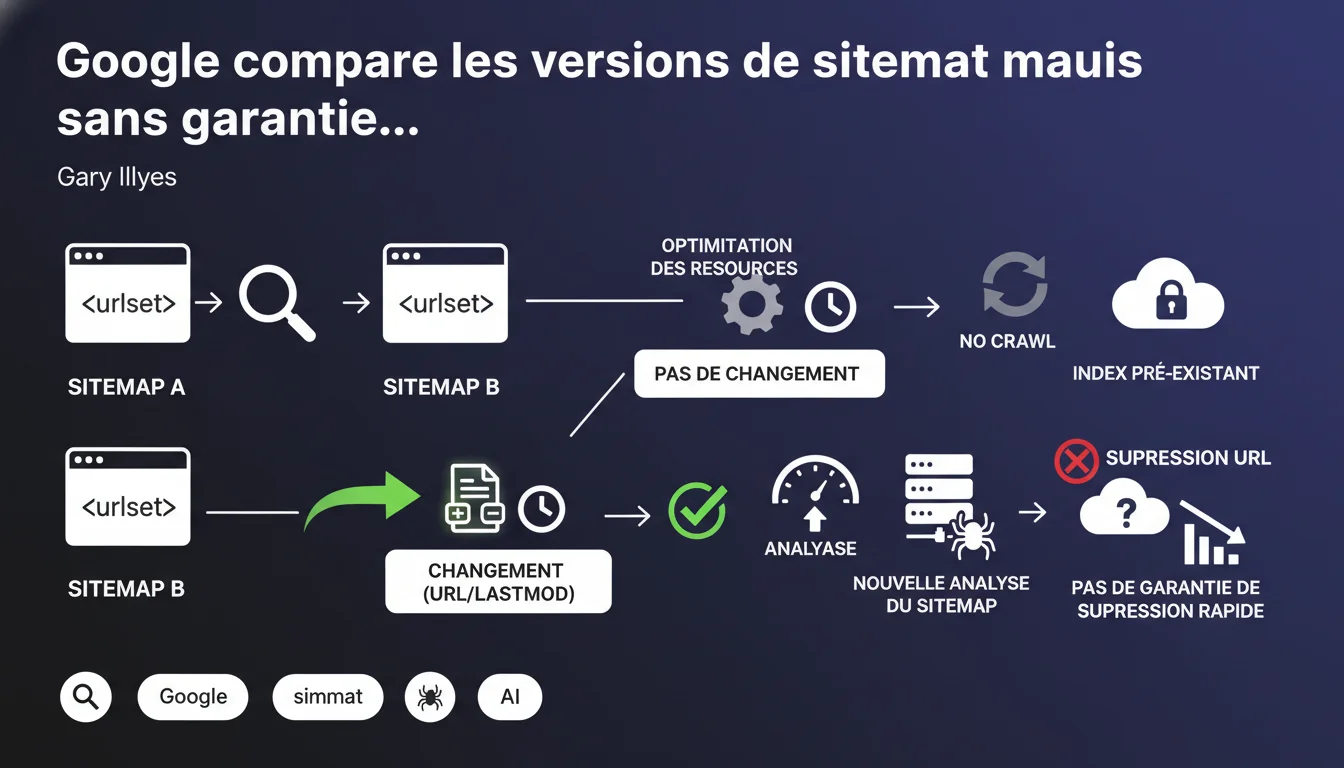

Google ne retraite pas un sitemap identique au dernier crawl — pure optimisation de ressources. Dès qu'une URL ou un lastmod change, le sitemap est analysé à nouveau. Retirer une URL du sitemap ne garantit absolument pas sa suppression rapide de l'index.

Ce qu'il faut comprendre

Comment Google détecte-t-il qu'un sitemap a changé ?

Google compare la version actuelle du sitemap avec celle enregistrée lors du précédent crawl. Si le contenu est strictement identique — même structure XML, mêmes URLs, mêmes attributs lastmod — le fichier n'est pas retraité.

C'est une stratégie d'optimisation des ressources côté Google. Pourquoi analyser 10 000 URLs si rien n'a bougé ? Le bot économise du temps de calcul et du crawl budget pour d'autres tâches.

Qu'est-ce qui déclenche un nouveau traitement du sitemap ?

Deux éléments principaux : l'ajout ou la suppression d'une URL, et la modification d'une balise lastmod. Même une seule ligne modifiée suffit à relancer l'analyse complète du fichier.

Concrètement ? Si vous ajoutez une nouvelle page ou changez la date de dernière modification d'une URL existante, Google retraite le sitemap entier lors du prochain crawl.

Retirer une URL du sitemap force-t-il sa désindexation ?

Non. C'est une erreur courante de croire que supprimer une URL du sitemap entraîne sa suppression rapide de l'index.

Le sitemap est un signal de découverte, pas un ordre de désindexation. Google peut conserver l'URL en index si elle reste accessible et liée depuis d'autres pages.

- Le sitemap n'est pas retraité si aucun changement n'est détecté depuis le dernier crawl

- Toute modification d'URL ou de lastmod déclenche un nouveau traitement complet

- Supprimer une URL du sitemap ne garantit pas sa suppression de l'index

- Le sitemap reste un signal de découverte, pas un outil de contrôle strict de l'indexation

Avis d'un expert SEO

Cette déclaration correspond-elle aux observations terrain ?

Oui. On observe depuis des années que Google ne crawle pas systématiquement les sitemaps statiques. Les logs montrent clairement que certains fichiers XML ne sont même pas touchés pendant des semaines si le site n'évolue pas.

Par contre, Gary Illyes reste vague sur la fréquence de vérification. Combien de temps Google attend-il avant de contrôler si un sitemap a changé ? Ça dépend du crawl budget, de la popularité du site, de la fraîcheur des contenus — bref, aucune règle universelle. [A vérifier] au cas par cas via les logs.

Faut-il vraiment se fier au lastmod pour forcer un retraitement ?

Le lastmod est un signal, pas une garantie. Google peut l'ignorer s'il détecte que la page n'a pas réellement changé — ou s'il soupçonne une manipulation.

Modifier artificiellement toutes les dates lastmod pour "réveiller" Google ? Mauvaise idée. Le bot n'est pas dupe : si le contenu HTML reste identique, le signal perd sa crédibilité. À terme, Google pourrait carrément ignorer vos lastmod.

Pourquoi supprimer une URL du sitemap ne suffit-il pas à la désindexer ?

Parce que le sitemap n'est qu'un des canaux de découverte. Google peut trouver l'URL via le maillage interne, des backlinks externes, l'historique de crawl — et la garder en index tant qu'elle renvoie un 200.

Pour désindexer proprement : combinaison noindex + suppression du sitemap + éventuellement robots.txt si vous voulez bloquer le crawl. Ou mieux : 404/410 si la page n'a plus lieu d'exister.

Impact pratique et recommandations

Comment optimiser la gestion de vos sitemaps ?

Première règle : ne surchargez pas vos sitemaps avec des URLs inutiles. Si Google ne retraite pas un fichier identique, autant s'assurer qu'il contient uniquement des pages stratégiques.

Segmentez vos sitemaps par type de contenu ou par fraîcheur. Un sitemap dédié aux nouveautés sera retraité plus souvent qu'un fichier statique avec des pages anciennes rarement modifiées.

Quelles erreurs éviter avec les attributs lastmod ?

Ne modifiez pas systématiquement toutes les dates lastmod à chaque génération de sitemap. C'est contre-productif et ça dégrade la confiance que Google accorde à vos signaux.

Mettez à jour le lastmod uniquement quand le contenu de la page a réellement changé — refonte, ajout de sections, mise à jour d'infos clés. Pas pour un simple changement de pied de page ou d'encart publicitaire.

Comment forcer la désindexation d'URLs supprimées du sitemap ?

Retirer une URL du sitemap ne suffit pas. Combinaison gagnante : 404 ou 410 si la page n'existe plus, ou noindex si elle doit rester accessible mais hors index.

Ensuite, demandez une réexploration via Search Console pour accélérer la prise en compte. Surveillez les logs pour vérifier que Google crawle effectivement les URLs concernées.

- Segmenter les sitemaps par type de contenu ou fréquence de mise à jour

- Ne modifier le lastmod que si le contenu de la page a réellement changé

- Ne jamais compter uniquement sur le sitemap pour désindexer — utiliser 404/410 ou noindex

- Vérifier via les logs que Google crawle bien les sitemaps modifiés

- Éviter les sitemaps surchargés avec des milliers d'URLs peu stratégiques

- Demander une réexploration manuelle via Search Console pour les changements critiques

❓ Questions frequentes

Google crawle-t-il mon sitemap à chaque fois qu'il visite mon site ?

Modifier uniquement le lastmod suffit-il à forcer un nouveau traitement du sitemap ?

Retirer une URL du sitemap la fait-elle disparaître de l'index ?

Combien de temps Google met-il à détecter un changement dans mon sitemap ?

Puis-je segmenter mes sitemaps pour optimiser leur retraitement ?

🎥 De la même vidéo 18

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 07/06/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.