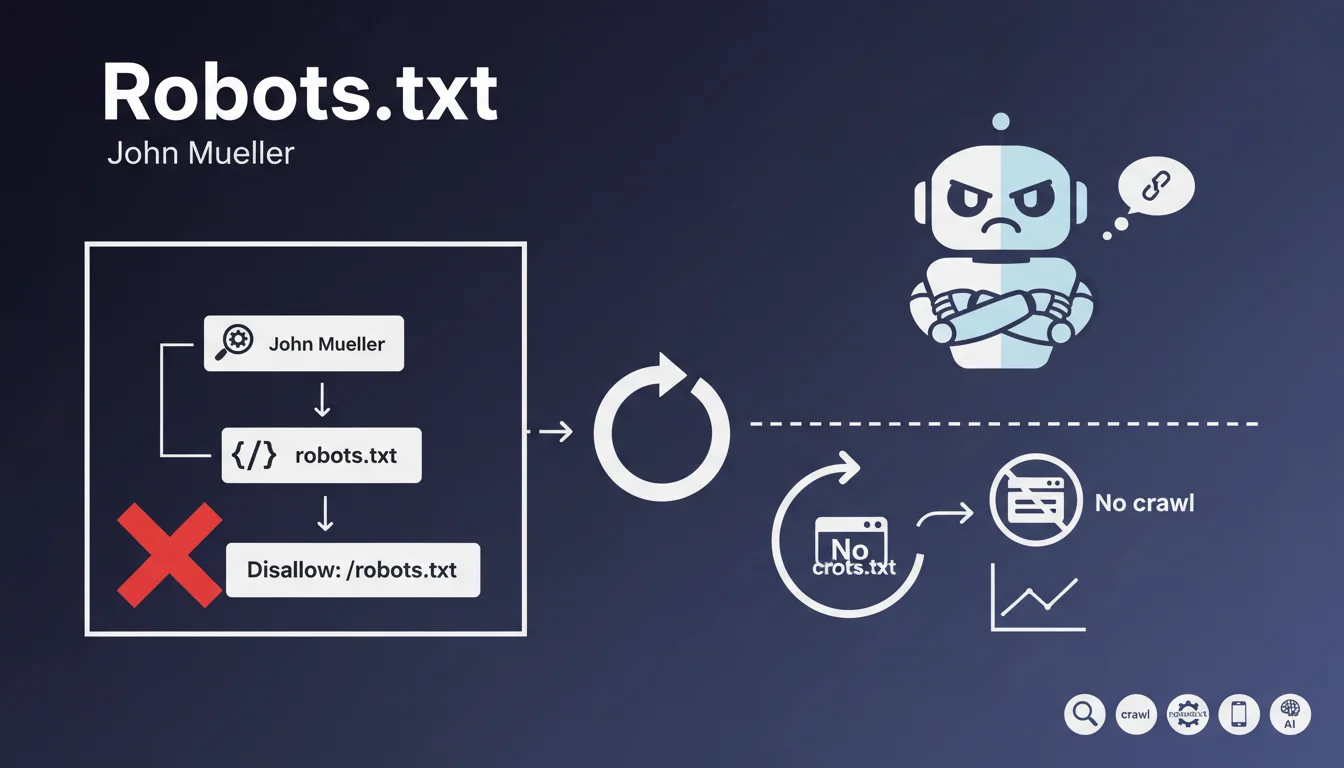

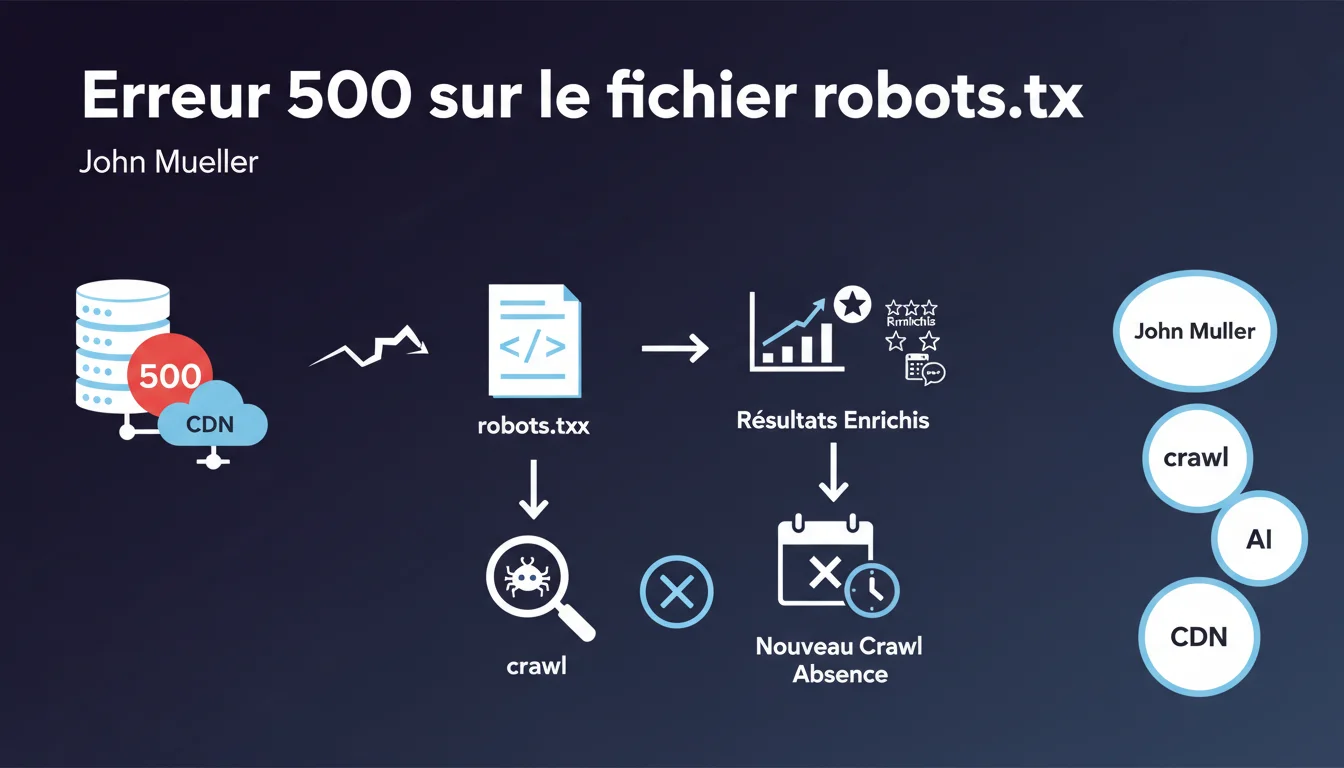

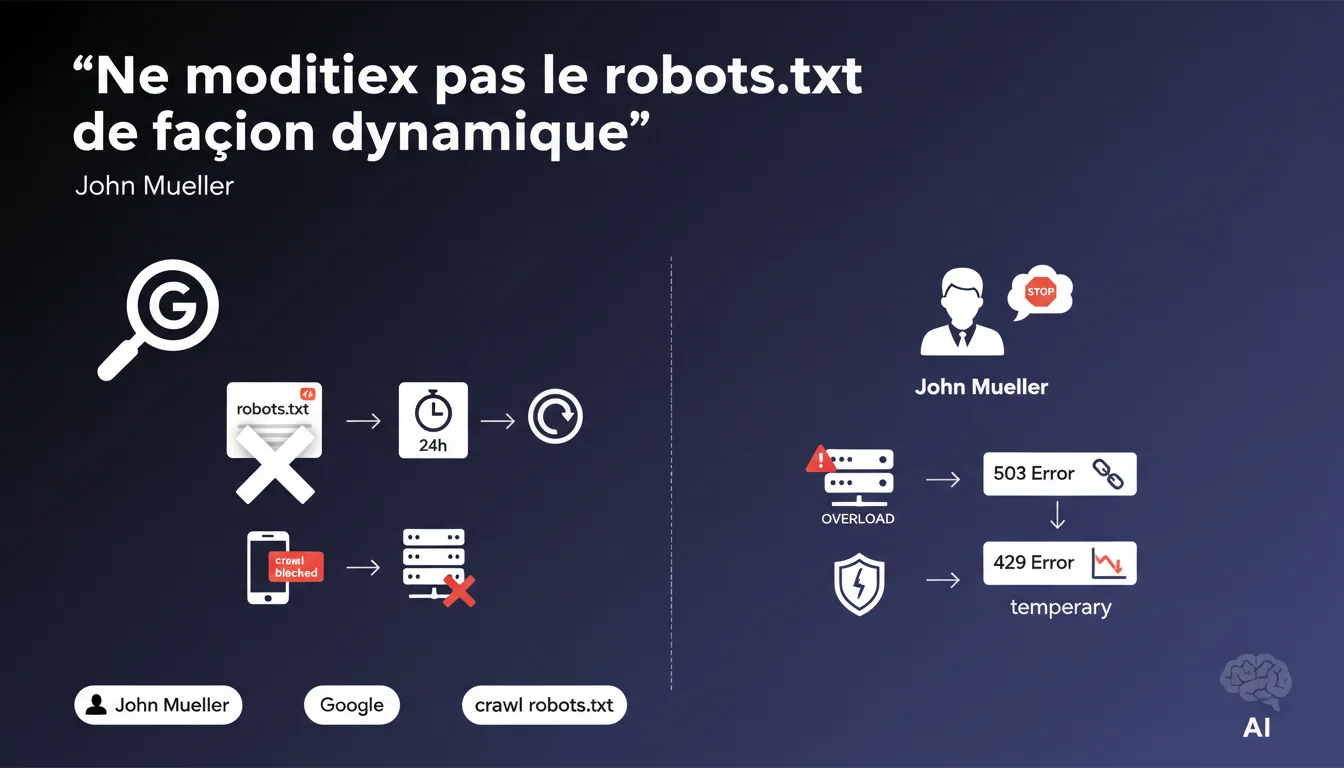

Une erreur 500 sur votre robots.txt peut-elle vraiment bloquer tout le crawl de votre site ?

John Mueller

21/03/2022

★★★

Toujours dans ce hangout, John Mueller a indiqué que si, lorsque le robot tente de lire le fichier robots.txt d'un site, il recevait une err...