Declaration officielle

Ce qu'il faut comprendre

Pourquoi vouloir mettre un sitemap en noindex ?

Le fichier sitemap XML est un outil destiné aux robots des moteurs de recherche pour découvrir et indexer les pages importantes d'un site. Paradoxalement, ce fichier technique peut lui-même apparaître dans les résultats de recherche, ce qui n'apporte aucune valeur aux utilisateurs.

En ajoutant une directive noindex via l'en-tête HTTP, vous indiquez aux moteurs de ne pas afficher ce fichier dans leurs SERP. Cela n'empêche absolument pas les robots de le crawler et d'utiliser les URLs qu'il contient.

Comment Google traite-t-il un sitemap en noindex ?

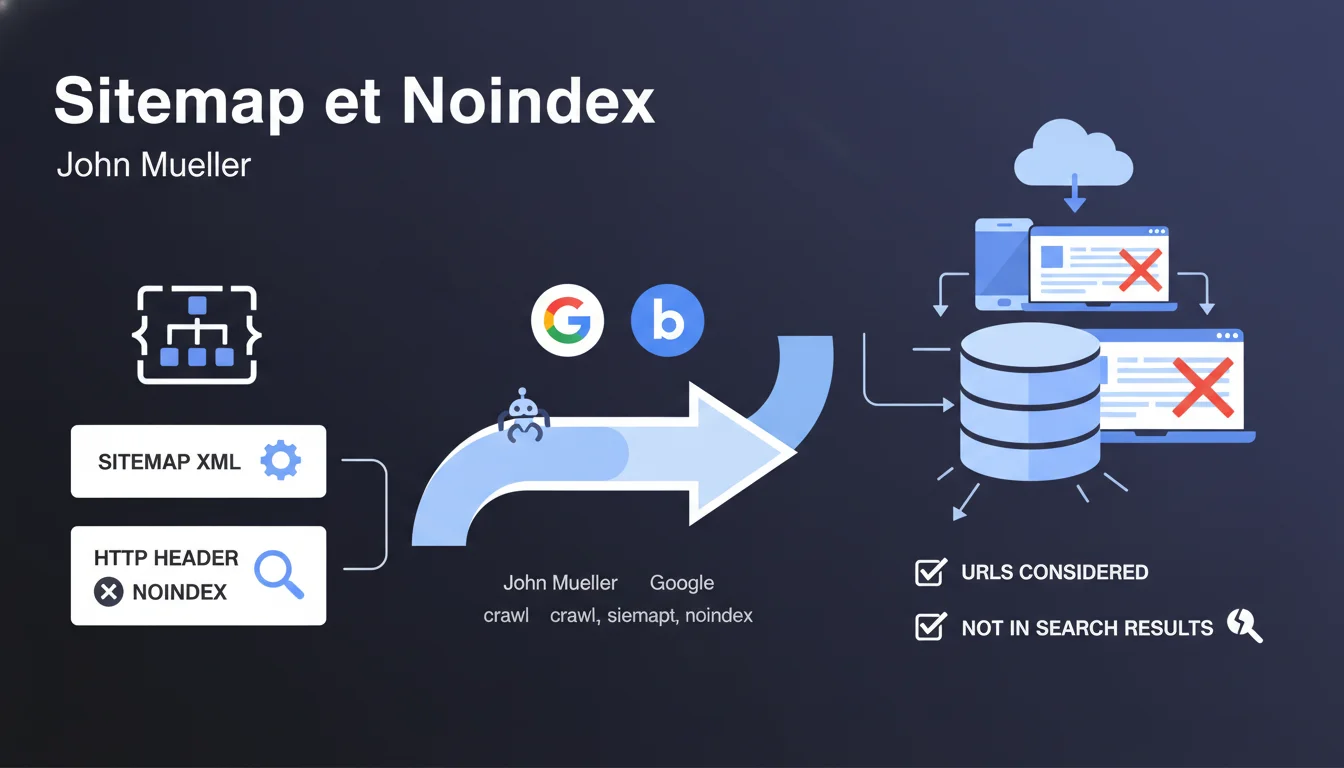

Google et Bing ont confirmé que la directive noindex sur un sitemap n'affecte que la visibilité du fichier lui-même dans les résultats. Les robots continuent de le télécharger, de l'analyser et de découvrir les URLs listées.

Cette distinction est cruciale : le noindex empêche l'indexation du sitemap comme page de résultat, mais ne bloque pas son rôle de guide pour le crawl. Les URLs contenues restent parfaitement éligibles à l'indexation.

Quelle est la différence entre noindex et robots.txt ?

Bloquer le sitemap via robots.txt empêcherait Google de le crawler et donc d'en exploiter le contenu. C'est une erreur fréquente qui prive le moteur d'informations précieuses sur la structure du site.

Le noindex via en-tête HTTP, en revanche, permet au robot de lire le fichier tout en évitant qu'il ne pollue l'index. C'est l'approche recommandée pour les fichiers techniques.

- Le sitemap XML peut recevoir une directive noindex sans impact sur son utilité

- Les URLs contenues dans le sitemap restent crawlables et indexables normalement

- Cette pratique évite l'apparition du sitemap dans les résultats de recherche

- Ne jamais confondre noindex (en-tête HTTP) et blocage robots.txt

- Le noindex s'applique au fichier sitemap, pas aux URLs qu'il référence

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Dans mes 15 années d'expérience, j'ai effectivement constaté que les sitemaps apparaissent parfois dans l'index, notamment pour des sites moins autoritaires ou avec des problèmes de maillage interne. Cette pollution de l'index est non seulement inesthétique mais peut aussi diluer l'autorité du domaine.

La confirmation de John Mueller valide une pratique déjà adoptée par certains SEO avancés. Cette approche est particulièrement pertinente pour les sites e-commerce avec des dizaines de sitemaps ou les plateformes générant des sitemaps dynamiques multiples.

Quelles nuances et précautions faut-il apporter ?

Il est crucial de comprendre que le noindex doit être appliqué via l'en-tête HTTP, pas via une balise meta dans le XML. Le sitemap étant un fichier XML et non HTML, une balise meta n'aurait aucun effet et pourrait même invalider le format.

Attention également à ne pas confondre cette pratique avec le noindex des pages référencées. Mettre le sitemap en noindex n'affecte en rien le statut d'indexation des URLs listées à l'intérieur, qui suivent leurs propres directives.

Dans quels cas cette pratique est-elle vraiment nécessaire ?

Pour la majorité des sites, l'apparition du sitemap dans l'index n'est pas un problème critique. Google est généralement assez efficace pour ne pas afficher ces fichiers techniques dans les résultats standards.

Cependant, pour les grands sites avec une architecture complexe, les plateformes avec de nombreux sous-domaines, ou les sites ayant des problèmes d'indexation de pages de faible qualité, cette pratique peut être bénéfique. Elle apporte une couche supplémentaire de contrôle sur ce qui apparaît dans l'index.

Impact pratique et recommandations

Comment mettre concrètement un sitemap en noindex ?

La méthode recommandée consiste à configurer votre serveur web pour ajouter un en-tête HTTP X-Robots-Tag avec la valeur "noindex" spécifiquement pour les fichiers sitemap.xml. Sur Apache, cela se fait via le fichier .htaccess avec une directive Header set.

Sur Nginx, vous ajouterez une configuration dans le bloc location correspondant au sitemap. Sur les CMS comme WordPress, certains plugins SEO avancés permettent de gérer ces en-têtes sans toucher à la configuration serveur.

Vérifiez ensuite avec les outils de développement du navigateur que l'en-tête X-Robots-Tag: noindex est bien présent dans la réponse HTTP lors de l'accès au sitemap.

Quelles erreurs éviter lors de la mise en place ?

L'erreur la plus fréquente est de bloquer le sitemap via robots.txt en pensant obtenir le même résultat. Cela empêcherait Google de le crawler et rendrait le fichier totalement inutile.

Ne tentez pas non plus d'ajouter une balise meta robots dans le XML : cela invaliderait le format du sitemap et pourrait entraîner des erreurs dans la Search Console. Le noindex doit impérativement passer par l'en-tête HTTP.

Enfin, évitez d'appliquer ce noindex de manière globale à tous les fichiers XML de votre site, car certains pourraient avoir besoin d'être indexés selon votre stratégie de contenu.

Que faut-il vérifier après l'implémentation ?

Contrôlez dans la Google Search Console que vos sitemaps continuent d'être traités normalement. Le rapport Sitemaps doit indiquer que Google peut toujours les lire et qu'il découvre les URLs contenues.

Surveillez également que le fichier sitemap lui-même disparaisse progressivement de l'index. Une recherche site:votredomaine.com/sitemap.xml ne devrait plus retourner de résultat après quelques semaines.

- Configurer l'en-tête HTTP X-Robots-Tag: noindex sur les fichiers sitemap uniquement

- Vérifier la présence de l'en-tête avec les outils développeur du navigateur

- Ne jamais bloquer le sitemap via robots.txt

- Contrôler que la Search Console traite toujours les sitemaps normalement

- Surveiller la désindexation progressive du fichier sitemap dans les SERP

- Maintenir les URLs référencées dans le sitemap avec leurs directives d'indexation propres

- Documenter cette configuration pour les futures migrations ou changements de serveur

La possibilité de mettre un sitemap en noindex sans affecter son utilité pour le crawl représente une optimisation technique avancée qui nécessite une compréhension fine des mécanismes d'indexation. Cette configuration doit être mise en place au niveau serveur avec précision.

Pour les sites complexes avec des enjeux importants de crawl budget et de propreté de l'index, ce type d'optimisation fait partie d'une approche SEO technique approfondie. Si ces aspects vous semblent complexes ou chronophages, l'accompagnement par une agence SEO spécialisée peut s'avérer judicieux pour mettre en place ces configurations de manière sécurisée et personnalisée selon votre infrastructure spécifique.

💬 Commentaires (0)

Soyez le premier à commenter.