Declaration officielle

Ce qu'il faut comprendre

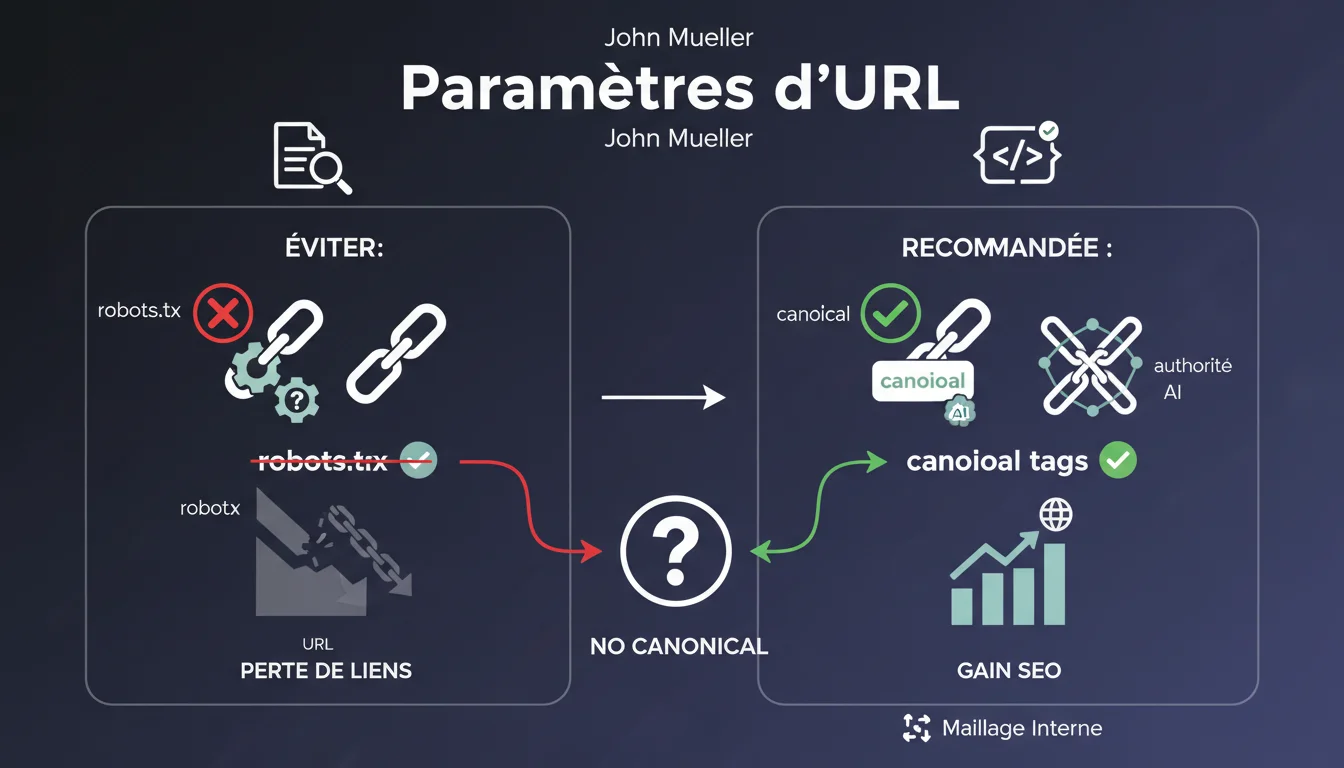

Google a clarifié sa position concernant la gestion des paramètres d'URL : le fichier robots.txt reste la méthode privilégiée pour bloquer le crawl d'URLs avec paramètres complexes. L'outil de traitement des paramètres d'URL dans la Search Console ne constitue pas une alternative suffisante.

Cette déclaration met en lumière une hiérarchie claire entre les outils de contrôle du crawl. Le robots.txt agit en amont, empêchant directement les robots d'accéder aux URLs, tandis que l'outil Search Console ne fait qu'indiquer à Google comment interpréter ces paramètres après coup.

Les points essentiels à retenir :

- Le robots.txt offre un contrôle universel, valable pour tous les moteurs de recherche (Google, Bing, etc.)

- L'outil de paramètres d'URL de la Search Console ne fonctionne que pour Google

- Une gestion « propre » via robots.txt est techniquement plus efficace

- L'outil Search Console n'a pas été migré vers la nouvelle version, questionnant sa pérennité

Pour un praticien SEO, cela signifie qu'il faut repenser la stratégie de gestion des paramètres d'URL en privilégiant une approche centralisée via robots.txt plutôt que de se reposer sur des outils spécifiques à un moteur.

Avis d'un expert SEO

Cette position de Google est parfaitement cohérente avec les bonnes pratiques SEO observées depuis des années. Le robots.txt a toujours été l'outil de référence pour contrôler le crawl budget, et cette déclaration confirme qu'il reste la solution la plus robuste et pérenne.

Toutefois, une nuance importante mérite d'être apportée : bloquer via robots.txt empêche l'indexation mais peut parfois créer des problèmes avec les signaux de liens. Si des URLs avec paramètres reçoivent des backlinks, les bloquer complètement peut faire perdre ce jus de liens. Dans ce cas, une approche combinée avec des canonicals reste préférable.

Il existe également des situations où les paramètres d'URL sont nécessaires pour le fonctionnement du site (filtres de recherche, tracking interne). Dans ces cas, il faut privilégier une architecture propre avec des balises canonical plutôt qu'un blocage systématique.

Impact pratique et recommandations

- Auditez vos URLs avec paramètres : identifiez tous les paramètres utilisés sur votre site (pagination, tri, filtres, tracking, session IDs)

- Classez ces paramètres : distinguez ceux qui génèrent du contenu unique de ceux qui créent du duplicate content

- Configurez votre robots.txt : ajoutez des règles Disallow pour bloquer les paramètres inutiles (session IDs, paramètres de tracking internes)

- Implémentez des canonicals : pour les paramètres nécessaires au fonctionnement (filtres, tri), utilisez rel=canonical plutôt que de bloquer

- Testez avec Google Search Console : utilisez l'outil de test du robots.txt pour vérifier que vos règles fonctionnent correctement

- Documentez votre stratégie : créez une documentation claire listant tous les paramètres et leur traitement (bloqué, canonical, indexable)

- Surveillez votre crawl budget : suivez l'évolution du nombre de pages crawlées dans la Search Console après vos modifications

- Pensez multi-moteurs : votre configuration robots.txt bénéficiera également à Bing, Yandex et autres moteurs

La gestion technique des paramètres d'URL et l'optimisation du crawl budget peuvent rapidement devenir complexes, particulièrement sur les sites e-commerce ou les plateformes avec de nombreux filtres. Un diagnostic approfondi nécessite une expertise pointue pour éviter de bloquer accidentellement des contenus stratégiques ou de gaspiller du crawl budget sur des pages inutiles.

Ces optimisations techniques demandent une approche méthodique et personnalisée selon votre architecture spécifique. Si vous gérez un site avec plusieurs milliers d'URLs et de nombreux paramètres, faire appel à une agence SEO spécialisée peut vous permettre d'obtenir un accompagnement sur mesure, d'éviter les erreurs coûteuses et de maximiser rapidement l'efficacité de votre crawl budget.

💬 Commentaires (0)

Soyez le premier à commenter.