Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Google supporte-t-il vraiment JavaScript pour le SEO ou est-ce un leurre ?

- □ Le JavaScript ralentit-il réellement l'indexation de votre site ?

- □ Faut-il vraiment abandonner JavaScript pour le SSR en SEO ?

- □ Pourquoi la configuration JavaScript de votre site est-elle un point de contrôle critique pour Google ?

- □ Faut-il vraiment maîtriser Chrome DevTools pour faire du SEO technique ?

- □ Faut-il vraiment maîtriser le fonctionnement des navigateurs pour faire du SEO technique ?

- □ Faut-il vraiment se fier uniquement à la documentation officielle de Google ?

- □ Pourquoi le trafic ne devrait-il jamais être votre seule métrique SEO ?

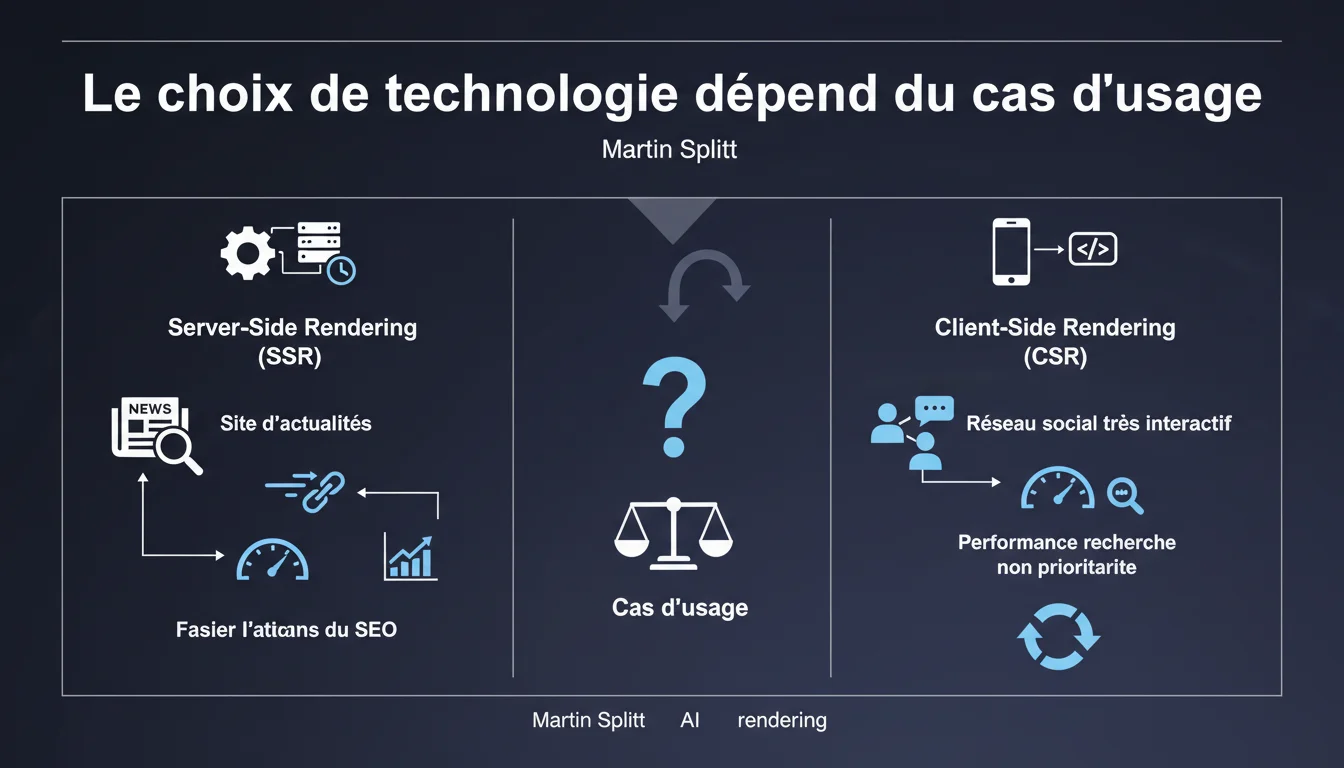

Martin Splitt affirme que le choix entre SSR et CSR doit dépendre du cas d'usage : SSR recommandé pour les sites d'actualités, CSR toléré pour les réseaux sociaux où la performance SEO n'est pas prioritaire. Une position qui simplifie dangereusement la réalité technique et ignore les nuances de l'écosystème JavaScript moderne.

Ce qu'il faut comprendre

Que dit exactement Google sur le choix SSR vs CSR ?

Martin Splitt pose un principe apparemment simple : adapter la stratégie de rendu selon la nature du projet. Pour un site d'actualités qui dépend massivement du trafic organique, le SSR (Server-Side Rendering) reste la recommandation officielle. Pour un réseau social où l'interaction prime sur la découvrabilité, le CSR (Client-Side Rendering) devient acceptable.

Cette distinction repose sur l'idée que tous les sites n'ont pas les mêmes objectifs business. Un média vit de son référencement. Un réseau social vit de sa base utilisateurs captive — le SEO y joue un rôle marginal comparé à l'expérience en temps réel.

Pourquoi Google maintient-il cette différenciation ?

Parce que Googlebot gère le JavaScript, mais avec des limitations qui n'ont jamais été totalement levées. Le budget crawl, le délai de rendu, la dépendance aux ressources externes : autant de friction qui pénalisent les sites CSR purs.

En recommandant le SSR pour les contenus critiques, Google admet indirectement que son infrastructure préfère toujours le HTML statique. C'est moins coûteux à crawler, plus rapide à indexer, plus fiable dans la restitution du contenu.

Cette approche reflète-t-elle vraiment les usages terrain ?

Pas totalement. La dichotomie SSR/CSR est datée — elle ignore les architectures hybrides qui dominent aujourd'hui : SSR initial avec hydratation client, rendu incrémental (ISR), streaming SSR. Next.js, Nuxt, SvelteKit ont rendu ces distinctions binaires obsolètes.

Un site d'actualités moderne peut très bien servir du SSR pour les articles tout en gardant du CSR pour les espaces commentaires ou les modules personnalisés. Splitt simplifie un paysage technique qui s'est considérablement complexifié.

- SSR recommandé pour les contenus indexables critiques (actualités, e-commerce, institutionnel)

- CSR toléré pour les applications où le SEO n'est pas le moteur principal (dashboards, réseaux sociaux fermés)

- Architectures hybrides non mentionnées alors qu'elles représentent la majorité des projets modernes

- Performance de crawl reste le critère décisif pour Google, même si Googlebot exécute JavaScript

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe en pratique ?

Oui et non. La préférence de Google pour le SSR sur les sites contenu-centrés est confirmée par des tests répétés : le time-to-index est systématiquement plus court avec du HTML statique. Pas de surprise.

Mais — et c'est là que ça coince — affirmer qu'un réseau social peut se permettre du CSR pur parce que "la performance en recherche n'est pas prioritaire" relève d'une vision binaire qui ne tient pas face aux ambitions SEO réelles de ces plateformes. LinkedIn, Twitter (X), Pinterest investissent massivement dans le SSR pour leurs pages publiques. Pourquoi ? Parce que le trafic organique compte, même pour eux.

Quelles nuances Splitt omet-il volontairement ?

Première omission : l'impact des Core Web Vitals. Un site CSR mal optimisé accumule les pénalités sur LCP, CLS, INP. Ce n'est plus seulement un problème de crawl, c'est un problème de classement direct. Splitt n'en parle pas.

Deuxième omission : le coût réel du rendu côté serveur à grande échelle. SSR = charge CPU, latence réseau, complexité d'infrastructure. Pour un petit média, c'est gérable. Pour un site à fort trafic, ça devient un enjeu d'architecture majeur. [À vérifier] : Google mesure-t-il l'impact de cette charge sur les temps de réponse serveur dans ses signaux de ranking ?

Troisième angle mort : les frameworks modernes permettent du SSR conditionnel (uniquement pour Googlebot) ou du pre-rendering statique. Ces approches contournent le problème — Splitt fait comme si elles n'existaient pas.

Dans quels cas cette recommandation ne s'applique-t-elle pas ?

Concrètement ? Dès qu'on sort du schéma caricatural "site d'actu vs réseau social". Un SaaS B2B avec un blog SEO performant aura besoin de SSR pour le blog, mais du CSR pour l'app elle-même. Un e-commerce peut vouloir du SSR pour les fiches produits, du CSR pour le panier et le checkout.

La vraie question n'est jamais "SSR ou CSR ?". C'est "quelle partie de mon site doit être crawlable immédiatement ?". Tout le reste est architecture.

Impact pratique et recommandations

Que faut-il faire concrètement avec cette information ?

Cartographiez votre site en deux catégories : contenus critiques pour le SEO (fiches produits, articles, pages de destination) et fonctionnalités interactives (filtres, comparateurs, espaces membres). Les premiers doivent être en SSR ou pré-rendus. Les seconds peuvent rester en CSR.

Si vous êtes sur un framework moderne (Next.js, Nuxt, Astro), activez le SSR par défaut et passez en CSR uniquement pour les composants qui le justifient. C'est l'approche la plus sûre — et celle que Google préfère sans le dire ouvertement.

Quelles erreurs éviter absolument ?

Ne vous dites pas "on est un réseau social, donc CSR OK". À moins que vous ne soyez vraiment Facebook ou LinkedIn, vous avez besoin du trafic organique. Et ce trafic passe par des pages publiques indexables — donc SSR.

Évitez aussi de sur-interpréter cette déclaration comme une validation du CSR généralisé. Splitt parle de cas d'usage spécifiques. Il ne dit pas "le CSR marche aussi bien que le SSR pour Google" — il dit "dans certains contextes, on tolère le CSR".

Comment vérifier que votre stratégie de rendu est adaptée ?

Testez l'indexation réelle. Utilisez l'outil d'inspection d'URL de la Search Console pour comparer le HTML brut (ce que le serveur envoie) et le HTML rendu (ce que Googlebot voit après exécution du JS). Si l'écart est important, vous avez un problème.

Surveillez aussi le time-to-index sur les nouvelles pages. Un site SSR bien configuré voit ses pages indexées en quelques heures. Un site CSR peut attendre plusieurs jours — c'est le signe que Googlebot galère avec votre JS.

- Identifier les pages à fort enjeu SEO et passer leur rendu en SSR ou SSG (Static Site Generation)

- Conserver le CSR pour les zones fonctionnelles non indexables (dashboards, filtres avancés, espaces privés)

- Tester systématiquement l'indexation avec l'outil Search Console sur les nouvelles pages critiques

- Mesurer les Core Web Vitals en conditions réelles — un CSR mal optimisé plombe LCP et INP

- Si vous utilisez un framework hybride, configurer les règles de rendu par route (SSR pour /blog, CSR pour /app)

- Monitorer le budget crawl : un site CSR consomme plus de ressources Googlebot qu'un site SSR équivalent

❓ Questions frequentes

Googlebot indexe-t-il aussi bien les sites CSR que les sites SSR ?

Un site e-commerce peut-il utiliser du CSR pour ses fiches produits ?

Quels frameworks permettent de mixer SSR et CSR facilement ?

Le pre-rendering statique est-il équivalent au SSR pour Google ?

Comment savoir si mon CSR pose problème pour l'indexation ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 29/12/2021

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.