Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Google supporte-t-il vraiment JavaScript pour le SEO ou est-ce un leurre ?

- □ Faut-il vraiment abandonner JavaScript pour le SSR en SEO ?

- □ Pourquoi la configuration JavaScript de votre site est-elle un point de contrôle critique pour Google ?

- □ Faut-il vraiment choisir SSR ou CSR selon le type de site ?

- □ Faut-il vraiment maîtriser Chrome DevTools pour faire du SEO technique ?

- □ Faut-il vraiment maîtriser le fonctionnement des navigateurs pour faire du SEO technique ?

- □ Faut-il vraiment se fier uniquement à la documentation officielle de Google ?

- □ Pourquoi le trafic ne devrait-il jamais être votre seule métrique SEO ?

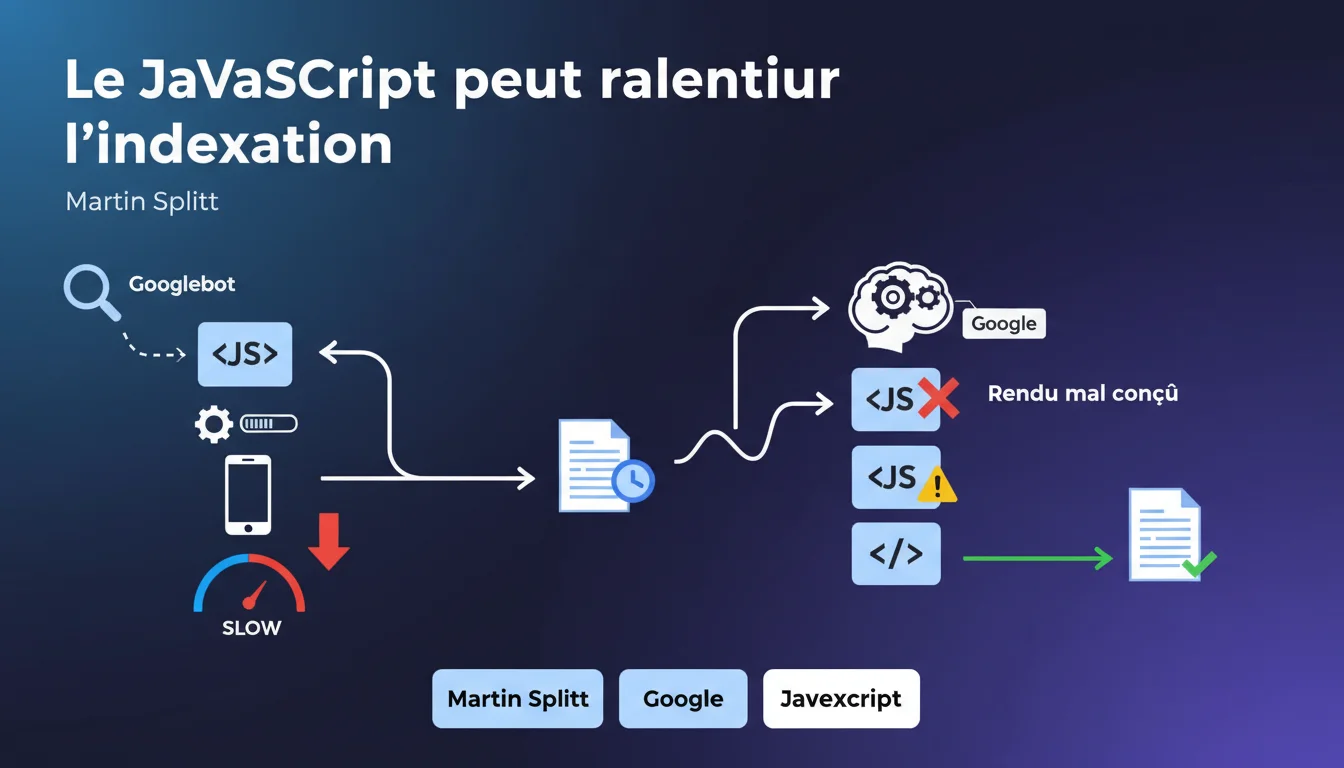

Google confirme que les sites en JavaScript nécessitent un temps d'indexation plus long en raison du rendu côté serveur. Un rendu mal optimisé peut créer un goulot d'étranglement significatif dans le processus de crawl et d'indexation. Pour les sites JS-heavy, l'architecture technique devient un facteur critique de performance SEO.

Ce qu'il faut comprendre

Pourquoi le JavaScript pose-t-il un problème spécifique pour l'indexation ?

Contrairement aux sites HTML statiques que Googlebot peut analyser directement, les sites JavaScript nécessitent une étape supplémentaire : le rendu. Google doit exécuter le code JavaScript pour générer le HTML final et accéder au contenu réel de la page.

Ce processus mobilise des ressources de calcul considérables côté Google. Chaque page doit passer par une file d'attente de rendu distincte, ce qui ajoute un délai incompressible entre le crawl initial et l'indexation effective du contenu.

Quelle est la différence entre crawl et indexation dans ce contexte ?

Le crawl correspond à la première visite de Googlebot qui télécharge les ressources de la page. L'indexation intervient après le rendu, une fois que Google a pu extraire et analyser le contenu généré par JavaScript.

Pour un site HTML classique, ces deux étapes sont quasi-simultanées. Pour un site JavaScript, il peut s'écouler plusieurs heures voire plusieurs jours entre le moment où Googlebot visite la page et celui où le contenu est effectivement indexé.

Tous les frameworks JavaScript sont-ils logés à la même enseigne ?

Non. Les frameworks proposant du rendu côté serveur (SSR) ou de la génération statique (SSG) permettent à Google de recevoir du HTML pré-rendu, contournant ainsi le problème. React avec Next.js, Vue avec Nuxt, ou Angular Universal entrent dans cette catégorie.

En revanche, les applications 100% client-side (CSR) — React sans SSR, Vue classique, applications SPA monolithiques — obligent Google à effectuer le rendu complet. C'est là que le délai d'indexation explose.

- Le rendu JavaScript ajoute une étape technique supplémentaire entre crawl et indexation

- Cette étape consomme des ressources Google et crée un délai potentiellement important

- Les frameworks avec SSR/SSG contournent le problème en servant du HTML pré-rendu

- Les applications CSR pures subissent le délai d'indexation maximal

- La qualité du code JavaScript impacte directement la vitesse de rendu et donc d'indexation

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, et c'est documenté depuis des années. Les tests sur des sites réels montrent systématiquement un délai d'indexation plus long pour les contenus générés en JavaScript. On parle de quelques heures dans le meilleur des cas, parfois plusieurs jours pour des sites mal optimisés.

Le problème devient critique sur les sites à forte volumétrie de pages — e-commerce avec des milliers de fiches produits, sites d'annonces, marketplaces. Quand chaque page nécessite du rendu individuel, le goulot d'étranglement se transforme en handicap structurel.

Quelles sont les zones d'ombre de cette déclaration ?

Martin Splitt reste flou sur l'ampleur réelle du ralentissement. Parler de "plus de temps" sans donner d'ordre de grandeur, c'est un peu court. [À vérifier] : Google ne communique jamais de chiffres précis sur les délais de sa file de rendu.

Autre point : la notion de "rendu mal conçu" reste vague. Google ne précise pas si le problème vient du temps d'exécution JavaScript côté client, de la complexité du DOM généré, ou de ressources bloquantes. Tout ça joue, mais dans quelle proportion ? Mystère.

Dans quels cas cette règle s'applique-t-elle moins ?

Pour les sites avec un faible volume de pages et une forte autorité, l'impact reste marginal. Si votre site compte 50 pages et que Google le visite quotidiennement, même avec du JavaScript pur, vous ne verrez probablement pas de problème d'indexation.

À l'inverse, sur un site e-commerce avec 100 000 produits en CSR pur, le problème devient structurel. La longue traîne — qui représente souvent 70% du trafic SEO — sera systématiquement handicapée par le délai de rendu.

Impact pratique et recommandations

Que faut-il faire concrètement sur un site JavaScript existant ?

Premier réflexe : auditer l'architecture actuelle. Votre site utilise-t-il du SSR, du SSG, ou du CSR pur ? Si vous ne savez pas, désactivez JavaScript dans votre navigateur et rechargez la page. Si vous voyez du contenu, c'est bon signe. Si la page reste vide, vous êtes en CSR pur.

Ensuite, utilisez la Search Console et l'outil "Inspection d'URL". Comparez le HTML brut avec le rendu final. Si des différences majeures apparaissent — contenu manquant, liens absents — c'est que Google doit effectuer le rendu pour voir votre contenu réel.

Quelles erreurs techniques aggravent le problème ?

Les ressources JavaScript bloquantes qui empêchent le rendu initial. Si votre script principal pèse 2 Mo non compressés et charge de manière synchrone, Google attendra que tout soit téléchargé avant de commencer le rendu.

Les appels API critiques côté client constituent un autre piège. Si le contenu principal dépend d'une requête fetch() vers une API externe, Google devra attendre la réponse de cette API avant d'indexer le contenu. Chaque milliseconde compte.

Enfin, les erreurs JavaScript silencieuses — celles qui ne plantent pas la page mais empêchent certains contenus de s'afficher. Google ne vous enverra pas d'alerte, le contenu sera simplement absent de l'index.

Comment migrer vers une architecture plus SEO-friendly ?

La solution optimale reste le Server-Side Rendering (SSR) ou la génération statique (SSG). Next.js pour React, Nuxt pour Vue, Angular Universal pour Angular — ces frameworks permettent de servir du HTML pré-rendu à Googlebot.

Si une migration complète est trop lourde, envisagez le dynamic rendering : servir du HTML statique aux bots et garder le JavaScript pour les vrais utilisateurs. Google l'accepte officiellement comme solution transitoire, même si ce n'est pas l'idéal.

- Auditer l'architecture actuelle : SSR, SSG ou CSR pur

- Vérifier le rendu dans Search Console (Inspection d'URL)

- Identifier les ressources JavaScript bloquantes et les optimiser

- Déplacer les appels API critiques côté serveur quand c'est possible

- Surveiller les erreurs JavaScript qui impactent l'affichage du contenu

- Évaluer la pertinence d'une migration SSR/SSG selon le volume de pages

- Mettre en place un monitoring spécifique du délai crawl → indexation

❓ Questions frequentes

Le dynamic rendering est-il considéré comme du cloaking par Google ?

Un site en SSR bénéficie-t-il d'un avantage de ranking par rapport à du CSR pur ?

Comment savoir si mes pages JavaScript sont correctement indexées ?

Les Progressive Web Apps (PWA) souffrent-elles du même problème ?

Le délai de rendu impacte-t-il aussi la découverte de nouveaux contenus ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 29/12/2021

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.