Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Google supporte-t-il vraiment JavaScript pour le SEO ou est-ce un leurre ?

- □ Le JavaScript ralentit-il réellement l'indexation de votre site ?

- □ Pourquoi la configuration JavaScript de votre site est-elle un point de contrôle critique pour Google ?

- □ Faut-il vraiment choisir SSR ou CSR selon le type de site ?

- □ Faut-il vraiment maîtriser Chrome DevTools pour faire du SEO technique ?

- □ Faut-il vraiment maîtriser le fonctionnement des navigateurs pour faire du SEO technique ?

- □ Faut-il vraiment se fier uniquement à la documentation officielle de Google ?

- □ Pourquoi le trafic ne devrait-il jamais être votre seule métrique SEO ?

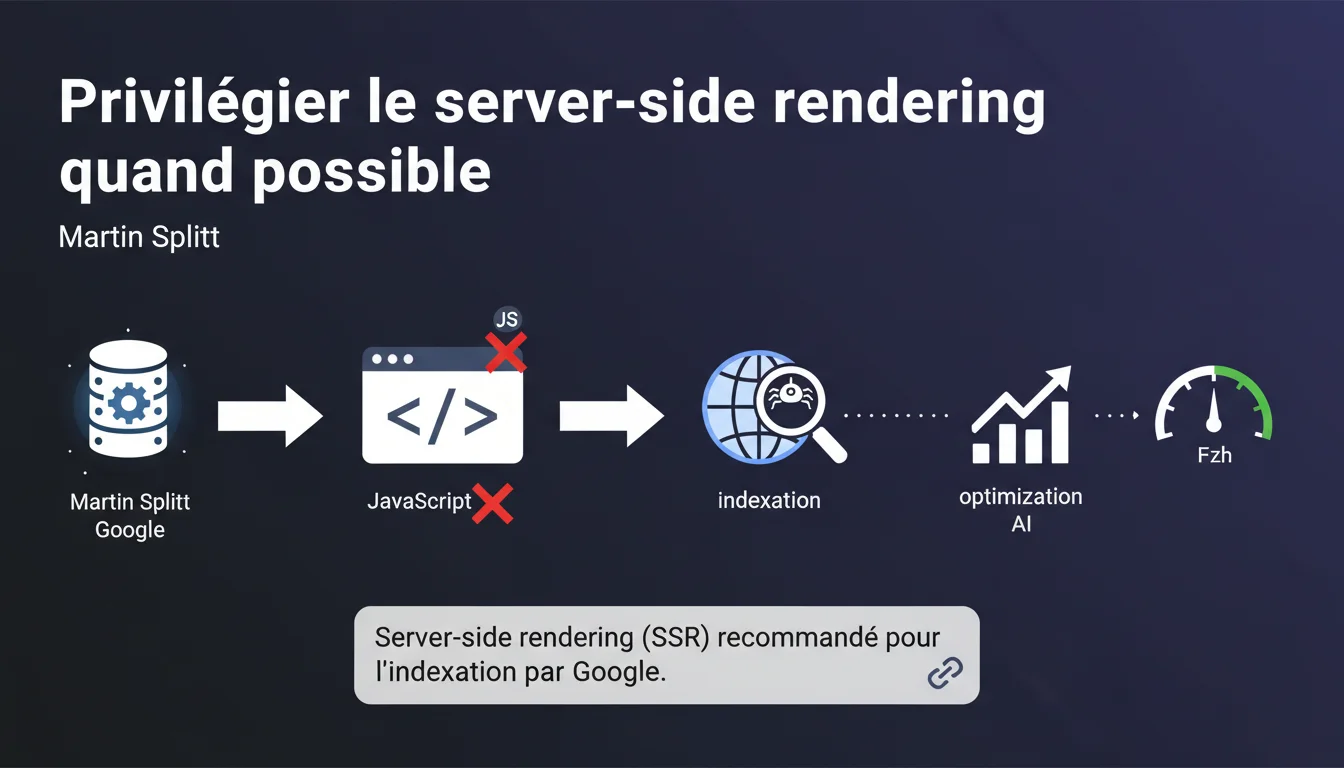

Google recommande officiellement le server-side rendering (SSR) plutôt que le JavaScript côté client pour faciliter l'indexation. Martin Splitt est clair : si un site peut être construit sans JS, c'est la voie à privilégier. Cette position tranche avec la tendance actuelle des frameworks modernes.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il autant sur le SSR ?

La déclaration de Martin Splitt révèle une préférence marquée pour le contenu généré côté serveur. Le crawler de Google peut certes exécuter du JavaScript, mais cette capacité a ses limites : ressources de calcul, délais de traitement, risques d'erreurs. Le SSR élimine ces frictions en fournissant du HTML directement exploitable.

Concretement, un site en SSR présente son contenu complet dès la première requête HTTP. Pas besoin d'attendre que le navigateur charge, parse et exécute du JavaScript pour révéler le texte, les liens ou les balises meta. Le crawler indexe immédiatement ce qu'il voit.

Cette recommandation s'applique-t-elle à tous les types de sites ?

Google reste pragmatique : « si un site peut être construit sans JavaScript ». Cette formulation laisse une marge de manœuvre pour les applications web complexes (dashboards, SaaS, outils interactifs) où le JS est structurellement nécessaire.

Pour un blog, un site vitrine, un e-commerce classique ? Le SSR devient la norme attendue. Le problème, c'est que beaucoup de CMS et frameworks poussent par défaut vers du client-side rendering (CSR) ou du SPA, créant une friction avec cette directive.

Quels sont les risques concrets du JavaScript côté client ?

- Délais d'indexation : le contenu peut mettre plus de temps à être crawlé et indexé, parfois plusieurs jours voire semaines

- Budget de crawl gaspillé : Googlebot consomme des ressources supplémentaires pour rendre le JS, au détriment d'autres pages

- Erreurs silencieuses : un script qui échoue en production peut rendre du contenu invisible pour le bot sans que vous le sachiez

- Problèmes de cache : les CDN et les proxys peuvent servir des versions non-renderisées aux bots

- Absence de fallback : si le JS ne s'exécute pas (timeout, erreur), la page reste vide pour le crawler

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. Les tests montrent que le SSR accélère significativement l'apparition dans l'index — parfois de plusieurs jours à quelques heures. Les sites migrés de CSR vers SSR constatent souvent une amélioration du crawl et de la fraîcheur des contenus indexés.

En revanche, Google reste flou sur un point : la corrélation entre SSR et ranking. Splitt parle d'indexation, pas de positionnement. [A verifier] : est-ce que le SSR impacte directement les classements ou seulement la vitesse d'indexation ? Les données publiques manquent sur ce point précis.

Dans quels cas cette règle ne s'applique-t-elle pas strictement ?

Les applications web interactives (Gmail, Google Docs, outils SaaS) ne peuvent pas raisonnablement fonctionner sans JavaScript côté client. Google le sait et n'attend pas d'eux un SSR pur.

Le piège : beaucoup de sites se classent mentalement dans cette catégorie alors qu'ils sont de simples sites de contenu ou d'e-commerce. Un filtrage dynamique de produits ou un formulaire de contact ne justifient pas un SPA complet. Soyons honnêtes : 80% des sites web n'ont aucune raison technique de dépendre du CSR — c'est un choix de stack, pas une nécessité fonctionnelle.

Quelle nuance apporter à la recommandation SSR ?

Le SSR n'est pas binaire. Il existe un spectre : SSR pur, hydratation partielle, rendu statique, pré-rendering, ISR (Incremental Static Regeneration). Tous ces modèles génèrent du HTML côté serveur, mais avec des compromis différents en termes de performance et de fraîcheur.

Impact pratique et recommandations

Que faut-il faire concrètement pour passer au SSR ?

La réponse dépend de votre stack actuelle. Un site WordPress ou Drupal fait déjà du SSR par défaut — le problème vient souvent des plugins ou thèmes qui injectent du contenu critique en JS. Auditez ce qui charge après le HTML initial.

Pour les sites en React, Vue ou Angular : Next.js, Nuxt.js et Angular Universal permettent le SSR sans refonte totale. Mais attention — l'hydratation côté client reste coûteuse si elle charge des mega-bundles JS. Le SSR ne résout pas tout si le Time to Interactive explose.

Quelles erreurs éviter lors de la migration vers SSR ?

Première erreur : confondre SSR et performance. Un SSR mal implémenté (serveur lent, TTFB élevé) peut être pire qu'un CSR bien optimisé. Le SSR déplace la charge du navigateur vers le serveur — il faut que ce dernier suive.

Deuxième piège : oublier le cache. Un SSR sans stratégie de cache (CDN, edge rendering, cache applicatif) va saturer vos serveurs dès que le trafic grimpe. Le rendu statique ou l'ISR peuvent être des alternatives plus robustes pour du contenu semi-dynamique.

Comment vérifier que mon site est correctement rendu côté serveur ?

- Désactive JavaScript dans Chrome DevTools et navigue sur ton site — tout le contenu critique doit être visible

- Inspecte le code source (Ctrl+U) : le contenu doit être présent dans le HTML initial, pas injecté après coup

- Utilise l'outil « Inspection d'URL » de la Search Console pour voir ce que Googlebot reçoit vraiment

- Compare le « View Page Source » avec le « Inspect Element » : s'ils diffèrent massivement, tu es en CSR

- Teste avec curl ou wget : si le contenu n'apparaît pas dans la réponse HTTP brute, c'est du JS côté client

- Vérifie les logs serveur : un SSR génère de la charge CPU côté serveur, un CSR sert juste des fichiers statiques

Le message de Google est sans ambiguïté : le SSR doit être la norme, pas l'exception. Si votre site charge du contenu critique en JavaScript côté client, vous prenez un risque d'indexation inutile.

La migration vers SSR peut être techniquement complexe selon votre stack actuelle — elle implique souvent des choix d'architecture, des ajustements d'infrastructure et une validation rigoureuse. Si ces enjeux dépassent vos ressources internes, un accompagnement par une agence SEO spécialisée peut accélérer la transition tout en évitant les pièges techniques classiques. L'objectif reste toujours le même : rendre votre contenu immédiatement accessible aux crawlers, sans compromis.

❓ Questions frequentes

Le SSR est-il obligatoire pour être indexé par Google ?

Un site en Next.js ou Nuxt.js fait-il automatiquement du SSR ?

Le dynamic rendering est-il une alternative acceptable au SSR ?

Comment tester si mon contenu est bien en SSR ?

Le SSR impacte-t-il directement le classement dans Google ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 29/12/2021

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.