Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Google supporte-t-il vraiment JavaScript pour le SEO ou est-ce un leurre ?

- □ Le JavaScript ralentit-il réellement l'indexation de votre site ?

- □ Faut-il vraiment abandonner JavaScript pour le SSR en SEO ?

- □ Faut-il vraiment choisir SSR ou CSR selon le type de site ?

- □ Faut-il vraiment maîtriser Chrome DevTools pour faire du SEO technique ?

- □ Faut-il vraiment maîtriser le fonctionnement des navigateurs pour faire du SEO technique ?

- □ Faut-il vraiment se fier uniquement à la documentation officielle de Google ?

- □ Pourquoi le trafic ne devrait-il jamais être votre seule métrique SEO ?

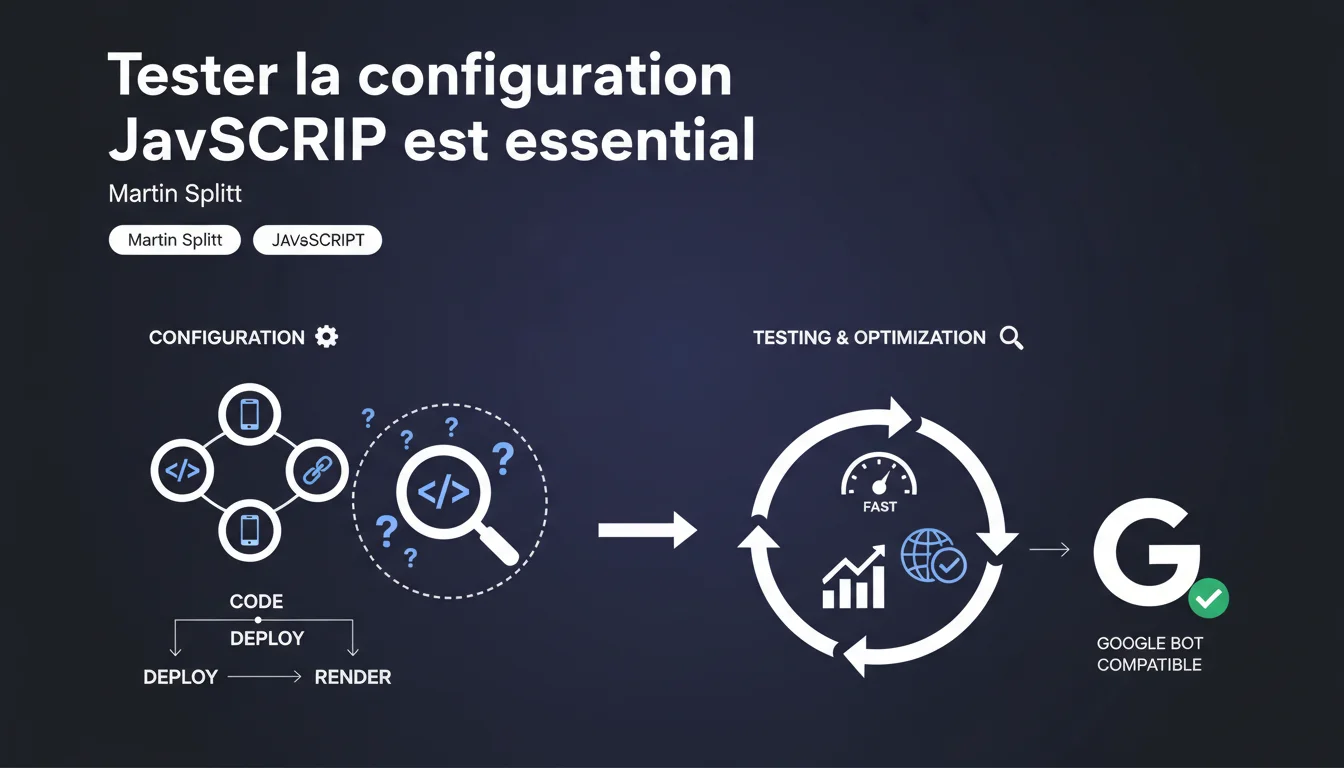

Google insiste : les sites JavaScript doivent suivre des bonnes pratiques techniques strictes et faire l'objet de tests approfondis pour être correctement explorés et indexés. Sans validation rigoureuse de votre configuration, vous risquez des pertes d'indexation invisibles au premier coup d'œil.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il autant sur les tests de configuration JavaScript ?

Le crawl et l'indexation JavaScript restent fondamentalement différents du rendu HTML classique. Google doit exécuter le code, attendre les ressources, construire le DOM — processus qui multiplie les points de défaillance potentiels.

Une erreur de configuration (ressources bloquées, timeout, dépendances manquantes) peut rendre votre contenu invisible pour Googlebot alors que tout semble fonctionner côté utilisateur. D'où cette insistance sur les tests : ce qui marche en navigation classique peut échouer silencieusement côté crawl.

Quelles sont les bonnes pratiques techniques évoquées ?

Google reste volontairement flou sur les détails, mais on sait que cela couvre : le rendu côté serveur ou la pré-génération (SSR/SSG), l'optimisation des ressources critiques, la gestion des states, l'hydratation propre du DOM.

Le problème ? Chaque framework (React, Vue, Angular, Next, Nuxt…) a ses propres exigences et pièges. Une "bonne pratique" pour Next.js ne s'applique pas forcément telle quelle à un SPA vanilla.

Comment identifier si votre site pose problème à Google ?

Les outils officiels (Search Console, Test d'optimisation mobile, inspection d'URL) montrent le rendu final vu par Googlebot. Mais ils ne détectent pas tout : les timeouts intermittents, les erreurs JS non bloquantes, les contenus chargés tardivement.

Il faut croiser plusieurs sources : logs serveur, analyse des crawls réels, comparaison DOM source vs DOM rendu, monitoring des Core Web Vitals en conditions réelles.

- Le rendu JavaScript côté Google reste une boîte noire avec des comportements parfois imprévisibles

- Les tests en navigation utilisateur ne suffisent pas — Googlebot a ses propres contraintes (timeout, budget crawl, exécution asynchrone)

- Chaque framework impose ses propres bonnes pratiques, il n'existe pas de solution universelle

- Les outils Google officiels donnent une vision partielle — il faut multiplier les sources de validation

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Absolument. Les sites JavaScript mal configurés affichent systématiquement des écarts massifs entre pages crawlées et pages indexées. On voit régulièrement des pertes de 30 à 60% du contenu, sans que l'équipe technique comprenne pourquoi au départ.

Le hic : Google ne donne aucune définition opérationnelle de ce qu'est une "bonne pratique" ou un "test minutieux". Résultat, chacun interprète avec ses propres critères — et rate souvent l'essentiel. [À vérifier] : quels sont les seuils de timeout réels appliqués par Googlebot selon les types de sites ?

Quelles nuances faut-il apporter à cette recommandation ?

Tous les sites JavaScript ne se valent pas. Un site pré-rendu côté serveur (SSR strict) pose infiniment moins de problèmes qu'un SPA client-side pur. Entre les deux : tout un spectre de configurations hybrides avec des risques variables.

Soyons honnêtes — les "bonnes pratiques" de Google sont souvent en retard sur les frameworks modernes. Next.js 13+ avec App Router, les Server Components React… Google communique encore sur des bases pensées pour Angular 1.x.

Dans quels cas cette règle devient-elle secondaire ?

Si votre architecture repose sur du SSG complet (génération statique à 100%), vous servez du HTML pur au crawl. JavaScript n'intervient qu'après pour l'interactivité — Google voit le contenu immédiatement, sans attendre l'exécution.

Autre cas : les sites avec fallback HTML solide, où le contenu essentiel existe déjà dans le DOM source avant toute exécution JS. Là, les risques sont minimaux même si le JavaScript plante.

Impact pratique et recommandations

Que faut-il auditer en priorité sur un site JavaScript ?

Commencez par vérifier que toutes les ressources critiques (JS, CSS, polyfills) sont accessibles à Googlebot — pas de blocage robots.txt, pas de 403/401 sur les CDN. Ensuite, comparez le DOM source et le DOM après hydratation : les contenus essentiels doivent être présents dès le HTML initial.

Testez avec JavaScript désactivé : que reste-t-il ? Si la réponse est "rien", vous êtes en zone rouge. Analysez les logs serveur pour repérer les timeouts Googlebot, les erreurs 5xx intermittentes, les requêtes API qui échouent côté crawl.

Quelles erreurs techniques bloquent systématiquement l'indexation ?

Les timeouts non gérés : si vos appels API prennent 8-10 secondes, Googlebot abandonne avant la fin du rendu. Les dépendances externes critiques (Google Fonts, analytics) qui retardent le rendu — si elles sont bloquées, tout s'effondre.

Les états JavaScript mal initialisés : contenus qui n'apparaissent que sur événement utilisateur (scroll, clic), infinite scroll sans pagination HTML, lazy-loading sans fallback SSR. Google ne simule pas ces interactions.

Comment mettre en place un monitoring fiable du rendu JavaScript ?

Déployez un monitoring synthétique qui crawle votre site comme Googlebot, avec les mêmes contraintes (user-agent, timeout, pas d'interactions). Comparez systématiquement avec les données Search Console — tout écart significatif est un signal d'alerte.

Mettez en place des alertes automatiques sur les métriques critiques : ratio pages crawlées/indexées, erreurs 5xx, timeouts API, Core Web Vitals en P75. Et surtout : testez après chaque déploiement majeur, pas une fois par trimestre.

- Vérifier l'accessibilité de toutes les ressources JS/CSS critiques pour Googlebot

- Comparer le DOM source vs DOM rendu pour chaque template clé

- Tester le site avec JavaScript désactivé pour valider le fallback HTML

- Analyser les logs serveur pour détecter les timeouts et erreurs côté crawl

- Implémenter un monitoring synthétique simulant le comportement Googlebot

- Auditer les dépendances externes qui bloquent ou retardent le rendu

- Mesurer les Core Web Vitals en conditions réelles (RUM), pas seulement en lab

- Documenter toute modification de framework ou d'architecture avant déploiement

❓ Questions frequentes

Les outils Google (Search Console, Test d'optimisation mobile) suffisent-ils pour valider ma configuration JavaScript ?

Le SSR (Server-Side Rendering) résout-il automatiquement tous les problèmes d'indexation JavaScript ?

À quelle fréquence faut-il tester la configuration JavaScript d'un site ?

Google pénalise-t-il les sites JavaScript par rapport aux sites HTML classiques ?

Quels frameworks JavaScript posent le moins de problèmes à Google ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 29/12/2021

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.