Declaration officielle

Autres déclarations de cette vidéo 12 ▾

- □ L'AI Mode de Google va-t-il bouleverser votre stratégie de mots-clés longue traîne ?

- □ Les groupes de requêtes dans Search Console changent-ils la façon d'analyser vos performances SEO ?

- □ Les annotations personnalisées Search Console vont-elles vraiment changer votre analyse de performance ?

- □ Mise à jour spam d'août : Google resserre-t-il vraiment l'étau sur les contenus bas de gamme ?

- □ Discover peut-il vraiment booster votre visibilité sans passer par votre site web ?

- □ Comment les profils créateurs dans Discover vont-ils redistribuer les cartes du trafic SEO ?

- □ Faut-il déclarer ses politiques d'expédition et de retour au niveau organisation dans les données structurées ?

- □ Faut-il encore implémenter des données structurées si Google supprime leur affichage visuel ?

- □ Pourquoi Google insiste-t-il sur une configuration flexible pour vos données structurées ?

- □ HTTPS par défaut dans Chrome : la fin du HTTP non sécurisé en 2026 ?

- □ Faut-il créer un fichier llms.txt pour être visible dans les résultats IA de Google ?

- □ L'IA de Google peut-elle vraiment réserver une table sur votre site sans intervention humaine ?

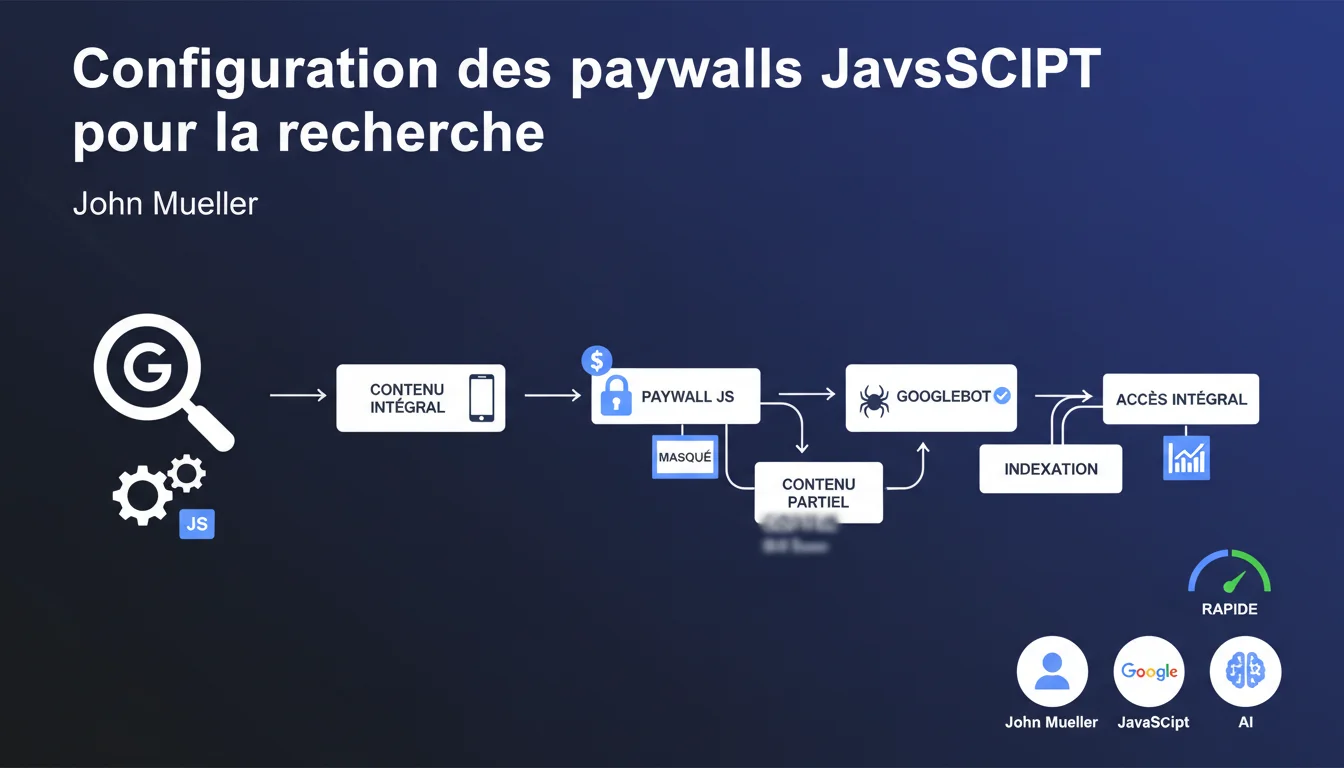

Google vient de publier une documentation détaillée sur la configuration des paywalls JavaScript pour éviter qu'ils ne bloquent l'indexation. L'enjeu : permettre à Googlebot d'accéder au contenu tout en maintenant votre modèle économique, sans tomber dans le cloaking. Les erreurs de configuration peuvent soit brider votre visibilité, soit vous valoir une pénalité manuelle.

Ce qu'il faut comprendre

Pourquoi Google publie-t-il des guidelines spécifiques sur les paywalls JavaScript ?

Parce que la majorité des éditeurs qui implémentent un paywall côté client le font mal. Soit ils bloquent complètement Googlebot en pensant protéger leur contenu, soit ils créent involontairement du cloaking en montrant tout à Google et rien aux utilisateurs.

Google a besoin d'indexer le contenu premium pour le classer correctement, mais doit aussi respecter le modèle économique des éditeurs. D'où ces recommandations techniques précises : comment structurer le JS pour que le bot comprenne ce qui est payant sans pénaliser le site.

Qu'est-ce qui différencie un paywall JavaScript d'un paywall serveur classique ?

Le paywall JavaScript s'exécute côté navigateur après le chargement initial de la page. Le HTML complet est envoyé, puis le script masque ou floute le contenu si l'utilisateur n'est pas abonné.

Googlebot, lui, exécute désormais le JavaScript — mais pas toujours comme Chrome. Si votre paywall ne s'affiche pas correctement lors du rendering, Google voit soit tout le contenu (risque de cloaking perçu), soit rien du tout (perte d'indexation).

Quels sont les pièges d'implémentation les plus fréquents ?

- Structured Data incohérents : déclarer isAccessibleForFree: true alors que le contenu est verrouillé

- Lazy loading mal configuré : le contenu payant ne se charge jamais pour Googlebot

- Firstload trop généreux : afficher 100% du contenu puis masquer via JS crée un signal de cloaking

- Absence de signaux clairs : pas de marquage schema.org, pas de message visible pour l'utilisateur non-abonné

- Délais d'exécution JS : le paywall s'affiche après le snapshot de Googlebot

Avis d'un expert SEO

Cette documentation change-t-elle vraiment quelque chose pour les sites déjà en place ?

Soyons honnêtes : si votre paywall fonctionne depuis des mois sans action manuelle, vous n'êtes probablement pas dans le viseur. Mais cette mise à jour officialise des pratiques observées empiriquement et comble un vide documentaire.

Le vrai changement, c'est que Google donne maintenant des exemples de code précis. Avant, on tâtonnait en espérant ne pas déclencher un filtre. Maintenant, il y a un référentiel officiel — ce qui signifie aussi que les équipes spam ont probablement affiné leurs algorithmes de détection.

Où se situe la ligne rouge entre optimisation légitime et cloaking ?

Google tolère que Googlebot voie plus de contenu qu'un visiteur lambda non-connecté, à condition que ce surplus soit limité et cohérent avec l'expérience utilisateur réelle. Un aperçu de 2-3 paragraphes avant le mur : OK. Tout l'article en clair dans le HTML puis masqué en JS : zone grise dangereuse.

Le critère déterminant reste l'intention. Si votre implémentation vise à tromper l'algorithme pour ranker sur du contenu inaccessible, vous finirez par trinquer — même si techniquement vous suivez les guidelines au pixel près.

Google a-t-il un intérêt caché dans ces recommandations ?

Absolument. Plus Google indexe de contenu premium de qualité, plus ses SERP restent pertinentes face à des agrégateurs comme ChatGPT. Les éditeurs qui bloquent complètement leurs articles par peur du scraping privent Google de matière première.

Ces guidelines servent aussi à standardiser les implémentations pour réduire les faux positifs en détection de spam. Moins d'ambiguïté = moins de tickets au support = équipes spam plus efficaces sur les vrais tricheurs.

Impact pratique et recommandations

Comment vérifier que mon paywall JavaScript est correctement configuré ?

Première étape : Google Search Console, outil d'inspection d'URL. Comparez la version rendue par Googlebot avec ce que voit un utilisateur non-connecté en navigation privée. Le contenu visible doit correspondre — ni plus, ni radicalement moins.

Ensuite, validez vos structured data avec le test des résultats enrichis. Le champ isAccessibleForFree doit être à false pour les articles payants, et vous devez implémenter hasPart avec cssSelector pour identifier précisément la zone verrouillée.

Enfin, testez le temps d'exécution JS. Si votre paywall met plus de 3-4 secondes à s'afficher, Googlebot risque de snapshot la page avant son activation. Utilisez Lighthouse et WebPageTest avec throttling pour simuler des conditions réelles de crawl.

Quelles erreurs critiques faut-il absolument éviter ?

- Ne jamais utiliser

user-agentdetection pour afficher plus de contenu à Googlebot — c'est du cloaking caractérisé - Ne pas masquer le paywall via

display:noneconditionnel basé sur le referrer - Éviter les scripts qui chargent le contenu complet puis le suppriment du DOM après rendering

- Ne pas bloquer les ressources JS/CSS du paywall dans robots.txt — Google doit pouvoir les exécuter

- Ne jamais déclarer du contenu gratuit dans les données structurées si un mur existe réellement

Quelle stratégie adopter pour un site avec plusieurs milliers de pages premium ?

Pour un catalogue étendu, l'audit manuel page par page n'est pas tenable. Mettez en place un monitoring automatisé : scripts qui comparent le HTML source vs. le DOM rendu, alertes sur les écarts de isAccessibleForFree entre fichiers structured data et comportement réel.

Côté priorisation, concentrez-vous d'abord sur les pages à fort trafic organique. Une erreur sur une landing page qui génère 10K visites/mois a plus d'impact qu'un bug sur un article de fond peu consulté. Segmentez par template : homepage, catégories, articles — et corrigez par blocs.

Les paywalls JavaScript bien configurés permettent de concilier monétisation et visibilité SEO, mais la marge d'erreur est étroite. Entre structured data, timing d'exécution JS, cohérence UX/crawl et risque de cloaking, les paramètres à maîtriser sont nombreux.

Pour les éditeurs qui gèrent des milliers de contenus premium ou qui ont subi des pénalités par le passé, ces optimisations demandent une expertise technique pointue et un suivi rigoureux. Faire appel à une agence SEO spécialisée dans les architectures JavaScript complexes peut accélérer la mise en conformité et sécuriser durablement votre positionnement, surtout si vos équipes internes manquent de bande passante ou de recul technique sur ces enjeux.

🎥 De la même vidéo 12

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 17/11/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.