Declaration officielle

Autres déclarations de cette vidéo 12 ▾

- □ L'AI Mode de Google va-t-il bouleverser votre stratégie de mots-clés longue traîne ?

- □ Les groupes de requêtes dans Search Console changent-ils la façon d'analyser vos performances SEO ?

- □ Les annotations personnalisées Search Console vont-elles vraiment changer votre analyse de performance ?

- □ Mise à jour spam d'août : Google resserre-t-il vraiment l'étau sur les contenus bas de gamme ?

- □ Discover peut-il vraiment booster votre visibilité sans passer par votre site web ?

- □ Comment les profils créateurs dans Discover vont-ils redistribuer les cartes du trafic SEO ?

- □ Faut-il déclarer ses politiques d'expédition et de retour au niveau organisation dans les données structurées ?

- □ Faut-il encore implémenter des données structurées si Google supprime leur affichage visuel ?

- □ Pourquoi Google insiste-t-il sur une configuration flexible pour vos données structurées ?

- □ HTTPS par défaut dans Chrome : la fin du HTTP non sécurisé en 2026 ?

- □ Comment configurer un paywall JavaScript sans ruiner votre crawl budget ?

- □ Faut-il créer un fichier llms.txt pour être visible dans les résultats IA de Google ?

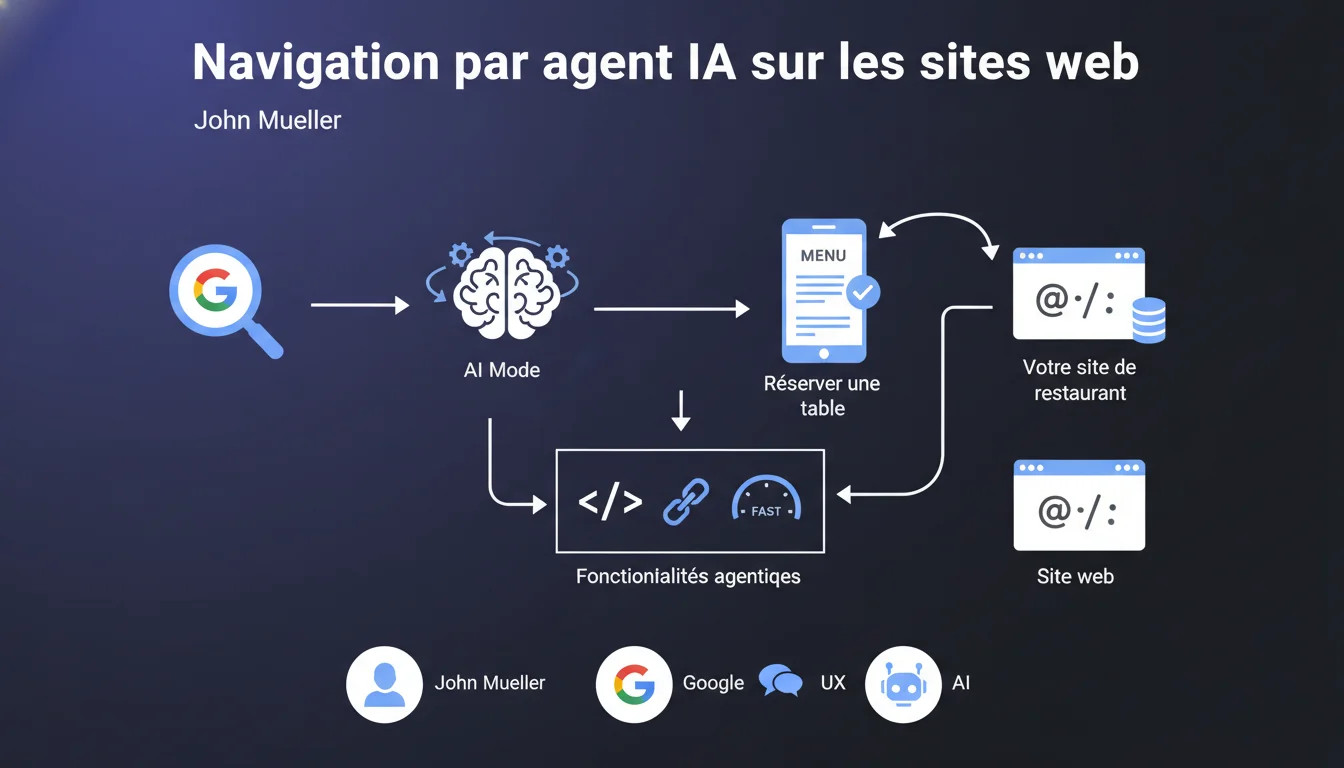

Google teste un AI Mode agentique capable d'accomplir des tâches directement depuis la recherche — par exemple réserver une table sur un site de restaurant sans que l'utilisateur ait à naviguer manuellement. Ce changement transforme la Search en interface d'action, pas seulement de découverte. Pour les sites transactionnels, ça veut dire repenser l'architecture technique pour être « actionnable » par un agent IA.

Ce qu'il faut comprendre

Qu'est-ce que ce mode agentique change concrètement pour la recherche ?

Google ne se contente plus de renvoyer vers des pages. Avec ce mode expérimental, l'IA peut interpréter une demande complexe (« trouve-moi un restaurant italien ce soir à Paris et réserve une table pour deux »), identifier le site pertinent, naviguer dans ses pages, remplir un formulaire de réservation et finaliser l'action.

L'utilisateur reste dans l'écosystème Google. Le site devient un fournisseur de service en coulisses, pas une destination visible. C'est un bouleversement du parcours utilisateur classique — et du trafic que vous mesurez dans Analytics.

Pourquoi Google pousse-t-il dans cette direction maintenant ?

Deux raisons. D'abord, la concurrence de ChatGPT et des assistants conversationnels qui promettent de résoudre des tâches de bout en bout. Ensuite, monétisation : un utilisateur qui accomplit une action dans la Search est captif plus longtemps, et Google peut se positionner comme intermédiaire de transaction.

C'est aussi une réponse à l'évolution des comportements : les gens veulent des réponses actionnables, pas des listes de liens bleus. Le « zero-click search » devient « zero-navigation action ».

Quelles sont les implications techniques pour les sites concernés ?

Pour que l'agent IA puisse agir sur votre site, il faut une architecture accessible et structurée. Ça passe par des données structurées claires (schema.org), des formulaires identifiables, des parcours utilisateurs logiques sans barrières inutiles (captchas trop agressifs, JS obfusqué).

Google devra aussi « comprendre » vos intentions métier : est-ce qu'une réservation nécessite validation ? Un paiement immédiat ? Ces subtilités doivent être explicitement balisées.

- L'IA devient un utilisateur autonome qui navigue sans vous demander votre avis

- Votre site doit être techniquement « lisible » par un agent, pas seulement par Googlebot classique

- Le trafic visible dans vos stats peut baisser même si le volume de conversions reste stable ou augmente

- Les sites incapables de supporter cette interaction risquent une perte de visibilité si Google favorise ceux qui « jouent le jeu »

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Oui et non. Google teste ce genre de fonctionnalités depuis des années via Google Assistant et Actions on Google — mais avec un succès très mitigé. L'idée d'automatiser les tâches transactionnelles n'est pas neuve. Ce qui change ici, c'est l'intégration directe dans la Search principale, avec des LLM capables de naviguer de manière beaucoup plus fluide.

Soyons honnêtes : on n'a pas encore vu de déploiement massif. C'est pour l'instant cantonné à des expérimentations limitées. Mais la direction est claire, et sous-estimer cette tendance serait une erreur.

Quels sont les risques pour les sites qui dépendent du trafic organique ?

Le premier risque, c'est la désintermédiation totale. Vous perdez le contact visuel avec l'utilisateur. Il ne voit jamais votre marque, votre design, votre proposition de valeur différenciante. Google devient le point de contact, vous n'êtes qu'un backend.

Deuxième problème : la captation de données. Si Google orchestre la transaction, il collecte des données comportementales que vous ne verrez jamais. Vous perdez en capacité d'analyse, de remarketing, de compréhension fine de vos audiences.

Dans quels cas cette fonctionnalité agentique ne fonctionnera-t-elle pas ?

Tous les sites ne sont pas concernés de la même manière. Les tâches simples et standardisées (réservation, prise de rendez-vous, commande basique) sont candidates idéales. Mais tout ce qui nécessite une interaction riche, un conseil personnalisé, une configuration complexe restera hors de portée des agents IA — du moins pour les prochaines années.

Les secteurs réglementés (santé, finance, juridique) vont aussi poser problème. Google ne prendra pas le risque de gérer automatiquement des actions sensibles sans validation humaine explicite. Et c'est là que ça coince : si l'utilisateur doit quand même valider manuellement, l'intérêt de l'agent s'effondre.

Impact pratique et recommandations

Que faut-il faire concrètement pour préparer son site ?

D'abord, structurer vos données. Si vous proposez des services transactionnels (réservation, prise de rendez-vous, achat), assurez-vous que vos pages exploitent les schémas schema.org adaptés : Reservation, Event, Product, Service selon le cas.

Ensuite, simplifiez vos parcours. Un formulaire avec 15 champs obligatoires et trois étapes de validation ne sera jamais navigable par un agent IA. Pensez fluidité et minimalisme. Les champs doivent avoir des labels explicites, des attributs HTML sémantiques corrects (autocomplete, required, type).

Enfin, testez la compatibilité technique. Votre site fonctionne-t-il sans JavaScript lourd côté client ? Les actions critiques sont-elles accessibles via des requêtes HTTP standards ? Un agent IA ne simulera pas un navigateur humain dans les mêmes conditions qu'un utilisateur classique.

Quelles erreurs éviter absolument ?

Ne bloquez pas l'accès à vos pages transactionnelles derrière des captchas systématiques ou des murs de connexion obligatoire. Si Google ne peut pas « voir » le formulaire de réservation sans créer un compte, l'agent ne pourra pas agir. Ça ne veut pas dire tout ouvrir au public, mais prévoir une logique d'accès progressive.

Autre piège : ignorer cette tendance en se disant que ça ne vous concerne pas. Même si vous n'êtes pas un site transactionnel aujourd'hui, Google pourrait demain considérer que les sites actionnables méritent un traitement préférentiel dans les résultats. Anticiper, c'est se donner une marge de manœuvre.

- Implémenter les données structurées schema.org pertinentes pour vos services

- Simplifier les formulaires : moins de champs, labels clairs, validation accessible

- Vérifier que les parcours critiques fonctionnent sans JS lourd côté client

- Tester l'accessibilité de vos pages transactionnelles sans captcha agressif

- Suivre l'évolution des guidelines Google sur les « actionable results »

- Anticiper une possible baisse du trafic visible tout en surveillant les conversions réelles

Comment s'assurer que votre site reste compétitif dans ce nouveau paradigme ?

La clé, c'est de ne pas subir cette évolution mais de la prendre comme levier. Si votre site devient « actionnable », vous gagnez potentiellement en conversions même si le trafic apparent baisse. Mais ça demande une refonte technique et stratégique souvent complexe.

Pour beaucoup de sites, cette transition nécessite des compétences croisées : SEO technique avancé, développement orienté API, stratégie de données structurées, compréhension fine des parcours utilisateurs automatisés. Peu d'équipes internes maîtrisent cet ensemble.

🎥 De la même vidéo 12

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 17/11/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.