Declaration officielle

Ce qu'il faut comprendre

Que se passe-t-il concrètement quand Googlebot rencontre une erreur 500 sur le robots.txt ?

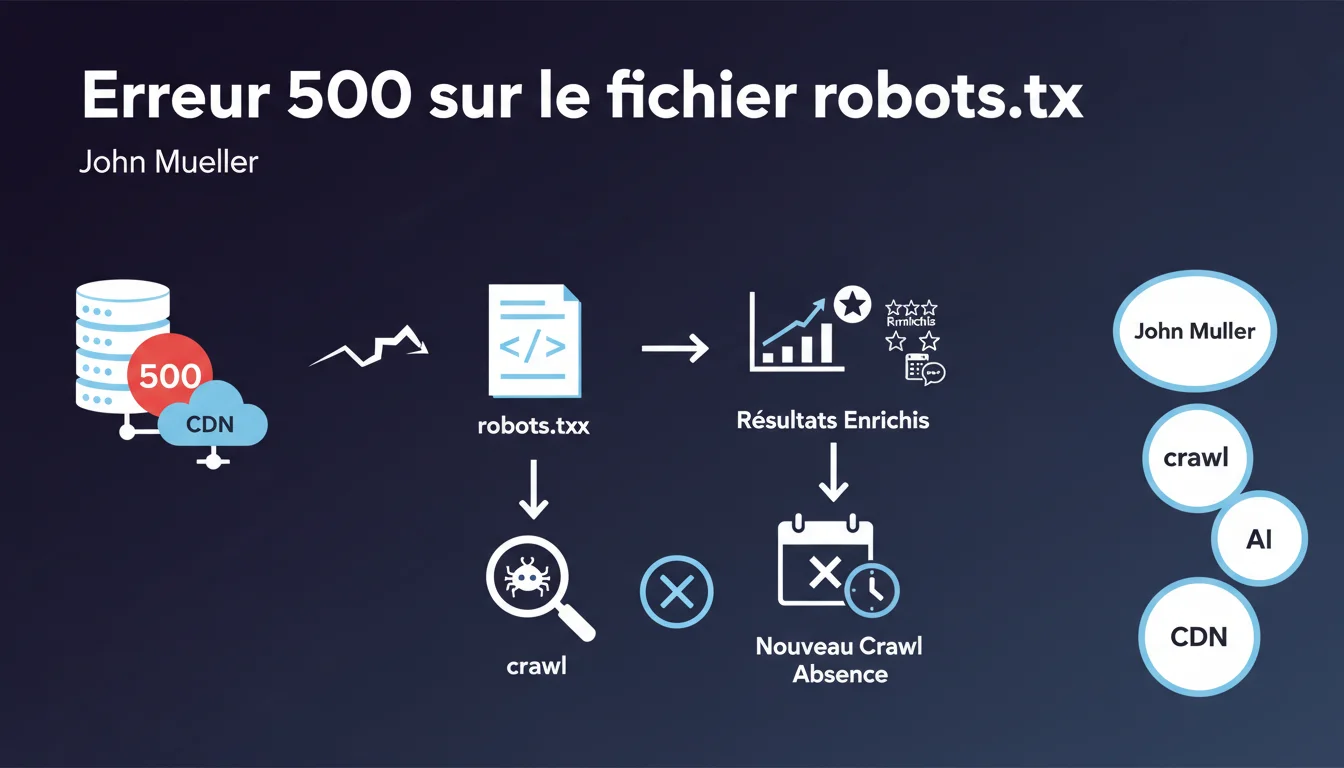

Lorsque Googlebot tente d'accéder au fichier robots.txt d'un site et reçoit une erreur serveur 5xx, il interprète cette réponse comme un problème technique temporaire sur l'ensemble du serveur.

Plutôt que de risquer de crawler le site de manière inappropriée ou de surcharger un serveur potentiellement défaillant, Google adopte une posture conservatrice : il stoppe immédiatement tout nouveau crawl du site. Cette mesure de précaution s'applique que l'erreur provienne directement du serveur ou passe par un CDN.

Pourquoi les résultats enrichis disparaissent-ils également ?

Les résultats enrichis (rich snippets) comme les étoiles d'avis, les recettes de cuisine ou les FAQ nécessitent un crawl régulier pour être maintenus à jour dans l'index de Google.

Sans accès au robots.txt et donc sans nouveau crawl, Google ne peut plus valider la présence et la fraîcheur des données structurées. Par mesure de prudence, il retire progressivement ces résultats enrichis de l'affichage dans les SERP.

Quelle est la différence entre une erreur 404 et une erreur 500 pour robots.txt ?

Une erreur 404 sur robots.txt signifie simplement que le fichier n'existe pas, ce qui est interprété par Google comme "aucune restriction de crawl". Le bot peut donc explorer librement le site selon ses règles par défaut.

Une erreur 500 indique un dysfonctionnement serveur, ce qui empêche Google de savoir s'il y a ou non des directives à respecter. Par principe de précaution, il préfère suspendre le crawl plutôt que de violer d'éventuelles restrictions.

- Erreur 404 : crawl autorisé sans restrictions (absence de fichier = pas de règles)

- Erreur 500 : crawl bloqué totalement (impossibilité de lire les règles éventuelles)

- Perte des résultats enrichis : conséquence directe de l'arrêt du crawl

- Impact CDN : l'erreur 500 a le même effet qu'elle provienne du CDN ou du serveur d'origine

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Cette position de Google est parfaitement cohérente avec leur philosophie de prudence technique. Dans mon expérience de 15 ans, j'ai effectivement observé des chutes drastiques de crawl sur des sites victimes d'erreurs 5xx répétées sur leur robots.txt.

Ce qui est moins évident pour beaucoup de praticiens, c'est la distinction entre 404 et 500. Beaucoup pensent à tort qu'une erreur est une erreur, alors que Google traite ces deux codes HTTP de manière radicalement opposée pour le robots.txt.

Quels cas particuliers méritent une attention spécifique ?

Les configurations avec CDN ou WAF (Web Application Firewall) sont particulièrement à risque. Ces couches intermédiaires peuvent générer des erreurs 500 suite à des timeouts, des règles de sécurité trop strictes, ou des problèmes de configuration, même si le serveur origine fonctionne correctement.

Les sites avec une infrastructure complexe ou distribuée doivent également redoubler de vigilance. J'ai vu des cas où le robots.txt était servi par un service différent du reste du site, créant des points de défaillance uniques.

Dans quels scénarios cette règle a-t-elle le plus d'impact ?

Les sites e-commerce et médias avec des milliers de pages et un besoin de crawl fréquent sont les plus vulnérables. Une interruption de crawl de quelques jours peut signifier des produits non indexés ou des actualités manquées.

Les sites avec une forte dépendance aux résultats enrichis (sites de recettes, d'avis, d'événements) subissent un double impact : arrêt du crawl ET perte immédiate de visibilité via les rich snippets, ce qui peut entraîner une chute de CTR de 30 à 50%.

Impact pratique et recommandations

Comment vérifier que votre robots.txt répond correctement ?

La première étape consiste à tester manuellement l'accès à votre fichier robots.txt via plusieurs méthodes. Utilisez votre navigateur, des outils de ligne de commande comme curl, et surtout la Search Console de Google dans la section "Outils pour robots.txt".

Mettez en place une surveillance continue avec des outils de monitoring (Pingdom, UptimeRobot, ou des scripts personnalisés) qui vérifient spécifiquement le code HTTP retourné pour /robots.txt. Un monitoring toutes les 5-10 minutes est recommandé pour les sites critiques.

Quelles sont les erreurs de configuration les plus fréquentes à éviter ?

L'erreur la plus commune concerne les configurations de CDN mal paramétrées. Assurez-vous que votre CDN est configuré pour servir le robots.txt depuis l'origine, ou qu'une version est mise en cache de manière fiable avec des règles de fallback appropriées.

Les règles WAF trop restrictives représentent un autre piège classique. Certains firewalls bloquent ou retournent des erreurs 500 pour des patterns suspects dans les user-agents, ce qui peut affecter Googlebot. Testez spécifiquement avec le user-agent de Google.

Évitez les générations dynamiques de robots.txt sans mécanisme de cache robuste. Un fichier statique reste l'option la plus sûre et la plus performante dans 90% des cas.

Que faut-il mettre en place concrètement pour sécuriser votre configuration ?

- Vérifier que /robots.txt retourne un code 200 si le fichier existe, ou 404 s'il n'existe pas (jamais 500)

- Configurer des alertes de monitoring spécifiques pour le code HTTP du robots.txt

- Tester la configuration avec différents user-agents, notamment Googlebot desktop et mobile

- Documenter la localisation et le mode de service du robots.txt (serveur origine, CDN, génération dynamique)

- Prévoir un plan de fallback en cas de défaillance du système servant le robots.txt

- Auditer les règles CDN et WAF pour s'assurer qu'elles n'interfèrent pas avec l'accès au robots.txt

- Implémenter des logs détaillés pour tracker tous les accès et erreurs sur /robots.txt

- Effectuer des tests de charge pour vérifier que le robots.txt reste accessible même sous trafic élevé

Une erreur 500 sur le robots.txt a des conséquences immédiates et sévères : arrêt complet du crawl et perte des résultats enrichis. La distinction entre codes 404 (acceptable) et 500 (bloquant) est cruciale.

La solution passe par un monitoring proactif, une configuration technique rigoureuse, et une attention particulière aux couches intermédiaires (CDN, WAF) qui peuvent introduire des points de défaillance inattendus.

Ces configurations techniques impliquent souvent des interdépendances complexes entre infrastructure, CDN, sécurité et SEO. Pour les sites à fort enjeu, il peut s'avérer judicieux de s'appuyer sur une agence SEO spécialisée capable d'auditer l'ensemble de la chaîne technique et de mettre en place une stratégie de surveillance adaptée à vos enjeux business.

💬 Commentaires (0)

Soyez le premier à commenter.