Declaration officielle

Ce qu'il faut comprendre

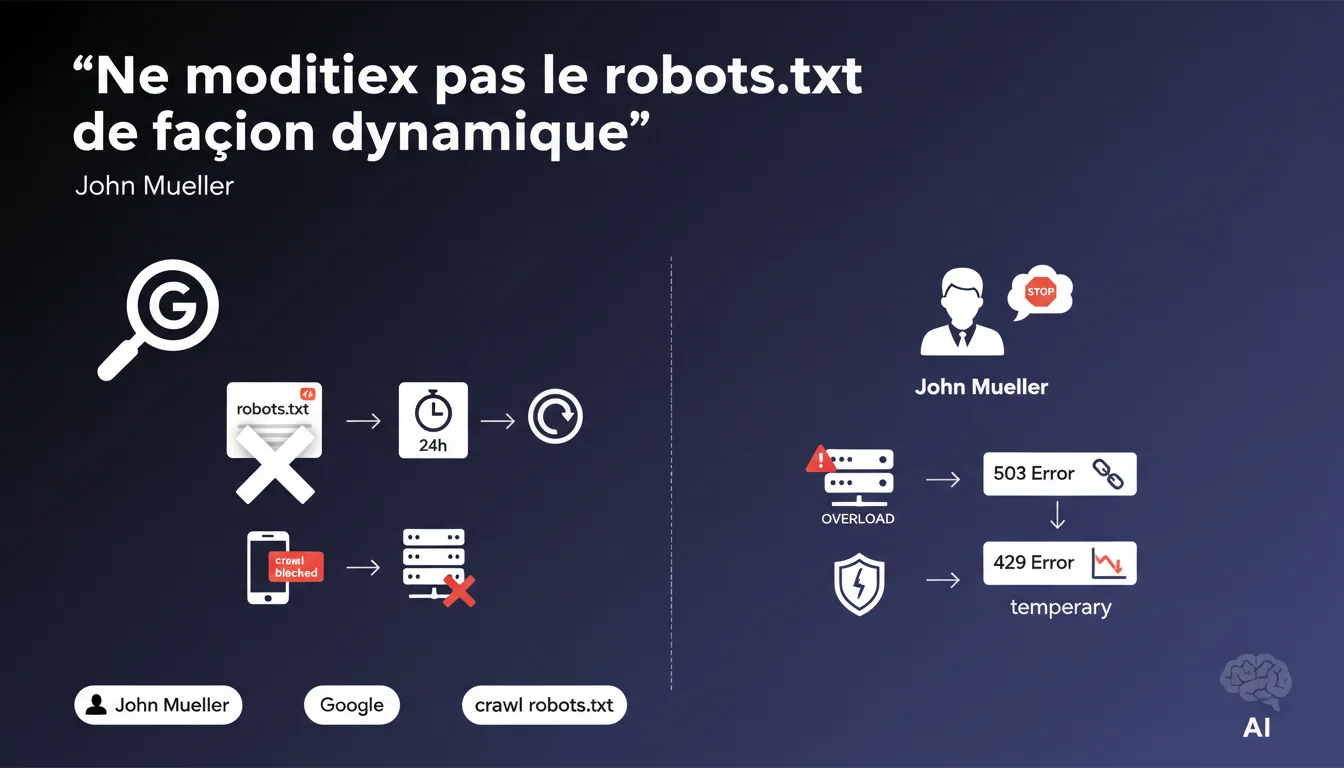

Le fichier robots.txt est mis en cache par Google pendant environ 24 heures. Cette information technique est cruciale pour comprendre pourquoi les modifications fréquentes de ce fichier n'ont aucun impact immédiat sur le comportement du crawler.

Certains techniciens tentent de modifier le robots.txt plusieurs fois par jour pour bloquer Googlebot aux heures de pointe et le réautoriser ensuite. Cette approche part d'une bonne intention : protéger le serveur d'une charge de crawl excessive.

Cette stratégie est totalement inefficace car Google ne voit pas ces changements en temps réel. Le bot continue de suivre la version en cache du fichier, ignorant complètement les modifications temporaires effectuées entre-temps.

- Le robots.txt est caché par Google pendant environ 24 heures

- Les modifications dynamiques ne sont pas prises en compte immédiatement

- Cette méthode ne permet pas de gérer la charge serveur en temps réel

- Des alternatives existent pour contrôler le crawl de façon réactive

Avis d'un expert SEO

Cette recommandation est parfaitement cohérente avec les observations terrain. De nombreux sites ont tenté cette approche sans succès, constatant que Googlebot continuait de crawler malgré les modifications du robots.txt.

Les codes HTTP 503 et 429 sont effectivement les solutions appropriées pour gérer une charge temporaire. Le code 503 (Service Unavailable) indique une indisponibilité temporaire, tandis que le 429 (Too Many Requests) signale explicitement une limitation de débit. Ces codes sont interprétés en temps réel par les crawlers.

Une nuance importante : si votre infrastructure nécessite des blocages horaires récurrents de Googlebot, c'est probablement le symptôme d'un problème d'architecture plus profond. Il serait plus judicieux d'optimiser votre budget de crawl via la Search Console ou d'améliorer la capacité serveur.

Impact pratique et recommandations

- Ne jamais modifier le robots.txt plus d'une fois par jour - Les changements fréquents sont inutiles et créent de la confusion

- Implémenter une gestion dynamique via codes HTTP - Utiliser 503 ou 429 au niveau serveur pour les pics de charge temporaires

- Monitorer votre charge de crawl dans la Search Console pour identifier les patterns problématiques

- Optimiser le budget de crawl en bloquant les URLs inutiles de façon permanente dans le robots.txt

- Dimensionner correctement votre infrastructure si les pics de crawl posent régulièrement problème

- Utiliser les paramètres de vitesse de crawl dans la Search Console (quand disponibles) plutôt que des blocages temporaires

- Éviter les solutions temporaires récurrentes - Si vous bloquez Googlebot quotidiennement, c'est le signe d'un problème structurel

En résumé : Le robots.txt est un outil de directive permanente, pas un interrupteur temps réel. Pour gérer la charge serveur de façon réactive, privilégiez les codes HTTP 503/429.

La gestion optimale du crawl budget nécessite une approche globale combinant infrastructure serveur, paramétrage technique et monitoring continu. Ces optimisations techniques requièrent une expertise pointue en architecture web et en comportement des crawlers. Si votre site rencontre des problématiques récurrentes de charge liée au crawl, l'accompagnement par une agence SEO spécialisée peut s'avérer précieux pour établir un diagnostic complet et mettre en place une stratégie pérenne adaptée à votre contexte spécifique.

💬 Commentaires (0)

Soyez le premier à commenter.