Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Comment Google crawle-t-il vraiment vos pages web ?

- □ Comment Google découvre-t-il vraiment vos nouvelles pages ?

- □ Pourquoi Google ne découvre-t-il pas toutes les URLs de votre site ?

- □ Comment Googlebot décide-t-il quelles pages crawler sur votre site ?

- □ Googlebot ralentit-il volontairement sur votre site pour ne pas le surcharger ?

- □ Pourquoi Googlebot ignore-t-il une partie des URLs qu'il découvre ?

- □ Googlebot peut-il vraiment crawler le contenu derrière une page de connexion ?

- □ Pourquoi Google ne voit-il pas votre contenu JavaScript sans rendering ?

- □ Faut-il vraiment automatiser la génération de vos sitemaps ?

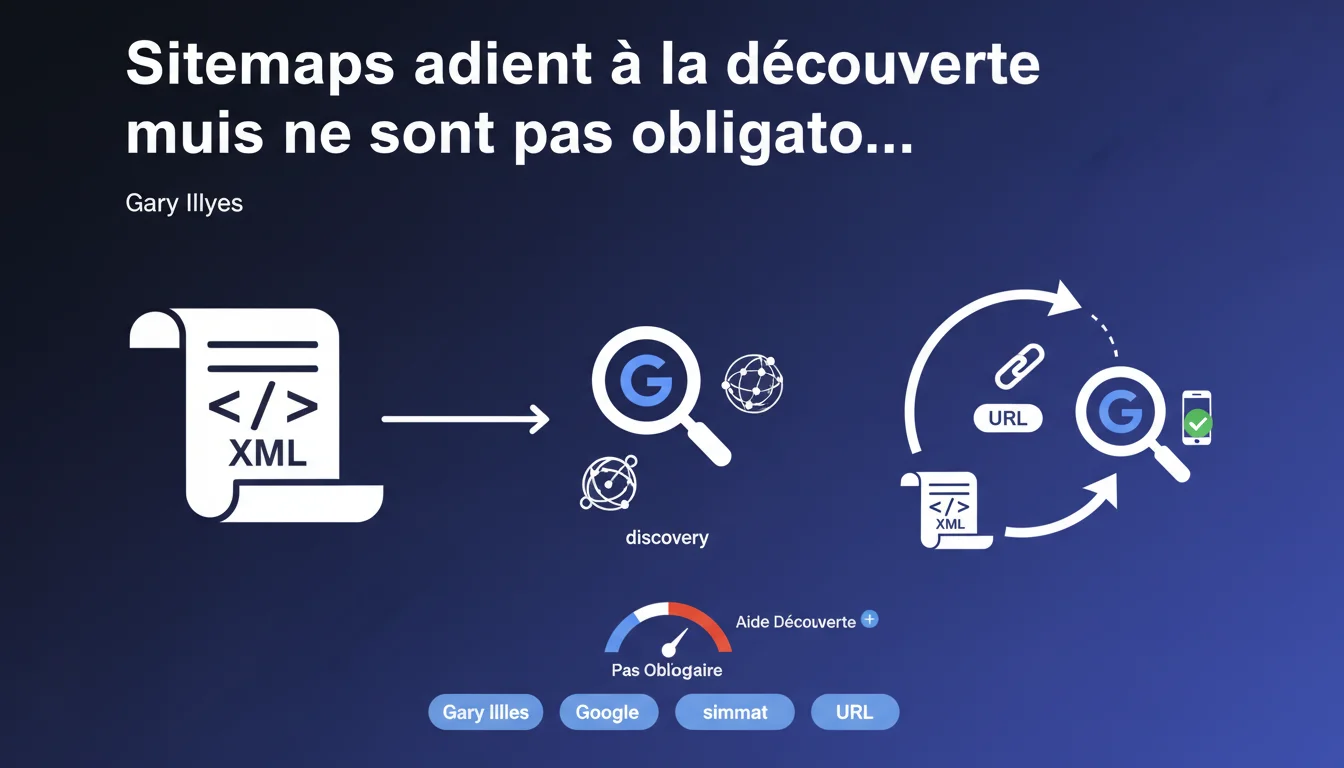

Google confirme que les sitemaps XML ne sont pas obligatoires pour l'indexation, mais qu'ils facilitent la découverte du contenu. Concrètement : un site bien maillé peut s'en passer, mais un sitemap reste un filet de sécurité précieux, surtout pour les gros volumes ou les contenus mal connectés.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il sur le caractère non obligatoire des sitemaps ?

Google veut éviter un malentendu persistant : un sitemap n'est pas un prérequis technique pour que Googlebot crawle et indexe vos pages. Si votre architecture interne est propre, avec un maillage cohérent et des liens depuis la page d'accueil vers vos contenus stratégiques, le robot trouvera naturellement votre site.

Cette précision vise aussi à rappeler que soumettre un sitemap ne garantit aucunement l'indexation. C'est une aide à la découverte, pas un ordre d'indexation. Google reste seul maître de ce qu'il crawle, indexe et classe.

Dans quels cas un sitemap devient-il réellement utile ?

Les sitemaps brillent sur les sites volumineux ou à forte croissance : e-commerce avec milliers de fiches produit, médias publiant du contenu quotidiennement, plateformes user-generated. Ils permettent à Google de détecter rapidement les nouvelles URLs sans attendre qu'un lien interne les pointe.

Autre cas classique : les pages orphelines ou mal maillées. Si une section de votre site souffre d'un isolement structurel, le sitemap compense partiellement cette faiblesse. Attention toutefois — c'est un pansement, pas une solution.

Le format XML est-il le seul valable ?

Gary mentionne que c'est le plus populaire, et c'est vrai : XML reste la référence pour les moteurs de recherche. Mais Google accepte aussi les formats TXT (une URL par ligne) et RSS/Atom pour les flux de contenus récents.

Pour la majorité des sites, XML offre la meilleure flexibilité : balises lastmod, priority, changefreq (même si ces deux dernières sont largement ignorées par Google). Les CMS modernes le génèrent automatiquement, donc peu de raison de s'en priver.

- Un sitemap n'est pas obligatoire si votre maillage interne est solide et que Google découvre naturellement vos pages

- Il devient précieux pour les sites volumineux, à forte fréquence de publication ou comportant des pages isolées

- XML reste le format standard, bien que TXT et RSS soient supportés pour des cas d'usage spécifiques

- Soumettre un sitemap ne garantit ni crawl ni indexation — c'est un signal, pas une instruction

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Oui, totalement. On constate régulièrement que des sites sans sitemap — petits blogs bien maillés, sites vitrine structurés — s'indexent sans problème. À l'inverse, des sitemaps mal foutus (URLs en noindex, redirections, contenus dupliqués) ne sauvent personne.

Ce qui coince, c'est que beaucoup de praticiens confondent « aide à la découverte » et « garantie d'indexation ». Le sitemap reste un canal de soumission passif. Si votre contenu est médiocre ou que votre crawl budget est saturé par des pages inutiles, le sitemap n'y changera rien.

Quelles nuances faut-il apporter à cette affirmation ?

Dire qu'un sitemap « n'est pas obligatoire » est techniquement vrai, mais le risque de s'en passer dépend fortement du contexte. Sur un site de 50 pages avec une arborescence limpide, OK. Sur un site de 100 000 URLs avec des profondeurs de clic variables, c'est jouer avec le feu.

Gary ne précise pas non plus que les sitemaps servent aussi à signaler les mises à jour via la balise lastmod. Bien exploitée (et honnêtement renseignée), elle accélère la re-crawl des pages modifiées. C'est un levier souvent sous-estimé pour les sites d'actualité ou e-commerce.

Quand faut-il vraiment s'inquiéter de l'absence de sitemap ?

Soyons honnêtes : si Google met des semaines à découvrir vos nouvelles pages alors que vous publiez quotidiennement, l'absence de sitemap n'est probablement pas le seul coupable. Vérifiez d'abord votre crawl budget, votre robots.txt, vos temps de réponse serveur.

En revanche, sur des sites multi-lingues ou multi-régionaux, le sitemap devient un outil de signalisation précieux pour les balises hreflang. C'est un cas d'usage où son utilité dépasse la simple découverte.

Impact pratique et recommandations

Que faut-il faire concrètement avec cette information ?

Première étape : auditez votre sitemap actuel. Regardez dans la Search Console le taux de couverture (URLs soumises vs indexées). Si vous avez 10 000 URLs soumises et 3 000 indexées, creusez les raisons — problème de qualité, canonicals mal gérés, noindex oubliés.

Deuxième réflexe : segmentez vos sitemaps si votre site dépasse 5 000 pages. Créez un index de sitemaps avec des fichiers séparés par typologie (produits, blog, pages statiques). Cela facilite le diagnostic et permet à Google de prioriser le crawl.

Quelles erreurs éviter absolument ?

Ne listez jamais dans un sitemap des URLs en noindex, 404, 301 ou canonicalisées vers une autre page. C'est du bruit qui pollue le signal et fait perdre du temps à Googlebot — et donc érode votre crawl budget.

Autre piège classique : la balise priority. Google l'ignore largement, ne vous cassez pas la tête à l'optimiser. En revanche, lastmod doit être précise — ne mettez pas la date du jour sur toutes les URLs si rien n'a changé.

Comment vérifier que votre stratégie sitemap est efficace ?

Utilisez la Search Console pour suivre le taux de découverte : combien de temps entre la soumission d'une nouvelle URL et son premier crawl ? Si c'est rapide (quelques heures à 2 jours), votre sitemap remplit son rôle.

Comparez aussi le comportement de pages présentes dans le sitemap vs absentes. Si des pages hors sitemap mais bien maillées s'indexent plus vite, c'est un signe que votre maillage interne prime sur le sitemap — ce qui est plutôt bon signe structurellement.

- Vérifier que le sitemap ne contient que des URLs 200, indexables et canoniques

- Segmenter les sitemaps par type de contenu sur les sites de plus de 5 000 pages

- Renseigner lastmod uniquement en cas de modification réelle du contenu

- Monitorer le taux de couverture dans la Search Console (URLs soumises / indexées)

- Comparer la vitesse de découverte des pages avec et sans sitemap pour évaluer l'efficacité réelle

- Nettoyer régulièrement les URLs obsolètes (redirections, suppressions)

❓ Questions frequentes

Un site peut-il être indexé sans sitemap XML ?

Les balises priority et changefreq du sitemap XML sont-elles utiles ?

Combien d'URLs maximum dans un sitemap XML ?

Faut-il soumettre le sitemap dans la Search Console ou suffit-il de le déclarer dans le robots.txt ?

Peut-on mettre des URLs en noindex dans un sitemap ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 22/02/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.