Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Comment Google crawle-t-il vraiment vos pages web ?

- □ Comment Google découvre-t-il vraiment vos nouvelles pages ?

- □ Pourquoi Google ne découvre-t-il pas toutes les URLs de votre site ?

- □ Comment Googlebot décide-t-il quelles pages crawler sur votre site ?

- □ Googlebot ralentit-il volontairement sur votre site pour ne pas le surcharger ?

- □ Pourquoi Googlebot ignore-t-il une partie des URLs qu'il découvre ?

- □ Pourquoi Google ne voit-il pas votre contenu JavaScript sans rendering ?

- □ Faut-il vraiment un sitemap XML pour être indexé par Google ?

- □ Faut-il vraiment automatiser la génération de vos sitemaps ?

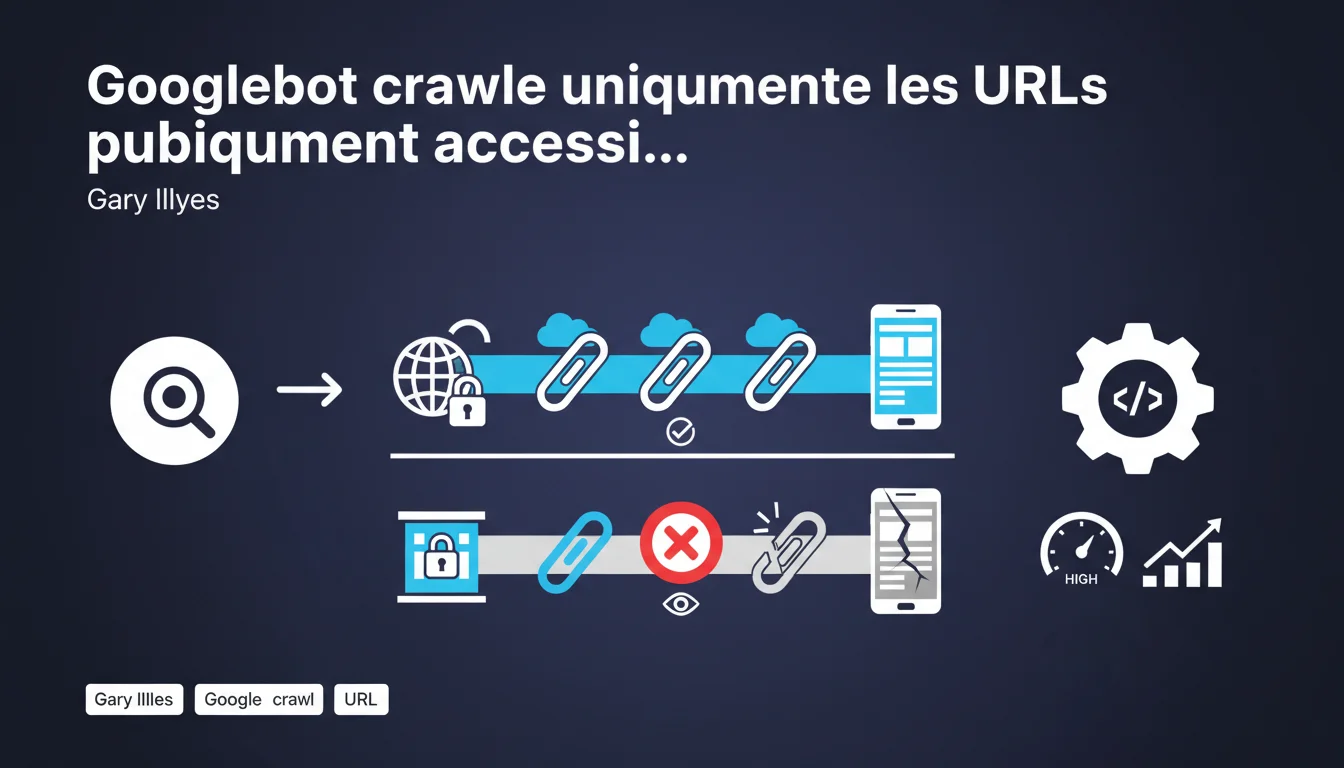

Googlebot ne crawle que les URLs publiquement accessibles sans authentification. Tout contenu placé derrière une page de connexion, un paywall ou un formulaire d'inscription reste invisible pour le moteur de recherche. Cette limitation impacte directement la stratégie d'indexation des sites proposant du contenu premium ou des espaces membres.

Ce qu'il faut comprendre

Qu'est-ce qu'une URL publiquement accessible pour Google ?

Une URL publiquement accessible est une adresse web que n'importe quel internaute peut atteindre sans fournir d'identifiants, sans remplir de formulaire, et sans accepter de conditions particulières au-delà des mentions légales standards. Googlebot se comporte comme un visiteur anonyme — s'il rencontre un obstacle à l'accès, il s'arrête.

Concrètement, cela signifie que les espaces membres, les contenus premium réservés aux abonnés, les documents derrière des paywalls ou même les pages nécessitant une simple inscription email restent invisibles pour le crawler. Google ne dispose d'aucun mécanisme pour s'authentifier automatiquement sur ces espaces.

Pourquoi cette limitation existe-t-elle ?

Google ne peut pas — et ne veut pas — gérer des millions de comptes utilisateurs pour crawler du contenu privé. Le principe fondamental du moteur de recherche repose sur l'indexation du web public, accessible à tous. Permettre à Googlebot de franchir des barrières d'authentification poserait des questions juridiques, éthiques et techniques majeures.

Cette règle protège également les propriétaires de sites qui souhaitent monétiser leur contenu ou créer des espaces réservés. Sans cette barrière, impossible de contrôler qui accède à quoi.

Quelles sont les exceptions à cette règle ?

Il n'existe aucune exception officielle. Même les contenus partiellement visibles (aperçus, extraits) ne sont crawlables que si la partie visible est accessible sans connexion. Google propose des solutions alternatives comme le balisage de contenu payant (Flexible Sampling, Metered Paywall) qui permet d'indexer du contenu premium sous conditions strictes — mais ce n'est pas un contournement de la règle d'accessibilité publique.

- Googlebot ne peut pas remplir de formulaires d'inscription ou de connexion

- Les espaces membres, intranets et contenus premium restent hors de portée du crawler

- Le balisage de contenu payant nécessite une accessibilité partielle sans authentification

- Aucun paramètre robots.txt ou meta ne peut forcer l'indexation de contenu privé

- Les URLs derrière OAuth, SSO ou tout système d'authentification sont exclues du crawl

Avis d'un expert SEO

Cette déclaration correspond-elle aux observations terrain ?

Totalement. On ne constate aucun cas documenté où Googlebot aurait réussi à indexer du contenu véritablement protégé par authentification. Les quelques situations ambiguës concernent généralement des sites mal configurés qui exposent involontairement du contenu censé être privé — failles de sécurité, erreurs de configuration serveur, ou pages accessibles via des URLs directes non protégées.

Le vrai piège ? Les sites qui croient protéger leur contenu avec du JavaScript côté client. Si le contenu HTML est présent dans le code source même masqué visuellement, Googlebot peut le voir. Ce n'est pas une exception à la règle — c'est juste une mauvaise compréhension de ce qu'est une vraie barrière d'authentification.

Quelles nuances faut-il apporter à cette déclaration ?

Gary Illyes ne précise pas ce qui se passe avec les contenus mixtes — pages où une partie est publique et une autre réservée. D'expérience, Google indexe uniquement la portion accessible sans login. Mais la frontière peut être floue si le site utilise du chargement dynamique ou des API pour afficher du contenu conditionnel.

Autre zone grise : les pages accessibles via des liens temporaires ou tokens envoyés par email. Techniquement publiques (pas d'authentification), mais destinées à rester privées. Google peut les crawler si le lien est découvert — et c'est souvent le cas via des partages involontaires ou des fuites.

Dans quels cas cette règle pose-t-elle problème ?

Soyons honnêtes : cette limitation complique la vie des sites avec du contenu premium ou des espaces membres. Les plateformes SaaS, les médias à abonnement, les sites de formation en ligne doivent trouver un équilibre entre visibilité SEO et protection du contenu.

La solution la plus courante consiste à créer des landing pages publiques qui présentent le contenu premium sans le dévoiler entièrement. Mais cela fragmente l'architecture et dilue la profondeur de contenu — deux facteurs critiques pour le SEO. Il n'existe pas de solution miracle.

Impact pratique et recommandations

Que faut-il faire si vous avez du contenu derrière une connexion ?

Première étape : accepter que ce contenu ne sera jamais indexé. Aucune manipulation technique ne changera cette réalité. Si votre modèle économique repose sur du contenu réservé, vous devez construire votre stratégie SEO ailleurs — sur des pages publiques qui attirent du trafic vers vos offres premium.

Créez des pages teaser publiques pour chaque ressource premium. Un bon exemple : un article de blog qui résume les grands points d'un livre blanc téléchargeable après inscription. La page publique se positionne sur les requêtes cibles, le livre blanc reste protégé. C'est un compromis, pas une solution idéale.

Quelles erreurs techniques faut-il absolument éviter ?

L'erreur classique : protéger du contenu uniquement côté client avec du JavaScript ou du CSS (display:none). Si le HTML complet est présent dans le code source, Google le voit et l'indexe. Vous pensez avoir sécurisé votre contenu alors qu'il est totalement exposé.

Autre piège : les URLs prévisibles ou découvrables pour du contenu censé rester privé. Si vos documents premium suivent un schéma /ressources/doc-001.pdf, doc-002.pdf, etc., un bot malveillant (ou Googlebot qui découvre un lien) peut les trouver. La protection doit être au niveau serveur, pas juste une page de connexion en façade.

Comment auditer la protection de votre contenu privé ?

Testez en navigation privée sans être connecté. Si vous accédez au contenu d'une manière ou d'une autre (URL directe, lien partagé, manipulation de paramètres), c'est que Google peut aussi. Utilisez des outils comme Screaming Frog en mode "sans cookies" pour simuler le comportement de Googlebot.

Vérifiez également la Search Console : si des URLs censées être privées apparaissent dans les rapports de couverture ou de performance, vous avez une fuite. Soit votre protection est défaillante, soit des liens externes pointent vers ces pages et Google tente de les crawler.

- Identifiez clairement quelles pages doivent rester privées et lesquelles doivent être publiques

- Implémentez une authentification serveur (pas juste JavaScript) pour protéger le contenu sensible

- Créez des landing pages publiques optimisées pour chaque offre premium

- Utilisez le balisage schema.org pour les contenus payants si vous optez pour Flexible Sampling

- Auditez régulièrement la Search Console pour détecter des fuites d'indexation

- Testez vos protections en navigation privée et avec des crawlers simulant Googlebot

- Documentez votre architecture d'URLs pour éviter les zones grises entre public et privé

❓ Questions frequentes

Est-ce que Google peut indexer des pages derrière un paywall ?

Si je partage un lien direct vers une page privée, Google peut-il la crawler ?

Les extraits visibles sans connexion sont-ils crawlables ?

Puis-je forcer l'indexation d'un espace membre avec des directives spéciales ?

Comment savoir si du contenu privé apparaît dans l'index Google ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 22/02/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.