Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Comment Google crawle-t-il vraiment vos pages web ?

- □ Comment Google découvre-t-il vraiment vos nouvelles pages ?

- □ Pourquoi Google ne découvre-t-il pas toutes les URLs de votre site ?

- □ Googlebot ralentit-il volontairement sur votre site pour ne pas le surcharger ?

- □ Pourquoi Googlebot ignore-t-il une partie des URLs qu'il découvre ?

- □ Googlebot peut-il vraiment crawler le contenu derrière une page de connexion ?

- □ Pourquoi Google ne voit-il pas votre contenu JavaScript sans rendering ?

- □ Faut-il vraiment un sitemap XML pour être indexé par Google ?

- □ Faut-il vraiment automatiser la génération de vos sitemaps ?

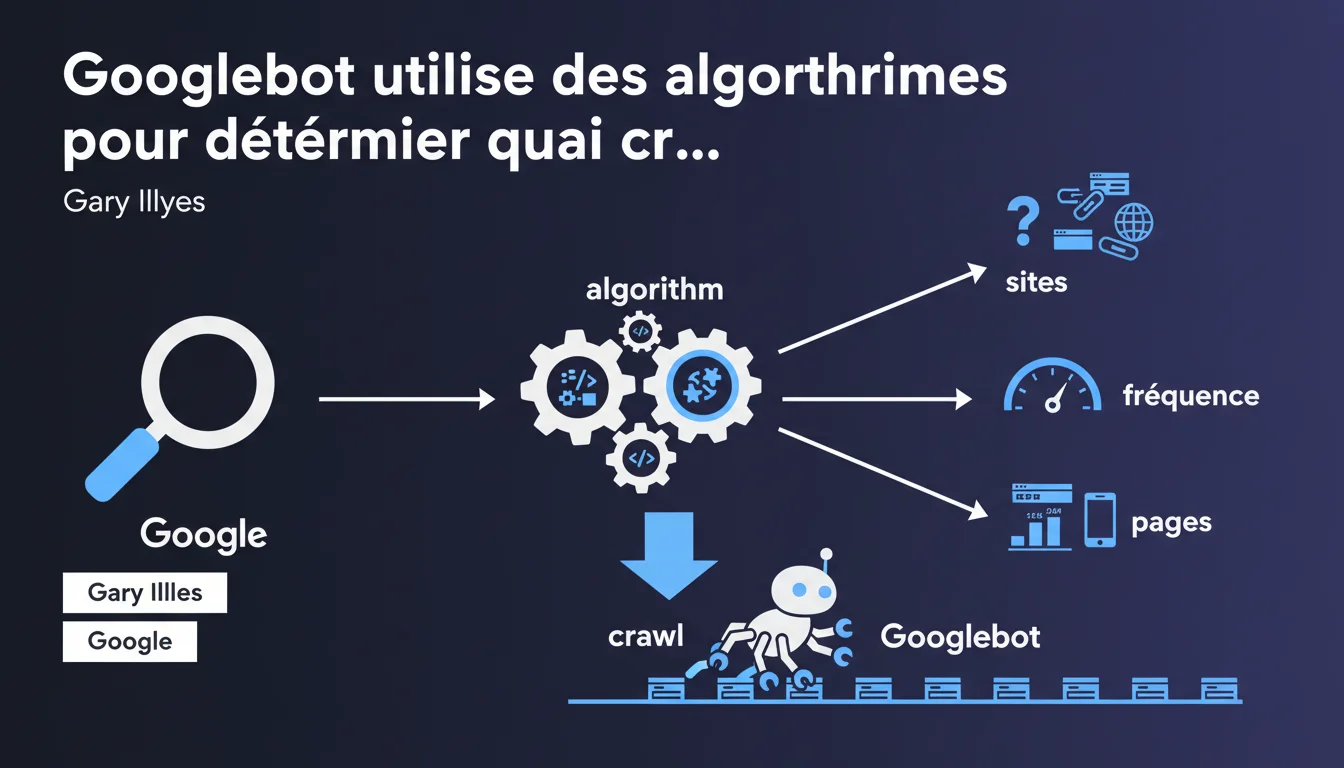

Googlebot s'appuie sur des algorithmes pour déterminer quels sites explorer, à quelle fréquence et combien de pages récupérer par site. Cette déclaration confirme qu'il n'existe pas de règle universelle : chaque site est évalué individuellement selon des critères que Google ne détaille pas précisément. L'enjeu pour les SEO est d'optimiser les signaux envoyés à Googlebot pour maximiser le crawl des pages stratégiques.

Ce qu'il faut comprendre

Quels critères Googlebot utilise-t-il pour prioriser le crawl ?

Google ne donne pas la liste exhaustive des critères utilisés par ses algorithmes de crawl. On sait néanmoins que la fréquence de mise à jour du contenu, l'autorité du domaine, la qualité des backlinks et la popularité des pages jouent un rôle déterminant.

La structure technique du site intervient aussi : temps de réponse serveur, profondeur des pages, qualité du maillage interne et présence d'erreurs influencent directement la capacité de Googlebot à explorer efficacement vos contenus.

Le crawl budget est-il le même pour tous les sites ?

Non. Chaque site dispose d'un crawl budget — une allocation de ressources que Googlebot consacre à l'exploration. Ce budget varie selon la taille, l'autorité et la santé technique du site.

Un petit blog n'aura jamais le même crawl budget qu'un site e-commerce de 100 000 pages. Google ajuste dynamiquement cette allocation en fonction des performances observées et de la demande en indexation.

Cette approche algorithmique signifie-t-elle une perte de contrôle pour les SEO ?

Partiellement. Vous ne pouvez pas forcer Googlebot à crawler une page spécifique à une fréquence donnée. Mais vous gardez la main sur les signaux techniques et sémantiques qui orientent ses décisions.

Le fichier robots.txt, le sitemap XML, les directives canonical et noindex, ainsi que la vitesse de chargement restent des leviers actionnables. L'enjeu est de maximiser l'efficacité du crawl sur vos pages à forte valeur ajoutée.

- Googlebot utilise des algorithmes opaques pour décider quoi crawler et à quelle fréquence

- Le crawl budget varie fortement d'un site à l'autre selon plusieurs critères

- La structure technique, la fraîcheur du contenu et l'autorité influencent ces décisions

- Les SEO conservent des leviers d'optimisation mais ne contrôlent pas directement la fréquence de crawl

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui, globalement. Les observations concordent : les sites avec une architecture propre, des contenus fréquemment mis à jour et une autorité solide bénéficient d'un crawl plus intensif. À l'inverse, les sites techniques négligés ou les fermes de contenu voient leur crawl budget drastiquement réduit.

Cependant, Google reste volontairement évasif sur les critères précis et leur pondération respective. Impossible de savoir si la vitesse serveur pèse plus lourd que la profondeur de page, par exemple. [À vérifier] : l'impact exact de chaque facteur technique reste largement opaque.

Quelles nuances cette déclaration masque-t-elle ?

Premier point : dire que Googlebot « utilise des algorithmes » n'apporte aucune information concrète. C'est une évidence — mais cela n'explique rien sur la logique sous-jacente.

Deuxième point : la formulation laisse entendre que le système est entièrement automatisé. Or, on sait que Google peut ajuster manuellement le crawl de certains sites en cas de pénalité ou de problème technique majeur. Cette déclaration simplifie donc une réalité plus complexe.

Troisième point — et c'est crucial : la fréquence de crawl ne garantit pas l'indexation. Googlebot peut passer quotidiennement sur vos pages sans jamais les indexer si elles sont jugées de faible qualité ou redondantes. [À vérifier] : beaucoup de sites confondent encore « être crawlé » et « être indexé », deux étapes distinctes du processus.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Certains types de contenus échappent aux règles classiques de crawl budget. Les contenus bloqués par robots.txt ne seront jamais crawlés (logique). Les pages orphelines — sans lien entrant interne ou externe — peuvent passer sous le radar pendant des mois.

Impact pratique et recommandations

Comment optimiser votre site pour maximiser le crawl des pages stratégiques ?

Première action : auditez vos logs serveur pour identifier quelles pages Googlebot crawle réellement, à quelle fréquence, et combien de ressources il consomme. Sans cette vision, vous pilotez à l'aveugle.

Deuxième action : priorisez le maillage interne vers vos pages à forte valeur ajoutée. Plus une page reçoit de liens internes depuis des pages fréquemment crawlées, plus elle sera visitée par Googlebot. Les pages profondes (4-5 clics depuis la home) sont souvent sous-crawlées.

Troisième action : éliminez les gouffres à crawl budget. Facettes infinies, pages paginées mal gérées, contenus dupliqués, URLs en paramètres — tout ce qui génère des milliers de pages sans valeur doit être bloqué ou canonicalisé.

Quelles erreurs éviter pour ne pas gaspiller votre crawl budget ?

Ne bloquez jamais des ressources essentielles (CSS, JS) dans robots.txt si elles sont nécessaires au rendu. Google a besoin d'accéder à ces fichiers pour comprendre vos pages. Un blocage abusif peut nuire à l'évaluation de vos contenus.

Évitez les redirections en chaîne (A → B → C). Chaque saut consomme du crawl budget inutilement. Redirigez directement de A vers C. Vérifiez aussi que vos codes HTTP sont cohérents : une page qui retourne un 200 mais qui devrait être en 404 pollue l'index.

Ne sur-optimisez pas au détriment de l'expérience utilisateur. Si vous bloquez toutes vos images pour « économiser du crawl budget », vous dégradez la qualité perçue de vos pages — ce qui peut à terme réduire leur priorité de crawl.

Quels outils utiliser pour suivre et améliorer le crawl de votre site ?

La Search Console fournit des données de crawl de base : erreurs, statistiques de crawl, couverture d'indexation. C'est votre premier point de contrôle, mais les données sont agrégées et parfois en retard.

Pour une analyse fine, passez à l'analyse de logs serveur avec des outils comme Oncrawl, Botify ou Screaming Frog Log Analyzer. Vous verrez en temps réel quelles pages Googlebot visite, combien de fois, et quelles ressources il ignore.

- Auditez régulièrement vos logs serveur pour comprendre le comportement réel de Googlebot

- Optimisez le maillage interne pour pousser le crawl vers vos pages stratégiques

- Éliminez les gouffres à crawl budget : facettes, pagination mal gérée, duplicata

- Corrigez les redirections en chaîne et harmonisez vos codes HTTP

- Ne bloquez jamais CSS/JS nécessaires au rendu dans robots.txt

- Suivez l'évolution du crawl avec la Search Console et des outils d'analyse de logs

❓ Questions frequentes

Googlebot crawle-t-il toutes les pages de mon site ?

Puis-je forcer Googlebot à crawler une page spécifique plus souvent ?

Le crawl budget est-il un problème pour les petits sites ?

Comment savoir si mon site a un problème de crawl budget ?

La vitesse du serveur impacte-t-elle vraiment le crawl ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 22/02/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.