Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Le robots.txt a-t-il toujours été respecté par Google depuis sa création ?

- □ Pourquoi tous les crawlers Google utilisent-ils la même infrastructure de crawl ?

- □ Google ralentit-il vraiment son crawl pour protéger vos serveurs ?

- □ Pourquoi Google a-t-il multiplié ses crawlers depuis l'arrivée de Mediapartners-Google ?

- □ Pourquoi Google ignore-t-il robots.txt pour les actions utilisateur ?

- □ L'outil de test en direct de Search Console crawle-t-il vraiment votre site ?

- □ Googlebot supporte-t-il HTTP/3 pour crawler votre site ?

- □ Pourquoi Google réduit-il drastiquement son empreinte de crawl sur le web ?

- □ Le crawl de Google consomme-t-il vraiment le plus de ressources serveur ?

- □ Pourquoi la charge serveur de Googlebot varie-t-elle autant selon votre architecture technique ?

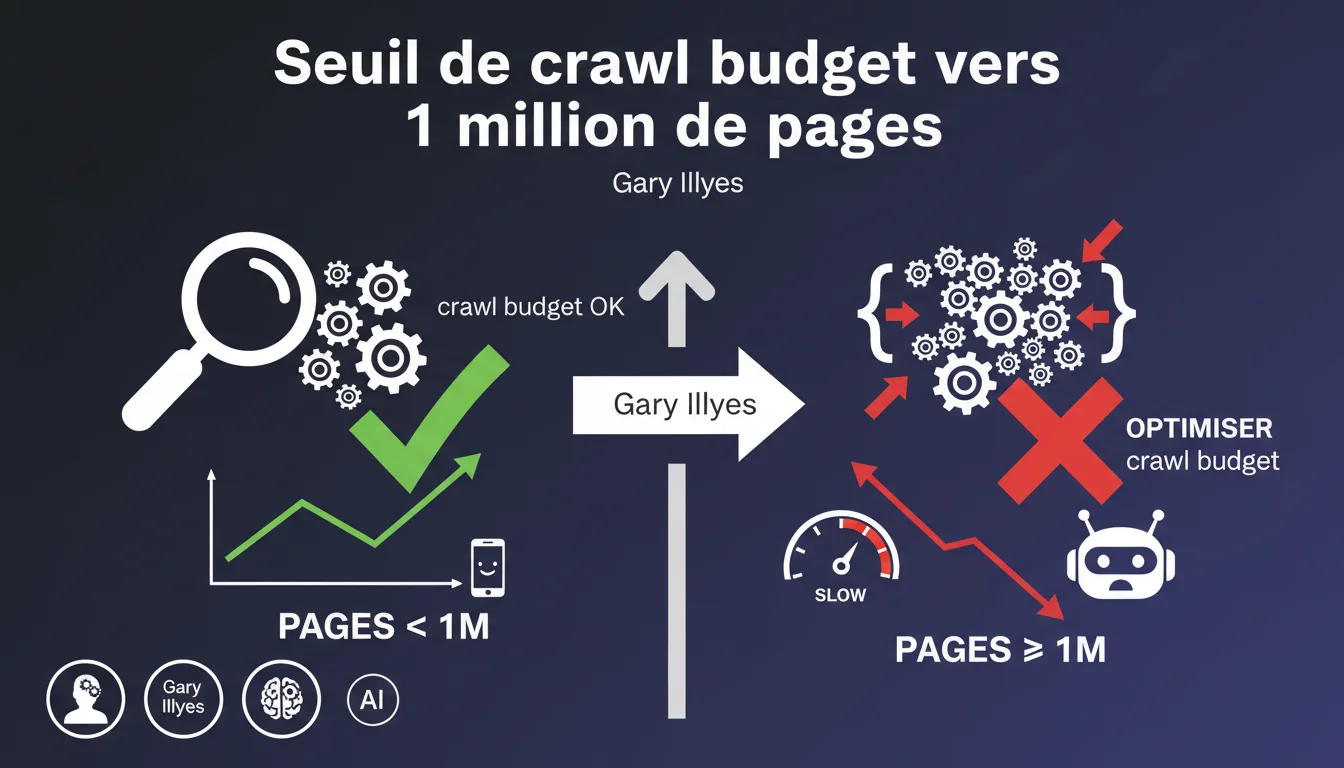

Google fixe un seuil indicatif d'environ 1 million de pages avant de considérer le crawl budget comme un enjeu prioritaire pour un site. En dessous, les problèmes d'exploration relèvent généralement d'autres causes — architecture défaillante, liens orphelins, contenu de faible qualité. Ce seuil n'est pas une règle absolue, mais un repère pour hiérarchiser les priorités.

Ce qu'il faut comprendre

Pourquoi Google fixe-t-il ce seuil à 1 million de pages ?

Googlebot dispose de ressources quasi-illimitées pour explorer le web, mais il optimise l'allocation de son temps d'exploration en fonction de la popularité et de la santé technique du site. Un site bien structuré de 500 000 pages sera crawlé sans friction, tandis qu'un site de 50 000 pages mal conçu peut rencontrer des blocages.

Le seuil d'1 million n'est pas un mur technique — c'est une zone de vigilance. Au-delà, la probabilité que certaines pages stratégiques soient négligées augmente si l'architecture n'est pas optimisée. En dessous, si vos pages ne sont pas indexées rapidement, le problème vient rarement du crawl budget.

Qu'est-ce qui détermine réellement le crawl budget d'un site ?

Deux facteurs principaux : la demande de crawl (popularité, fraîcheur du contenu, autorité du domaine) et la limite de crawl (santé du serveur, temps de réponse, erreurs HTTP). Google ajuste dynamiquement son exploration en fonction de ces variables.

Un site très populaire avec un contenu fréquemment mis à jour bénéficiera d'un crawl budget généreux, même avec 5 millions de pages. À l'inverse, un site peu référencé avec 100 000 pages statiques verra Googlebot espacer ses passages. La taille brute du site n'est qu'un indicateur parmi d'autres.

Quand ce seuil devient-il vraiment pertinent ?

Sur les plateformes e-commerce avec génération automatique de variantes produits, les sites d'actualités avec archives volumineuses, ou les annuaires avec millions de fiches. Dans ces contextes, l'optimisation du crawl budget redevient stratégique : bloquer les pages à faible valeur, prioriser les URL profitables.

- Le seuil d'1 million de pages est un repère indicatif, pas une règle absolue

- En dessous, les problèmes d'indexation proviennent rarement du crawl budget

- La qualité architecturale et la popularité pèsent plus que le volume brut

- Au-delà du million, l'audit technique devient prioritaire pour éviter le gaspillage de crawl

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, globalement. Les audits de sites entre 100 000 et 800 000 pages montrent rarement un déficit de crawl comme cause racine des problèmes d'indexation. Les vrais coupables : contenu dupliqué, pagination mal gérée, liens internes défaillants, temps de réponse serveur catastrophique.

En revanche, dès qu'on dépasse le million — particulièrement sur des plateformes avec croissance non maîtrisée du volume de pages — le risque d'avoir des sections entières sous-crawlées augmente mécaniquement. [A vérifier] : Google ne précise pas si ce seuil s'applique uniformément à tous les secteurs ou s'il varie selon la typologie de site.

Quelles nuances faut-il apporter à cette affirmation ?

Le seuil est indicatif, pas normatif. Un site médiatique très populaire avec 2 millions d'articles peut ne jamais rencontrer de friction, tandis qu'un annuaire B2B obscur avec 300 000 fiches verra Googlebot se désintéresser rapidement des pages profondes. La fraîcheur du contenu et l'autorité du domaine comptent davantage que le volume brut.

Autre biais : Gary Illyes parle de « site individuel ». Qu'en est-il des architectures multi-domaines, des sous-domaines, des sous-répertoires géolocalisés ? Cette déclaration laisse trop de zones grises pour les cas complexes — typiquement les groupes médias ou les plateformes SaaS internationales.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Sur les sites avec régénération massive d'URL (paramètres dynamiques mal canonisés, filtres produits, sessions utilisateurs), le crawl budget peut s'épuiser bien avant 1 million de pages indexables. Googlebot perd du temps sur des URL sans valeur SEO, au détriment des pages stratégiques.

Impact pratique et recommandations

Que faut-il faire concrètement si mon site dépasse 1 million de pages ?

Commencer par un audit de crawl comparatif : combien de pages sont réellement crawlées sur une période de 30 jours via Search Console ? Comparer ce chiffre au nombre de pages stratégiques. Si l'écart est significatif, identifier les sections négligées et les causes (profondeur excessive, liens orphelins, temps de réponse).

Ensuite, prioriser impitoyablement : bloquer via robots.txt ou balise noindex les pages à faible valeur (archives anciennes, filtres redondants, pages de remerciement). Investir dans le maillage interne pour remonter les pages stratégiques en surface. Optimiser la vitesse serveur pour maximiser le nombre de pages crawlables par session Googlebot.

Quelles erreurs éviter si mon site est sous le million de pages ?

Ne pas justifier une indexation médiocre par un prétendu « manque de crawl budget ». En dessous du million, c'est presque toujours un prétexte commode pour masquer des défaillances structurelles : contenu faible, cannibalisation, absence de liens internes, balises meta robots mal configurées.

Éviter également l'obsession du crawl budget comme métrique de vanité. Ce qui compte, c'est le taux d'indexation des pages stratégiques, pas le volume brut de crawl. Un site de 10 000 pages parfaitement indexées surperforme un site de 500 000 pages dont 80 % sont ignorées.

Comment vérifier que mon site exploite efficacement son crawl budget ?

Dans Google Search Console, section « Statistiques d'exploration » : observer l'évolution du nombre de pages crawlées par jour, les erreurs serveur, le temps de téléchargement moyen. Si le volume de crawl stagne ou régresse sans cause externe (migration, pénalité), creuser les logs serveur pour identifier les goulots.

- Auditer le volume de pages crawlées vs pages stratégiques dans Search Console

- Bloquer via robots.txt les sections à faible valeur SEO (filtres, archives anciennes)

- Optimiser le maillage interne pour remonter les pages prioritaires

- Surveiller le temps de réponse serveur et réduire les erreurs 5xx

- Implémenter un sitemap XML hiérarchisé par priorité commerciale

- Éviter la génération incontrôlée d'URL dynamiques (paramètres, sessions)

❓ Questions frequentes

Le crawl budget s'applique-t-il uniquement aux très gros sites ?

Comment savoir si mon site souffre d'un problème de crawl budget ?

Faut-il bloquer des pages pour économiser du crawl budget ?

Un sitemap XML peut-il augmenter le crawl budget ?

Les sous-domaines consomment-ils un crawl budget séparé ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 29/05/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.