Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Le robots.txt a-t-il toujours été respecté par Google depuis sa création ?

- □ Pourquoi tous les crawlers Google utilisent-ils la même infrastructure de crawl ?

- □ Google ralentit-il vraiment son crawl pour protéger vos serveurs ?

- □ Pourquoi Google a-t-il multiplié ses crawlers depuis l'arrivée de Mediapartners-Google ?

- □ Pourquoi Google ignore-t-il robots.txt pour les actions utilisateur ?

- □ L'outil de test en direct de Search Console crawle-t-il vraiment votre site ?

- □ Googlebot supporte-t-il HTTP/3 pour crawler votre site ?

- □ Le crawl de Google consomme-t-il vraiment le plus de ressources serveur ?

- □ Faut-il vraiment s'inquiéter du crawl budget avant 1 million de pages ?

- □ Pourquoi la charge serveur de Googlebot varie-t-elle autant selon votre architecture technique ?

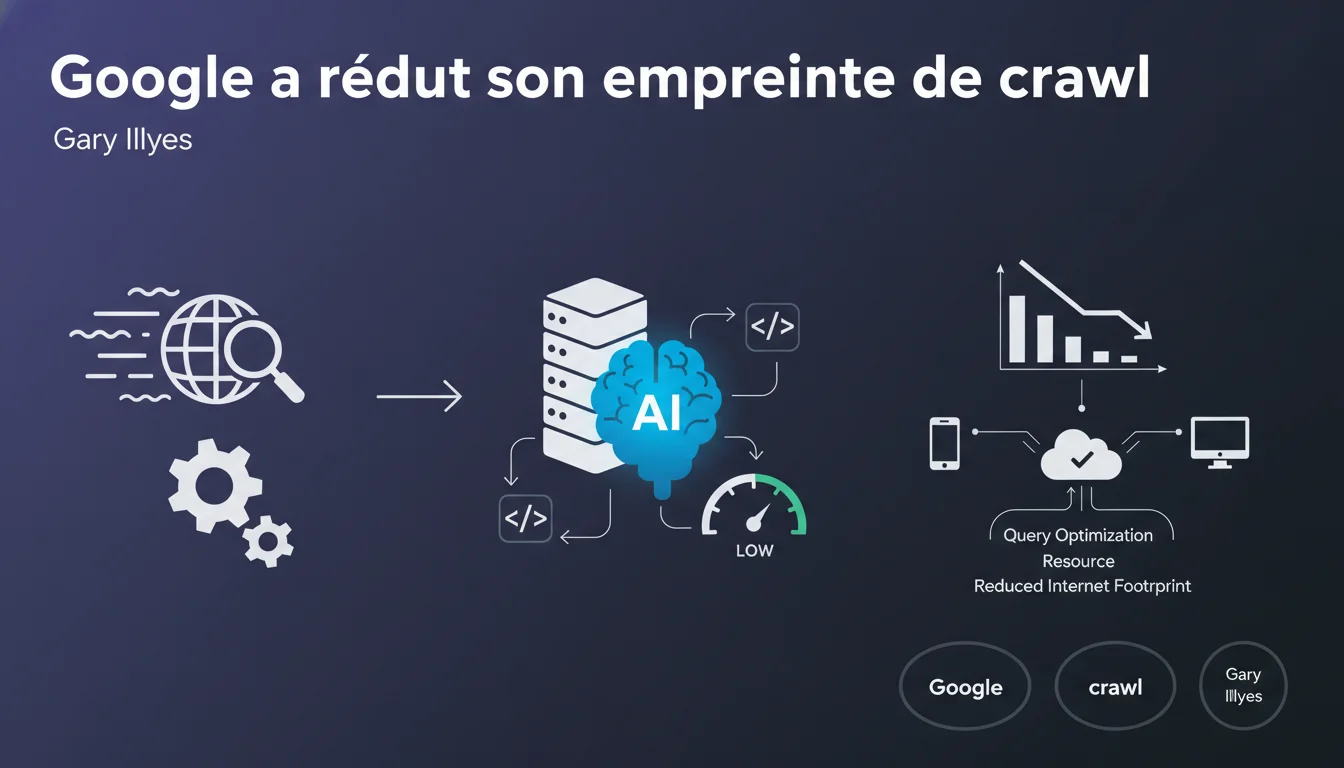

Google a optimisé ses requêtes de crawl pour réduire son empreinte sur Internet et économiser des ressources. Concrètement, Googlebot visite moins de pages, ce qui impacte directement les sites avec un crawl budget limité. Cette évolution soulève des questions stratégiques sur l'optimisation technique des sites pour maintenir leur visibilité.

Ce qu'il faut comprendre

Que signifie exactement « réduire l'empreinte de crawl » ?

Google a choisi de limiter le nombre de requêtes que ses robots effectuent sur les serveurs web. L'objectif officiel : économiser des ressources, probablement autant côté Google (infrastructure, énergie) que côté éditeurs (charge serveur).

Cette réduction ne signifie pas nécessairement que votre site sera moins crawlé — sauf si vous faites partie des sites avec un crawl budget contraint. En revanche, Google priorise encore plus sévèrement les pages qu'il choisit d'explorer.

Quels sites sont les plus impactés par cette restriction ?

Les gros sites avec des milliers de pages (e-commerce, médias, annuaires) sont en première ligne. Si vous publiez régulièrement du contenu ou générez automatiquement des pages, cette optimisation risque de ralentir l'indexation de vos nouvelles URLs.

Les petits sites (quelques dizaines de pages) ne verront probablement aucun impact. Leur crawl budget n'était déjà pas un problème structurel.

Google communique-t-il des chiffres précis sur cette réduction ?

Non. Et c'est là que ça coince. La déclaration reste délibérément floue : aucune donnée sur l'ampleur de la réduction, aucune métrique partagée, aucune timeline détaillée.

On ne sait pas si le crawl a baissé de 5 % ou de 40 %. Impossible de quantifier l'impact réel sans monitorer soi-même ses logs serveur.

- Google priorise plus sévèrement les pages à crawler

- Les gros sites avec crawl budget limité sont les premiers concernés

- Aucune donnée chiffrée communiquée officiellement

- Surveiller vos logs devient encore plus stratégique

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, largement. Depuis plusieurs mois, de nombreux SEO rapportent une baisse du taux de crawl sur des sites e-commerce volumineux. Les nouvelles pages mettent plus de temps à être découvertes, les pages profondes sont moins visitées.

Ce qui est intéressant, c'est que Google présente ça comme une optimisation vertueuse — économie de ressources, écologie numérique. Soyons honnêtes : c'est aussi une manière de gérer l'explosion du contenu web avec des coûts d'infrastructure maîtrisés.

Quelles nuances faut-il apporter à cette annonce ?

[À vérifier] Google parle d'« optimisation des requêtes », mais ne détaille pas les critères de priorisation. Est-ce que la qualité perçue d'un site joue davantage ? La fraîcheur du contenu ? L'engagement utilisateur ?

L'absence de transparence rend difficile l'ajustement stratégique. On suppose que les signaux classiques (liens, autorité, performance) pèsent encore plus lourd, mais rien n'est confirmé.

Autre point flou : cette réduction s'applique-t-elle uniformément à tous les types de contenu, ou certains verticaux (actualités, par exemple) restent-ils privilégiés ? Aucune indication.

Dans quels cas cette restriction ne s'applique-t-elle pas ?

Si votre site est petit, bien structuré et techniquement propre, vous ne verrez probablement rien. Le crawl budget n'a jamais été votre goulot d'étranglement.

En revanche, si vous avez des centaines de milliers de pages, des facettes infinies, des duplications non contrôlées ou une arborescence bordélique, cette optimisation va amplifier vos problèmes existants. Google ne fera plus l'effort de compenser vos faiblesses techniques.

Impact pratique et recommandations

Que faut-il faire concrètement pour s'adapter ?

Première étape : monitorer vos logs serveur. Sans données précises sur l'évolution de votre crawl, vous naviguez à l'aveugle. Utilisez des outils comme Oncrawl, Botify ou des solutions maison pour traquer l'activité de Googlebot.

Ensuite, priorisez impitoyablement. Identifiez vos pages stratégiques (celles qui génèrent du trafic, des conversions, du chiffre) et assurez-vous qu'elles restent accessibles en 1-2 clics depuis la home. Le maillage interne devient encore plus critique.

Quelles erreurs éviter absolument ?

Ne laissez pas Google crawler des pages sans valeur : facettes inutiles, paramètres d'URL redondants, pages paginées infinies, contenus dupliqués. Chaque requête gaspillée sur du contenu low-quality réduit les chances que vos vraies pages soient explorées.

Évitez aussi de bloquer des ressources critiques (CSS, JS) si elles influencent le rendu. Google crawle moins, mais il veut toujours comprendre vos pages. Ne lui compliquez pas la tâche.

Comment vérifier que votre site reste performant malgré cette restriction ?

Comparez le taux d'indexation de vos nouvelles pages avant et après cette optimisation. Si une page publiée met désormais 10 jours à être indexée au lieu de 2, c'est un signal d'alerte.

Vérifiez aussi la profondeur de crawl : est-ce que Googlebot explore toujours vos pages profondes, ou s'arrête-t-il plus tôt dans l'arborescence ?

- Installer un outil d'analyse des logs serveur pour suivre l'activité de Googlebot

- Auditer votre architecture et éliminer les pages sans valeur SEO

- Renforcer le maillage interne vers les pages stratégiques

- Optimiser les temps de réponse serveur pour maximiser chaque crawl

- Surveiller le délai d'indexation des nouvelles pages publiées

- Nettoyer les facettes et paramètres d'URL redondants

- Soumettre les URLs prioritaires via l'API Indexing (si éligible)

❓ Questions frequentes

Mon petit site de 50 pages est-il concerné par cette réduction du crawl ?

Comment savoir si mon site est moins crawlé qu'avant ?

Google a-t-il communiqué les critères de priorisation du crawl ?

Faut-il bloquer certaines pages dans le robots.txt pour économiser le crawl budget ?

L'API Indexing peut-elle compenser cette réduction du crawl ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 29/05/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.