Declaration officielle

Autres déclarations de cette vidéo 13 ▾

- □ Robots.txt bloque-t-il vraiment l'indexation de vos pages ?

- □ La balise meta 'none' est-elle vraiment l'équivalent de noindex + nofollow ?

- □ Robots.txt est-il vraiment inefficace pour bloquer l'indexation ?

- □ Peut-on bloquer l'indexation de répertoires entiers via des modules serveur plutôt que robots.txt ?

- □ Faut-il vraiment indexer les pages de connexion de votre site ?

- □ Faut-il vraiment préférer rel=canonical à noindex pour les contenus anciens ?

- □ La balise noarchive empêche-t-elle réellement Google d'archiver vos pages ?

- □ Faut-il bloquer les snippets avec nosnippet pour protéger son contenu sensible ?

- □ Faut-il vraiment utiliser max-snippet et max-image-preview pour contrôler l'affichage dans les SERP ?

- □ Faut-il privilégier l'attribut nofollow individuel ou la balise meta robots nofollow pour contrôler le PageRank ?

- □ Pourquoi Google refuse-t-il de créer de nouvelles balises meta robots ?

- □ Comment bloquer l'indexation de PDFs et fichiers non-HTML sans accès aux headers HTTP ?

- □ Comment Google transforme-t-il vraiment vos PDFs en contenu indexable ?

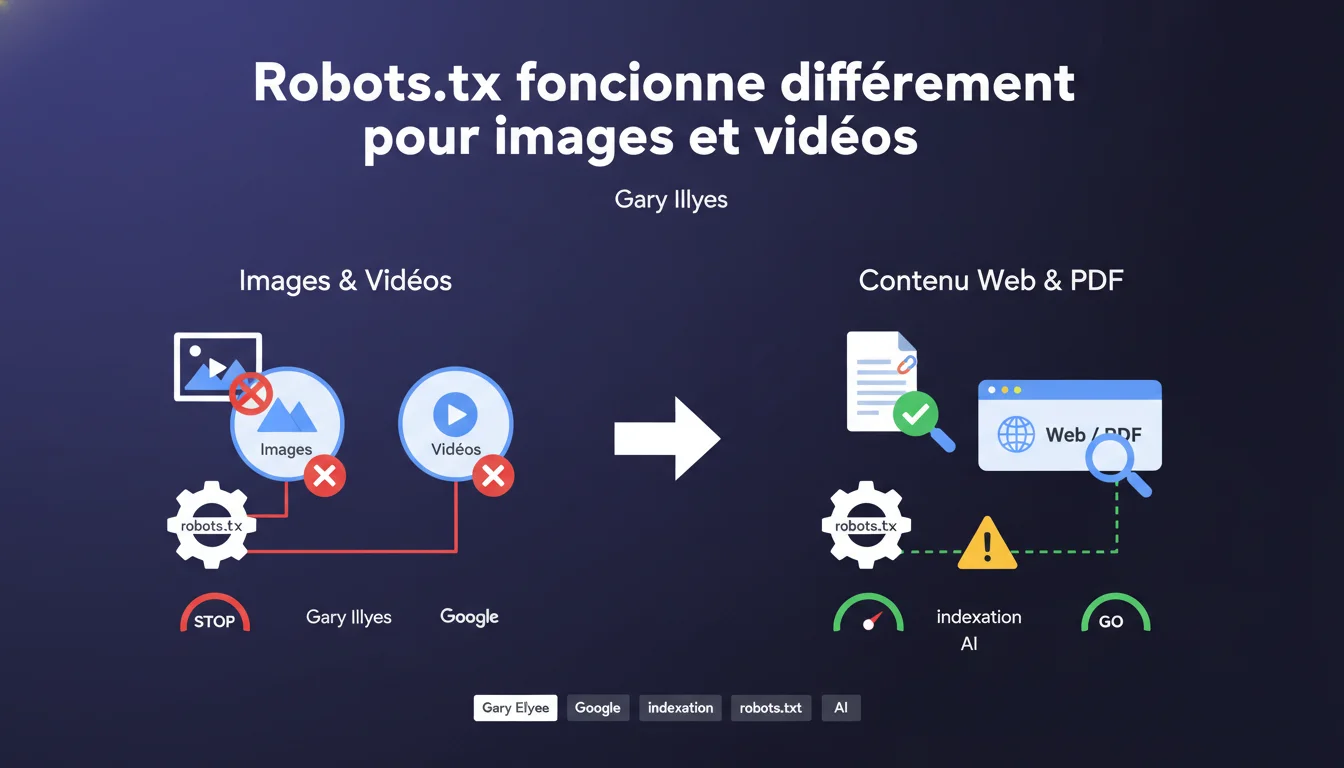

Le fichier robots.txt bloque efficacement l'indexation des images et vidéos car ces contenus vivent dans des onglets séparés (Images, Vidéos) où Google n'a rien à afficher sans le média lui-même. Pour les pages web classiques ou PDF, robots.txt ne suffit pas à empêcher l'indexation — l'URL peut apparaître dans les résultats même si le contenu n'est pas crawlé.

Ce qu'il faut comprendre

Comment Google indexe-t-il différemment images/vidéos et pages web ?

L'architecture de Google repose sur des index séparés par type de contenu. Les images vivent dans l'index Images, les vidéos dans l'index Vidéos, et le contenu textuel dans l'index Web principal. Cette séparation technique crée des comportements radicalement différents face au robots.txt.

Quand vous bloquez une image ou une vidéo via robots.txt, Google ne peut pas la crawler. Sans accès au fichier média, il n'a aucun snippet à afficher dans les onglets Images ou Vidéos — donc l'indexation échoue complètement. Le contenu n'apparaît nulle part.

Pourquoi robots.txt ne bloque-t-il pas l'indexation des pages web ?

Pour une page web standard, Google peut collecter l'URL via des liens externes même si le crawl est interdit. Il indexe alors l'URL avec un snippet minimal — souvent juste le titre récupéré depuis l'anchor text ou les métadonnées publiques. La page apparaît dans les SERP, juste sans description ni extrait.

Ce n'est pas un bug. C'est un choix technique : une URL est une information en soi, indépendante du contenu de la page. Google peut décider de la montrer même sans avoir accès au HTML.

Quelles sont les implications concrètes pour le contrôle de l'indexation ?

- Images et vidéos : robots.txt suffit pour les bloquer complètement de l'indexation dans leurs onglets respectifs

- Pages web et PDF : robots.txt empêche le crawl mais pas nécessairement l'apparition dans l'index — utilisez noindex pour un blocage garanti

- Cohérence stratégique : robots.txt et noindex répondent à deux objectifs différents (crawl vs indexation) — ne les confondez pas

- Cas particulier : une image/vidéo peut quand même apparaître sur le Web principal si elle est intégrée dans une page indexée avec structured data riche

Avis d'un expert SEO

Cette distinction est-elle cohérente avec les observations terrain ?

Oui, et c'est l'un des rares cas où la déclaration de Google colle parfaitement à la réalité. On observe régulièrement des URLs bloquées par robots.txt qui apparaissent dans les SERP avec un snippet vide ou générique. En revanche, une image bloquée dans robots.txt ne remonte jamais dans Google Images si elle est correctement interdite.

Le piège classique ? Bloquer une page sensible avec robots.txt en pensant qu'elle devient invisible. Elle reste indexable via ses backlinks, et Google affichera l'URL même sans description. Pour du contenu vraiment confidentiel, c'est insuffisant — il faut une authentification ou un noindex sur une page crawlable.

Quelles nuances faut-il apporter à cette règle ?

Gary simplifie volontairement, mais il y a des zones grises. Une image peut apparaître dans les résultats Web classiques si elle fait partie d'un rich snippet ou d'un Knowledge Panel — même si elle est bloquée dans robots.txt. L'index Images est isolé, mais les données structurées créent des passerelles. [À vérifier] dans quelle mesure ImageObject schema.org contourne ce blocage.

Autre nuance : les vidéos hébergées sur YouTube ou Vimeo échappent totalement à votre robots.txt. Vous contrôlez uniquement l'indexation de la page d'embed, pas celle de la vidéo sur la plateforme tierce. Ce n'est pas votre fichier robots.txt qui décide.

Dans quels cas cette logique pose-t-elle problème ?

Le vrai problème, c'est que beaucoup de sites bloquent par défaut des répertoires entiers (/wp-content/uploads/, /media/) sans réaliser qu'ils tuent leur visibilité Images. Ensuite, ils s'étonnent que leurs visuels n'apparaissent nulle part. Soyons honnêtes : robots.txt est un outil brutal qui ne pardonne pas l'approximation.

Impact pratique et recommandations

Que faut-il faire concrètement pour gérer images et vidéos ?

Si vous voulez que vos images et vidéos apparaissent dans les résultats Google, ne bloquez jamais leurs URLs dans robots.txt. Ça paraît évident, mais c'est l'erreur numéro un sur les sites refondus ou migrés — un disallow trop large qui aspire tout un répertoire /images/.

Pour contrôler l'indexation sans bloquer le crawl, utilisez plutôt X-Robots-Tag: noindex dans les en-têtes HTTP du fichier média. Ça marche pour images et vidéos, et ça vous laisse la possibilité de crawler sans indexer. Mais franchement, les cas où vous voulez ça sont rares.

Comment gérer les pages web qu'on veut vraiment exclure de l'index ?

Pour les pages sensibles, oubliez robots.txt comme méthode de désindexation. Servez une balise <meta name="robots" content="noindex"> sur une page crawlable. Google doit pouvoir lire la directive pour la respecter — et c'est là que ça coince.

Le paradoxe technique : si vous bloquez une page dans robots.txt ET que vous ajoutez noindex, Google ne peut pas crawler pour lire le noindex. Résultat ? L'URL reste potentiellement indexée. La seule solution propre : laissez crawler, servez noindex, attendez la désindexation, puis bloquez si besoin.

Quelles erreurs critiques éviter dans robots.txt ?

- Ne bloquez jamais vos fichiers CSS, JS ou images si vous voulez un rendu correct dans les SERP — Google a besoin de ces ressources pour évaluer la page

- Vérifiez que votre

Disallow: /images/ne massacre pas votre SEO Images — c'est réversible mais long à récupérer - N'utilisez pas robots.txt pour masquer du contenu dupliqué : Google l'indexera quand même via les liens externes, et vous perdez le contrôle de la canonicalisation

- Testez systématiquement vos modifications dans Search Console (outil Test robots.txt) avant de déployer — une virgule mal placée peut bloquer tout le site

- Auditez régulièrement les URLs bloquées qui apparaissent quand même dans l'index — signe que votre stratégie robots.txt/noindex est bancale

❓ Questions frequentes

Si je bloque une image dans robots.txt, peut-elle quand même apparaître dans les résultats Web classiques ?

Puis-je utiliser robots.txt pour empêcher l'indexation d'une page sensible ?

Que se passe-t-il si je bloque une page dans robots.txt ET que j'ajoute une balise noindex ?

Est-ce que bloquer /images/ dans robots.txt affecte mon référencement e-commerce ?

Comment vérifier que mes directives robots.txt fonctionnent correctement ?

🎥 De la même vidéo 13

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 30/06/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.