Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Google rend-il vraiment toutes les pages HTML indexables sans exception ?

- □ Googlebot suit-il vraiment Chrome en temps réel ?

- □ Les données structurées injectées en JavaScript sont-elles vraiment crawlées par Google ?

- □ Les redirections JavaScript sont-elles vraiment traitées comme des redirections serveur par Google ?

- □ Pourquoi le rendu Google ne sera jamais vraiment celui d'un navigateur standard ?

- □ Google conserve-t-il vraiment les cookies entre chaque rendu de page ?

- □ Pourquoi Google ignore-t-il les bannières de consentement des cookies lors du crawl ?

- □ Faut-il abandonner le dynamic rendering basé sur le user-agent de Googlebot ?

- □ Pourquoi la gestion d'erreurs JavaScript conditionne-t-elle désormais votre capacité à être indexé par Google ?

- □ L'outil d'inspection d'URL est-il vraiment fiable pour tester le rendu par Googlebot ?

- □ Pourquoi Google rend-il toutes les pages HTML même celles qui n'ont pas besoin de JavaScript ?

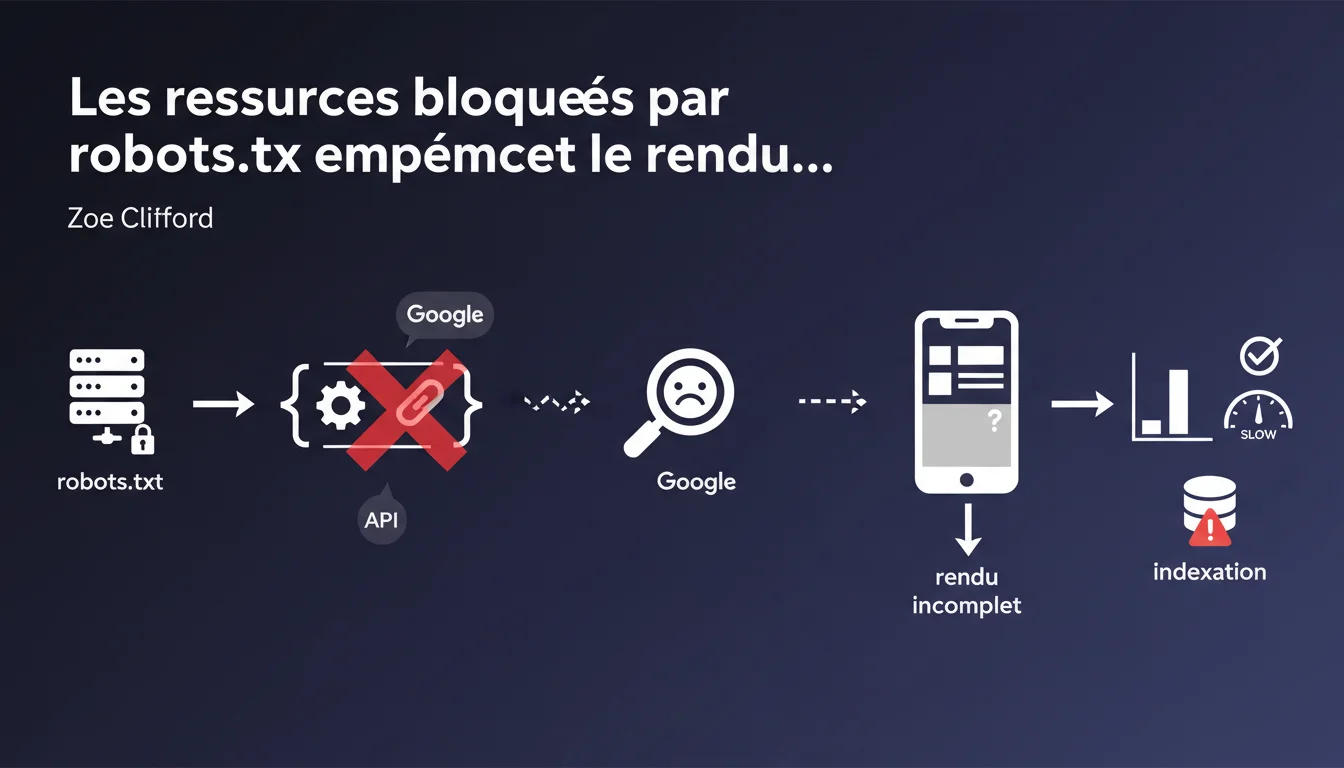

Google ne peut pas récupérer les ressources bloquées par robots.txt durant le rendu. Si ces ressources contiennent du contenu principal de la page, celle-ci apparaîtra incomplète et posera des problèmes d'indexation. Le blocage de ressources critiques via robots.txt compromet directement la capacité de Google à comprendre votre contenu.

Ce qu'il faut comprendre

Cette déclaration de Google rappelle un principe fondamental mais souvent mal appliqué : bloquer des ressources dans robots.txt empêche activement leur récupération durant la phase de rendu.

Contrairement à une idée reçue, le crawl et le rendu sont deux étapes distinctes. Robots.txt agit sur les deux.

Qu'est-ce que le rendu exactement et pourquoi est-ce important ?

Le rendu, c'est le moment où Googlebot exécute le JavaScript et construit la version finale de votre page — celle qu'un utilisateur verrait dans son navigateur. C'est à ce moment que le contenu dynamique apparaît.

Si une API ou un fichier JavaScript bloqué par robots.txt charge votre contenu principal, Google ne verra qu'une coquille vide. Pas de contenu = pas d'indexation pertinente.

Pourquoi bloquer des ressources peut sembler une bonne idée ?

Historiquement, certains praticiens bloquaient des ressources pour économiser le crawl budget ou protéger des fichiers sensibles. L'intention était bonne, mais l'impact est souvent désastreux.

Le problème : vous ne contrôlez pas toujours ce qui est vraiment essentiel au rendu. Une ressource tierce peut charger du contenu critique sans que vous le sachiez.

Quelles ressources sont réellement concernées par ce risque ?

Typiquement : fichiers JavaScript qui chargent du contenu via fetch ou XHR, appels API pour du contenu dynamique, certains CSS critiques qui révèlent du texte masqué initialement.

Les ressources purement décoratives (polices, icônes, certaines images) peuvent être bloquées sans impact majeur. Mais dès qu'une ressource participe à l'affichage du contenu textuel principal, c'est un risque.

- Robots.txt bloque la récupération des ressources durant le crawl ET le rendu

- Une page avec du contenu principal chargé en JS bloqué apparaîtra vide ou incomplète à Google

- Le risque concerne surtout les applications monopages (SPA) et les sites avec rendu côté client

- Bloquer des ressources décoratives reste acceptable, mais la frontière est floue

- Google ne devine pas ce qui est essentiel — il se base uniquement sur ce qu'il peut télécharger

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. On observe régulièrement des sites avec un contenu riche invisible pour Google à cause de blocages robots.txt mal calibrés. Search Console signale d'ailleurs ces cas via l'outil d'inspection d'URL.

Le piège classique : bloquer /wp-content/plugins/ ou /assets/js/ en pensant gagner du crawl budget. Résultat : des pages riches côté utilisateur mais vides côté Googlebot.

Quelles nuances faut-il apporter à cette recommandation ?

Google ne précise pas quel niveau d'incomplétude pose problème. Une page à 95% rendue correctement mais avec un widget bloqué passera probablement. Une page à 30% de contenu accessible sera ignorée.

[À vérifier] : Google ne donne pas de seuil quantitatif. L'impact dépend probablement du ratio contenu principal accessible / contenu total.

Autre nuance : certains types de contenu (commentaires, widgets sociaux, publicités) peuvent être bloqués sans impact SEO direct. Mais attention aux effets de bord — un script bloqué peut casser le rendu de toute la page.

Dans quels cas cette règle ne s'applique-t-elle pas vraiment ?

Si votre site utilise du rendu côté serveur (SSR) ou de la génération statique, le contenu HTML est déjà présent avant toute exécution JS. Dans ce cas, bloquer certaines ressources JS d'amélioration progressive pose moins de risques.

Les sites 100% HTML statique sans JavaScript critique ne sont évidemment pas concernés. Mais combien de sites correspondent encore à ce profil en pratique ?

Impact pratique et recommandations

Que faut-il faire concrètement pour sécuriser le rendu ?

Premier réflexe : auditer votre robots.txt ligne par ligne. Identifiez chaque Disallow et demandez-vous si cette ressource participe au rendu du contenu principal.

Utilisez l'outil d'inspection d'URL de Search Console pour vérifier le rendu réel de vos pages critiques. Comparez la capture d'écran Google avec ce que voit un utilisateur normal.

Si vous détectez des différences majeures, cherchez les ressources bloquées dans l'onglet "Ressources" de l'outil d'inspection. C'est là que Google liste ce qu'il n'a pas pu charger.

Quelles erreurs éviter absolument ?

Ne bloquez jamais /wp-content/, /assets/, /static/ de manière indiscriminée. Ces répertoires contiennent souvent du JavaScript et CSS critiques.

Évitez de bloquer les APIs internes que votre propre site appelle. Si votre site fait des fetch() vers /api/content/, ce endpoint doit être crawlable.

Méfiez-vous des plugins et thèmes qui ajoutent automatiquement des règles robots.txt. Certains bloquent trop large par défaut.

Comment vérifier que mon site est conforme ?

Mettez en place un monitoring régulier via Search Console. Vérifiez au moins mensuellement les pages clés avec l'outil d'inspection d'URL.

Testez en navigation privée avec JavaScript désactivé : si votre contenu principal disparaît complètement, vous avez un problème structurel qui va au-delà de robots.txt (rendu côté client pur).

- Auditer chaque ligne Disallow de votre robots.txt et justifier son existence

- Utiliser l'outil d'inspection d'URL sur vos pages stratégiques et comparer le rendu

- Vérifier l'onglet "Ressources" pour identifier les blocages problématiques

- Autoriser explicitement les répertoires contenant JS/CSS critiques (/assets/, /static/, etc.)

- Ne jamais bloquer les endpoints API appelés par votre propre site

- Mettre en place un monitoring mensuel du rendu de vos pages clés

- Documenter chaque blocage robots.txt avec une justification claire

- Privilégier le rendu côté serveur ou l'hydratation pour réduire la dépendance au JS

Le blocage de ressources via robots.txt est un levier puissant mais dangereux. Chaque ligne Disallow doit être justifiée et testée.

L'arbitrage entre optimisation du crawl budget et risque d'indexation incomplète demande une expertise technique pointue. Si votre architecture repose sur du rendu client lourd ou des APIs, l'audit devient complexe.

Face à ces enjeux techniques, de nombreux sites gagnent à s'appuyer sur une agence SEO spécialisée capable d'auditer finement le rendu et d'ajuster robots.txt sans casser l'indexation. L'accompagnement personnalisé permet d'éviter les erreurs coûteuses sur des optimisations aussi sensibles.

❓ Questions frequentes

Puis-je bloquer les fichiers CSS dans robots.txt sans risque ?

Le blocage robots.txt impacte-t-il uniquement le crawl ou aussi le rendu ?

Comment savoir quelles ressources Google n'a pas pu charger sur ma page ?

Est-ce que bloquer /wp-content/uploads/ pose problème pour l'indexation ?

Le rendu côté serveur (SSR) résout-il complètement ce problème ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 11/07/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.