Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Google rend-il vraiment toutes les pages HTML indexables sans exception ?

- □ Les données structurées injectées en JavaScript sont-elles vraiment crawlées par Google ?

- □ Les redirections JavaScript sont-elles vraiment traitées comme des redirections serveur par Google ?

- □ Pourquoi le rendu Google ne sera jamais vraiment celui d'un navigateur standard ?

- □ Faut-il vraiment débloquer toutes vos ressources dans robots.txt pour éviter les problèmes d'indexation ?

- □ Google conserve-t-il vraiment les cookies entre chaque rendu de page ?

- □ Pourquoi Google ignore-t-il les bannières de consentement des cookies lors du crawl ?

- □ Faut-il abandonner le dynamic rendering basé sur le user-agent de Googlebot ?

- □ Pourquoi la gestion d'erreurs JavaScript conditionne-t-elle désormais votre capacité à être indexé par Google ?

- □ L'outil d'inspection d'URL est-il vraiment fiable pour tester le rendu par Googlebot ?

- □ Pourquoi Google rend-il toutes les pages HTML même celles qui n'ont pas besoin de JavaScript ?

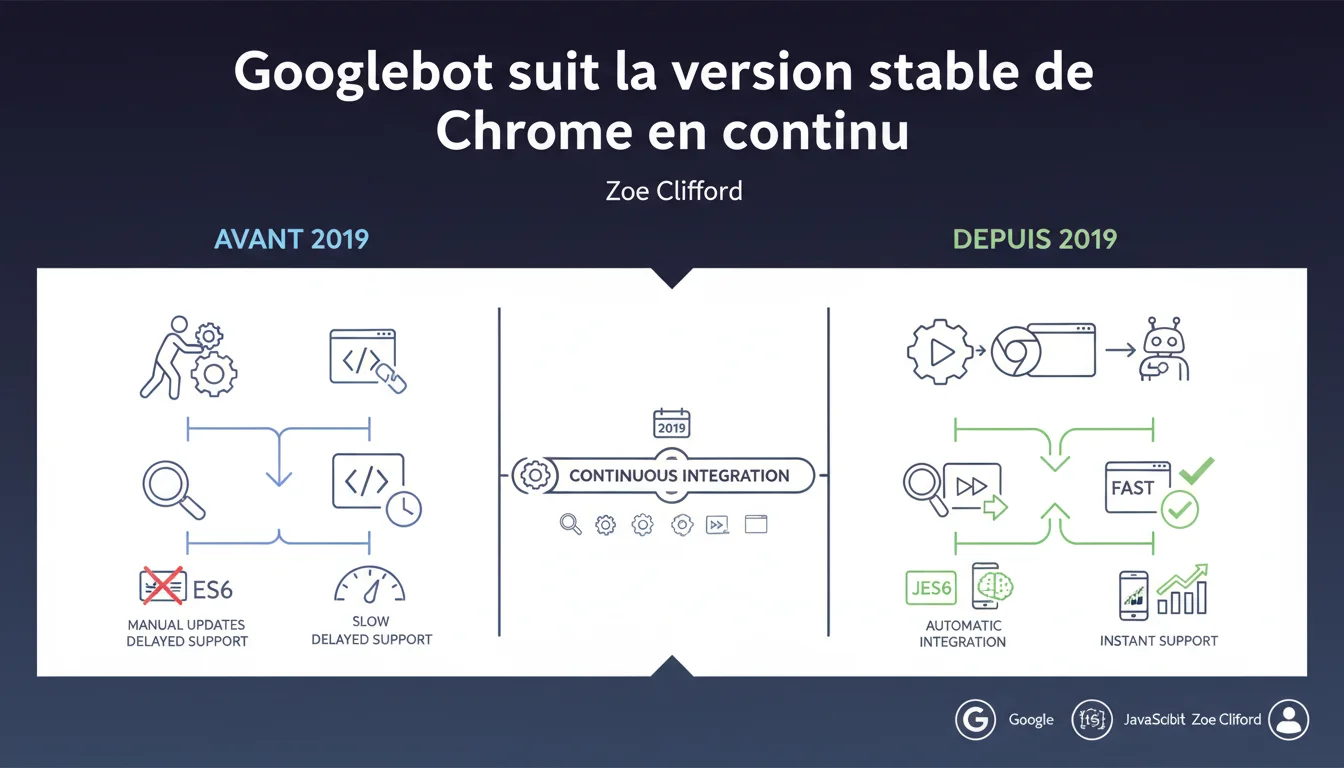

Googlebot suit automatiquement la version stable de Chromium depuis 2019 grâce à l'intégration continue. Fini le retard de plusieurs mois sur le support JavaScript : chaque nouvelle version de Chrome est désormais intégrée sans intervention manuelle. Concrètement, votre code ES6+ et vos frameworks modernes sont rendus comme dans un navigateur à jour.

Ce qu'il faut comprendre

Qu'est-ce que cela change par rapport à l'ancien fonctionnement ?

Avant 2019, les mises à jour de Googlebot étaient manuelles. Résultat : un décalage de plusieurs mois entre la sortie d'une nouvelle fonctionnalité JavaScript dans Chrome et son support par le crawler. Les sites utilisant ES6, Promises ou async/await se retrouvaient souvent avec du contenu invisible pour Google.

Depuis l'intégration continue, Googlebot suit la version stable de Chromium sans intervention humaine. Chaque nouvelle release de Chrome est automatiquement intégrée. Le crawler bénéficie donc des dernières optimisations, corrections de bugs et nouveaux standards web — exactement comme un utilisateur avec un navigateur à jour.

Cela signifie-t-il que tout le JavaScript moderne fonctionne ?

En théorie, oui. En pratique, il reste des nuances. Googlebot dispose désormais d'un moteur de rendu moderne, capable d'exécuter la majorité du JavaScript client-side sans broncher. Les frameworks comme React, Vue ou Angular sont généralement bien digérés.

Mais — et c'est là que ça coince — l'exécution du JavaScript consomme du crawl budget. Plus votre page nécessite de requêtes réseau, de calculs côté client ou d'interactions complexes, plus le rendu prend du temps. Et Google n'attend pas indéfiniment.

Quels étaient les principaux problèmes avec l'ancien système ?

- Retard technologique : Googlebot restait bloqué sur des versions obsolètes de Chrome, parfois avec 6 à 12 mois de décalage

- Support partiel d'ES6 : Les syntaxes modernes (arrow functions, classes, modules) n'étaient pas toujours interprétées correctement

- Bugs non corrigés : Les correctifs de sécurité et les patches de performance arrivaient avec un délai conséquent

- Tests complexes : Difficile de savoir quelle version de Chrome simuler pour reproduire le comportement de Googlebot

- Régression SEO imprévisible : Un site pouvait fonctionner parfaitement dans Chrome stable mais échouer au rendu côté Google

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Globalement, oui. Les tests avec Search Console et des outils de rendu montrent que Googlebot interprète correctement le JavaScript moderne. Les sites React ou Vue avec SSR léger, voire du pur CSR bien conçu, s'en sortent correctement dans la majorité des cas.

Mais il faut nuancer : l'intégration continue ne résout pas tous les problèmes. Le budget de rendu reste limité, et certains sites avec des chaînes de chargement complexes (lazy loading agressif, hydratation tardive, multiples requêtes API séquentielles) rencontrent encore des problèmes d'indexation. Google suit peut-être Chrome, mais avec un timeout beaucoup plus court qu'un utilisateur humain.

Quelles zones d'ombre subsistent dans cette annonce ?

Google ne précise pas combien de temps Googlebot attend avant de considérer qu'une page est « rendue ». On sait qu'il y a une phase initiale de crawl HTML, puis une file d'attente pour le rendu JavaScript — mais les délais exacts restent flous. [À vérifier] : est-ce que toutes les pages bénéficient du même budget, ou y a-t-il une priorisation basée sur l'autorité du site ?

Autre point évasif : le comportement face aux Single Page Applications (SPA). Google affirme que Googlebot gère les changements d'état JavaScript, mais en pratique, les navigations internes dans une SPA ne déclenchent pas toujours un nouveau rendu. Si votre routeur client ne pousse pas l'état dans l'historique ou ne met pas à jour les métadonnées, Google peut rater du contenu.

Dans quels cas cette évolution ne change rien ?

Si votre site repose sur du rendu côté serveur (SSR) ou de la génération statique, cette annonce ne vous concerne quasiment pas. Vous envoyiez déjà du HTML complet à Googlebot, donc peu importe la version de Chrome utilisée.

De même, les sites avec peu ou pas de JavaScript ne sont pas impactés. L'intégration continue profite surtout aux applications web modernes qui dépendent fortement du JS client-side pour afficher le contenu principal.

Impact pratique et recommandations

Que faut-il faire concrètement sur son site ?

Arrêtez de transpiler systématiquement vers ES5. Si vous ciblez encore des syntaxes pré-2015 « au cas où », vous pouvez désormais servir du JavaScript moderne (ES6+) directement à Googlebot. Cela réduit la taille des bundles et améliore les performances.

Vérifiez que votre contenu critique apparaît bien dans le rendu HTML initial ou au moins rapidement après l'exécution du JS. Utilisez l'outil d'inspection d'URL dans Search Console pour voir ce que Google capture réellement. Si des éléments manquent, c'est probablement un problème de timing, pas de compatibilité.

Quelles erreurs éviter maintenant que Googlebot suit Chrome ?

- Ne comptez pas uniquement sur le JavaScript pour le contenu principal — même si Googlebot le supporte, le délai de rendu peut poser problème

- Évitez les chaînes de requêtes API trop longues : chaque appel réseau rallonge le temps de rendu et consomme du crawl budget

- Ne présumez pas que Googlebot simule les interactions utilisateur : les contenus derrière un click, un scroll infini ou un hover restent invisibles

- Testez régulièrement avec Search Console : l'intégration continue signifie aussi que les comportements peuvent évoluer discrètement entre deux versions de Chrome

- Surveillez les Core Web Vitals : un JavaScript lourd dégrade l'expérience utilisateur ET peut ralentir l'indexation

Comment vérifier que mon site est bien crawlé ?

Le premier réflexe : Search Console, onglet « Inspection d'URL ». Comparez le HTML brut avec le rendu capturé par Google. Si des sections entières manquent, c'est que le JavaScript n'a pas eu le temps de s'exécuter ou qu'une erreur a bloqué le rendu.

Ensuite, analysez vos logs serveur. Googlebot fait deux passages : un pour le HTML brut, un second pour le rendu JavaScript. Si vous voyez un écart important entre les deux, ou si le second passage n'arrive jamais pour certaines pages, vous avez probablement un problème de crawl budget ou de timeout.

❓ Questions frequentes

Dois-je encore transpiler mon JavaScript en ES5 pour Googlebot ?

Est-ce que Googlebot exécute tous les frameworks JavaScript modernes ?

L'intégration continue signifie-t-elle que Googlebot se met à jour en même temps que Chrome ?

Les Single Page Applications sont-elles bien indexées maintenant ?

Comment vérifier que mon contenu JavaScript est bien capturé par Google ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 11/07/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.