Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Google rend-il vraiment toutes les pages HTML indexables sans exception ?

- □ Googlebot suit-il vraiment Chrome en temps réel ?

- □ Les données structurées injectées en JavaScript sont-elles vraiment crawlées par Google ?

- □ Les redirections JavaScript sont-elles vraiment traitées comme des redirections serveur par Google ?

- □ Pourquoi le rendu Google ne sera jamais vraiment celui d'un navigateur standard ?

- □ Faut-il vraiment débloquer toutes vos ressources dans robots.txt pour éviter les problèmes d'indexation ?

- □ Google conserve-t-il vraiment les cookies entre chaque rendu de page ?

- □ Pourquoi Google ignore-t-il les bannières de consentement des cookies lors du crawl ?

- □ Pourquoi la gestion d'erreurs JavaScript conditionne-t-elle désormais votre capacité à être indexé par Google ?

- □ L'outil d'inspection d'URL est-il vraiment fiable pour tester le rendu par Googlebot ?

- □ Pourquoi Google rend-il toutes les pages HTML même celles qui n'ont pas besoin de JavaScript ?

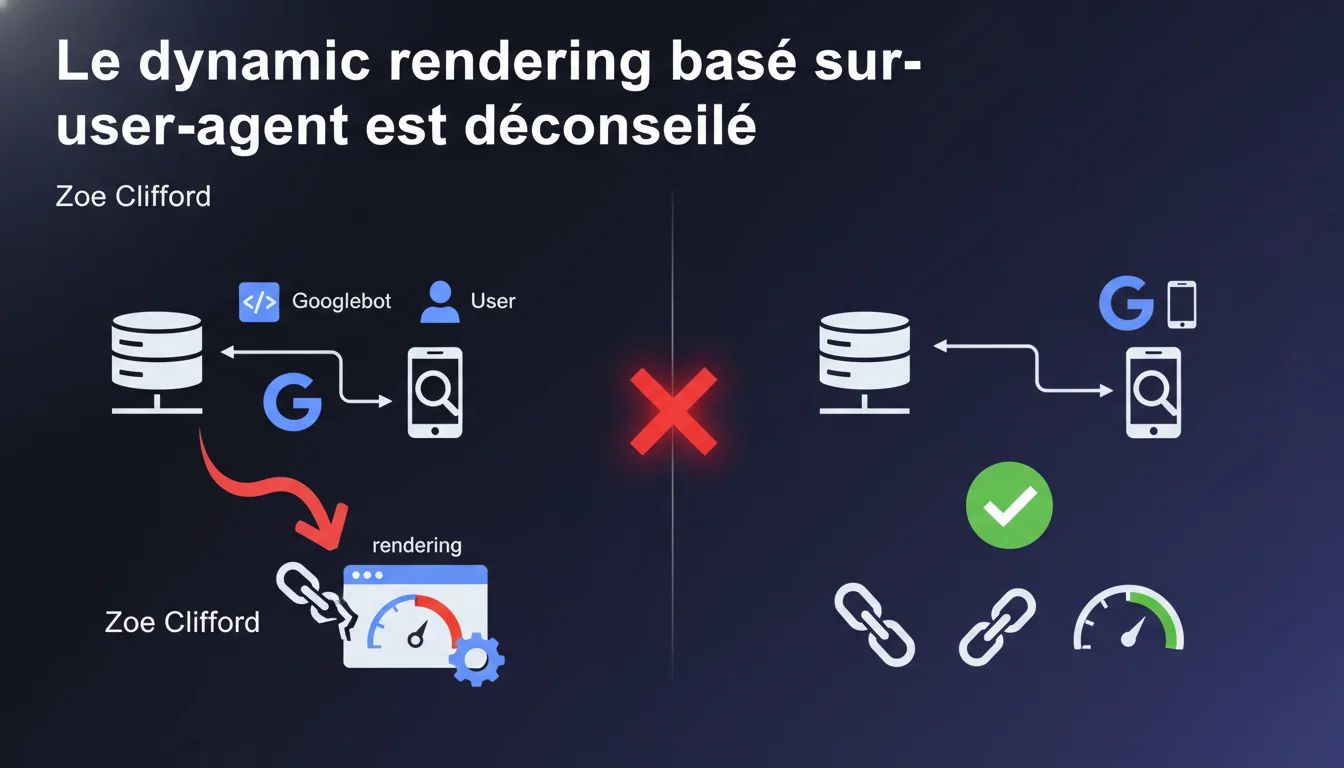

Google déconseille officiellement de servir un contenu différent à Googlebot en se basant sur son user-agent. Ces implémentations deviennent obsolètes au fil des mises à jour et risquent d'afficher du contenu cassé uniquement pour le bot. L'approche pose des problèmes de maintenance et de cohérence entre ce que voit Googlebot et les utilisateurs réels.

Ce qu'il faut comprendre

Pourquoi Google prend-il position contre le dynamic rendering basé sur user-agent ?

Le dynamic rendering consiste à servir une version différente d'une page selon le visiteur — typiquement, une version pré-rendue en HTML pour les bots, et du JavaScript côté client pour les utilisateurs. Pendant des années, Google a toléré cette pratique, notamment pour contourner les limites de son moteur de rendu JavaScript.

Aujourd'hui, la position change. Google signale que cibler spécifiquement Googlebot via son user-agent pose des risques : ces implémentations vieillissent mal, se cassent lors des mises à jour du bot, et créent des divergences entre ce que voit le crawler et ce que voient les utilisateurs.

Quelle est la différence avec le cloaking ?

Le cloaking consiste à servir du contenu trompeur aux moteurs de recherche — une violation claire des guidelines. Le dynamic rendering, lui, vise à faciliter le crawl et l'indexation sans manipuler les résultats.

Mais la frontière est mince. Si la version servie à Googlebot diverge trop de celle destinée aux utilisateurs, Google peut considérer cela comme du cloaking involontaire. La déclaration actuelle pousse les sites à converger vers une seule version pour tous.

Quelles sont les conséquences concrètes d'une implémentation obsolète ?

Googlebot évolue régulièrement : nouvelles capacités JavaScript, changements de user-agent, mise à jour de Chromium. Si votre dynamic rendering repose sur une détection stricte du user-agent, une mise à jour peut casser la logique de détection.

Résultat : Googlebot reçoit du contenu incomplet ou cassé, voire une erreur 500. Votre indexation se dégrade sans que vous ne compreniez pourquoi — surtout si vous ne testez jamais la version servie au bot.

- Google déconseille désormais de servir un contenu différent à Googlebot basé uniquement sur le user-agent

- Ces implémentations vieillissent mal et peuvent casser lors de mises à jour du bot

- Le risque principal : afficher du contenu incomplet ou cassé uniquement pour Googlebot, sans s'en rendre compte

- La frontière entre dynamic rendering légitime et cloaking involontaire devient floue

- Google pousse vers une convergence : une seule version pour bots et utilisateurs

Avis d'un expert SEO

Cette déclaration marque-t-elle vraiment un tournant ?

Soyons honnêtes : Google recommande depuis des années d'éviter le dynamic rendering quand c'est possible. Cette déclaration durcit le ton, mais ne sort pas de nulle part. Ce qui change, c'est l'affirmation explicite que cibler Googlebot via user-agent pose problème.

En pratique, beaucoup de sites utilisent encore cette méthode — notamment des plateformes e-commerce ou des SPAs complexes. La question n'est pas de savoir si Google aime cette approche, mais si votre implémentation résiste aux évolutions du bot. [A vérifier] : Google ne précise pas à quelle fréquence ces « problèmes » surviennent réellement, ni s'ils impactent le ranking ou juste l'indexation.

Dans quels cas cette règle ne s'applique-t-elle pas vraiment ?

Google ne bannit pas le dynamic rendering en bloc. Si vous servez une version pré-rendue à tous les bots (pas uniquement Googlebot), et que cette version est strictement équivalente à ce que voit un utilisateur, vous restez dans les clous.

Le problème surgit quand vous créez une logique spécifique pour Googlebot — par exemple, en servant uniquement à ce bot une version allégée, ou en ajoutant du contenu invisible pour les utilisateurs. Là, vous entrez dans une zone grise que Google commence à sanctionner.

Les observations terrain confirment-elles cette position ?

Oui et non. On observe effectivement des cas où Googlebot reçoit du contenu cassé à cause d'un dynamic rendering mal maintenu — notamment après des mises à jour majeures de Chromium. Mais quantifier l'ampleur du problème reste difficile.

Ce qui est certain : Google préfère que vous investissiez dans le server-side rendering (SSR) ou le static site generation (SSG) plutôt que dans une détection de bot. Ces approches éliminent la divergence à la source.

Impact pratique et recommandations

Que faut-il faire concrètement si vous utilisez du dynamic rendering ?

Première étape : auditez votre implémentation. Servez-vous exactement le même contenu à Googlebot et aux utilisateurs ? Testez avec l'outil d'inspection d'URL dans Search Console — comparez le rendu avec ce qu'affiche un navigateur classique.

Si vous détectez Googlebot via user-agent, listez tous les cas où la logique diverge. Demandez-vous si ces divergences sont justifiées ou si elles relèvent de solutions de facilité qui ont vieilli.

Quelles erreurs éviter absolument ?

Ne servez jamais à Googlebot un contenu que les utilisateurs ne voient pas — même si l'intention est de faciliter l'indexation. Google considère cela comme du cloaking, intentionnel ou non.

Évitez aussi de figer votre liste de user-agents. Si vous devez détecter des bots, utilisez une bibliothèque maintenue activement — et testez régulièrement que la détection fonctionne après chaque mise à jour.

Comment migrer vers une architecture plus robuste ?

L'idéal : server-side rendering (SSR) ou static site generation (SSG). Ces approches garantissent que tout le monde — bots et utilisateurs — reçoit du HTML pré-rendu. Plus de divergence, plus de risque de casser l'indexation.

Si vous ne pouvez pas migrer immédiatement, assurez-vous au minimum que votre JavaScript se rend correctement côté client pour tous les visiteurs. Testez avec des navigateurs classiques, sans dynamic rendering — si ça fonctionne, désactivez la détection de Googlebot.

- Testez le rendu Googlebot via l'outil d'inspection d'URL dans Search Console

- Comparez pixel par pixel avec ce qu'affiche un navigateur classique pour un utilisateur réel

- Listez toutes les divergences entre la version bot et la version utilisateur

- Si vous utilisez une liste de user-agents, vérifiez qu'elle est maintenue activement

- Privilégiez SSR ou SSG pour éliminer toute divergence à la source

- Si vous gardez du dynamic rendering, servez la même version à tous les bots — pas uniquement Googlebot

- Mettez en place une alerte automatique si le rendu Googlebot casse (monitoring Search Console API)

❓ Questions frequentes

Le dynamic rendering est-il complètement interdit par Google ?

Comment savoir si mon dynamic rendering pose problème ?

Quelle est la meilleure alternative au dynamic rendering basé sur user-agent ?

Si je désactive mon dynamic rendering, est-ce que Googlebot saura indexer mon JavaScript ?

Cette déclaration impacte-t-elle le ranking ou uniquement l'indexation ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 11/07/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.