Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Google rend-il vraiment toutes les pages HTML indexables sans exception ?

- □ Googlebot suit-il vraiment Chrome en temps réel ?

- □ Les données structurées injectées en JavaScript sont-elles vraiment crawlées par Google ?

- □ Les redirections JavaScript sont-elles vraiment traitées comme des redirections serveur par Google ?

- □ Pourquoi le rendu Google ne sera jamais vraiment celui d'un navigateur standard ?

- □ Faut-il vraiment débloquer toutes vos ressources dans robots.txt pour éviter les problèmes d'indexation ?

- □ Google conserve-t-il vraiment les cookies entre chaque rendu de page ?

- □ Pourquoi Google ignore-t-il les bannières de consentement des cookies lors du crawl ?

- □ Faut-il abandonner le dynamic rendering basé sur le user-agent de Googlebot ?

- □ Pourquoi la gestion d'erreurs JavaScript conditionne-t-elle désormais votre capacité à être indexé par Google ?

- □ L'outil d'inspection d'URL est-il vraiment fiable pour tester le rendu par Googlebot ?

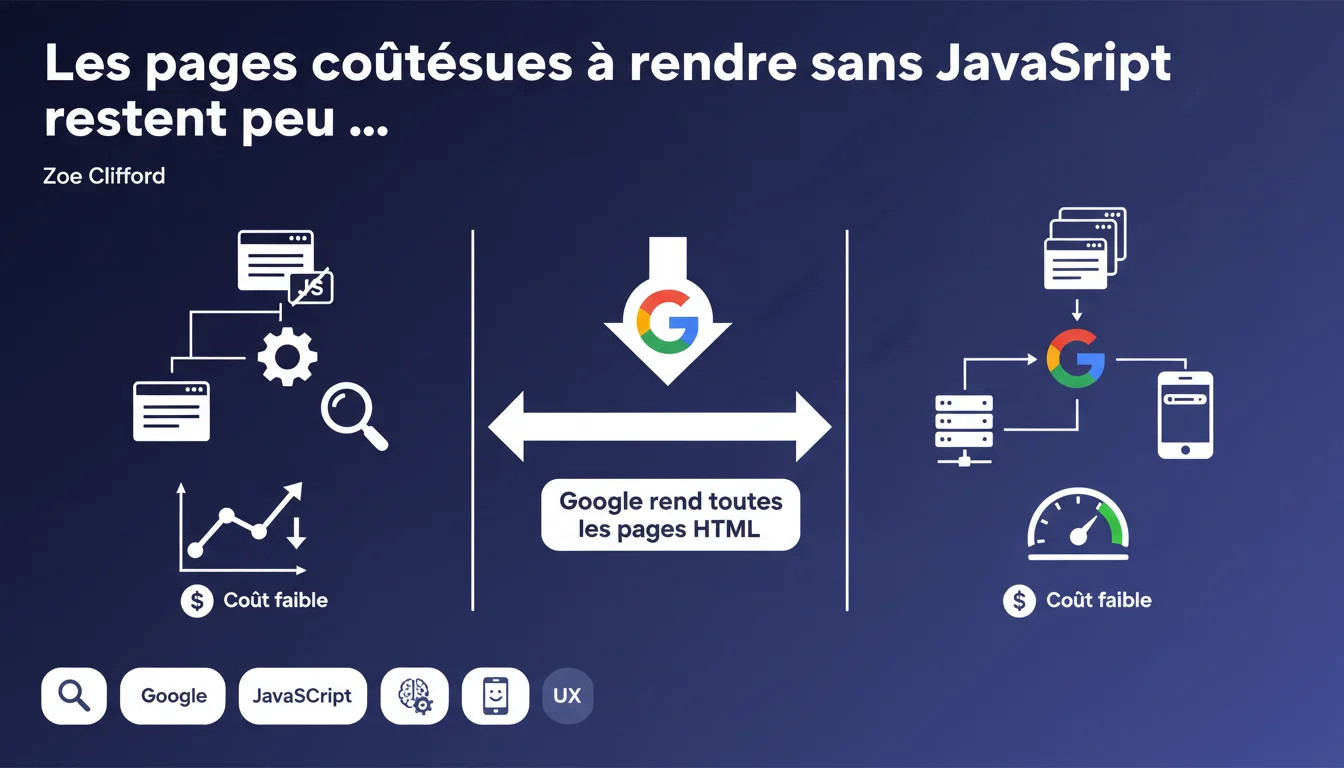

Google rend systématiquement toutes les pages HTML, y compris celles qui n'utilisent pas JavaScript. Le coût en ressources reste faible pour les pages purement HTML, ce qui justifie cette approche généralisée plutôt qu'un tri préalable.

Ce qu'il faut comprendre

Qu'entend Google par "pages peu coûteuses à rendre" ?

Le rendu des pages consomme des ressources serveur chez Google — CPU, mémoire, temps de traitement. Une page HTML statique, sans JavaScript à exécuter, reste très légère à traiter pour Googlebot.

Google précise que même si son infrastructure doit techniquement "rendre" toutes les pages, celles qui n'exigent pas d'exécution JavaScript ne mobilisent qu'une fraction des ressources. Le coût de traitement est si bas qu'il devient négligeable à l'échelle de l'indexation.

Pourquoi Google ne filtre-t-il pas en amont les pages sans JavaScript ?

Googlebot pourrait théoriquement détecter l'absence de scripts avant le rendu et court-circuiter l'étape. Mais cette détection préalable introduirait elle-même une complexité technique et des risques d'erreur.

En rendant systématiquement toutes les pages, Google simplifie son pipeline d'indexation. Le surcoût pour les pages HTML simples est si faible que l'optimisation ne vaut pas la peine. C'est une question d'architecture : mieux vaut un processus uniforme qu'un tri préalable incertain.

Quelle distinction entre rendu côté client et côté serveur ?

Les pages qui génèrent leur contenu via JavaScript côté client (SPA, frameworks modernes) imposent à Google d'exécuter ce code pour accéder au DOM final. C'est là que le rendu devient coûteux — attente, exécution, stabilisation.

À l'inverse, une page HTML traditionnelle ou rendue côté serveur (SSR) livre son contenu directement. Google n'a qu'à parser le HTML, sans déclencher de moteur JavaScript. Le coût reste minimal.

- Le rendu consomme des ressources chez Google, mais pas uniformément selon les technologies utilisées

- Les pages HTML statiques ou SSR restent très peu coûteuses même dans un pipeline de rendu généralisé

- Google privilégie la simplicité opérationnelle en rendant toutes les pages plutôt qu'en filtrant

- La vraie distinction de coût se situe entre pages nécessitant JavaScript et pages purement HTML

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui. Les sites en HTML statique ou SSR n'ont jamais rencontré de problèmes d'indexation liés au budget de rendu. Les délais d'apparition dans l'index restent courts, les pages sont crawlées régulièrement.

Les sites full JavaScript, eux, subissent parfois des décalages entre crawl et indexation — le rendu différé crée un goulot d'étranglement. Cette asymétrie confirme que Google traite différemment les deux catégories, même si techniquement il "rend" tout.

Quelles nuances faut-il apporter à cette affirmation ?

La déclaration reste volontairement vague sur le seuil exact de "coût faible". Google ne quantifie pas : combien de millisecondes ? Quelle consommation CPU ? À partir de combien de scripts une page devient-elle "coûteuse" ?

[À vérifier] : la notion de "peu coûteux" est relative à l'infrastructure Google, pas à votre serveur. Une page lourde en DOM (50 000 nœuds) mais sans JS reste "peu coûteuse" pour Google, même si elle met vos serveurs à genoux. Ne confondez pas les deux.

Autre point — cette déclaration ne dit rien sur la priorisation. Google rend toutes les pages, certes, mais à quelle fréquence ? Les pages JS passent-elles après les autres dans la file d'attente ? Le silence sur ce point est éloquent.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Si votre HTML contient des scripts inline massifs ou des balises <script> chargeant des dizaines de fichiers, vous sortez du cadre "peu coûteux". Le volume de ressources externes à télécharger peut faire basculer le coût.

Les Progressive Web Apps (PWA) avec service workers complexes, les sites avec lazy loading agressif déclenchant du JS au scroll — tout ça consomme. Google peut techniquement les rendre, mais le coût grimpe vite.

Impact pratique et recommandations

Que faut-il faire concrètement si votre site utilise beaucoup de JavaScript ?

Privilégiez le Server-Side Rendering (SSR) ou la génération statique pour les contenus critiques : pages produits, catégories, articles. Vous réduisez la dépendance au rendu côté client et facilitez l'indexation.

Si vous restez en full client-side, assurez-vous que votre contenu principal soit accessible dans le HTML initial — même vide au début — plutôt que généré 100% par JS après chargement. Google peut attendre quelques secondes, pas indéfiniment.

Quelles erreurs éviter pour ne pas surcharger le budget de rendu ?

Ne multipliez pas les couches de JS inutiles. Un CMS WordPress avec 40 plugins chargeant chacun leurs scripts en footer, ça alourdit le rendu même si la page semble "statique". Auditez vos dépendances.

Évitez les SPAs mono-page où chaque navigation client-side nécessite un nouveau cycle de rendu complet. Google doit re-exécuter tout le JS à chaque URL — le coût explose. Découpez en vraies pages HTML distinctes quand c'est possible.

Comment vérifier que votre site reste dans la zone "peu coûteuse" ?

- Testez vos pages clés avec l'outil d'inspection d'URL dans Search Console — vérifiez que le rendu aboutit et affiche le contenu attendu

- Comparez le DOM HTML brut (view source) au DOM rendu (DevTools) : si 80%+ du contenu est déjà dans le HTML brut, vous êtes bon

- Mesurez le temps de rendu dans Puppeteer ou un outil similaire : visez < 3 secondes pour atteindre un état stable

- Surveillez les logs de crawl pour détecter d'éventuels délais ou abandons de rendu (erreurs timeout)

- Utilisez des frameworks modernes avec SSR intégré (Next.js, Nuxt, SvelteKit) plutôt que du pur React/Vue client-side

❓ Questions frequentes

Google rend-il vraiment toutes les pages, même celles sans JavaScript ?

Une page HTML statique est-elle indexée plus vite qu'une SPA ?

Le Server-Side Rendering (SSR) élimine-t-il tous les problèmes de rendu côté Google ?

Dois-je abandonner les frameworks JavaScript pour améliorer mon SEO ?

Comment savoir si mon site dépasse le seuil "peu coûteux" de Google ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 11/07/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.