Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Le fichier robots.txt empêche-t-il réellement l'indexation de vos pages ?

- □ Votre outil de test SEO est-il vraiment un crawler aux yeux de Google ?

- □ Googlebot suit-il vraiment les liens ou fonctionne-t-il autrement ?

- □ Pourquoi Google abandonne-t-il les directives d'indexation dans robots.txt ?

- □ Publier un site web équivaut-il juridiquement à autoriser Google à le crawler ?

- □ Comment Googlebot ajuste-t-il sa fréquence de crawl pour ne pas faire planter vos serveurs ?

- □ Peut-on indexer une page sans la crawler ?

- □ Pourquoi Google refuse-t-il des directives robots.txt trop granulaires ?

- □ Le robots.txt est-il vraiment suffisant pour contrôler le crawl de votre site ?

- □ Qui a vraiment créé le parser robots.txt de Google ?

- □ Pourquoi Google refuse-t-il catégoriquement de moderniser le format robots.txt ?

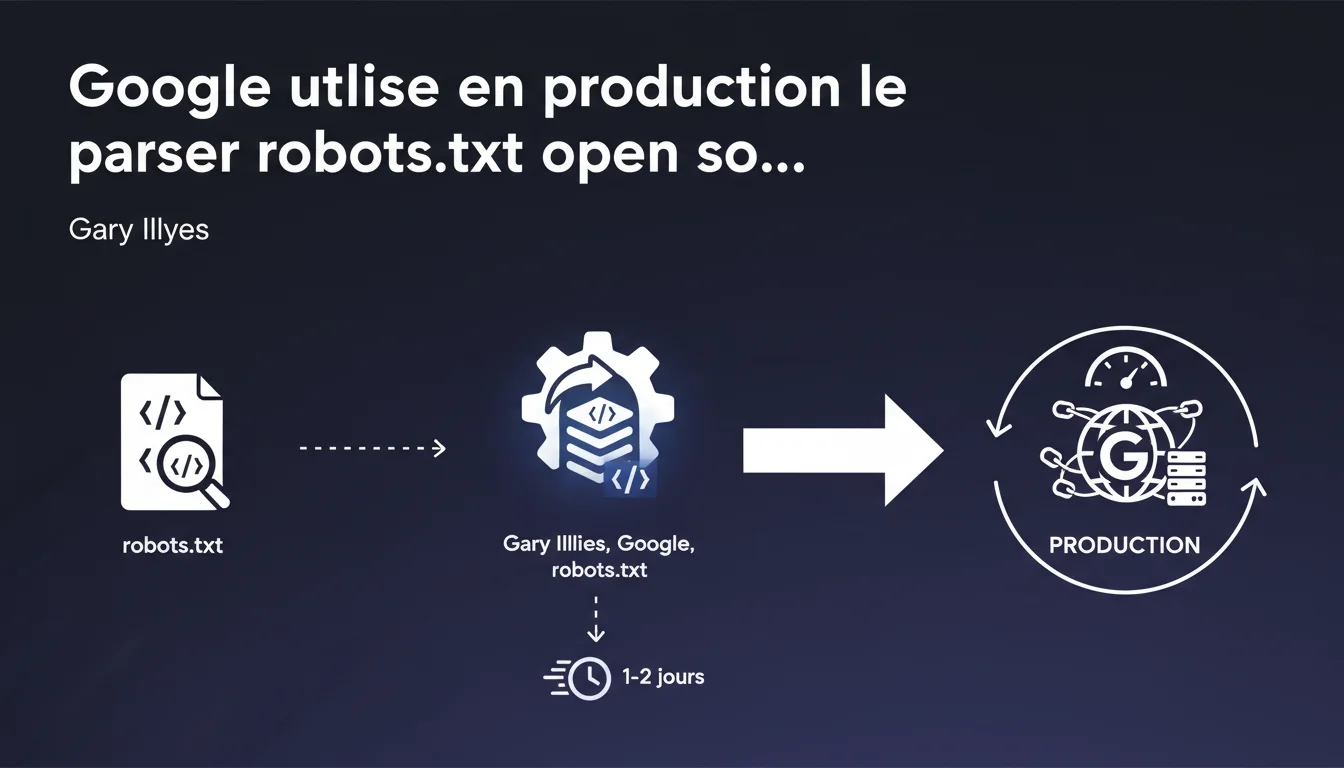

Google confirme que le parser robots.txt qu'il a rendu open source est exactement le même code qui tourne en production. Les modifications apportées au dépôt GitHub sont déployées en production sous 1 à 2 jours. C'est un niveau de transparence inhabituel qui permet d'anticiper les changements de comportement du crawler.

Ce qu'il faut comprendre

Pourquoi Google a-t-il rendu son parser robots.txt open source ?

Google a publié le code source de son parser robots.txt sur GitHub pour favoriser la standardisation. Pendant des années, chaque moteur interprétait le fichier robots.txt à sa manière, créant des incohérences.

En rendant son code public, Google a permis aux développeurs de tester localement comment Googlebot interprétera leurs directives. C'est aussi un signal fort envoyé à l'industrie : voici comment nous faisons, alignez-vous si vous voulez de la cohérence.

Que signifie concrètement "le même code en production" ?

Gary Illyes affirme que ce n'est pas une version simplifiée ou édulcorée. C'est le code exact qui analyse les fichiers robots.txt de millions de sites chaque jour. Quand Googlebot rencontre un robots.txt, il passe par ce parser.

Les modifications validées dans le dépôt GitHub sont déployées en production en 1 à 2 jours. Ça veut dire qu'on peut suivre les évolutions du comportement de Google en surveillant les commits. C'est du jamais vu en termes de transparence.

Quels sont les éléments essentiels à retenir ?

- Le parser open source n'est pas une démo — c'est le code réel de production

- Les mises à jour du code sont déployées sous 1 à 2 jours après validation

- On peut anticiper les changements de comportement en surveillant le repo GitHub

- Les développeurs peuvent tester localement comment Googlebot interprétera leur robots.txt

- C'est un pas vers la standardisation de l'interprétation du protocole robots.txt

Avis d'un expert SEO

Cette transparence est-elle cohérente avec les pratiques observées sur le terrain ?

Oui, et c'est justement ce qui rend cette déclaration crédible. Depuis la publication du code, plusieurs développeurs ont comparé le comportement observé de Googlebot avec les règles définies dans le parser. Les résultats concordent.

Cette cohérence n'est pas anodine. Google aurait pu publier un parser "marketing" qui ressemble au vrai sans l'être. Le fait que le code soit effectivement utilisé en production change la donne pour les tests et la prédictibilité.

Quelles nuances faut-il apporter à cette déclaration ?

Le parser robots.txt est un composant parmi d'autres dans le système de crawl de Google. Il détermine ce que Googlebot a le droit de crawler, mais pas ce qu'il va effectivement crawler ni quand.

Les décisions de crawl budget, de priorisation, de fréquence de passage — tout ça reste opaque. Le parser dit "autorisé" ou "bloqué", point. Le reste de la machinerie de crawl n'est pas open source.

Peut-on vraiment se fier au délai de déploiement annoncé ?

Le délai de 1 à 2 jours entre commit et production est plausible techniquement — c'est un cycle de CI/CD classique pour du code critique. Mais cette rapidité implique aussi que des bugs peuvent arriver en production vite.

Surveiller le repo GitHub devient donc pertinent. Si une modification majeure est poussée, tu peux anticiper qu'elle sera active sous 48h. Ça permet de détecter d'éventuelles régressions avant qu'elles n'impactent ton crawl.

Impact pratique et recommandations

Que faut-il faire concrètement avec cette information ?

D'abord, installer le parser localement si tu gères des sites avec des règles robots.txt complexes. Le dépôt GitHub fournit un outil en ligne de commande qui te permet de tester tes directives avant de les pousser en production.

Ensuite, configure une surveillance du repo GitHub. Les modifications du parser peuvent révéler des changements de comportement avant qu'ils ne soient documentés officiellement. C'est un avantage stratégique pour anticiper.

Quelles erreurs éviter avec le fichier robots.txt ?

Ne pas confondre robots.txt et gestion de l'indexation. Le robots.txt bloque le crawl, pas l'indexation. Si une URL est bloquée dans robots.txt mais possède des backlinks, Google peut quand même l'indexer sans la crawler.

Évite les patterns trop complexes. Le parser supporte les wildcards (*) et les end-of-path ($), mais plus tes règles sont alambiquées, plus le risque d'erreur augmente. Teste systématiquement avec le parser avant de déployer.

Comment vérifier que mon robots.txt est correctement interprété ?

- Utilise l'outil de test robots.txt dans Google Search Console

- Clone le parser GitHub et teste localement tes règles complexes

- Compare le comportement observé dans les logs avec les directives définies

- Vérifie que les directives critiques (admin, zones sensibles) sont bien appliquées

- Surveille les commits du repo GitHub pour détecter les évolutions futures

❓ Questions frequentes

Le parser open source est-il vraiment identique au code de production de Google ?

Puis-je utiliser ce parser pour tester mon robots.txt avant de le déployer ?

Si je surveille le repo GitHub, puis-je anticiper les changements de comportement de Googlebot ?

Le robots.txt bloque-t-il l'indexation ou seulement le crawl ?

Quels sont les risques d'une règle robots.txt mal configurée ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 21/12/2021

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.