Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Le fichier robots.txt empêche-t-il réellement l'indexation de vos pages ?

- □ Votre outil de test SEO est-il vraiment un crawler aux yeux de Google ?

- □ Googlebot suit-il vraiment les liens ou fonctionne-t-il autrement ?

- □ Le parser robots.txt open source de Google est-il vraiment utilisé en production ?

- □ Pourquoi Google abandonne-t-il les directives d'indexation dans robots.txt ?

- □ Publier un site web équivaut-il juridiquement à autoriser Google à le crawler ?

- □ Comment Googlebot ajuste-t-il sa fréquence de crawl pour ne pas faire planter vos serveurs ?

- □ Peut-on indexer une page sans la crawler ?

- □ Pourquoi Google refuse-t-il des directives robots.txt trop granulaires ?

- □ Le robots.txt est-il vraiment suffisant pour contrôler le crawl de votre site ?

- □ Pourquoi Google refuse-t-il catégoriquement de moderniser le format robots.txt ?

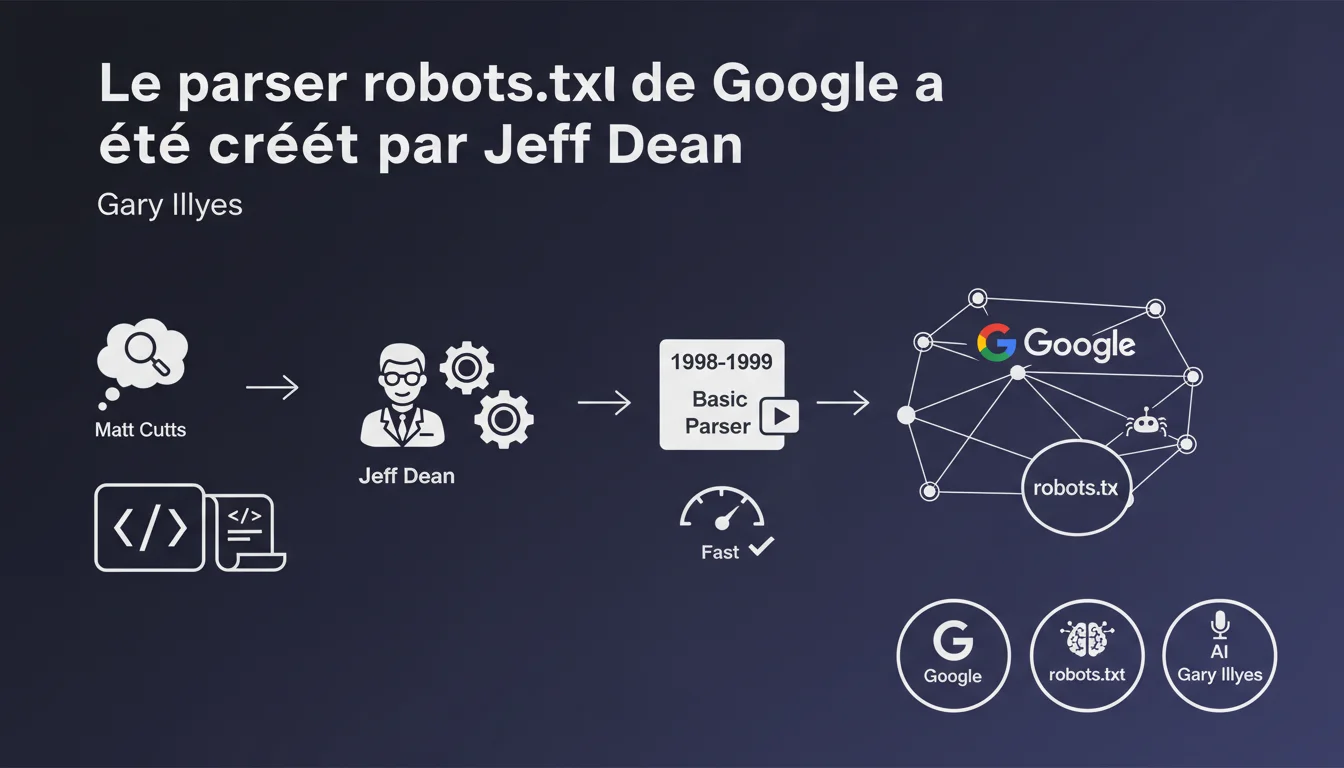

Jeff Dean a écrit le parser robots.txt de Google en 1998-1999, suite à la proposition de Matt Cutts d'intégrer le protocole. Le code initial était minimaliste, avec seulement quelques lignes. Cette révélation illustre la genèse technique d'un composant fondamental du crawl moderne.

Ce qu'il faut comprendre

Pourquoi cette révélation historique compte-t-elle encore ?

Le parser robots.txt est le premier rempart entre un site et les robots de Google. Savoir qu'il a été conçu par Jeff Dean — figure mythique du génie logiciel chez Google — avec un code initial très simple, rappelle un principe clé : l'efficacité prime sur la complexité.

Matt Cutts a proposé l'idée d'implémenter le protocole robots.txt, que Google a ensuite adopté. Le fichier robots.txt est devenu le mécanisme standard pour contrôler l'accès des crawlers aux ressources d'un site.

Qu'est-ce que cela révèle sur l'évolution du crawler Google ?

Le parser initial tenait en quelques lignes de code. Aujourd'hui, le système de crawl de Google est un écosystème complexe qui gère des milliards de pages, des règles conditionnelles, des patterns avancés.

Cette simplicité originelle explique pourquoi certains comportements du parser semblent parfois rigides : les bases posées en 1998-1999 ont influencé l'architecture actuelle, même après de nombreuses itérations.

Le protocole robots.txt est-il toujours pertinent aujourd'hui ?

Absolument. Malgré son ancienneté, le robots.txt reste le premier fichier consulté par Googlebot avant tout crawl. Mal configuré, il peut bloquer l'indexation de sections entières d'un site — erreur fréquente en production.

Google a d'ailleurs ouvert le code source de son parser en 2019, standardisant ainsi les comportements et permettant aux développeurs de tester leurs configurations localement.

- Jeff Dean a codé le parser robots.txt originel entre 1998 et 1999

- Le code initial était très basique, avec seulement quelques lignes

- Matt Cutts a proposé l'intégration du protocole robots.txt chez Google

- Le parser a évolué mais conserve une architecture héritée de cette conception initiale

- Google a ouvert le code source du parser en 2019, standardisant les implémentations

Avis d'un expert SEO

Cette déclaration apporte-t-elle de la valeur technique ?

Honnêtement, c'est une anecdote historique plus qu'une révélation stratégique. Savoir qui a écrit le code initial ne change rien à la manière dont on doit configurer un robots.txt aujourd'hui.

En revanche, cela confirme un point souvent sous-estimé : les fondations de Google reposent sur des choix d'ingénierie simples. Pas de sur-optimisation. Ce qui compte, c'est que le parser fonctionne de manière prévisible et rapide.

Le parser actuel est-il toujours aussi basique ?

Évidemment non. [A vérifier] Mais il serait intéressant de savoir combien de lignes fait le parser moderne. Les SEO rencontrent régulièrement des comportements subtils : gestion des wildcards, interprétation des allow/disallow contradictoires, respect partiel de certaines directives non-standard (crawl-delay par exemple).

Le fait que le code initial ait été minimal suggère que certaines limitations actuelles ne sont pas des bugs, mais des choix d'architecture hérités. Google a toujours privilégié la vitesse d'exécution à la flexibilité syntaxique.

Faut-il s'inquiéter de la simplicité originelle ?

Non. La robustesse d'un système ne dépend pas de sa complexité initiale. Le parser robots.txt a prouvé sa fiabilité sur plus de deux décennies — c'est ce qui compte.

Là où ça coince parfois, c'est quand des SEO tentent d'utiliser des patterns exotiques non documentés. Le parser Google suit le standard REP (Robots Exclusion Protocol), et tout ce qui sort de ce cadre relève du comportement non garanti.

Impact pratique et recommandations

Que faut-il faire concrètement avec son robots.txt ?

Gardez-le simple et explicite. Pas de patterns alambiqués qui pourraient être mal interprétés. Testez chaque modification dans Google Search Console avant de déployer en production.

Évitez de bloquer des ressources critiques (CSS, JS) sauf si vous savez exactement ce que vous faites. Google a explicitement recommandé de ne pas bloquer les assets nécessaires au rendu des pages.

Quelles erreurs éviter absolument ?

Bloquer accidentellement tout le site via un Disallow: / mal placé — ça arrive plus souvent qu'on ne le pense, surtout après une migration ou un changement de CMS.

Utiliser le robots.txt pour masquer du contenu sensible. Ce fichier est public, lisible par n'importe qui. Il indique même parfois aux malveillants où chercher. Pour du contenu privé, utilisez une authentification serveur ou des meta robots noindex.

Comment vérifier que tout fonctionne correctement ?

Utilisez l'outil de test robots.txt dans Google Search Console. Il vous montre exactement comment Googlebot interprète votre fichier, URL par URL.

Vérifiez régulièrement les rapports de couverture pour détecter des blocages involontaires. Un pic soudain de pages exclues par robots.txt signale souvent une erreur de configuration.

- Testez chaque modification du robots.txt dans Google Search Console avant déploiement

- Ne bloquez jamais CSS et JavaScript nécessaires au rendu

- Surveillez les rapports de couverture pour détecter les blocages involontaires

- N'utilisez pas robots.txt pour masquer du contenu sensible — fichier public

- Privilégiez la simplicité : moins de lignes = moins de risques d'erreur

- Documentez chaque directive non-standard pour comprendre son impact futur

- Vérifiez la syntaxe avec des validateurs conformes au standard REP

Le robots.txt reste un outil essentiel du contrôle de crawl, mais sa gestion demande rigueur et vigilance. Une erreur de configuration peut coûter cher en visibilité organique.

Pour les sites complexes ou les architectures multi-domaines, l'optimisation fine du crawl budget et la gestion stratégique du robots.txt nécessitent une expertise approfondie. Un accompagnement par une agence SEO spécialisée permet d'éviter les pièges courants et d'implémenter des stratégies de crawl adaptées à votre contexte technique.

❓ Questions frequentes

Qui a proposé l'intégration du protocole robots.txt chez Google ?

Le code du parser robots.txt de Google est-il toujours aussi simple ?

Google a-t-il rendu public son parser robots.txt ?

Peut-on bloquer des ressources CSS/JS via robots.txt ?

Comment tester son fichier robots.txt avant de le mettre en production ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 21/12/2021

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.