Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Le fichier robots.txt empêche-t-il réellement l'indexation de vos pages ?

- □ Googlebot suit-il vraiment les liens ou fonctionne-t-il autrement ?

- □ Le parser robots.txt open source de Google est-il vraiment utilisé en production ?

- □ Pourquoi Google abandonne-t-il les directives d'indexation dans robots.txt ?

- □ Publier un site web équivaut-il juridiquement à autoriser Google à le crawler ?

- □ Comment Googlebot ajuste-t-il sa fréquence de crawl pour ne pas faire planter vos serveurs ?

- □ Peut-on indexer une page sans la crawler ?

- □ Pourquoi Google refuse-t-il des directives robots.txt trop granulaires ?

- □ Le robots.txt est-il vraiment suffisant pour contrôler le crawl de votre site ?

- □ Qui a vraiment créé le parser robots.txt de Google ?

- □ Pourquoi Google refuse-t-il catégoriquement de moderniser le format robots.txt ?

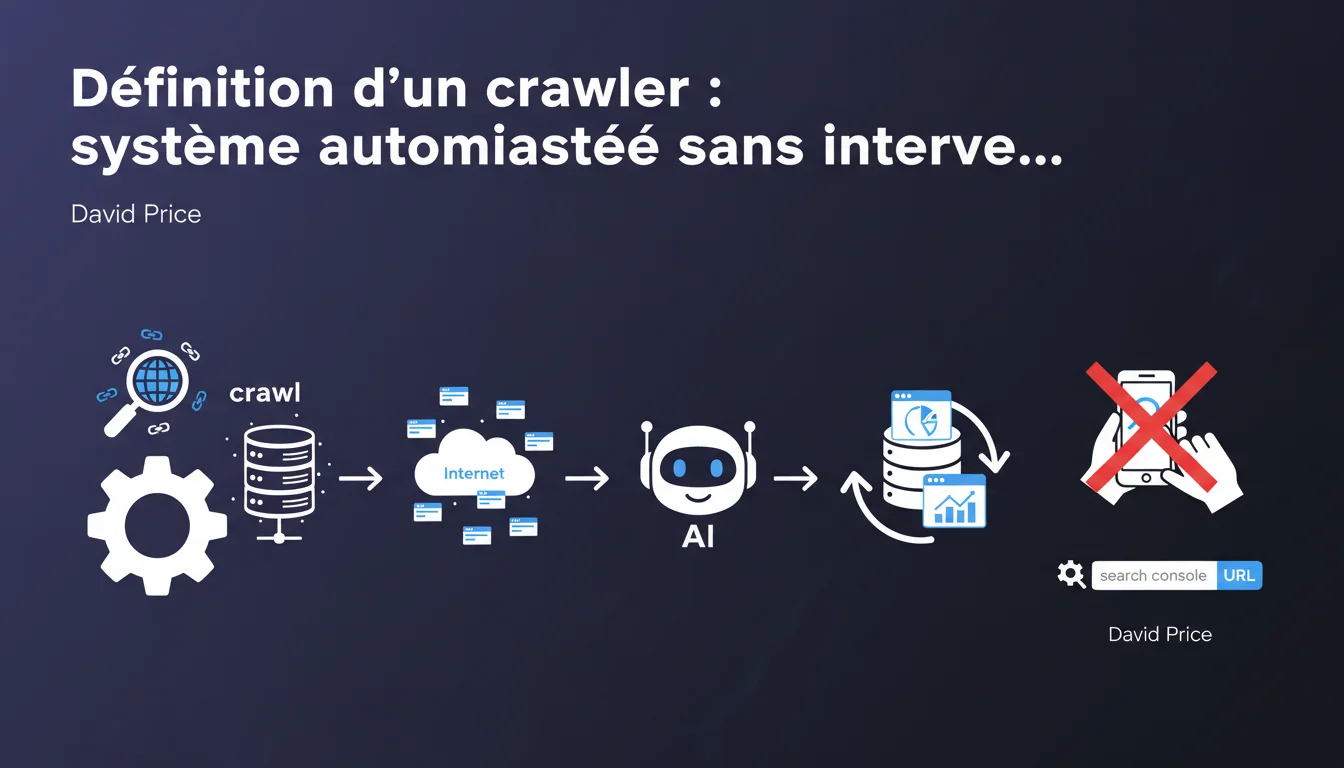

Google définit un crawler comme un système entièrement automatisé qui accède aux pages sans intervention humaine. Les outils où un utilisateur déclenche manuellement une action — comme l'inspecteur d'URL de Search Console — ne sont pas considérés comme des crawlers classiques. Cette distinction technique a des implications concrètes sur la façon dont Google traite les requêtes de ces différents systèmes.

Ce qu'il faut comprendre

Quelle est la vraie définition d'un crawler selon Google ?

Google pose une distinction claire : un crawler authentique fonctionne de manière totalement automatisée, sans qu'un humain ait besoin d'intervenir à chaque requête. Googlebot, par exemple, parcourt le web en suivant des liens, en respectant son propre calendrier de crawl, sans qu'aucun employé Google n'appuie sur un bouton pour chaque URL.

À l'inverse, un outil comme l'inspecteur d'URL de Search Console nécessite qu'un utilisateur saisisse manuellement une adresse et déclenche une vérification. C'est un outil d'inspection, pas un crawler au sens strict. Cette nuance peut sembler purement sémantique — elle ne l'est pas.

Pourquoi cette distinction technique est-elle importante pour le SEO ?

Parce qu'elle influence la manière dont Google traite vos requêtes et priorise ses ressources. Un crawler automatisé comme Googlebot suit une logique de budget de crawl, optimise ses visites selon la fraîcheur perçue du contenu, la qualité du site, la vitesse de réponse du serveur.

Un outil manuel comme l'inspecteur d'URL, lui, génère une requête à la demande, immédiate, qui ne reflète pas forcément l'état réel du crawl régulier. C'est une photographie instantanée, pas le comportement normal de Googlebot sur votre site.

Quels outils sont concernés par cette définition ?

Tous les systèmes où l'utilisateur déclenche manuellement une action tombent hors du champ des crawlers classiques. L'inspecteur d'URL de Search Console en est l'exemple type, mais d'autres outils de test SEO qui fonctionnent sur requête manuelle sont dans le même cas.

Concrètement, si vous devez cliquer sur un bouton pour obtenir une analyse d'URL, vous n'utilisez pas un crawler au sens Google. Les vrais crawlers — Googlebot, Bingbot, les spiders de sites tiers comme Ahrefs ou SEMrush — tournent en continu, sans intervention humaine pour chaque page.

- Un crawler : système entièrement automatisé, parcourt le web sans intervention humaine constante

- Un outil d'inspection manuel : requête déclenchée par l'utilisateur à chaque fois, comme l'inspecteur d'URL

- Cette distinction influe sur la priorisation des ressources et le comportement réel du crawl

- Les résultats d'un outil manuel ne reflètent pas toujours le crawl naturel de Googlebot

Avis d'un expert SEO

Cette clarification change-t-elle vraiment quelque chose sur le terrain ?

Honnêtement ? Ça dépend de votre usage des outils. Si vous utilisez l'inspecteur d'URL comme référence absolue pour diagnostiquer un problème d'indexation, vous pourriez passer à côté du vrai comportement de Googlebot. L'inspecteur force une visite immédiate — il ne respecte pas le budget de crawl, ni les priorités que Googlebot applique en conditions réelles.

J'ai vu des cas où l'inspecteur d'URL indiquait qu'une page était indexable sans problème, alors que dans le crawl quotidien, Googlebot ne la visitait tout simplement pas à cause d'un crawl budget insuffisant ou d'une architecture de liens défaillante. La distinction n'est donc pas qu'une question de vocabulaire — elle traduit deux comportements différents.

Pourquoi Google insiste-t-il sur cette définition maintenant ?

Probablement parce que trop de gens confondent les deux et tirent des conclusions erronées. Quand vous utilisez l'inspecteur d'URL et que tout semble correct, vous pourriez croire que Googlebot accède normalement à votre contenu. Sauf que l'inspecteur ne simule pas les contraintes du crawl réel : pas de respect du crawl budget, pas de simulation de la charge serveur, pas de prise en compte du taux de rafraîchissement perçu.

Google veut probablement éviter que les webmasters prennent des décisions SEO basées sur des tests manuels qui ne reflètent pas la réalité du crawl automatisé. [À vérifier] : il serait intéressant de savoir si Google envisage d'ajouter des fonctionnalités dans Search Console pour mieux simuler le comportement réel de Googlebot — pour l'instant, rien n'indique que ce soit le cas.

Faut-il donc arrêter d'utiliser l'inspecteur d'URL ?

Non, ce serait idiot. L'inspecteur d'URL reste extrêmement utile pour tester rapidement si une page peut être rendue correctement, si le JavaScript s'exécute bien, si les balises canoniques sont correctes. Mais il ne faut pas l'utiliser comme unique source de vérité.

Pour avoir une vision complète, combinez l'inspecteur d'URL avec les données des rapports de couverture dans Search Console, les logs serveur, et éventuellement un crawler tiers configuré pour respecter le crawl budget. C'est cette triangulation qui vous donne une image fidèle de ce qui se passe vraiment.

Impact pratique et recommandations

Comment vérifier que Googlebot crawle vraiment vos pages critiques ?

La première étape, c'est d'analyser vos logs serveur. Pas d'autre moyen fiable de savoir exactement quelles pages Googlebot visite, à quelle fréquence, et avec quel comportement. L'inspecteur d'URL ne vous donnera jamais cette information — il ne crawle pas, il inspecte à la demande.

Ensuite, comparez ces données avec les rapports de couverture de Search Console. Si vous constatez que des pages stratégiques ne sont jamais visitées par Googlebot alors que l'inspecteur d'URL les valide, vous avez un problème de crawl budget ou d'architecture.

Quelles erreurs éviter quand on utilise des outils manuels ?

Ne tirez jamais de conclusions définitives à partir d'un seul test manuel. L'inspecteur d'URL peut vous dire qu'une page est techniquement accessible, mais il ne vous dira pas si Googlebot la visite réellement dans son crawl quotidien.

Autre piège classique : croire qu'une page testée manuellement bénéficie du même traitement qu'une page découverte naturellement par le crawler. Le contexte de découverte compte énormément — une page isolée dans l'arborescence sans maillage interne sera rarement crawlée, même si l'inspecteur la valide.

Que faire concrètement pour optimiser le crawl automatisé ?

Travaillez sur votre maillage interne pour guider Googlebot vers les pages prioritaires. Surveillez votre budget de crawl via les logs — si Googlebot perd du temps sur des pages inutiles (facettes, paramètres d'URL), nettoyez via robots.txt ou des balises noindex.

Assurez-vous que vos temps de réponse serveur sont optimaux. Un serveur lent fait chuter le nombre de pages que Googlebot accepte de crawler par session. Enfin, mettez à jour régulièrement votre contenu sur les pages stratégiques — Google crawle plus fréquemment les contenus qu'il perçoit comme dynamiques.

- Analysez vos logs serveur pour connaître le comportement réel de Googlebot

- Comparez les données des logs avec les rapports de couverture Search Console

- Ne vous fiez pas uniquement aux tests manuels comme l'inspecteur d'URL

- Optimisez votre maillage interne pour orienter Googlebot vers les pages prioritaires

- Surveillez et optimisez votre budget de crawl — éliminez les URLs inutiles

- Améliorez les temps de réponse serveur pour augmenter le volume de crawl autorisé

- Mettez à jour régulièrement le contenu des pages stratégiques pour stimuler le recrawl

❓ Questions frequentes

L'inspecteur d'URL de Search Console est-il fiable pour tester l'indexabilité ?

Pourquoi Googlebot ne visite-t-il pas certaines pages validées par l'inspecteur d'URL ?

Quels outils SEO sont considérés comme des crawlers automatisés ?

Comment savoir quelles pages Googlebot crawle vraiment sur mon site ?

Peut-on forcer Googlebot à crawler plus souvent une page stratégique ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 21/12/2021

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.