Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Le fichier robots.txt empêche-t-il réellement l'indexation de vos pages ?

- □ Votre outil de test SEO est-il vraiment un crawler aux yeux de Google ?

- □ Googlebot suit-il vraiment les liens ou fonctionne-t-il autrement ?

- □ Le parser robots.txt open source de Google est-il vraiment utilisé en production ?

- □ Pourquoi Google abandonne-t-il les directives d'indexation dans robots.txt ?

- □ Publier un site web équivaut-il juridiquement à autoriser Google à le crawler ?

- □ Comment Googlebot ajuste-t-il sa fréquence de crawl pour ne pas faire planter vos serveurs ?

- □ Peut-on indexer une page sans la crawler ?

- □ Le robots.txt est-il vraiment suffisant pour contrôler le crawl de votre site ?

- □ Qui a vraiment créé le parser robots.txt de Google ?

- □ Pourquoi Google refuse-t-il catégoriquement de moderniser le format robots.txt ?

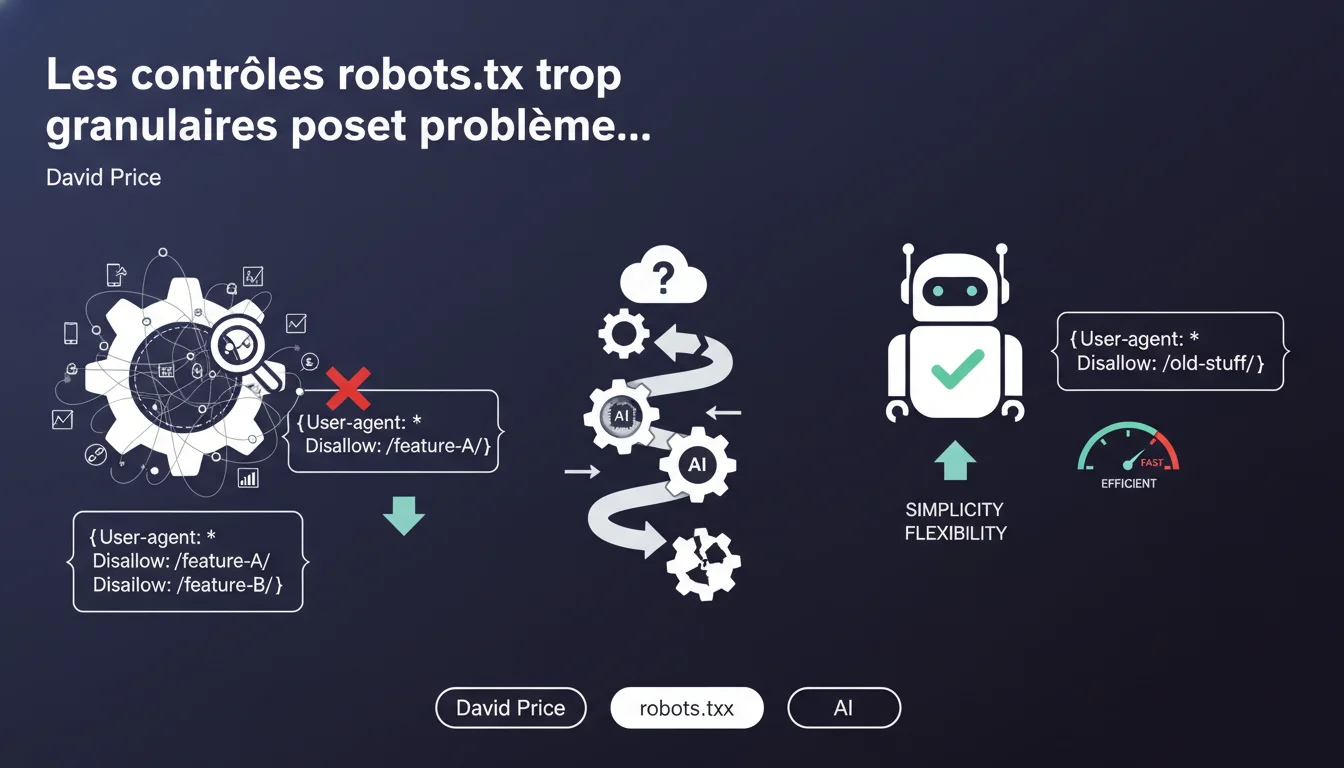

Google explique que des directives robots.txt trop spécifiques créent des problèmes d'interprétation quand les fonctionnalités du moteur évoluent. C'est pourquoi le fichier reste volontairement simple et haut niveau. Un argument qui soulève la question : est-ce vraiment pour notre bien, ou pour simplifier le travail de Google ?

Ce qu'il faut comprendre

David Price, de chez Google, prend position sur un débat technique : faut-il affiner au maximum les directives robots.txt pour contrôler précisément ce que Googlebot peut explorer ?

Sa réponse est claire — non. Et l'explication tient en un mot : la maintenance.

Que signifie « trop granulaire » dans ce contexte ?

On parle ici de directives ultra-ciblées qui tentent de bloquer des fonctionnalités précises plutôt que des sections entières d'un site. Par exemple : interdire l'accès à des paramètres d'URL spécifiques, à des chemins générés dynamiquement, ou à des fichiers techniques très pointus.

Le problème ? Quand Google fait évoluer son crawler — nouveau user-agent, nouvelle logique d'exploration, fusion de bots — ces règles hyper-spécifiques peuvent devenir obsolètes, mal interprétées, voire contre-productives. Vous bloquez une chose qui n'existe plus, ou laissez passer ce que vous vouliez interdire.

Pourquoi Google préfère-t-il un robots.txt « simple et haut niveau » ?

Parce que ça réduit les cas d'interprétation ambigüe. Un Disallow: /admin/ reste valide pendant 10 ans. Un Disallow: /api/v2.3/legacy-endpoint?param=x devient un casse-tête dès que votre API passe en v3 ou que Google modifie sa manière de gérer les paramètres.

Google dit : si vous voulez du contrôle fin, utilisez les balises meta robots, X-Robots-Tag, ou Search Console. Robots.txt n'est pas fait pour ça.

- Robots.txt doit rester un outil de blocage grossier : répertoires entiers, fichiers statiques, zones sensibles.

- Les directives trop spécifiques deviennent fragiles dès que votre site ou l'algorithme de Google évolue.

- Pour un contrôle fin, privilégiez meta robots, noindex, canonical, ou les paramètres dans Search Console.

- Google veut que robots.txt reste un standard stable et interopérable, pas une usine à gaz.

Avis d'un expert SEO

Cette justification tient-elle vraiment la route ?

En partie, oui. L'argument de la maintenance à long terme est valide — j'ai vu des robots.txt de 200 lignes devenir ingérables après une migration ou un refonte. Des règles oubliées qui bloquent des ressources critiques, personne ne sait pourquoi.

Mais soyons honnêtes : cette position arrange aussi Google. Un robots.txt simple, c'est moins de cas limites à traiter, moins de support, moins de bugs à corriger. Dire « on garde ça basique » évite d'avoir à gérer des edge cases complexes.

Dans quels cas cette recommandation ne suffit pas ?

Sur des sites avec génération dynamique massive de contenu — marketplaces, annuaires, agrégateurs — il est parfois nécessaire de bloquer des patterns précis pour éviter le crawl de millions de pages inutiles. Un simple Disallow: /search? peut être trop brutal.

Dans ces cas, les directives « granulaires » sont inévitables. Mais Google a raison sur un point : documentez-les, maintenez-les, et prévoyez une revue régulière. [À vérifier] — on manque de retours d'expérience documentés sur l'impact réel d'une évolution Googlebot sur des robots.txt complexes. Google ne publie pas de changelog détaillé à chaque mise à jour de crawler.

Quelle est l'alternative concrète proposée ?

Google dit : meta robots, X-Robots-Tag, canonical, paramètres Search Console. C'est vrai, ces outils offrent un contrôle plus fin. Mais ils nécessitent que Googlebot crawle d'abord la page pour lire ces instructions — ce qui consomme du crawl budget.

Donc si l'objectif est d'économiser des ressources serveur ou d'empêcher l'accès avant même le crawl, robots.txt reste indispensable. La contradiction est là : Google dit « restez simples » tout en sachant que certains sites n'ont pas le choix.

Impact pratique et recommandations

Que faut-il faire concrètement avec votre robots.txt ?

Auditez votre fichier actuel. Si vous avez des dizaines de lignes ciblant des endpoints précis, des versions d'API, des paramètres GET ultra-spécifiques — posez-vous la question : sont-elles encore nécessaires ?

Privilégiez des règles larges et stables. Par exemple, bloquez /admin/ plutôt que /admin/dashboard/v2/. Si demain vous passez en v3, la règle reste valide.

Quelles erreurs éviter absolument ?

Ne bloquez jamais des ressources critiques (CSS, JS, images) via des règles trop pointues. Google peut mal interpréter, surtout si son rendering évolue. Testez toujours vos modifications via l'outil de test robots.txt dans Search Console.

Évitez les regex complexes ou les wildcards imbriqués. Même si la syntaxe est techniquement supportée, elle peut devenir ambigüe lors d'une mise à jour du parser de Google.

Comment vérifier que votre configuration est conforme ?

- Ouvrez Search Console → Outil de test robots.txt → vérifiez que les URLs critiques ne sont pas bloquées

- Listez toutes les directives

Disallowet demandez-vous : « Si Google change son crawler demain, cette règle reste-t-elle pertinente ? » - Documentez chaque règle complexe : pourquoi elle existe, ce qu'elle bloque, qui l'a ajoutée

- Passez en revue votre robots.txt tous les 6 mois minimum, surtout après une migration ou une refonte

- Utilisez meta robots ou X-Robots-Tag pour tout ce qui nécessite un contrôle fin (noindex, nofollow, indexIfEmbedded, etc.)

- Si vous bloquez des patterns dynamiques, testez-les régulièrement avec des outils tiers (Screaming Frog, Botify, OnCrawl)

Robots.txt doit rester un outil de blocage grossier et stable. Tout ce qui nécessite de la granularité doit passer par meta robots, canonical ou Search Console. Si votre fichier devient complexe, c'est probablement le signe qu'il faut repenser l'architecture de votre site plutôt que d'ajouter des rustines.

Ces optimisations techniques — surtout sur des sites à forte volumétrie — demandent une expertise pointue et une surveillance continue. Si votre robots.txt dépasse les 50 lignes ou si vous gérez des millions de pages indexables, l'accompagnement d'une agence SEO spécialisée peut vous éviter des erreurs coûteuses et garantir une configuration pérenne, même quand Google fait évoluer ses crawlers.

❓ Questions frequentes

Est-ce que Google prévient quand il modifie le comportement de Googlebot ?

Peut-on bloquer Googlebot-Image différemment de Googlebot tout en restant « simple » ?

Si je bloque des paramètres via robots.txt, est-ce que Google les ignore totalement ?

Quelle est la taille maximale recommandée pour un fichier robots.txt ?

Dois-je supprimer toutes mes directives complexes immédiatement ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 21/12/2021

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.