Declaration officielle

Autres déclarations de cette vidéo 20 ▾

- □ Comment Google indexe-t-il réellement le contenu des iframes ?

- □ Faut-il vraiment privilégier une structure hiérarchique pour les grands sites ?

- □ Bloquer le crawl via robots.txt : solution miracle contre les liens toxiques ?

- □ Faut-il traduire ses URLs pour améliorer son référencement international ?

- □ Pourquoi Googlebot ignore-t-il la balise meta prerender-status-code 404 dans les applications JavaScript ?

- □ Pourquoi les migrations de sites échouent-elles si souvent malgré une préparation SEO ?

- □ Pourquoi Google pénalise-t-il les vidéos hors du viewport et comment y remédier ?

- □ Comment transférer efficacement le classement de vos images vers de nouvelles URLs ?

- □ Faut-il vraiment s'inquiéter des erreurs 404 sur son site ?

- □ HTTP 200 sur une page 404 : soft 404 ou cloaking ?

- □ Faut-il forcer l'indexation de son fichier sitemap dans Google ?

- □ Faut-il s'inquiéter si Googlebot crawle vos endpoints API et génère des 404 ?

- □ L'accessibilité web est-elle vraiment un facteur de classement Google ou un écran de fumée ?

- □ L'achat de liens reste-t-il vraiment sanctionné par Google ?

- □ Faut-il encore signaler les mauvais backlinks à Google ?

- □ Pourquoi bloquer le crawl via robots.txt empêche-t-il Google de voir votre directive noindex ?

- □ Pourquoi Google refuse-t-il l'idée d'une formule magique pour ranker ?

- □ Pourquoi Google affiche-t-il mal vos caractères spéciaux dans ses résultats ?

- □ Google Analytics et Search Console : pourquoi ces différences de données posent-elles problème ?

- □ Faut-il vraiment viser le SEO parfait ?

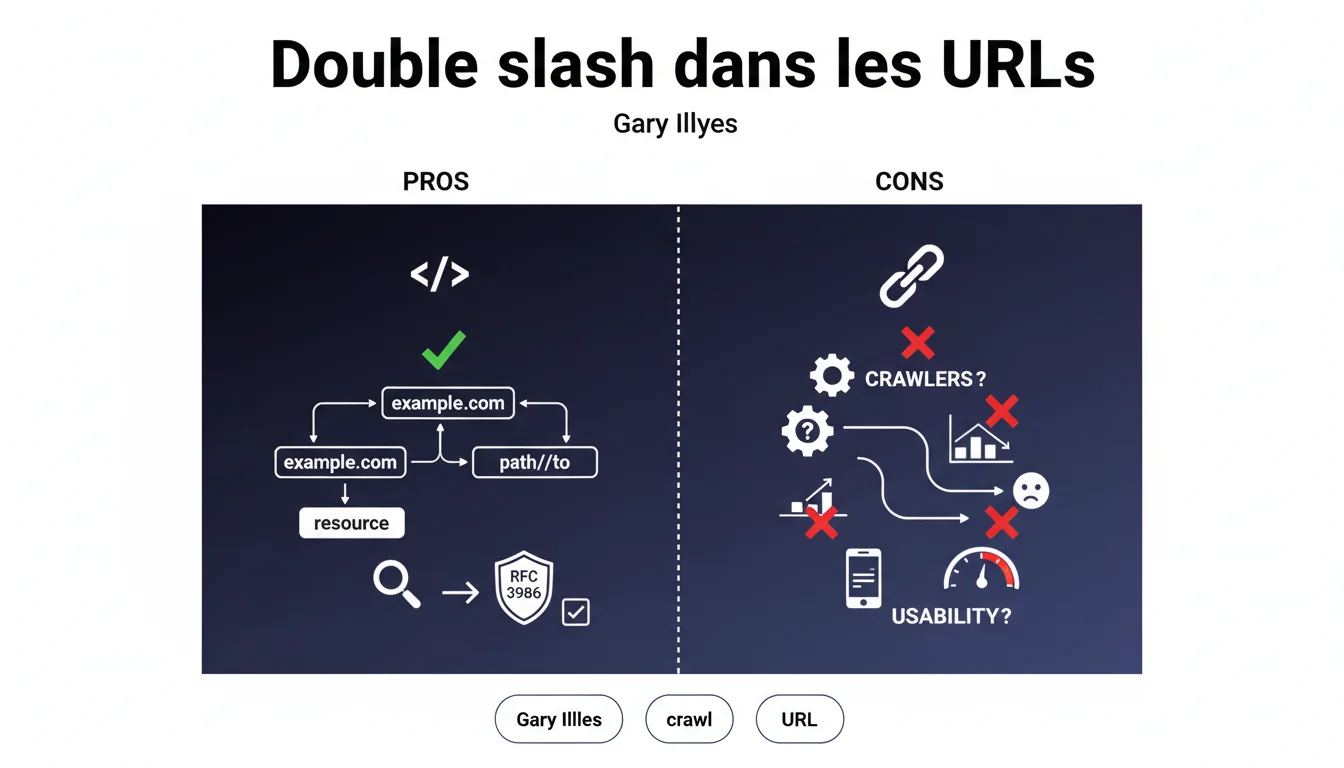

Techniquement, les doubles slashes dans les URLs sont conformes au RFC 3986 et ne posent pas de problème de validité. Mais du côté utilisabilité et crawl, c'est une autre histoire : certains crawlers peuvent se perdre et l'expérience utilisateur en pâtit. Google tolère, mais ne recommande clairement pas.

Ce qu'il faut comprendre

Quelle est la position technique de Google sur les doubles slashes ?

Gary Illyes rappelle que le slash est un séparateur valide selon le standard RFC 3986, qui régit la syntaxe des URLs. Concrètement, une URL comme example.com/category//page ne viole aucune norme technique.

Mais attention — ce n'est pas parce qu'une URL est techniquement valide qu'elle est optimale. Google fait une distinction nette entre conformité technique et praticité réelle.

Pourquoi certains crawlers se perdent-ils avec les doubles slashes ?

Le problème n'est pas dans la spécification, mais dans l'implémentation des crawlers. Certains bots interprètent mal les doubles slashes et peuvent considérer /category//page et /category/page comme deux URLs distinctes.

Résultat : risque de duplication de contenu, dilution du PageRank, et confusion dans l'indexation. Même si Googlebot gère plutôt bien le sujet, d'autres crawlers — y compris ceux utilisés pour l'analyse de logs ou le SEO technique — peuvent trébucher.

Quel impact sur l'expérience utilisateur ?

Une URL propre inspire confiance. Une URL avec des doubles slashes, c'est visuellement bizarre et ça donne l'impression d'une erreur ou d'un site mal maintenu.

C'est d'autant plus vrai quand l'URL est partagée sur les réseaux sociaux, copiée-collée dans un email ou affichée dans les SERPs. L'utilisateur peut hésiter à cliquer.

- Les doubles slashes sont techniquement valides selon RFC 3986

- Certains crawlers peuvent mal interpréter ces URLs et créer de la duplication

- L'expérience utilisateur est dégradée : impression d'erreur

- Google tolère mais déconseille implicitement cette pratique

Avis d'un expert SEO

Cette tolérance technique cache-t-elle un vrai problème SEO ?

Soyons honnêtes : si Gary Illyes prend la peine de préciser « ce n'est pas idéal du point de vue utilisabilité », c'est qu'il y a un souci. Google ne dit jamais explicitement « évitez ça », mais le message est clair.

Sur le terrain, on observe que les doubles slashes génèrent des variations d'URLs qui peuvent fragmenter les signaux de ranking. Même si Googlebot fait l'effort de normaliser, pourquoi prendre ce risque ?

Dans quels cas les doubles slashes apparaissent-ils le plus souvent ?

Généralement, c'est un bug de génération d'URLs dynamiques : concaténation de chemins mal gérée, variables vides, mauvaise configuration de réécriture d'URLs (mod_rewrite, nginx). Ça arrive aussi avec certains CMS ou frameworks mal paramétrés.

Moins souvent, c'est intentionnel — et là, c'est encore pire. Aucun intérêt SEO à structurer volontairement des URLs avec doubles slashes. [À vérifier] : certains parlent d'une possible interprétation comme paramètre encodé, mais aucune donnée terrain solide ne vient étayer cette hypothèse.

Faut-il corriger systématiquement ces URLs ?

Oui, sauf si le volume est microscopique et que l'impact est négligeable. Mais dans la plupart des cas, nettoyer ces URLs améliore la cohérence technique et évite des surprises désagréables lors d'une migration ou d'un audit SEO approfondi.

Impact pratique et recommandations

Que faut-il faire si mon site contient des doubles slashes ?

Première étape : identifier l'origine. Crawl complet avec Screaming Frog ou Oncrawl, analyse des logs serveur, vérification des sitemaps XML. Repérez toutes les URLs concernées.

Ensuite, corrigez la génération d'URLs côté code. Si c'est un CMS, vérifiez les plugins, la config de réécriture, et les templates. Si c'est du code custom, traquez la concaténation fautive.

Comment gérer les URLs déjà indexées avec doubles slashes ?

Mettez en place des redirections 301 depuis les versions avec doubles slashes vers les versions propres. Assurez-vous que les canonicals pointent vers la bonne version.

Ensuite, soumettez un nouveau sitemap propre et demandez une réindexation via Google Search Console pour accélérer la mise à jour de l'index.

Quelles erreurs éviter absolument ?

Ne laissez jamais coexister les deux versions sans canonical ou redirection. Ça crée de la duplication de contenu et fragmente vos signaux de ranking.

Ne faites pas non plus de redirections en chaîne (double slash → version propre → autre redirection). Google suit les redirections, mais chaque saut dilue un peu plus les signaux.

- Crawler le site pour identifier toutes les URLs avec doubles slashes

- Corriger la génération d'URLs côté code (CMS, framework, templates)

- Mettre en place des redirections 301 propres vers les URLs normalisées

- Vérifier les canonicals et s'assurer qu'ils pointent vers la bonne version

- Soumettre un sitemap XML nettoyé

- Monitorer l'indexation via Google Search Console

- Vérifier que les autres crawlers (analytics, SEO tools) n'indexent plus ces URLs fautives

❓ Questions frequentes

Google pénalise-t-il les sites avec des doubles slashes dans les URLs ?

Les doubles slashes créent-ils systématiquement de la duplication de contenu ?

Peut-on utiliser des canonicals au lieu de corriger les URLs ?

Les doubles slashes affectent-ils les performances de crawl ?

Comment vérifier si mes URLs avec doubles slashes sont indexées ?

🎥 De la même vidéo 20

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 18/12/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.