Declaration officielle

Autres déclarations de cette vidéo 20 ▾

- □ Comment Google indexe-t-il réellement le contenu des iframes ?

- □ Faut-il vraiment privilégier une structure hiérarchique pour les grands sites ?

- □ Bloquer le crawl via robots.txt : solution miracle contre les liens toxiques ?

- □ Faut-il traduire ses URLs pour améliorer son référencement international ?

- □ Pourquoi les migrations de sites échouent-elles si souvent malgré une préparation SEO ?

- □ Les doubles slashes dans les URLs sont-ils un problème pour le SEO ?

- □ Pourquoi Google pénalise-t-il les vidéos hors du viewport et comment y remédier ?

- □ Comment transférer efficacement le classement de vos images vers de nouvelles URLs ?

- □ Faut-il vraiment s'inquiéter des erreurs 404 sur son site ?

- □ HTTP 200 sur une page 404 : soft 404 ou cloaking ?

- □ Faut-il forcer l'indexation de son fichier sitemap dans Google ?

- □ Faut-il s'inquiéter si Googlebot crawle vos endpoints API et génère des 404 ?

- □ L'accessibilité web est-elle vraiment un facteur de classement Google ou un écran de fumée ?

- □ L'achat de liens reste-t-il vraiment sanctionné par Google ?

- □ Faut-il encore signaler les mauvais backlinks à Google ?

- □ Pourquoi bloquer le crawl via robots.txt empêche-t-il Google de voir votre directive noindex ?

- □ Pourquoi Google refuse-t-il l'idée d'une formule magique pour ranker ?

- □ Pourquoi Google affiche-t-il mal vos caractères spéciaux dans ses résultats ?

- □ Google Analytics et Search Console : pourquoi ces différences de données posent-elles problème ?

- □ Faut-il vraiment viser le SEO parfait ?

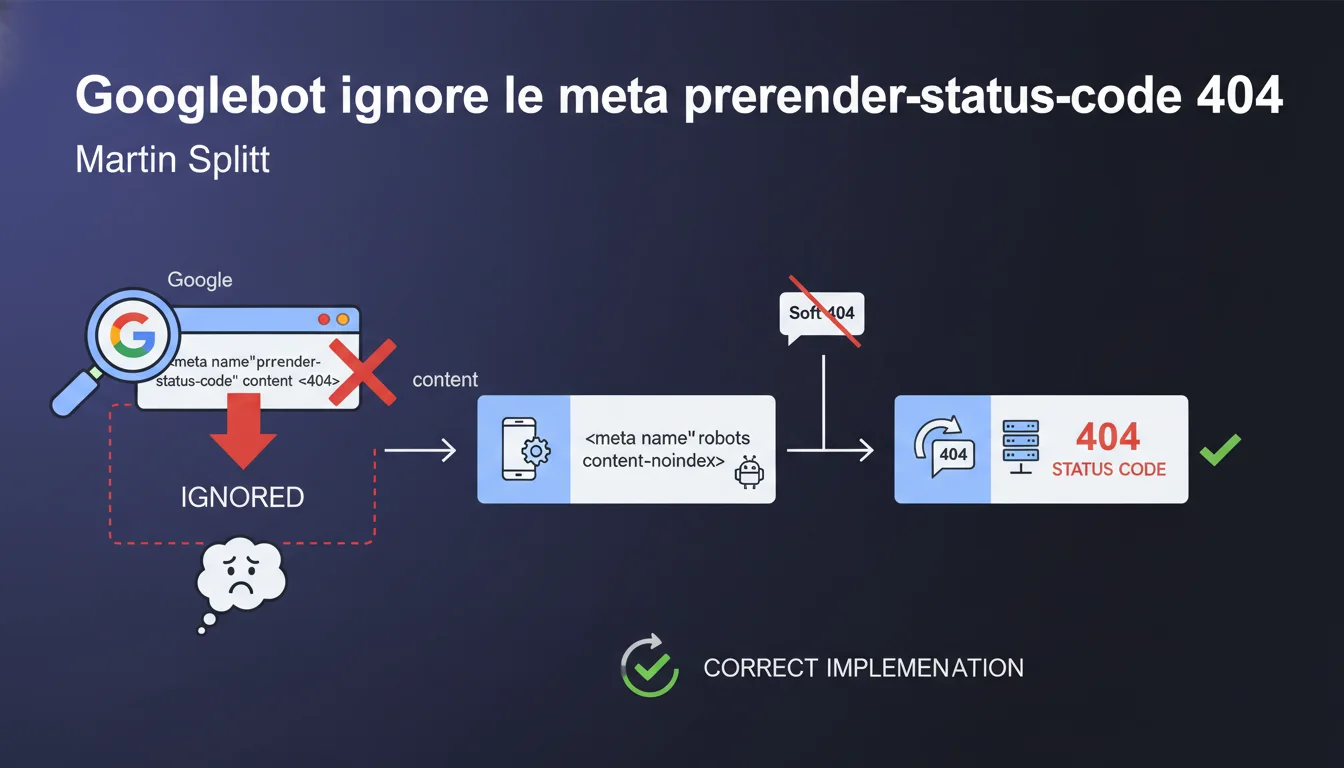

Googlebot ne traite pas la balise meta 'prerender-status-code content 404' utilisée par certains frameworks JavaScript pour simuler des codes de statut HTTP. Résultat : vos pages 404 en rendu client risquent d'être perçues comme des soft 404 et indexées malgré leur inexistence. La solution ? Passer par un vrai code HTTP 404 serveur ou un noindex via meta robots.

Ce qu'il faut comprendre

Qu'est-ce que la balise meta prerender-status-code exactement ?

Cette balise a été conçue pour les services de pré-rendu comme Prerender.io ou Rendertron. Elle permet aux applications monopage (SPA) de communiquer un code de statut HTTP au service de pré-rendu, même si techniquement le serveur répond toujours avec un 200 OK.

L'idée initiale ? Dire au service « cette page est en réalité une 404, traite-la comme telle ». Certains développeurs ont cru que Googlebot lirait cette balise directement, sans passer par un service intermédiaire. Spoiler : non.

Pourquoi Googlebot l'ignore-t-il alors ?

Googlebot ne fait pas de différence entre le contenu généré côté client et celui généré côté serveur — il rend le JavaScript et analyse le DOM final. Mais il ne traite pas les directives meta « maison » inventées pour des services tiers.

La balise meta prerender-status-code n'est pas un standard HTML reconnu par les moteurs de recherche. Google attend un vrai code HTTP 404 envoyé par le serveur ou une directive explicite via meta robots. Le reste ? Du bruit.

Quels sont les risques concrets de cette mécompréhension ?

Si votre SPA génère dynamiquement une page 404 avec cette balise sans envoyer un vrai code HTTP 404, Google voit une page « vide » ou pauvre qui répond avec un 200. Résultat : soft 404.

- Indexation parasite de pages d'erreur

- Crawl budget gaspillé sur des URLs inexistantes

- Signaux de qualité dégradés si le volume de soft 404 est important

- Confusion dans Search Console avec des avertissements soft 404 récurrents

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Oui, totalement. J'ai vu des dizaines de SPA mal configurées où le serveur renvoie systématiquement un 200 OK même pour des URLs foireuses. Le développeur pense que sa balise meta « fait le job ». Sauf que Google s'en fiche.

Le problème, c'est que certains outils de monitoring (comme Screaming Frog en mode JavaScript) peuvent ne pas détecter ce type de configuration bancale si on ne simule pas précisément le comportement de Googlebot. Résultat : on découvre le pot aux roses des mois après le déploiement, quand Search Console se remplit de soft 404.

Dans quels cas cette règle pourrait-elle poser problème ?

Si vous utilisez un service de pré-rendu intermédiaire qui convertit effectivement cette balise en vrai code HTTP 404 avant de servir le contenu à Googlebot, ça marche. Mais c'est une dépendance externe de plus, avec un coût et une latence supplémentaires.

Pour les petites structures ou les projets internes sans budget infra lourd, compter sur un service tiers pour « traduire » vos codes de statut est bancal architecturalement. Autant corriger le problème à la racine : côté serveur ou via dynamic rendering maison.

Google aurait-il pu être plus clair sur ce point avant ?

Franchement, oui. Cette balise traîne depuis des années dans la doc de Prerender.io et autres solutions de pré-rendu. Google n'a jamais officiellement dit « on supporte ça » — mais le silence a créé une zone grise que beaucoup ont interprétée à leur sauce.

Martin Splitt a raison de clarifier enfin, mais ça aurait mérité un article détaillé ou une mise à jour explicite de la doc officielle. [A vérifier] : est-ce que Google a prévu de documenter proprement toutes les meta balises qu'il ignore activement ? Ça aiderait.

Impact pratique et recommandations

Que faut-il faire concrètement si vous utilisez cette balise ?

Première option : configurez votre serveur pour qu'il renvoie un vrai code HTTP 404 lorsque la ressource n'existe pas. C'est la solution la plus propre. Ça implique souvent de passer par du server-side rendering (SSR) ou un système de routing côté serveur qui détecte les URLs invalides.

Deuxième option : ajoutez une balise meta robots noindex dans le DOM généré par votre SPA pour les pages 404. Google ne les indexera pas, même si le serveur répond 200. Attention : ça ne résout pas totalement le problème du crawl budget gaspillé, mais ça évite l'indexation parasite.

Comment vérifier que votre site est correctement configuré ?

Testez vos URLs inexistantes avec l'outil d'inspection d'URL de Search Console. Regardez le code de statut HTTP renvoyé et le rendu HTML final. Si vous voyez un 200 avec une page vide ou d'erreur sans noindex, vous avez un problème.

Crawlez votre site avec un outil qui simule le rendu JavaScript (Screaming Frog en mode Chrome ou Oncrawl avec JS activé). Identifiez toutes les pages qui renvoient un 200 mais qui sont en réalité des erreurs. Priorisez leur correction.

- Auditer toutes les URLs 404 potentielles via Search Console et un crawler JS

- Vérifier que votre serveur renvoie un code HTTP 404 réel pour les pages inexistantes

- Si SSR/dynamic rendering impossible : ajouter meta robots noindex sur les pages d'erreur

- Supprimer toute référence à la balise meta prerender-status-code si elle n'est pas couplée à un service de pré-rendu fonctionnel

- Monitorer régulièrement les soft 404 dans Search Console

La gestion des codes de statut HTTP dans les SPA est un sujet technique qui touche à l'architecture frontend, backend et SEO. Si votre équipe dev n'a pas l'expertise ou le temps pour implémenter proprement du SSR ou du dynamic rendering, l'accompagnement d'une agence SEO spécialisée peut faire gagner des mois et éviter des erreurs coûteuses. Un audit technique approfondi permet souvent de débloquer rapidement ce type de configuration.

❓ Questions frequentes

Peut-on utiliser un code JavaScript pour envoyer un 404 à Google ?

Est-ce qu'un service de pré-rendu comme Prerender.io résout le problème ?

Quelle différence entre un soft 404 et un vrai 404 pour Google ?

Le noindex suffit-il à remplacer un code 404 serveur ?

Doit-on corriger les anciennes pages qui utilisent cette balise ?

🎥 De la même vidéo 20

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 18/12/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.