Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Le crawl intensif garantit-il vraiment un site de qualité ?

- □ Faut-il forcer Google à crawler davantage pour améliorer son classement ?

- □ Peut-on vraiment augmenter le crawl budget de son site en contactant Google ?

- □ Pourquoi Google crawle-t-il certains sites plus souvent que d'autres ?

- □ Pourquoi Google insiste-t-il sur l'implémentation du header If-Modified-Since ?

- □ Les paramètres d'URL créent-ils vraiment un espace de crawl infini pour Google ?

- □ Pourquoi Google insiste-t-il autant sur les statistiques d'exploration dans Search Console ?

- □ Pourquoi un temps de réponse serveur lent tue-t-il votre crawl budget ?

- □ Googlebot suit-il vraiment les liens comme un utilisateur navigue de page en page ?

- □ Faut-il vraiment optimiser le crawl budget si Google a des ressources illimitées ?

- □ Les sitemaps sont-ils vraiment indispensables pour optimiser le crawl de votre site ?

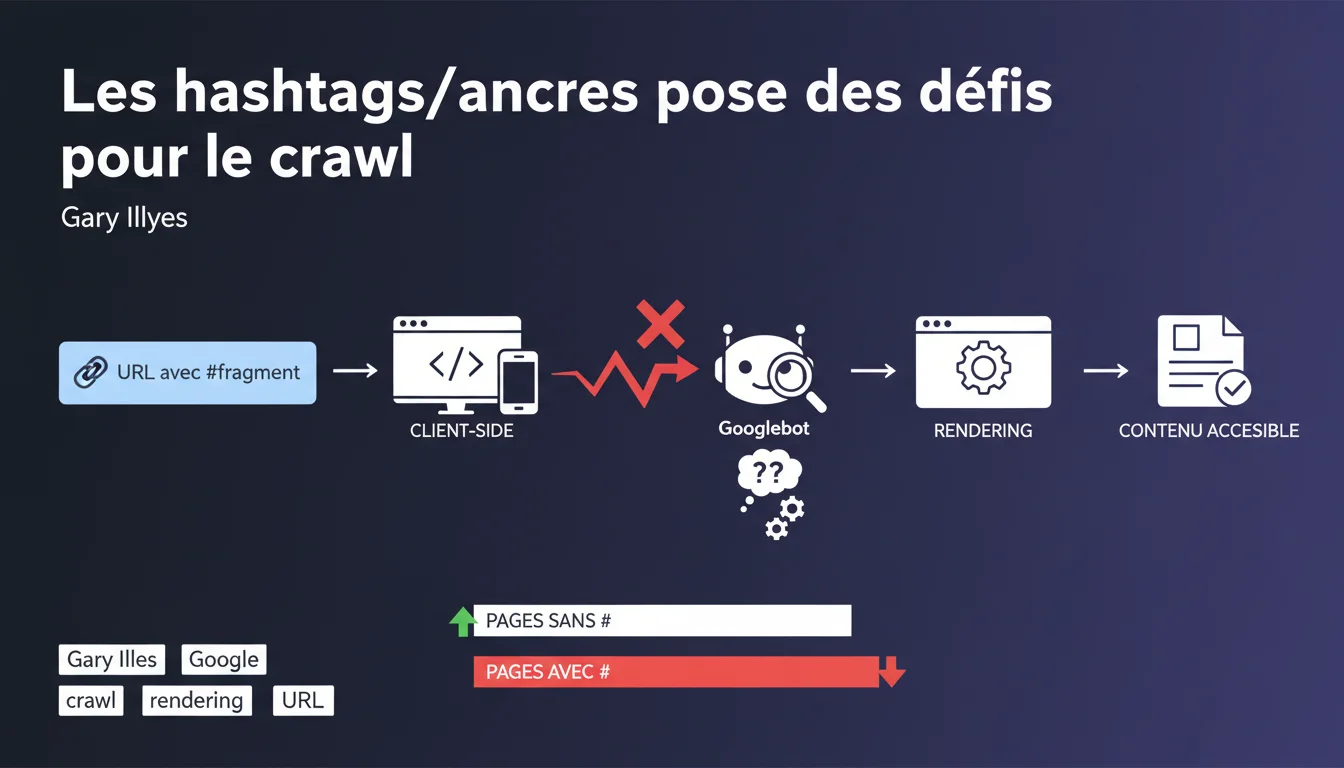

Les fragments d'URL (tout ce qui suit le #) ne sont traités que côté navigateur et restent invisibles pour Googlebot sans rendering JavaScript. Concrètement, si votre architecture repose sur des ancres pour structurer le contenu, Google risque de ne jamais découvrir certaines sections — sauf si vous forcez le rendering, ce qui consomme du crawl budget.

Ce qu'il faut comprendre

Quelle est la différence entre une URL complète et un fragment d'ancre ?

Une URL classique comme exemple.com/page est entièrement transmise au serveur lors de la requête HTTP. En revanche, tout ce qui suit le symbole # — appelé fragment ou ancre — reste strictement côté client. Le navigateur l'utilise pour scroller jusqu'à un élément de la page ou déclencher du JavaScript, mais ce fragment n'est jamais envoyé au serveur.

Pour Googlebot en mode crawl classique (sans rendering), c'est comme si ces ancres n'existaient pas. Il voit exemple.com/page, point. Si votre contenu dynamique dépend d'un #section-2 pour s'afficher, Google ne le verra pas lors du premier passage.

Comment Google peut-il quand même accéder à ces contenus ?

Google dispose d'une capacité de rendering JavaScript — autrement dit, il peut exécuter le JS de votre page comme le ferait un navigateur. Mais ce processus intervient dans une file d'attente distincte, avec un délai variable (parfois plusieurs jours), et consomme beaucoup plus de ressources qu'un simple crawl HTML.

Si votre navigation repose massivement sur des ancres et que le JS tarde à être exécuté, certaines sections risquent de ne jamais être découvertes ou indexées. C'est là que ça coince pour les sites one-page ou les SPAs mal configurés.

Quelles architectures sont concernées par ce problème ?

Principalement les Single Page Applications (SPAs), les sites construits avec des frameworks JavaScript (React, Vue, Angular), et les pages one-page avec navigation par ancres. Si votre menu principal utilise des liens du type href="#services" sans véritable URL distincte, vous êtes directement impacté.

Les sites classiques avec des ancres utilisées uniquement pour le scroll interne (table des matières, retour en haut de page) ne posent pas de souci majeur — tant que le contenu est déjà présent dans le HTML initial.

- Les fragments d'URL (#) ne sont jamais transmis au serveur lors d'une requête HTTP

- Googlebot en mode crawl standard ne voit pas les ancres sans rendering

- Le rendering JavaScript arrive après le crawl initial, avec un délai imprévisible

- Les architectures SPA ou one-page sont les plus exposées à ce risque de découvrabilité

- Sans URLs distinctes pour chaque section, le maillage interne et le crawl budget en souffrent

Avis d'un expert SEO

Cette déclaration correspond-elle à ce qu'on observe sur le terrain ?

Oui, totalement. On voit régulièrement des SPAs avec des taux d'indexation catastrophiques parce que Google n'a jamais rendu certaines routes. Le rendering différé est un fait établi — et quand le budget crawl est serré, certaines pages peuvent attendre des semaines avant d'être rendues.

Là où Gary Illyes reste flou, c'est sur les priorités exactes du rendering. Quels signaux déclenchent un rendering rapide versus un rendering tardif ou jamais ? On manque de données concrètes. [À vérifier] dans vos propres logs serveur et Search Console.

Faut-il pour autant bannir toute utilisation d'ancres ?

Non, et ce serait une erreur. Les ancres restent parfaitement valides pour améliorer l'expérience utilisateur — tables des matières, navigation interne fluide, deep linking dans des contenus riches. Le vrai problème, c'est quand l'architecture entière repose sur des ancres sans URLs distinctes.

Si votre contenu critique est accessible via une vraie URL et que les ancres servent juste de raccourcis UX, aucun souci. C'est l'usage exclusif d'ancres pour segmenter du contenu invisible côté HTML qui pose problème.

Quelles sont les solutions réellement fiables aujourd'hui ?

Le Server-Side Rendering (SSR) ou la génération statique restent les approches les plus sûres. Next.js, Nuxt, Gatsby — tous ces frameworks permettent de générer du HTML complet côté serveur. Googlebot voit immédiatement le contenu, sans dépendre du rendering.

Sinon, le Dynamic Rendering (servir du HTML pré-rendu uniquement aux bots) fonctionne, mais Google a déjà laissé entendre que ce n'était qu'une solution temporaire. À long terme, mieux vaut miser sur du SSR ou du pré-rendering systématique.

Impact pratique et recommandations

Que faut-il vérifier en priorité sur son site ?

Commencez par identifier si votre navigation principale ou vos contenus stratégiques dépendent d'ancres. Inspectez vos liens internes : si vous voyez beaucoup de href="#" ou href="#section" sans URLs distinctes, c'est un signal d'alarme.

Ensuite, testez le HTML brut avec un curl ou View Source dans le navigateur. Si des blocs entiers de contenu n'apparaissent pas sans JavaScript activé, Google risque de les manquer au premier crawl.

Comment corriger une architecture trop dépendante des ancres ?

La solution propre, c'est de migrer vers des URLs distinctes pour chaque section importante. Au lieu de exemple.com/offres#conseil, créez exemple.com/offres/conseil. Vous conservez une vraie structure d'URLs crawlable, avec des possibilités de maillage interne et de suivi dans Search Console.

Si une refonte complète n'est pas envisageable à court terme, le SSR ou pré-rendering peut servir de palliatif. Mais attention — ce n'est qu'un pansement si l'architecture sous-jacente reste bancale.

Quelles erreurs éviter absolument ?

Ne comptez jamais sur le rendering JavaScript comme solution par défaut. Certains sites attendent des mois avant que Google ne rende certaines pages — et parfois, ça n'arrive jamais. Le crawl budget n'est pas infini, surtout sur des sites de taille moyenne.

Autre piège : les liens internes vers des ancres sans fallback HTML. Si votre maillage interne repose sur onclick ou des événements JS pour charger du contenu, Google ne suivra jamais ces liens en crawl standard.

- Auditez vos liens internes : repérez tous les

href="#"et vérifiez s'ils masquent du contenu critique - Testez le HTML brut (curl, View Source) pour confirmer que le contenu est bien présent sans JS

- Consultez les rapports de couverture Search Console : des pages manquantes peuvent signaler un problème de découvrabilité

- Privilégiez les URLs distinctes pour chaque section stratégique plutôt que des ancres

- Si vous utilisez un framework JS, implémentez du SSR ou de la génération statique

- Monitorez les délais de rendering avec les logs serveur et les outils de crawl

❓ Questions frequentes

Google indexe-t-il le contenu chargé via des ancres JavaScript ?

Les ancres nuisent-elles au référencement dans tous les cas ?

Peut-on utiliser des SPAs sans compromettre le SEO ?

Comment vérifier si mon site est impacté par ce problème ?

Le Dynamic Rendering est-il une solution viable à long terme ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 08/08/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.