Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Le crawl intensif garantit-il vraiment un site de qualité ?

- □ Faut-il forcer Google à crawler davantage pour améliorer son classement ?

- □ Peut-on vraiment augmenter le crawl budget de son site en contactant Google ?

- □ Pourquoi Google crawle-t-il certains sites plus souvent que d'autres ?

- □ Pourquoi Google insiste-t-il sur l'implémentation du header If-Modified-Since ?

- □ Les paramètres d'URL créent-ils vraiment un espace de crawl infini pour Google ?

- □ Pourquoi les hashtags et ancres d'URL compliquent-ils le crawl de Google ?

- □ Pourquoi Google insiste-t-il autant sur les statistiques d'exploration dans Search Console ?

- □ Googlebot suit-il vraiment les liens comme un utilisateur navigue de page en page ?

- □ Faut-il vraiment optimiser le crawl budget si Google a des ressources illimitées ?

- □ Les sitemaps sont-ils vraiment indispensables pour optimiser le crawl de votre site ?

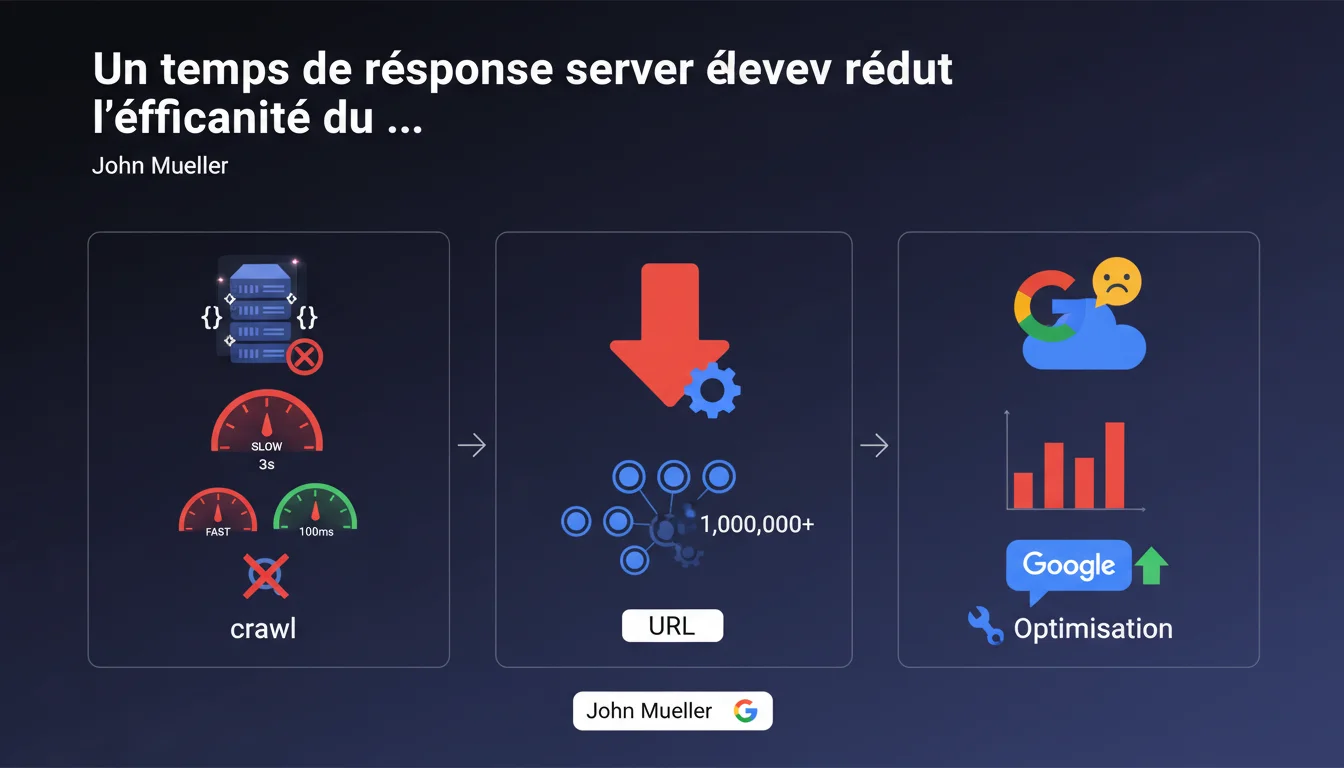

Un temps de réponse serveur élevé (3 secondes au lieu de 100 ms) multiplie par 20 à 30 le temps nécessaire pour crawler chaque URL. Sur des millions de pages, cela réduit drastiquement le nombre d'URLs que Googlebot peut explorer. L'optimisation du temps de réponse serveur devient alors un levier critique pour améliorer l'efficacité du crawl.

Ce qu'il faut comprendre

Quel est le lien direct entre temps de réponse serveur et crawl budget ?

Google alloue un budget de crawl à chaque site — un temps et un nombre de requêtes limités pour explorer vos pages. Si chaque requête consomme 3 secondes au lieu de 100 millisecondes, Googlebot peut crawler 20 à 30 fois moins d'URLs dans le même laps de temps.

Concrètement, un site qui pourrait théoriquement voir 10 000 pages crawlées par jour avec un temps de réponse optimal ne verra que 300 à 500 pages explorées si le serveur est lent. Pour les sites de plusieurs millions d'URLs, cela signifie que des pans entiers du contenu ne seront jamais vus par Google.

Pourquoi Google ne se contente-t-il pas d'augmenter le nombre de requêtes ?

Parce que Googlebot doit respecter les capacités du serveur. Augmenter le nombre de requêtes simultanées sur un serveur déjà lent risque de le surcharger et de dégrader l'expérience utilisateur pour les visiteurs réels.

Google adapte donc son rythme de crawl en fonction de la vitesse de réponse observée. Plus le serveur est lent, plus Googlebot ralentit — et plus votre crawl budget fond comme neige au soleil.

Quels sites sont les plus exposés à ce problème ?

Les sites volumineux (e-commerce, marketplaces, annuaires, médias) avec des milliers voire millions d'URLs sont les premiers concernés. Un site de 50 pages ne verra pas de différence notable — Google parviendra à tout crawler même avec un serveur médiocre.

En revanche, dès que vous dépassez les 10 000 à 100 000 pages, chaque milliseconde compte. Les sites techniques complexes (facettes, filtres, pagination infinie) avec une architecture mal optimisée cumulent les handicaps.

- Un temps de réponse serveur >1 seconde réduit drastiquement l'efficacité du crawl

- Les sites de plusieurs milliers d'URLs sont particulièrement vulnérables

- Google adapte son rythme de crawl pour ne pas surcharger les serveurs lents

- Optimiser le temps de réponse serveur libère du crawl budget pour explorer plus de pages

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Totalement. On observe régulièrement dans la Search Console des sites avec des milliers d'URLs découvertes mais non crawlées — et le temps de réponse serveur élevé figure parmi les causes principales.

Les tests de migration d'hébergement le confirment : passer d'un serveur lent (temps de réponse 1-2 secondes) à un serveur performant (100-200 ms) entraîne souvent une augmentation spectaculaire du nombre de pages crawlées dans les semaines suivantes. On parle parfois de +300% à +500%.

Quelles nuances faut-il apporter à ce constat ?

Soyons honnêtes : le temps de réponse serveur n'est qu'un paramètre parmi d'autres. Un serveur ultra-rapide ne sauvera pas un site avec une architecture catastrophique, des millions d'URLs dupliquées ou sans valeur ajoutée, ou une arborescence en silos étanches.

Google prend aussi en compte la popularité des pages, la fraîcheur du contenu, la qualité globale du site. Un serveur lent pénalise l'efficacité du crawl, mais ce n'est pas le seul facteur. [A vérifier] : Google ne communique pas de seuil précis à partir duquel le temps de réponse devient problématique — on parle souvent de 200-300 ms comme limite acceptable, mais c'est empirique.

Dans quels cas cette règle s'applique-t-elle moins ?

Sur les petits sites (moins de 1 000 pages), l'impact est négligeable. Google parvient à crawler l'intégralité du contenu même avec un serveur moyen. Le temps de réponse serveur devient critique à partir de plusieurs dizaines de milliers d'URLs.

Autre cas : les sites avec un très fort trafic organique ou une autorité établie bénéficient souvent d'un crawl budget plus généreux. Google crawle plus fréquemment et plus largement les sites qu'il juge importants — mais même dans ce cas, un serveur lent reste un frein.

Impact pratique et recommandations

Comment mesurer le temps de réponse serveur de mon site ?

Plusieurs outils permettent de mesurer le TTFB : Google Search Console (rapport Core Web Vitals), PageSpeed Insights, WebPageTest, GTmetrix, Pingdom. Visez un TTFB inférieur à 200 ms dans l'idéal, acceptable jusqu'à 500 ms, problématique au-delà.

Attention : testez depuis plusieurs localisations géographiques et à différents moments de la journée. Un TTFB de 150 ms en France à 3h du matin ne reflète pas forcément ce que Googlebot observe depuis les États-Unis en heure de pointe.

Quelles sont les causes les plus fréquentes d'un TTFB élevé ?

Hébergement sous-dimensionné : serveur mutualisé surchargé, ressources CPU/RAM insuffisantes, configuration serveur non optimisée. Les offres d'entrée de gamme à 5 € par mois ne sont pas adaptées aux sites ambitieux.

Base de données mal optimisée : requêtes SQL lentes, absence d'index, tables mal structurées, cache inexistant. Un site WordPress avec 50 plugins actifs et sans cache peut facilement atteindre 2-3 secondes de TTFB.

Code applicatif inefficace : boucles coûteuses, appels API externes bloquants, absence de mise en cache HTML. Un CMS mal configuré ou un développement custom sans optimisation génère souvent des temps de réponse catastrophiques.

Que faut-il faire concrètement pour optimiser le temps de réponse serveur ?

- Auditez le TTFB sur un échantillon représentatif d'URLs (homepage, catégories, produits, articles)

- Identifiez les goulots d'étranglement : base de données, requêtes externes, traitement serveur

- Mettez en place un cache serveur (Varnish, Redis, Memcached) pour servir les pages HTML pré-générées

- Optimisez les requêtes SQL : ajoutez des index, éliminez les requêtes redondantes, utilisez un cache de requêtes

- Activez un CDN pour rapprocher le contenu des utilisateurs et de Googlebot

- Si l'hébergement est en cause, migrez vers une infrastructure plus performante (VPS, cloud, serveur dédié)

- Surveillez le TTFB dans la durée avec des outils de monitoring (UptimeRobot, Pingdom, New Relic)

Un temps de réponse serveur élevé est un handicap majeur pour le crawl budget des sites volumineux. Google ne peut pas crawler efficacement si chaque requête prend plusieurs secondes. Optimiser le TTFB libère du crawl budget, permet à Google d'explorer plus de pages, et améliore l'indexation du contenu.

La mise en œuvre technique de ces optimisations — configuration serveur, tuning de base de données, mise en cache avancée — peut s'avérer complexe, surtout sur des infrastructures existantes. Si vous gérez un site de plusieurs milliers d'URLs et que le temps de réponse serveur reste un point de blocage, faire appel à une agence SEO spécialisée en audit technique peut vous faire gagner un temps précieux et éviter des erreurs coûteuses.

❓ Questions frequentes

Quelle est la différence entre TTFB et temps de chargement de la page ?

Un CDN améliore-t-il le TTFB pour Googlebot ?

A partir de quel volume d'URLs le TTFB devient-il critique ?

Le TTFB impacte-t-il directement le classement dans les résultats de recherche ?

Comment voir le TTFB dans Google Search Console ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 08/08/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.