Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Le crawl intensif garantit-il vraiment un site de qualité ?

- □ Peut-on vraiment augmenter le crawl budget de son site en contactant Google ?

- □ Pourquoi Google crawle-t-il certains sites plus souvent que d'autres ?

- □ Pourquoi Google insiste-t-il sur l'implémentation du header If-Modified-Since ?

- □ Les paramètres d'URL créent-ils vraiment un espace de crawl infini pour Google ?

- □ Pourquoi les hashtags et ancres d'URL compliquent-ils le crawl de Google ?

- □ Pourquoi Google insiste-t-il autant sur les statistiques d'exploration dans Search Console ?

- □ Pourquoi un temps de réponse serveur lent tue-t-il votre crawl budget ?

- □ Googlebot suit-il vraiment les liens comme un utilisateur navigue de page en page ?

- □ Faut-il vraiment optimiser le crawl budget si Google a des ressources illimitées ?

- □ Les sitemaps sont-ils vraiment indispensables pour optimiser le crawl de votre site ?

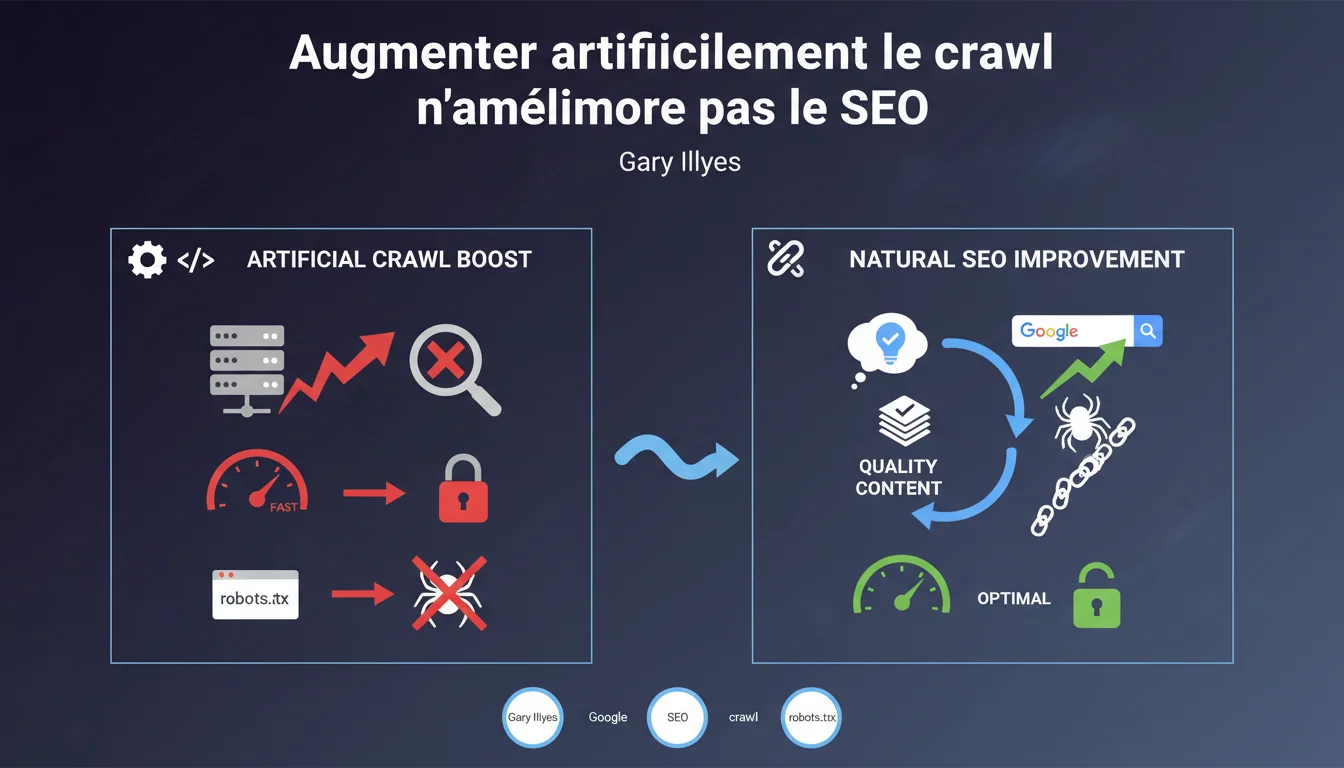

Augmenter artificiellement le crawl d'un site via des manipulations techniques ne sert à rien pour le SEO. Google ajuste automatiquement la fréquence de crawl en fonction de la qualité du contenu et de la popularité du site — c'est une conséquence, pas un levier.

Ce qu'il faut comprendre

Le crawl budget, c'est quoi exactement ?

Le crawl budget désigne le nombre de pages que Googlebot explore sur un site pendant une période donnée. Ce volume n'est pas fixe : il varie selon la santé technique du serveur, la fraîcheur du contenu et surtout la popularité perçue du site.

Google alloue ses ressources de crawl là où ça compte — les sites à forte valeur ajoutée reçoivent naturellement plus d'attention. Vouloir manipuler ce système avec des astuces techniques (forcer des recrawls via robots.txt, pinger excessivement l'API Indexing, etc.) revient à confondre cause et effet.

Pourquoi vouloir augmenter le crawl ne change rien au classement ?

Parce que le crawl n'est qu'une étape logistique. Crawler plus souvent ne rend pas votre contenu meilleur. Si vos pages n'apportent rien de neuf ou de qualitatif, Google peut les visiter 10 fois par jour — elles ne remonteront pas dans les résultats pour autant.

La vraie mécanique, c'est que Google intensifie le crawl quand il détecte des signaux positifs : nouveau contenu pertinent, augmentation du trafic référent, liens entrants de qualité. Le crawl suit la performance, il ne la crée pas.

Concrètement, qu'est-ce qui augmente naturellement le crawl ?

Plusieurs facteurs incitent Google à revenir plus souvent : publication régulière de contenu original et recherché, acquisition de backlinks depuis des sites d'autorité, amélioration de la vitesse de réponse du serveur, et élimination des erreurs techniques qui gaspillent le budget de crawl.

En clair, c'est la qualité globale de votre écosystème qui déclenche un cercle vertueux — pas une manip' dans un fichier texte.

- Le crawl budget est une conséquence, pas un levier direct de ranking

- Forcer le crawl sans améliorer le contenu ne sert strictement à rien

- Google alloue ses ressources aux sites qui prouvent leur valeur via des signaux externes et internes

- Optimiser le crawl consiste surtout à éliminer les obstacles (erreurs 404, redirections inutiles, duplicate content) pour que Google explore efficacement vos meilleures pages

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui, et c'est même l'une des rares affirmations de Google qu'on peut valider facilement en consultant les logs serveur. Les sites qui tentent de gonfler artificiellement leur crawl via des pings répétés ou des modifications inutiles de robots.txt ne constatent aucune amélioration de positionnement.

En revanche, les sites qui publient du contenu à forte demande et qui gagnent des liens naturels voient leur crawl exploser — sans avoir rien demandé. C'est un indicateur retardé, pas un déclencheur.

Quelles nuances faut-il apporter à cette règle ?

Il existe des cas où optimiser le crawl a un impact indirect mais réel. Sur les très gros sites (e-commerce massif, médias avec des milliers de pages), un crawl mal distribué peut empêcher l'indexation de pages stratégiques au profit de pages zombies.

Dans ce contexte, réduire le gaspillage de crawl (bloquer les facettes inutiles, prioriser le maillage interne vers les pages à forte valeur) libère du budget pour les bonnes pages. Mais encore une fois, ce n'est pas « augmenter le crawl » — c'est le rendre plus intelligent.

Où est-ce que Google reste flou ?

Gary Illyes parle de « qualité du contenu » sans jamais définir précisément ce qui déclenche une hausse de crawl. [À vérifier] : quels sont les seuils exacts d'engagement utilisateur, de taux de clic, ou de freshness qui font basculer un site dans une catégorie « prioritaire » pour Googlebot ?

On sait que ça existe (les sites d'actualité sont crawlés en quasi-temps réel), mais les critères restent opaques. Ce flou permet à Google de dire « faites du bon contenu » sans jamais donner de métriques actionnables.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser le crawl ?

D'abord, cessez de chercher à forcer la machine. Concentrez-vous sur l'élimination des freins : pages en erreur, chaînes de redirections, contenu dupliqué massif, facettes de filtres crawlables à l'infini.

Ensuite, orientez le crawl vers vos pages stratégiques via un maillage interne cohérent. Plus une page reçoit de liens internes pertinents, plus elle a de chances d'être crawlée fréquemment.

- Auditez vos logs serveur pour identifier les pages sur-crawlées sans valeur SEO

- Bloquez via robots.txt ou noindex les sections inutiles (pages de recherche interne, filtres sans trafic, archives obsolètes)

- Priorisez le maillage interne vers les pages à fort potentiel commercial ou informationnel

- Publiez régulièrement du contenu original qui répond à une vraie demande de recherche

- Améliorez le temps de réponse serveur — un site lent se fait moins crawler

- Obtenez des backlinks de qualité, qui signalent à Google que votre site mérite attention

Quelles erreurs éviter absolument ?

Ne pingez pas l'API Indexing de Google pour des pages classiques — elle est réservée aux contenus vidéo structurés ou aux offres d'emploi. Utiliser cette API sur du contenu standard peut être perçu comme du spam et nuire à votre crawl.

Évitez aussi de modifier sans cesse votre robots.txt ou sitemap.xml en pensant que ça va accélérer quoi que ce soit. Google détecte ces manipulations et ne réagit pas comme vous l'espérez.

Comment vérifier que votre stratégie fonctionne ?

Analysez vos logs serveur sur plusieurs semaines. Regardez si Googlebot explore vos nouvelles pages stratégiques dans un délai raisonnable (48-72h pour un site moyen, quasi-instantané pour un média). Si ce n'est pas le cas, c'est un signal que votre maillage interne ou votre pertinence globale pose problème.

Surveillez aussi l'évolution du nombre de pages indexées via Google Search Console. Une stagnation alors que vous publiez du contenu indique soit un problème technique, soit un déficit de qualité perçue.

❓ Questions frequentes

Modifier mon sitemap.xml plus souvent va-t-il accélérer l'indexation ?

L'API Indexing peut-elle forcer Google à indexer n'importe quel contenu ?

Pourquoi Google crawle-t-il des pages inutiles au lieu de mes nouvelles pages ?

Un site lent est-il moins crawlé ?

Le crawl budget est-il réellement un problème pour les petits sites ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 08/08/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.