Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Googlebot stocke-t-il les cookies lors de l'exploration de votre site ?

- □ Le dynamic rendering avec parité de contenu est-il vraiment sans risque pour l'indexation ?

- □ Les crawlers Google se comportent-ils vraiment comme de vrais navigateurs ?

- □ Pourquoi tester votre site avec un émulateur de user agent ne suffit-il pas à détecter les problèmes de crawl ?

- □ Pourquoi tester votre site avec un crawler est-il indispensable pour le SEO ?

- □ Pourquoi Google refuse-t-il la pagination basée sur les cookies ?

- □ Les cookies bloquent-ils vraiment l'accès des bots à votre contenu ?

- □ Les sites qui dépendent des cookies sont-ils invisibles pour Googlebot ?

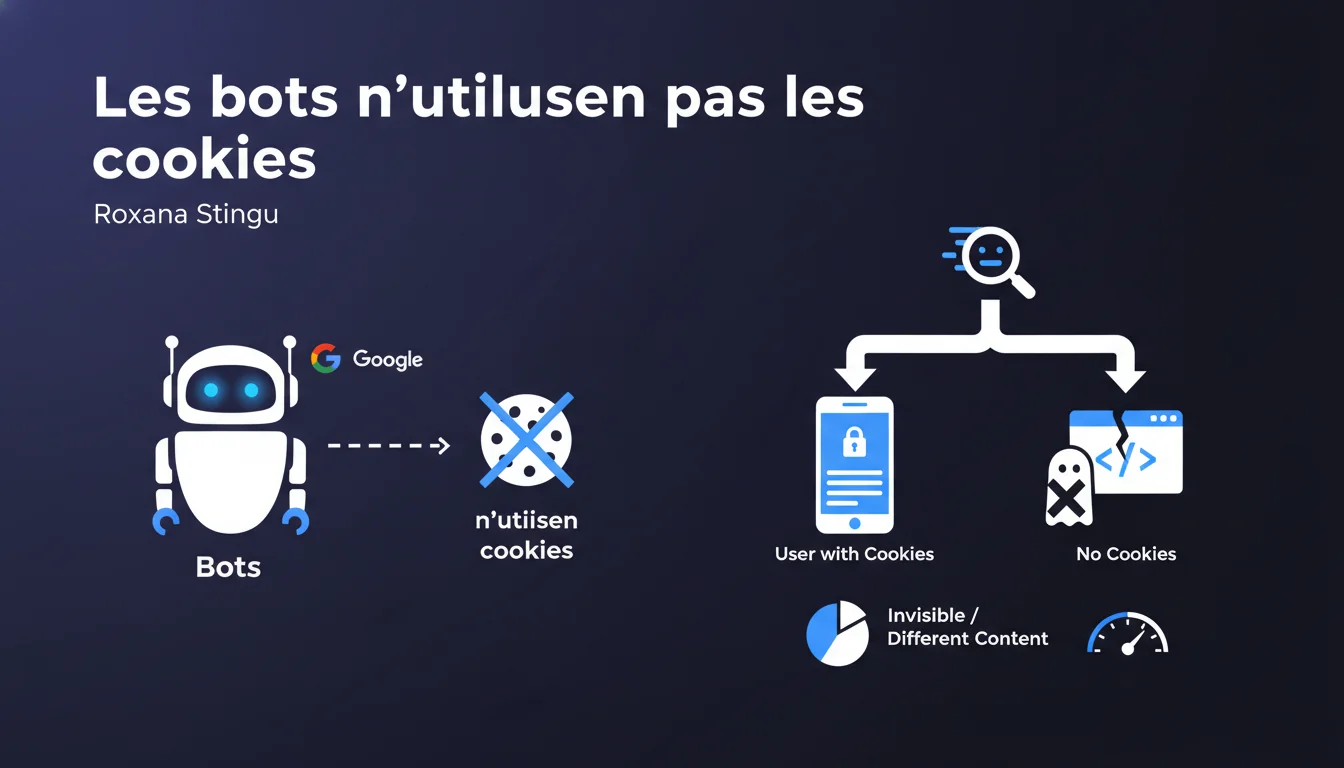

Googlebot et les autres crawlers ne stockent aucun cookie, ce qui signifie que tout contenu ou fonctionnalité reposant sur des cookies reste invisible pour eux. Si votre site conditionne l'affichage de contenus stratégiques à la présence de cookies, Google ne les verra jamais — et ne les indexera jamais.

Ce qu'il faut comprendre

Qu'est-ce que cela signifie concrètement pour l'exploration de mon site ?

Googlebot n'exécute pas de session persistante. Il arrive, crawle, repart. Aucun cookie n'est conservé entre deux passages, aucune session utilisateur n'est simulée. Si vous cachez du contenu derrière une bannière de consentement qui nécessite un cookie pour disparaître, Googlebot verra la bannière. Toujours.

Même logique pour les contenus débloqués après interaction (scroll infini conditionné, modales fermées par cookie). Si le mécanisme repose sur un cookie client, le bot ne franchit pas l'étape. Il voit l'état initial, celui qu'un visiteur lambda découvre sans historique de navigation.

Cette règle s'applique-t-elle uniquement à Googlebot ?

Non. Roxana Stingu le précise : tous les bots en général fonctionnent ainsi. Bing, Yandex, les crawlers SEO (Screaming Frog, Oncrawl, Botify), les robots sociaux (Facebook, Twitter) — aucun ne conserve de cookies. C'est un comportement standard, pas une spécificité Google.

Cela veut dire que vos tests avec des outils comme Screaming Frog reflètent fidèlement ce que voit Googlebot sur ce point. Pas de surprise à attendre côté exploration si votre crawler SEO valide l'accessibilité du contenu.

Quels types de fonctionnalités sont concernés ?

Tout mécanisme front-end qui stocke un état via cookie pour débloquer, masquer ou modifier du contenu. Les cas les plus fréquents : bannières RGPD qui masquent le contenu tant qu'on n'a pas cliqué, paywalls qui autorisent X articles avant blocage (cookie de compteur), contenus personnalisés selon préférences (langue, région), A/B tests pilotés par cookie.

- Bannières de consentement : si elles bloquent l'affichage du contenu, Googlebot voit l'écran de blocage

- Paywalls progressifs : le compteur d'articles gratuits ne fonctionne pas, le bot voit l'état « quota épuisé » si c'est le défaut

- Contenus conditionnels : tout ce qui s'affiche « après première visite » ou « après action utilisateur » enregistrée en cookie disparaît pour les crawlers

- Sessions utilisateur : connexion, panier e-commerce, préférences — rien de tout ça n'existe pour un bot

- A/B testing : Googlebot verra toujours la même variante, celle servie par défaut sans cookie de segmentation

Avis d'un expert SEO

Cette déclaration surprend-elle vraiment les praticiens SEO ?

Soyons honnêtes : non. C'est une confirmation de ce qu'on observe terrain depuis des années. Les bots ne simulent pas de vraies sessions utilisateur, ils ne cliquent pas, ne scrollent pas (sauf JavaScript rendering limité), ne valident pas de formulaires. L'absence de gestion des cookies est cohérente avec ce comportement.

Mais le rappel reste utile. Trop de sites e-commerce ou médias déploient encore des bannières RGPD qui masquent le contenu principal tant qu'on n'a pas accepté les cookies. Résultat : Googlebot indexe… la bannière. Pas le produit, pas l'article. Et ensuite, on s'étonne d'un effondrement du taux d'indexation.

Dans quels cas cette règle pose-t-elle problème en pratique ?

Le piège classique : les bannières de consentement mal implémentées. Si votre overlay RGPD bloque l'accès au contenu HTML (display:none sur le body, z-index 9999 sur la modale), Googlebot ne verra rien d'autre. Certains développeurs pensent que « ça ne gêne pas le SEO » parce que « le contenu est dans le DOM ». Faux si le CSS ou le JS le masque avant que le bot ne rende la page.

Autre cas épineux : les paywalls. Si vous comptez sur un cookie pour autoriser 3 articles gratuits avant blocage, Googlebot verra systématiquement l'état bloqué — sauf si vous servez une exception côté serveur pour le user-agent Googlebot. Mais attention, Google détecte le cloaking si le contenu servi aux bots diffère radicalement de celui vu par les utilisateurs. [A vérifier] : jusqu'où peut-on aller dans la différenciation bot/user sans risquer une pénalité ? Google reste flou sur la frontière exacte.

Quelles nuances faut-il apporter à cette déclaration ?

Googlebot n'utilise pas les cookies, mais il exécute du JavaScript et peut donc théoriquement interagir avec du localStorage ou sessionStorage. Cependant, ces mécanismes ne persistent pas non plus entre deux crawls distincts. En revanche, si votre JS lit un paramètre UTM, un hash d'URL ou une variable serveur pour débloquer du contenu, Googlebot peut y accéder.

Autre nuance : Googlebot respecte les Set-Cookie envoyés par le serveur pendant une même session de crawl (une séquence de requêtes liées). Mais il ne les stocke pas pour sa prochaine visite. Concrètement, si votre serveur envoie un cookie de session et que Googlebot suit un lien interne immédiatement après, il peut renvoyer ce cookie dans la requête suivante — mais uniquement dans cette fenêtre de crawl.

Impact pratique et recommandations

Que faut-il vérifier immédiatement sur mon site ?

Lancez un crawl avec Screaming Frog ou Oncrawl sans cookies activés. Comparez avec un crawl navigateur classique (avec cookies). Si des URLs critiques deviennent inaccessibles, si du contenu disparaît, si des bannières masquent vos H1, vous avez un problème. C'est exactement ce que voit Googlebot.

Testez particulièrement les pages stratégiques : fiches produits, articles de blog, landing pages SEA. Si elles nécessitent une interaction cookie pour afficher le contenu principal, refactorisez. Le contenu doit être accessible au premier chargement HTML, sans condition.

Comment gérer correctement les bannières RGPD sans nuire au SEO ?

La solution propre : afficher la bannière en overlay non bloquant. Le contenu reste visible en dessous, le DOM est intégralement accessible, et Googlebot indexe normalement. Utilisez un z-index pour superposer la bannière, mais ne masquez jamais le body ni les éléments principaux avec display:none ou visibility:hidden conditionnés à un cookie.

Si vous devez absolument bloquer l'interaction utilisateur (défilement, clics), faites-le via JavaScript côté client — mais laissez le HTML et le CSS afficher le contenu normalement. Googlebot rendra la page, verra le contenu, ignorera la bannière JavaScript qui attend un clic.

- Crawlez votre site avec un bot SEO sans cookies pour détecter les contenus masqués

- Vérifiez que les bannières RGPD n'utilisent pas display:none sur le contenu principal

- Testez l'affichage des pages en mode navigation privée (pas de cookies) : ce que vous voyez = ce que voit Googlebot

- Si vous utilisez un paywall, implémentez une exception serveur pour Googlebot (structured data Article, FirstClick Free) sans cloaking abusif

- Auditez les A/B tests : Googlebot doit toujours voir une version stable et indexable (utilisez les variants côté client, pas serveur)

- Supprimez toute dépendance cookie pour l'affichage des éléments SEO critiques (titres, textes, images, liens internes)

- Documentez les exceptions user-agent si vous servez du contenu différencié aux bots (et justifiez-les par une raison légitime, jamais du cloaking pur)

❓ Questions frequentes

Googlebot peut-il quand même lire les cookies envoyés par mon serveur ?

Si j'utilise localStorage au lieu de cookies, Googlebot y a-t-il accès ?

Ma bannière RGPD bloque-t-elle vraiment l'indexation de mon contenu ?

Puis-je servir une version différente de mon site à Googlebot pour contourner ce problème ?

Les autres moteurs de recherche (Bing, Yandex) fonctionnent-ils pareil ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 15/11/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.