Declaration officielle

Ce qu'il faut comprendre

Qu'est-ce que le rendu (rendering) par les robots Google ?

Le rendering désigne le processus par lequel un robot d'exploration exécute le JavaScript et affiche la page comme le ferait un navigateur web. Cette étape permet à Google de voir le contenu généré dynamiquement par JavaScript, qui n'apparaît pas dans le code HTML initial.

Contrairement à une idée reçue, cette opération coûteuse en ressources n'est pas systématique. Google doit choisir stratégiquement quand investir dans cette phase de rendu.

Pourquoi tous les robots Google ne font-ils pas de rendering ?

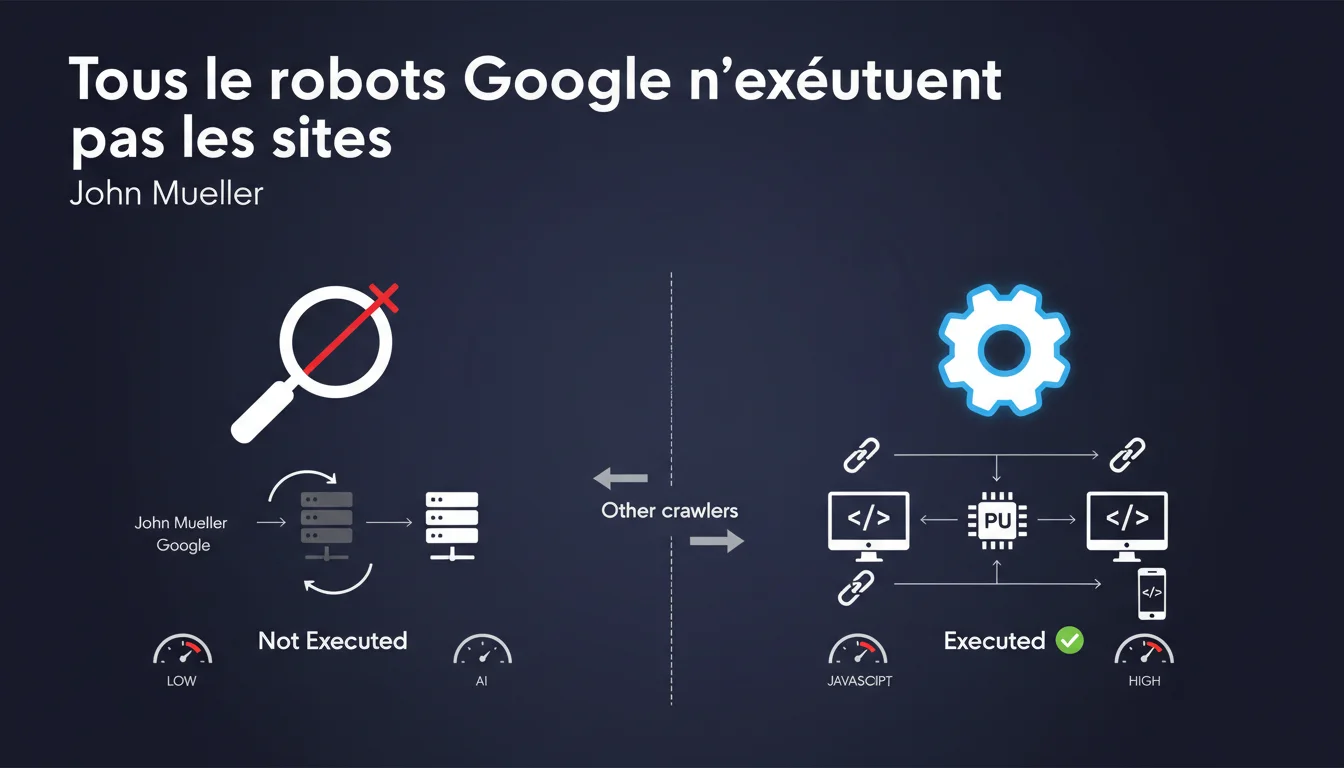

Google dispose de multiples robots spécialisés ayant chacun des missions différentes. Le Googlebot principal pour desktop et mobile doit voir le contenu complet pour l'indexation, donc il effectue le rendering.

En revanche, des robots comme le Googlebot Site Verifier (qui vérifie la propriété d'un site) ou le Googlebot Favicon (qui récupère l'icône du site) n'ont pas besoin d'exécuter JavaScript. Ils effectuent simplement des requêtes HTTP basiques pour accomplir leur tâche spécifique.

Quels sont les robots qui effectuent ou non le rendering ?

Les robots indexeurs principaux (Googlebot pour desktop et mobile) effectuent le rendering pour accéder au contenu complet de vos pages. C'est essentiel pour l'indexation et le classement dans les résultats de recherche.

Les robots utilitaires et secondaires se contentent généralement d'un crawl basique sans JavaScript.

- Avec rendering : Googlebot Desktop, Googlebot Mobile (indexation principale)

- Sans rendering : Googlebot Site Verifier, Googlebot Favicon, certains crawls de vérification technique

- Le rendering est une opération coûteuse réservée aux situations où voir le contenu final est nécessaire

- Cette différenciation permet à Google d'optimiser ses ressources de crawl

Avis d'un expert SEO

Cette distinction impacte-t-elle réellement les stratégies SEO ?

Cette déclaration confirme ce que les experts SEO observent depuis longtemps : Google optimise constamment ses ressources de crawl. Le rendering étant coûteux, il est logique de ne l'appliquer qu'aux robots qui en ont réellement besoin.

Pour les praticiens SEO, cela signifie qu'il faut concentrer ses efforts sur les robots indexeurs principaux. Les autres robots accomplissent des tâches périphériques qui n'affectent pas directement le positionnement.

Quelles nuances importantes faut-il apporter à cette affirmation ?

Même les robots indexeurs principaux ne font pas toujours du rendering immédiat. Google utilise un système de crawl en deux phases : d'abord le HTML brut, puis le rendering JavaScript si nécessaire et si les ressources le permettent.

Ce délai entre les deux phases peut atteindre plusieurs jours, voire semaines sur des sites avec un budget de crawl limité. C'est pourquoi le SSR (Server-Side Rendering) ou la génération statique restent préférables au JavaScript pur côté client.

Dans quels cas cette architecture pose-t-elle des problèmes SEO ?

Les sites entièrement basés sur des frameworks JavaScript (React, Vue, Angular) sans pré-rendering restent vulnérables. Si le contenu essentiel n'apparaît qu'après l'exécution JavaScript, il peut ne pas être indexé immédiatement.

Les sites e-commerce avec des milliers de pages produits générées en JavaScript sont particulièrement concernés. Un nouveau produit pourrait mettre des semaines à être correctement indexé si Google attend la phase de rendering.

Impact pratique et recommandations

Comment optimiser son site pour cette réalité du crawl Google ?

La stratégie optimale consiste à ne pas dépendre uniquement du rendering JavaScript. Votre contenu critique doit être présent dans le HTML initial, accessible lors du premier crawl sans exécution de code.

Privilégiez les approches hybrides : SSR (Server-Side Rendering), génération statique ou hydratation progressive. Ces techniques garantissent que les robots voient immédiatement votre contenu, même sans rendering.

Quelles erreurs techniques faut-il absolument éviter ?

N'utilisez jamais JavaScript pour afficher des éléments SEO critiques comme les titres H1, les descriptions de produits, ou les liens de navigation principaux. Ces éléments doivent être présents dans le HTML source.

Évitez également de bloquer les ressources JavaScript ou CSS dans le robots.txt, car cela empêcherait Google de faire correctement le rendering même quand il le souhaite.

- Vérifiez que votre contenu principal apparaît dans le HTML source (view-source dans le navigateur)

- Testez vos pages avec l'outil Inspection d'URL de la Search Console pour voir ce que Google indexe réellement

- Comparez le HTML brut et le HTML rendu pour identifier les écarts de contenu

- Implémentez du SSR ou de la génération statique pour les pages stratégiques (pages produits, catégories, articles)

- Surveillez les délais d'indexation de vos nouvelles pages dans la Search Console

- Configurez correctement votre robots.txt pour ne pas bloquer les ressources nécessaires au rendering

- Auditez régulièrement vos logs serveur pour comprendre quels robots crawlent votre site et avec quelle fréquence

Faut-il faire appel à des experts pour cette optimisation ?

L'architecture technique d'un site moderne nécessite des compétences pointues en développement front-end et SEO technique. Migrer d'une architecture JavaScript client-side vers du SSR ou de la génération statique représente un projet d'envergure.

Ces optimisations touchent au cœur de votre stack technique et peuvent être complexes à mettre en œuvre correctement. Elles nécessitent une coordination entre équipes SEO et développement, ainsi qu'une compréhension fine des mécanismes de crawl et d'indexation.

💬 Commentaires (0)

Soyez le premier à commenter.