Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Googlebot stocke-t-il les cookies lors de l'exploration de votre site ?

- □ Pourquoi les robots d'exploration ignorent-ils systématiquement vos cookies ?

- □ Les crawlers Google se comportent-ils vraiment comme de vrais navigateurs ?

- □ Pourquoi tester votre site avec un émulateur de user agent ne suffit-il pas à détecter les problèmes de crawl ?

- □ Pourquoi tester votre site avec un crawler est-il indispensable pour le SEO ?

- □ Pourquoi Google refuse-t-il la pagination basée sur les cookies ?

- □ Les cookies bloquent-ils vraiment l'accès des bots à votre contenu ?

- □ Les sites qui dépendent des cookies sont-ils invisibles pour Googlebot ?

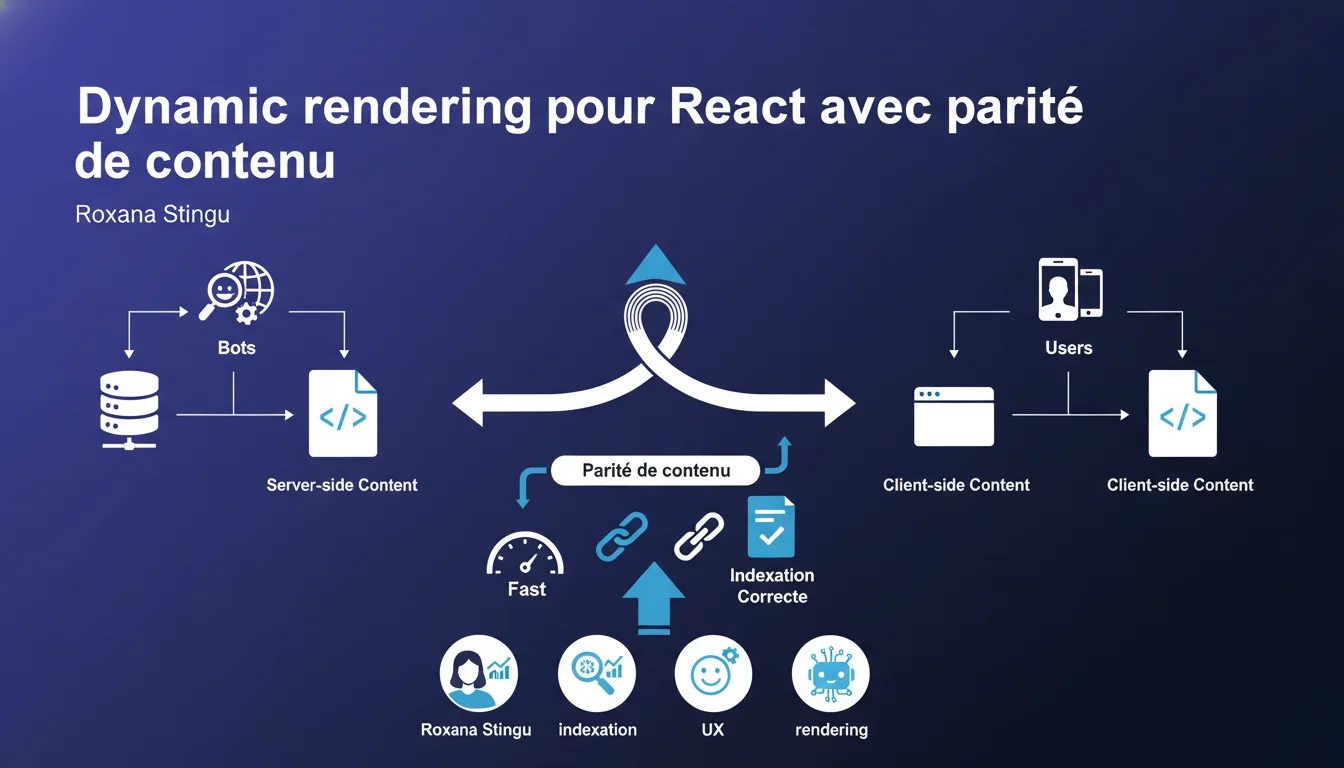

Google autorise le dynamic rendering à condition de maintenir une parité stricte entre le contenu server-side servi aux bots et le client-side pour les utilisateurs. Aucune divergence n'est tolérée — la moindre différence peut compromettre l'indexation. Cette technique reste une solution de contournement, pas une recommandation officielle.

Ce qu'il faut comprendre

Qu'est-ce que le dynamic rendering et pourquoi Google l'évoque-t-il ?

Le dynamic rendering consiste à servir deux versions différentes d'une même page : du contenu server-side rendu (SSR) aux crawlers et du client-side rendu (CSR) aux utilisateurs. Cette approche a émergé comme solution temporaire pour les sites React ou Vue.js qui peinent à être correctement crawlés.

Google ne recommande pas activement cette méthode, mais reconnaît qu'elle peut fonctionner dans certains contextes. La déclaration de Roxana Stingu pose une condition non négociable : la parité totale entre les deux versions.

Que signifie concrètement la « parité de contenu » ?

La parité signifie que le HTML servi à Googlebot doit contenir exactement les mêmes informations que ce que voit un utilisateur une fois la page chargée. Pas de raccourcis. Pas de simplifications. Pas de contenu caché côté bot.

Si votre version SSR affiche 10 produits et que votre CSR en charge 50 via un scroll infini, vous n'êtes pas en parité. Si vos filtres de recherche ne sont présents que côté client, vous n'êtes pas en parité. Si vos boutons d'action génèrent du contenu que le bot ne voit jamais, vous n'êtes pas en parité.

Pourquoi cette exigence de parité est-elle si stricte ?

Google lutte depuis des années contre le cloaking — servir un contenu différent aux bots et aux utilisateurs pour manipuler les résultats. Le dynamic rendering frôle cette ligne rouge par définition.

En exigeant une parité totale, Google s'assure que vous n'utilisez pas cette technique pour tromper l'indexation. Toute divergence peut être interprétée comme une tentative de manipulation, avec les conséquences qu'on connaît.

- Parité stricte obligatoire : aucune divergence tolérée entre SSR et CSR

- Solution de contournement : Google préfère le SSR natif ou l'hydratation côté serveur

- Risque de cloaking : toute différence peut déclencher une pénalité manuelle

- Complexité technique : maintenir deux versions synchronisées demande des ressources

Avis d'un expert SEO

Cette approche est-elle vraiment viable à long terme ?

Soyons honnêtes : le dynamic rendering est un sparadrap technique, pas une architecture pérenne. Maintenir deux rendus parfaitement synchronisés sur un site qui évolue quotidiennement ? C'est un cauchemar opérationnel.

Chaque ajout de feature, chaque A/B test, chaque widget tiers risque de casser la parité. Et le pire, c'est que vous ne vous en rendrez compte qu'après une chute de trafic. Les outils de monitoring classiques ne détectent pas ces divergences — il faut des audits réguliers comparant les deux versions.

Google dit-il toute la vérité sur ses capacités de rendu ?

[A verifier] Google affirme depuis des années que son crawler "exécute le JavaScript". Techniquement vrai. En pratique ? Beaucoup plus nuancé.

Les tests terrain montrent que Googlebot a des timeouts courts, ne gère pas toujours les interactions complexes, peut rater du contenu chargé après un délai ou conditionné à une action utilisateur. Le dynamic rendering existe précisément parce que le rendu JS côté Google n'est pas fiable à 100%.

Si Google avait totalement résolu le problème du rendu JS, cette déclaration n'existerait même pas. Le fait qu'on en parle encore prouve que c'est un sujet sensible.

Dans quels cas cette solution est-elle défendable ?

Le dynamic rendering peut se justifier sur des sites legacy React/Angular déjà en production, où une refonte complète en SSR coûterait trop cher à court terme. C'est une rustine qui achète du temps.

Mais attention — et c'est crucial — cette approche ne doit jamais être le plan A pour un nouveau projet. Si vous développez aujourd'hui avec Next.js, Nuxt ou Remix, vous avez accès au SSR natif ou à l'hydratation progressive. Pourquoi choisir la complexité ?

Impact pratique et recommandations

Comment vérifier que votre parité est respectée ?

Première étape : comparer les deux versions de manière systématique. Utilisez un user-agent Googlebot pour récupérer le HTML SSR, puis inspectez le DOM final côté client avec les DevTools. Chaque élément clé doit être présent dans les deux.

Les outils comme Screaming Frog permettent de crawler en mode "JavaScript" et "HTML brut". Comparez les deux exports — URLs indexables, titres, contenus, liens internes. Toute divergence est un signal d'alarme.

- Crawler le site avec et sans rendu JavaScript activé

- Comparer les balises title, meta description, h1-h3 entre les deux versions

- Vérifier que les liens internes sont identiques (même href, même ancre)

- Tester les pages produits, catégories et landing pages critiques manuellement

- Monitorer les logs serveur pour détecter des différences de réponse HTTP selon l'user-agent

- Automatiser ces tests dans votre CI/CD pour éviter les régressions

Quelles erreurs critiques faut-il éviter absolument ?

L'erreur la plus fréquente : oublier du contenu dynamique côté SSR. Filtres de recherche, boutons "Voir plus", contenu conditionnel basé sur des cookies — tout ce qui apparaît côté client doit être présent côté bot.

Autre piège classique : les lazy-loaded images ou sections qui ne se chargent qu'au scroll. Si votre SSR ne les inclut pas avec un attribut `src` valide, Google ne les verra jamais.

Et surtout, ne tombez pas dans le cloaking involontaire. Servir une version "allégée" aux bots pour améliorer la vitesse ? C'est tentant, mais c'est exactement ce que Google punit. La parité n'est pas négociable.

Quelle est la meilleure stratégie à moyen terme ?

Si vous êtes en dynamic rendering aujourd'hui, planifiez une migration vers du SSR natif ou de l'hydratation progressive. Les frameworks modernes (Next.js, Remix, SvelteKit) rendent cette transition plus simple qu'avant.

Le ROI est double : vous éliminez la complexité de maintenir deux versions et vous améliorez les Core Web Vitals. Le SSR bien configuré réduit le Time to First Byte et le First Contentful Paint — deux métriques que Google valorise.

❓ Questions frequentes

Le dynamic rendering est-il considéré comme du cloaking par Google ?

Peut-on utiliser le dynamic rendering uniquement pour certaines pages ?

Comment détecter une rupture de parité avant que Google ne s'en aperçoive ?

Le dynamic rendering impacte-t-il les Core Web Vitals ?

Google crawle-t-il vraiment toujours avec JavaScript activé aujourd'hui ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 15/11/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.