Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Les snippets mal optimisés peuvent-ils vraiment faire chuter votre trafic organique ?

- □ Pourquoi vos requêtes de crawl tombent-elles à zéro dans Search Console ?

- □ Robots.txt en disallow bloque-t-il vraiment la génération de snippets dans les SERP ?

- □ Search Console suffit-il vraiment à détecter tous vos problèmes de crawl ?

- □ Search Console suffit-elle vraiment pour diagnostiquer vos problèmes d'indexation ?

- □ Quels outils Google faut-il vraiment utiliser pour auditer correctement un site ?

- □ Lighthouse peut-il vraiment remplacer un audit SEO professionnel ?

- □ Un robots.txt mal configuré peut-il vraiment bloquer vos snippets et votre crawl ?

- □ Faut-il vraiment monitorer votre robots.txt en continu ?

- □ Faut-il bloquer certaines sections de votre site dans le robots.txt ?

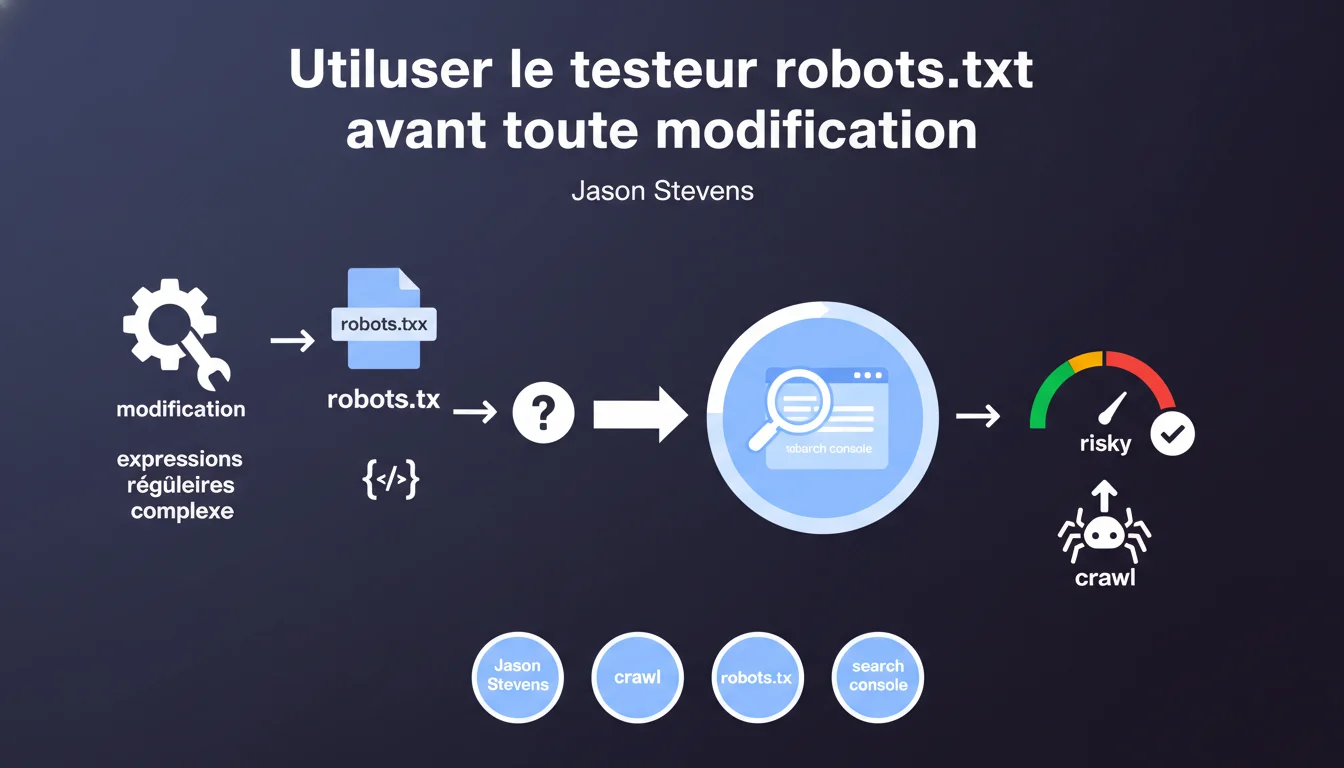

Google recommande d'utiliser systématiquement l'outil de test robots.txt de Search Console avant toute modification du fichier. L'objectif : anticiper l'impact des changements sur le crawl, surtout avec les expressions régulières complexes qui peuvent bloquer des sections entières du site par erreur.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il sur ce test préalable ?

Le fichier robots.txt contrôle l'accès des crawlers à vos contenus. Une simple erreur de syntaxe ou une regex mal calibrée peut interdire l'indexation de milliers de pages en quelques secondes. Google a visiblement constaté que de nombreux sites se tirent une balle dans le pied avec des modifications non testées.

L'outil de test de Search Console permet de simuler le comportement de Googlebot face à une URL donnée, avant même de déployer le fichier modifié en production. C'est un filet de sécurité indispensable, surtout quand on manipule des wildcards ou des expressions régulières.

Quelles sont les erreurs les plus fréquentes dans robots.txt ?

Les blocages accidentels représentent la majorité des incidents. Un Disallow: /*? mal placé peut interdire toutes les URLs avec paramètres, y compris des catégories essentielles. Les regex complexes amplifient ce risque : une parenthèse oubliée, et c'est l'ensemble d'un répertoire qui devient invisible.

Autre piège classique : confondre l'ordre des directives. Googlebot applique la règle la plus spécifique, pas forcément celle qu'on croit prioritaire. Sans test, impossible de vérifier l'interprétation réelle du moteur.

Que permet concrètement l'outil de test Search Console ?

L'outil affiche en temps réel si une URL sera autorisée ou bloquée selon le contenu du robots.txt testé. On peut modifier le fichier directement dans l'interface, lancer la simulation, et voir immédiatement les conséquences sur n'importe quelle URL du site.

C'est particulièrement précieux pour valider des patterns complexes avant déploiement. Soyons honnêtes : personne ne maîtrise parfaitement la syntaxe des regex dès le premier jet.

- Le robots.txt contrôle le crawl, pas l'indexation (une URL bloquée peut quand même apparaître dans les résultats)

- Une erreur dans robots.txt peut rendre invisible des sections entières du site en quelques minutes

- L'outil de test Search Console simule le comportement réel de Googlebot avant déploiement

- Les expressions régulières complexes sont la principale source d'erreurs de blocage accidentel

- La règle la plus spécifique l'emporte, pas forcément celle positionnée en premier

Avis d'un expert SEO

Cette recommandation est-elle vraiment suivie sur le terrain ?

Dans la pratique, la majorité des modifications de robots.txt se font encore en direct, sans validation préalable. Les équipes techniques traitent ce fichier comme un simple .txt à éditer en SSH — et découvrent les dégâts après coup, quand le trafic organique s'effondre.

Le problème ? L'outil de Search Console n'est pas intégré aux workflows de déploiement. Les devs ne vont pas naturellement dans GSC pour tester un fichier texte. Il manque une validation automatisée dans les pipelines CI/CD qui refuserait un déploiement sans test préalable.

Quelles limites présente l'outil de test de Google ?

L'outil teste une URL à la fois. Si vous modifiez une regex censée impacter 50 000 URLs, vous devrez tester manuellement plusieurs échantillons représentatifs. Pas de rapport global du type "ces 12 000 pages seront désormais bloquées".

Autre limite : l'outil ne simule que Googlebot. Si vous gérez des directives spécifiques pour Bingbot ou d'autres crawlers, vous naviguez à l'aveugle. [A vérifier] : Google ne communique pas sur la fréquence de mise à jour de son parseur robots.txt dans l'outil — on suppose qu'il suit les specs standards, mais aucune garantie officielle.

Dans quels cas peut-on se permettre de sauter cette étape ?

Soyons pragmatiques : un ajout simple comme Disallow: /admin/ sur un répertoire clairement identifié ne nécessite pas forcément un test élaboré. Le risque est quasi nul si la syntaxe est élémentaire et la cible explicite.

En revanche, dès qu'interviennent des wildcards multiples, des regex imbriquées ou des Allow/Disallow combinés, le test devient non négociable. Un seul caractère d'écart peut inverser totalement le comportement attendu.

Impact pratique et recommandations

Comment intégrer ce test dans un workflow de production ?

Première étape : ne jamais modifier le robots.txt directement en production. Créez une copie de travail, testez-la dans Search Console, validez sur 10-15 URLs représentatives (homepage, catégories, fiches produits, pages paginées, URLs avec paramètres).

Si votre stack technique le permet, automatisez ce contrôle via l'API Search Console. Certains outils de monitoring SEO proposent déjà des alertes en cas de modification non testée du robots.txt — un gain de temps considérable.

Quelles URLs faut-il absolument tester avant déploiement ?

Concentrez-vous sur les typologies à fort impact SEO : pages de catégories, fiches produits bestsellers, contenus éditoriaux stratégiques. Testez aussi les cas limites : URLs avec multiples paramètres, trailing slashes, versions HTTPS vs HTTP si votre config hérite d'anciens patterns.

N'oubliez pas les ressources critiques : CSS, JS, images. Bloquer accidentellement /assets/ peut dégrader le rendu mobile et impacter les Core Web Vitals — Googlebot a besoin d'accéder à ces fichiers pour évaluer la page complète.

Que faire si une erreur robots.txt a déjà causé des dégâts ?

Corrigez immédiatement le fichier, puis utilisez l'outil d'inspection d'URL de Search Console pour forcer un re-crawl des pages critiques. Google ne recrawle pas instantanément l'ensemble du site après correction — il faut relancer manuellement le processus sur les URLs prioritaires.

Surveillez les logs serveur pour confirmer que Googlebot accède bien aux sections précédemment bloquées. Le retour à la normale peut prendre de quelques heures à plusieurs jours selon la fréquence de crawl de votre site.

- Ne jamais modifier robots.txt directement en production sans validation préalable

- Tester au minimum 10-15 URLs représentatives dans l'outil Search Console

- Vérifier les typologies critiques : catégories, produits, contenus stratégiques, ressources JS/CSS

- Documenter chaque modification avec la liste des URLs testées et leurs résultats

- Automatiser les alertes via API Search Console si votre infrastructure le permet

- En cas d'erreur déployée, corriger immédiatement et forcer le re-crawl via l'inspection d'URL

- Surveiller les logs serveur pour confirmer le retour du crawl sur les sections impactées

❓ Questions frequentes

L'outil de test robots.txt fonctionne-t-il pour les autres moteurs de recherche ?

Peut-on tester un robots.txt avant même de le mettre en ligne ?

Une URL bloquée dans robots.txt peut-elle quand même apparaître dans Google ?

Combien de temps faut-il à Google pour prendre en compte une modification du robots.txt ?

Les expressions régulières sont-elles vraiment nécessaires dans robots.txt ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 10/01/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.