Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Les snippets mal optimisés peuvent-ils vraiment faire chuter votre trafic organique ?

- □ Pourquoi vos requêtes de crawl tombent-elles à zéro dans Search Console ?

- □ Robots.txt en disallow bloque-t-il vraiment la génération de snippets dans les SERP ?

- □ Search Console suffit-elle vraiment pour diagnostiquer vos problèmes d'indexation ?

- □ Quels outils Google faut-il vraiment utiliser pour auditer correctement un site ?

- □ Lighthouse peut-il vraiment remplacer un audit SEO professionnel ?

- □ Un robots.txt mal configuré peut-il vraiment bloquer vos snippets et votre crawl ?

- □ Faut-il vraiment monitorer votre robots.txt en continu ?

- □ Faut-il vraiment tester son robots.txt avant chaque modification ?

- □ Faut-il bloquer certaines sections de votre site dans le robots.txt ?

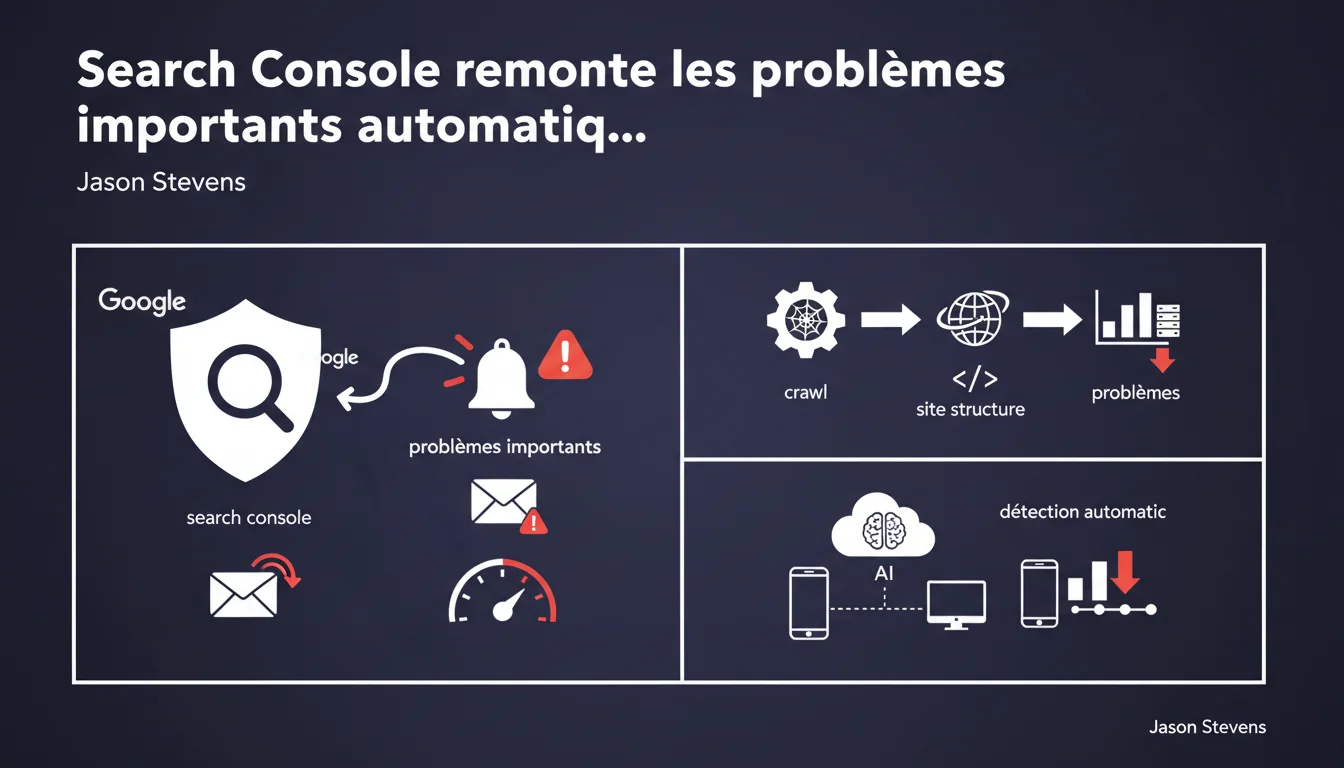

Google affirme que Search Console remonte automatiquement les problèmes critiques via la page d'accueil et par email. La section crawling permettrait de comprendre comment le bot explore votre site. En pratique, cette vision idéalisée mérite d'être nuancée — tous les problèmes ne sont pas signalés avec la même réactivité.

Ce qu'il faut comprendre

Que remonte réellement Search Console en priorité ?

La page d'accueil de Search Console affiche les alertes que Google juge critiques : erreurs d'indexation massives, problèmes de couverture soudains, pénalités manuelles, failles de sécurité. Ces notifications apparaissent aussi par email si vous avez configuré les préférences correctement.

La logique est simple : Google veut que vous corrigiez ce qui bloque l'exploration ou l'indexation à grande échelle. Un sitemap qui retourne des 404 en masse, un robots.txt qui interdit l'accès au site entier, une chute brutale du nombre de pages indexées — voilà ce qui déclenche une alerte visible.

À quoi sert concrètement la section crawling ?

L'onglet Paramètres > Statistiques d'exploration (anciennement "Statistiques sur l'exploration") montre le volume de requêtes quotidiennes, les temps de téléchargement, les types de fichiers crawlés. Vous voyez si Googlebot ralentit subitement, si le nombre de pages explorées chute, si votre serveur répond mal.

C'est utile pour diagnostiquer des problèmes de crawl budget ou repérer une surcharge serveur. Mais ces données restent agrégées — impossible de savoir précisément quelle URL pose problème sans croiser avec les logs serveur.

Pourquoi cette vision reste partielle ?

Google remonte ce qu'il considère comme "important" — pas forcément ce qui vous impacte réellement. Une section entière de votre site peut être ignorée par le bot sans que vous receviez d'alerte, simplement parce que Google ne la juge pas prioritaire.

- Les problèmes structurels (duplication, canonicalisation chaotique) ne génèrent souvent aucune notification directe

- Les baisses progressives de crawl passent sous le radar si elles ne franchissent pas un seuil d'alerte arbitraire

- Les erreurs JavaScript ou les contenus non rendus ne sont pas toujours signalés clairement

- Les alertes par email peuvent arriver avec plusieurs jours de décalage — trop tard pour certains sites à forte actualité

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui et non. Google fait effectivement remonter les catastrophes visibles — un site complètement désindexé, une pénalité manuelle, un piratage massif. Là-dessus, le système fonctionne correctement.

En revanche, affirmer que Search Console "fait un bon travail" pour tous les problèmes importants, c'est discutable. J'ai vu des sites perdre 30% de leur trafic organique à cause d'une migration ratée ou d'un changement de structure interne, sans recevoir la moindre alerte. Parce que techniquement, Googlebot continuait à crawler, juste différemment.

Quelles nuances faut-il apporter ?

La définition de "problème important" par Google ne correspond pas toujours à celle d'un SEO. Pour le moteur, un problème important = quelque chose qui l'empêche de faire son travail. Pour vous, c'est ce qui impacte le trafic ou les conversions.

[À vérifier] — Google ne précise jamais quels seuils déclenchent une alerte. Un site qui passe de 10 000 pages crawlées par jour à 7 000 reçoit-il une notification ? Rien ne le garantit. Cette opacité oblige à surveiller manuellement les tendances dans les statistiques d'exploration.

Dans quels cas cette approche ne suffit-elle pas ?

Sur les sites de grande envergure (e-commerce, médias), les problèmes de crawl sont rarement binaires. Vous avez plutôt des déséquilibres : certaines sections sur-crawlées, d'autres ignorées, du budget gaspillé sur des facettes inutiles. Search Console ne vous dira jamais "vous gaspillez 40% de votre crawl budget sur des pages de tri".

Même chose pour les problèmes de rendu JavaScript : vous verrez peut-être des URLs en erreur, mais impossible de savoir si c'est un timeout, un script qui plante, ou un contenu jamais généré. Il faut passer par des outils tiers ou des tests manuels.

Impact pratique et recommandations

Que faut-il faire concrètement pour ne rien louper ?

D'abord, configurez correctement les notifications par email dans Search Console (Paramètres > Utilisateurs et autorisations > Préférences des emails). Assurez-vous que toutes les alertes critiques sont activées et que les destinataires sont à jour.

Ensuite, ne vous contentez jamais de la page d'accueil. Allez régulièrement dans Paramètres > Statistiques d'exploration et surveillez les tendances : volume de requêtes, temps de réponse, types de fichiers. Une chute progressive ne déclenchera peut-être jamais d'alerte automatique.

Quelles erreurs éviter absolument ?

Erreur n°1 : croire qu'une absence de notification = absence de problème. Google ne signale que ce qu'il juge critique selon ses propres critères. Votre trafic peut s'effondrer sans qu'aucune alerte ne vous parvienne.

Erreur n°2 : ignorer les logs serveur. Search Console vous montre ce que Google dit avoir crawlé. Les logs vous montrent ce qu'il a réellement fait. Les écarts entre les deux révèlent souvent des anomalies invisibles dans l'interface.

- Activer toutes les notifications par email dans Search Console

- Consulter les statistiques d'exploration au moins une fois par semaine

- Croiser les données GSC avec vos logs serveur (obligatoire sur les gros sites)

- Monitorer le nombre de pages indexées via l'outil de couverture

- Tester régulièrement le rendu des pages clés avec l'outil d'inspection d'URL

- Auditer les sections du site qui reçoivent peu de crawl malgré leur importance stratégique

- Documenter tous les changements techniques majeurs pour corréler avec les variations de crawl

Comment vérifier que votre site est correctement suivi ?

Vérifiez que vous avez bien accès aux propriétés de domaine (et pas seulement aux propriétés de préfixe d'URL) dans Search Console — cela garantit une vision complète incluant tous les sous-domaines et protocoles.

Testez manuellement quelques URLs stratégiques avec l'outil d'inspection : demandez une indexation, observez si le rendu correspond à ce que vous attendez. Si des éléments manquent, creusez — le problème ne remontera peut-être jamais automatiquement.

❓ Questions frequentes

Search Console envoie-t-il toujours un email en cas de problème critique ?

Les statistiques d'exploration suffisent-elles à diagnostiquer un problème de crawl budget ?

Pourquoi certaines pages disparaissent de l'index sans notification ?

À quelle fréquence faut-il consulter les statistiques d'exploration ?

Search Console détecte-t-il les problèmes de rendu JavaScript ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 10/01/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.