Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi Google ouvre-t-il l'accès à des données horaires dans Search Console ?

- □ Faut-il vraiment surveiller les nouvelles recommandations Search Console pour éviter les pénalités d'indexation ?

- □ Google abandonne-t-il vraiment le terme 'webmaster' dans Search Console ?

- □ Pourquoi Google lance-t-il deux core updates distinctes en même temps ?

- □ Que change vraiment la mise à jour de la politique Google sur l'abus de site ?

- □ Qu'est-ce qu'une spam update de Google et comment s'en protéger efficacement ?

- □ Faut-il supprimer les données structurées Sitelink Search Box maintenant que Google les ignore ?

- □ Pourquoi 84% des sites web possèdent-ils un fichier robots.txt ?

- □ Comment Googlebot explore-t-il réellement vos pages et quel impact sur votre crawl budget ?

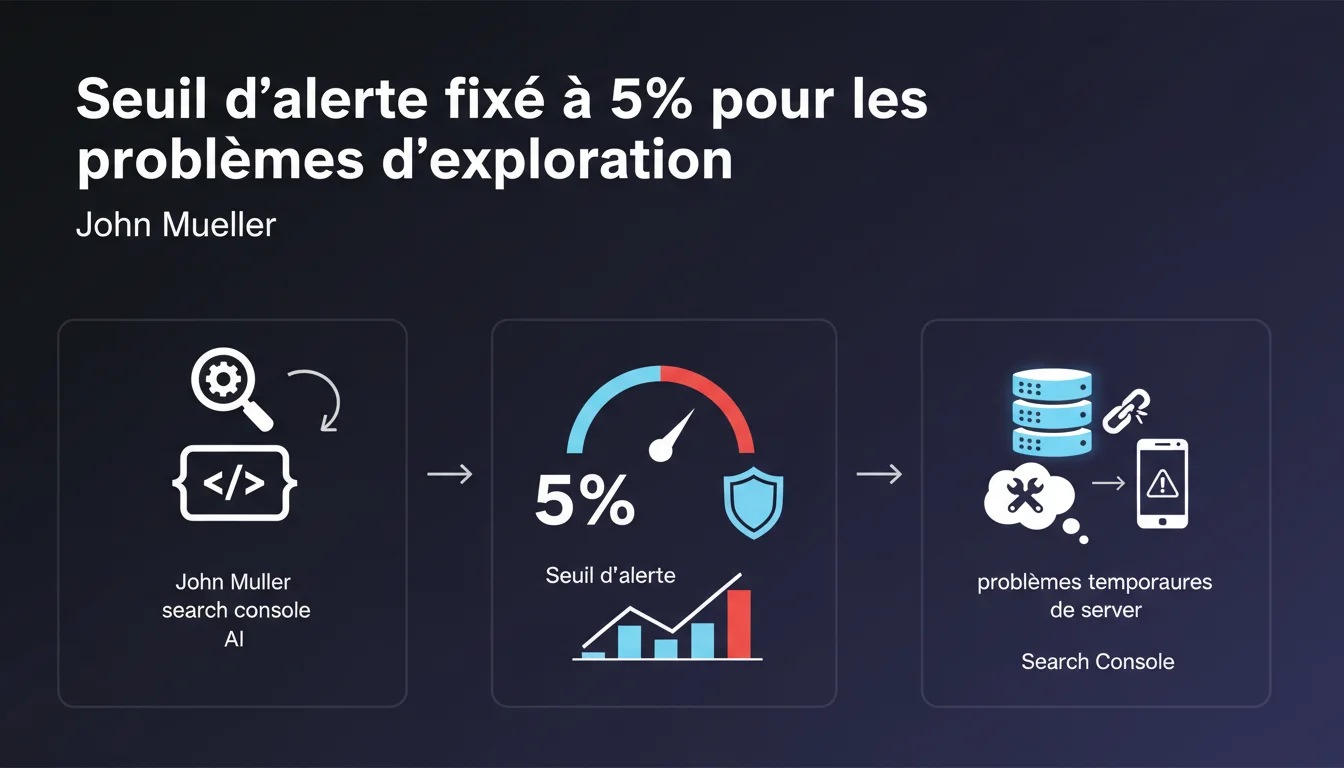

Google a fixé à 5% le seuil à partir duquel Search Console signale un problème d'exploration mesurable à l'échelle du site. Ce seuil vise à détecter les incidents serveur temporaires sans générer de fausses alertes. Les recommandations continueront d'évoluer selon Google.

Ce qu'il faut comprendre

Qu'est-ce que ce seuil de 5% signifie concrètement ?

Quand Google détecte qu'au moins 5% de vos URL rencontrent le même problème d'exploration, Search Console déclenche une recommandation. En dessous de ce seuil, le système considère qu'il s'agit d'anomalies ponctuelles ne nécessitant pas d'alerte.

Ce pourcentage s'applique aux problèmes mesurables à l'échelle du site — erreurs serveur, timeouts, problèmes de robots.txt. Pas aux erreurs 404 isolées ou aux soft 404 éparpillés.

Pourquoi Google a-t-il choisi précisément 5% ?

Le seuil de 5% permet de filtrer le bruit de fond — ces erreurs sporadiques qui touchent quelques pages sans révéler de problème structurel. Un serveur qui rame pendant 10 minutes peut facilement générer 5% d'échecs d'exploration.

Google cherche à équilibrer deux risques : alerter trop tôt (et noyer les webmasters sous les fausses alertes) versus alerter trop tard (et laisser passer des incidents critiques). Le 5% représente ce point d'équilibre — pour l'instant.

Ce seuil est-il définitif ?

Non. Mueller précise que les recommandations continueront d'être affinées. Ce 5% n'est pas gravé dans le marbre — c'est un paramètre que Google ajustera selon les retours et les données d'usage.

On peut s'attendre à ce que ce seuil évolue, voire devienne dynamique selon le type de problème ou la taille du site. Google teste, mesure, itère.

- Le seuil de 5% s'applique aux problèmes d'exploration récurrents, pas aux incidents isolés

- Il vise principalement les erreurs serveur temporaires détectables à l'échelle du site

- Ce paramètre évoluera — Google l'ajustera selon les retours terrain

- En dessous de 5%, Search Console ne génère pas de recommandation automatique

Avis d'un expert SEO

Ce seuil de 5% est-il adapté à tous les sites ?

Soyons honnêtes : un seuil unique pour tous les sites, c'est simpliste. Sur un site de 100 pages, 5% = 5 pages. Sur un site de 500 000 pages, 5% = 25 000 pages. L'impact n'est pas comparable.

Pour un gros site e-commerce, 5% d'erreurs serveur peut représenter des milliers de fiches produits inaccessibles pendant plusieurs heures. L'alerte arrive alors que le mal est fait. À l'inverse, sur un petit site corporate, 5% peut signaler un incident mineur sans conséquence réelle.

[A verifier] Google ne précise pas si ce seuil s'adapte à la volumétrie ou au type de site. Rien n'indique qu'un site de 10 000 pages bénéficie d'un seuil plus bas qu'un site de 100 pages.

Peut-on se fier uniquement à cette alerte ?

Non. Ce seuil couvre les problèmes d'exploration mesurables — essentiellement les erreurs serveur. Mais qu'en est-il des problèmes de qualité de crawl qui n'atteignent jamais 5% ?

Imaginons que 3% de vos pages stratégiques (les bestsellers, les landing pages premium) deviennent inaccessibles suite à une mauvaise gestion des paramètres URL. Pas d'alerte. Pourtant, l'impact SEO et business peut être sévère.

Le monitoring SEO ne peut pas se limiter aux alertes Search Console. Il faut croiser avec vos logs serveur, vos outils de crawl internes, vos KPIs d'indexation. Search Console donne une vision partielle — utile, mais partielle.

Cette transparence de Google est-elle une bonne nouvelle ?

Oui et non. D'un côté, connaître le seuil permet d'anticiper — on sait qu'en dessous de 5%, il faudra détecter les problèmes par d'autres moyens. De l'autre, cette transparence peut créer un faux sentiment de sécurité.

Certains vont se dire : « Tant que je n'ai pas d'alerte, tout va bien. » Et c'est faux. Un site peut perdre de la visibilité sans jamais déclencher d'alerte à 5% — problèmes de contenu dupliqué, soft 404 rampants, chute de crawl budget sur certaines sections.

Impact pratique et recommandations

Que faut-il surveiller en complément de ces alertes ?

Même si vous restez sous le seuil de 5%, certains signaux doivent déclencher une vérification manuelle. Surveillez vos logs serveur pour repérer les pics d'erreurs 5xx, même ponctuels.

Croisez avec vos données de crawl budget — si Googlebot réduit sa fréquence de passage sans alerte Search Console, c'est qu'il rencontre des frictions. Vérifiez également l'évolution du nombre de pages indexées : une chute progressive peut révéler un problème structurel qui ne déclenche jamais d'alerte à 5%.

Comment détecter les problèmes avant qu'ils atteignent 5% ?

Mettez en place un monitoring proactif des temps de réponse serveur. Si votre TTFB explose sur certaines sections, Googlebot va rencontrer des timeouts — mais peut-être pas assez pour déclencher l'alerte.

Utilisez des outils de crawl réguliers (Screaming Frog, Oncrawl, Botify) pour simuler le comportement de Googlebot. Si votre propre crawler rencontre 2-3% d'erreurs serveur, c'est un signal d'alarme — ne pas attendre que Google vous le confirme à 5%.

- Analysez vos logs serveur chaque semaine pour repérer les erreurs 5xx même sous le seuil de 5%

- Configurez des alertes automatiques si votre TTFB dépasse 1,5s sur plus de 2% des pages

- Lancez un crawl complet de votre site au moins une fois par mois pour anticiper les problèmes

- Surveillez l'évolution du nombre de pages indexées dans Search Console — une baisse progressive est un signal d'alerte

- Croisez les données Search Console avec vos analytics pour identifier les pages stratégiques qui pourraient être impactées

- Ne vous fiez pas uniquement aux alertes automatiques — elles arrivent souvent trop tard

Quelles actions mettre en place dès maintenant ?

Établissez une baseline de vos performances d'exploration. Notez combien d'erreurs serveur vous générez en temps normal — c'est votre référentiel pour détecter les anomalies avant qu'elles atteignent 5%.

Documentez vos incidents passés : quand avez-vous eu des problèmes d'exploration, à quel pourcentage, quelle a été la réaction de Search Console ? Cela vous permettra de calibrer votre propre seuil d'alerte interne.

❓ Questions frequentes

Le seuil de 5% s'applique-t-il à tous les types d'erreurs d'exploration ?

Si j'ai 4% d'erreurs serveur, Search Console ne m'alertera pas ?

Ce seuil varie-t-il selon la taille du site ?

Google va-t-il modifier ce seuil à l'avenir ?

Dois-je me fier uniquement aux alertes Search Console pour monitorer mon exploration ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 14/01/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.