Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi Google ouvre-t-il l'accès à des données horaires dans Search Console ?

- □ Faut-il vraiment surveiller les nouvelles recommandations Search Console pour éviter les pénalités d'indexation ?

- □ Pourquoi Google fixe-t-il le seuil d'alerte d'exploration à 5% dans Search Console ?

- □ Google abandonne-t-il vraiment le terme 'webmaster' dans Search Console ?

- □ Que change vraiment la mise à jour de la politique Google sur l'abus de site ?

- □ Qu'est-ce qu'une spam update de Google et comment s'en protéger efficacement ?

- □ Faut-il supprimer les données structurées Sitelink Search Box maintenant que Google les ignore ?

- □ Pourquoi 84% des sites web possèdent-ils un fichier robots.txt ?

- □ Comment Googlebot explore-t-il réellement vos pages et quel impact sur votre crawl budget ?

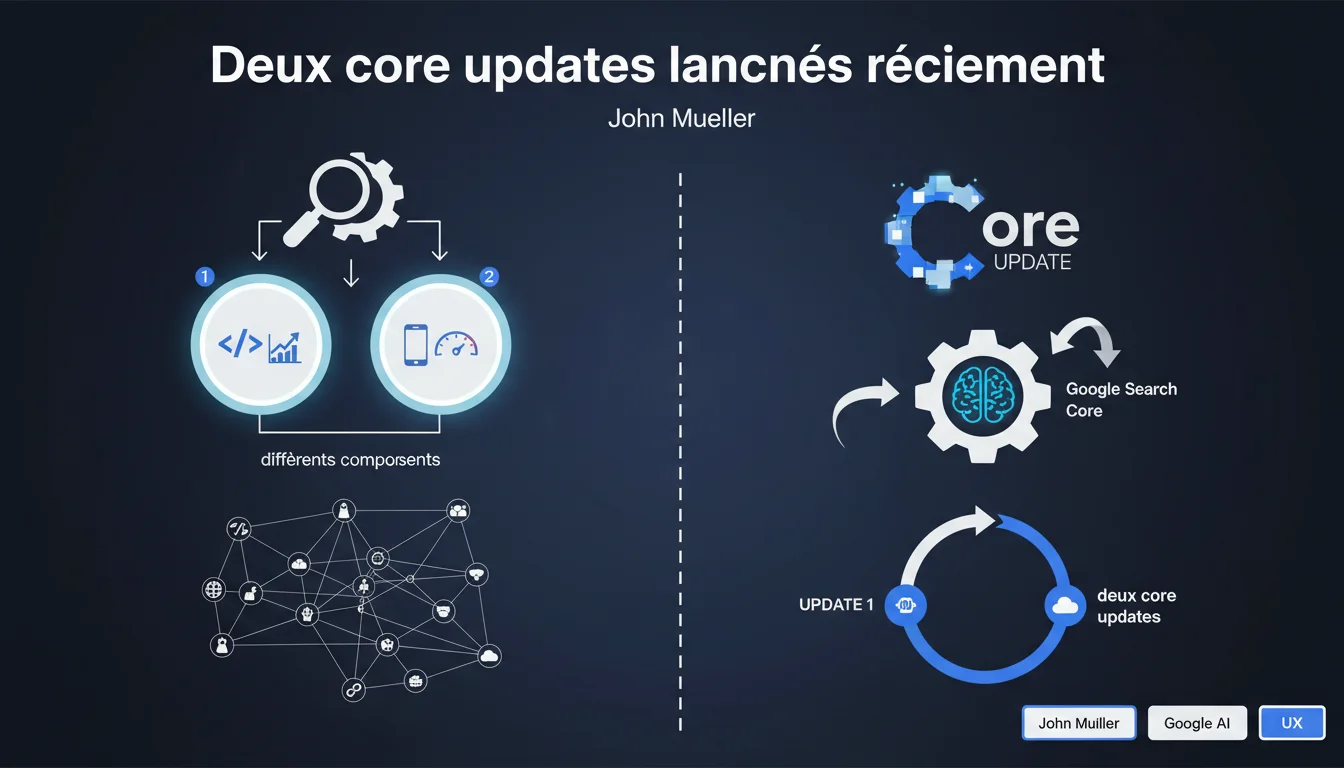

Google confirme le déploiement simultané de deux mises à jour core distinctes ciblant différents composants de son moteur de recherche. Cette approche parallèle — inhabituelle — suggère que l'algorithme de Google est désormais suffisamment modulaire pour être optimisé par briques indépendantes, sans attendre un déploiement global unique.

Ce qu'il faut comprendre

Que signifie « deux core updates » lancées ensemble ?

Traditionnellement, Google annonçait une seule core update par période, modifiant globalement la façon dont le moteur évalue la qualité des contenus. Ici, Mueller parle explicitement de deux mises à jour distinctes, chacune ciblant des composants spécifiques du « core ».

Cela confirme ce que beaucoup soupçonnaient : l'algorithme de Google n'est plus un bloc monolithique. Il est désormais composé de modules indépendants — pertinence sémantique, signaux d'expérience utilisateur, traitement des backlinks, fraîcheur, etc. — que Google peut ajuster séparément.

Pourquoi cette approche modulaire change-t-elle la donne ?

Parce qu'elle rend les fluctuations de ranking plus imprévisibles. Un site peut être impacté par l'une des deux updates, par les deux, ou par aucune — selon les composants concernés et les faiblesses de ce site.

Concrètement, si une update touche la gestion des signaux E-E-A-T et l'autre le traitement des liens internes, deux sites avec des profils différents réagiront de manière totalement asymétrique. Plus question de se dire « c'est une core update, tout le monde est logé à la même enseigne ».

Quels composants sont considérés comme « core » ?

Google ne précise jamais officiellement la liste. Mais par recoupement, on sait que le core inclut au minimum : la compréhension sémantique (NLP), le scoring de qualité (E-E-A-T), la gestion des signaux utilisateur (Core Web Vitals, comportement), l'analyse des backlinks, et la fraîcheur.

Tout signal qui influence directement le classement organique global — pas seulement une fonctionnalité isolée comme les featured snippets — peut être considéré comme faisant partie du core.

- Modularité croissante : Google peut désormais ajuster chaque composant indépendamment

- Impacts asymétriques : deux sites concurrents peuvent subir des effets opposés selon leurs forces/faiblesses respectives

- Moins de visibilité : Google ne dit jamais quels composants précis sont touchés par chaque update

- Complexité accrue : diagnostiquer une baisse de trafic après une core update devient plus délicat

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées ?

Totalement. Depuis plusieurs mois, on observe des rollouts de core updates qui se chevauchent, avec des périodes de volatilité prolongées. Cela collait mal avec l'idée d'une seule mise à jour globale.

Certains sites voyaient leur trafic remonter en milieu de rollout, puis rebaisser — signe probable que plusieurs ajustements successifs ou parallèles étaient en cours. Cette déclaration de Mueller légitime enfin ces observations terrain : oui, plusieurs updates core peuvent coexister.

Pourquoi Google reste-t-il aussi flou sur les composants concernés ?

Soyons honnêtes : si Google révélait précisément quels modules sont ajustés, les SEO pourraient reverse-engineer les critères et optimiser de manière chirurgicale. Google préfère maintenir une opacité stratégique pour éviter les manipulations.

Le problème, c'est que ça rend le diagnostic post-update extrêmement complexe. Un site qui perd 30 % de son trafic ne sait pas s'il doit retravailler son contenu, son maillage interne, ses backlinks, ou son UX. [A vérifier] : Mueller parle de « différents composants », mais aucune précision concrète n'est donnée. On reste dans le brouillard.

Faut-il s'attendre à plus de volatilité à l'avenir ?

C'est très probable. Si Google peut désormais itérer composant par composant, rien ne l'empêche de déployer trois, quatre, voire cinq ajustements core simultanés ou en cascade rapprochée.

Résultat : les périodes de stabilité entre core updates vont probablement se raccourcir. Et les outils de tracking SEO risquent d'afficher des courbes de volatilité quasi permanentes — ce qui compliquera encore plus la distinction entre fluctuation normale et vrai impact algorithme.

Impact pratique et recommandations

Que faut-il faire concrètement après cette annonce ?

D'abord, abandonner l'idée d'une stratégie unique face à une core update. Si deux composants sont touchés, il faut être capable d'auditer plusieurs axes en parallèle : qualité du contenu, signaux E-E-A-T, profil de liens, expérience utilisateur, architecture du site.

Ensuite, croiser les données. Regarde si la baisse de trafic concerne certaines typologies de pages spécifiques (pages produits vs articles de blog), certains segments de mots-clés (requêtes commerciales vs informationnelles), ou certains devices (mobile vs desktop). Cela peut révéler quel composant te pénalise.

Quelles erreurs éviter après une core update multi-composants ?

Erreur classique : paniquer et tout changer d'un coup. Si tu refonds ton site, réécris tes contenus, nettoies tes backlinks et modifies ton maillage interne simultanément, tu ne sauras jamais ce qui a vraiment fonctionné — ou empiré les choses.

Autre erreur : attendre une « récupération automatique ». Google a déjà dit que les core updates ne pénalisent pas, elles réévaluent. Mais si ton contenu reste médiocre, tu ne remonteras pas magiquement à la prochaine update. Il faut agir de manière ciblée.

Comment diagnostiquer quel composant m'a impacté ?

Commence par segmenter ton analyse. Si tu perds du trafic sur des requêtes YMYL (santé, finance), c'est probablement un ajustement E-E-A-T. Si c'est sur des pages techniquement lentes ou mal optimisées mobile, ça peut être lié aux Core Web Vitals ou aux signaux UX.

Ensuite, compare ton site à ceux qui ont gagné du trafic sur les mêmes mots-clés. Qu'ont-ils en plus ? Meilleur contenu ? Plus de backlinks autoritaires ? Meilleure expérience utilisateur ? Cette analyse concurrentielle est souvent plus parlante que n'importe quel outil de monitoring.

- Auditer plusieurs axes simultanément : contenu, backlinks, UX, architecture, E-E-A-T

- Segmenter l'analyse par typologie de pages et de requêtes pour identifier les patterns

- Ne pas tout changer d'un coup — tester des modifications ciblées et mesurer les effets

- Comparer son site aux gagnants de l'update pour détecter les écarts critiques

- Suivre la volatilité sur plusieurs semaines : une core update peut prendre 2-3 semaines à se stabiliser

- Documenter chaque action corrective pour savoir ce qui a réellement fonctionné

❓ Questions frequentes

Google va-t-il annoncer systématiquement quand plusieurs core updates sont lancées en parallèle ?

Si mon site est impacté par une seule des deux updates, l'autre peut-elle compenser les pertes ?

Les core updates multi-composants rendent-elles les outils de tracking SEO moins fiables ?

Peut-on anticiper quels composants Google va ajuster dans les prochaines core updates ?

Si je n'ai subi aucun impact, dois-je quand même auditer mon site après une core update ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 14/01/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.