Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi Google ouvre-t-il l'accès à des données horaires dans Search Console ?

- □ Faut-il vraiment surveiller les nouvelles recommandations Search Console pour éviter les pénalités d'indexation ?

- □ Pourquoi Google fixe-t-il le seuil d'alerte d'exploration à 5% dans Search Console ?

- □ Google abandonne-t-il vraiment le terme 'webmaster' dans Search Console ?

- □ Pourquoi Google lance-t-il deux core updates distinctes en même temps ?

- □ Que change vraiment la mise à jour de la politique Google sur l'abus de site ?

- □ Qu'est-ce qu'une spam update de Google et comment s'en protéger efficacement ?

- □ Faut-il supprimer les données structurées Sitelink Search Box maintenant que Google les ignore ?

- □ Comment Googlebot explore-t-il réellement vos pages et quel impact sur votre crawl budget ?

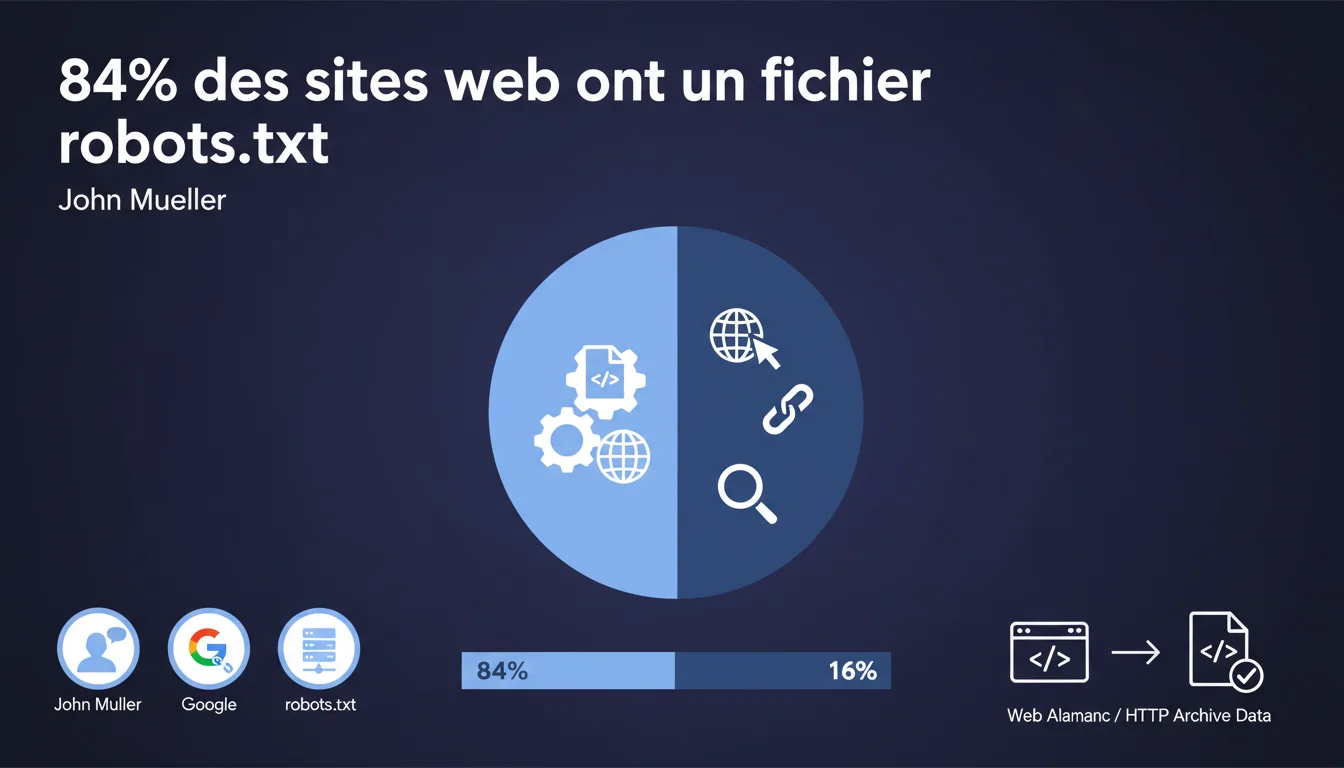

84% des sites web disposent d'un fichier robots.txt selon le Web Almanac. Cette statistique révèle une adoption massive d'un outil de contrôle du crawl, mais ne dit rien sur la qualité de ces fichiers ni leur réelle utilité pour la plupart des sites. Le vrai débat : combien de ces robots.txt sont réellement optimisés ?

Ce qu'il faut comprendre

Que révèle ce chiffre de 84% d'adoption ?

Ce taux d'adoption massif montre que la majorité des propriétaires de sites ont conscience de l'existence du fichier robots.txt. Les CMS modernes comme WordPress génèrent automatiquement ce fichier, ce qui explique en partie cette statistique.

Mais possession ne veut pas dire optimisation. Un fichier robots.txt par défaut n'est pas forcément adapté aux besoins spécifiques d'un site. Entre un fichier vide et un fichier finement configuré, il y a un monde.

Le Web Almanac est-il une source fiable ?

Publié par des experts de l'industrie et des employés Google, le Web Almanac s'appuie sur l'archive HTTP, une base de données massive qui analyse des millions de pages web. C'est une référence solide pour comprendre les tendances d'adoption des standards web.

Toutefois, cette archive capture un instantané du web à un moment donné — elle ne dit rien sur l'évolution des pratiques ni sur la répartition entre sites amateurs et sites professionnels.

Faut-il forcément avoir un robots.txt ?

Non, ce n'est pas une obligation technique. Un site sans robots.txt sera crawlé normalement selon les règles par défaut de Google. Le fichier devient pertinent quand vous voulez contrôler finement le comportement des bots.

Pour un blog personnel de 20 pages, l'absence de robots.txt n'aura aucun impact. Pour un site e-commerce de 10 000 références avec des filtres à facettes, c'est une autre histoire.

- 84% des sites possèdent un robots.txt, mais on ignore combien sont réellement configurés

- Les CMS modernes génèrent automatiquement ce fichier, ce qui gonfle les statistiques

- L'archive HTTP ne distingue pas les robots.txt optimisés des fichiers par défaut

- Un site sans robots.txt n'est pas pénalisé — il suit simplement les règles de crawl standards

Avis d'un expert SEO

Cette statistique reflète-t-elle vraiment une maîtrise du crawl budget ?

Soyons honnêtes : non. Avoir un fichier robots.txt ne signifie pas qu'il est correctement configuré. D'expérience, une majorité de ces 84% se compose de fichiers générés automatiquement par les CMS, jamais revus ni optimisés.

Le vrai problème, c'est qu'on confond souvent présence et pertinence. Combien de ces fichiers contiennent des directives obsolètes ? Combien bloquent par erreur des ressources critiques comme les CSS ou JavaScript ? [À vérifier] — Google ne donne aucun chiffre sur la qualité réelle de ces configurations.

Quelles erreurs observe-t-on fréquemment sur le terrain ?

Les classiques reviennent sans cesse : blocage des fichiers de style et scripts qui empêchent le rendu correct des pages, interdiction d'accès à des sections entières du site par erreur de syntaxe, ou encore présence de directives devenues inutiles après une refonte.

Un autre cas fréquent : les sites qui copient-collent un robots.txt d'exemple trouvé en ligne, sans l'adapter à leur architecture. Résultat ? Des URLs importantes ne sont pas crawlées, ou à l'inverse, du contenu dupliqué se retrouve indexé alors qu'il devrait être bloqué.

Dans quels cas un robots.txt est-il vraiment indispensable ?

Concrètement ? Quand vous devez optimiser le crawl budget sur des sites de plusieurs milliers de pages, bloquer des URLs de pagination infinies, ou empêcher l'indexation de fichiers de recherche interne. Pour un site vitrine de 50 pages, c'est accessoire.

Les sites e-commerce, médias, places de marché ont tout intérêt à maîtriser ce fichier. Les blogs personnels, portfolios, sites one-page ? Pas vraiment. Et c'est là que le chiffre de 84% perd de sa signification : il mélange des contextes incomparables.

Impact pratique et recommandations

Que faut-il vérifier en priorité sur votre robots.txt ?

Première étape : assurez-vous qu'il existe en accédant à votredomaine.com/robots.txt. Ensuite, vérifiez qu'aucune directive ne bloque par erreur vos pages stratégiques ou vos ressources CSS/JS essentielles au rendu.

Utilisez l'outil de test robots.txt dans la Google Search Console pour valider chaque directive. Simulez le crawl sur plusieurs URLs types pour repérer d'éventuelles interdictions non souhaitées.

Quelles erreurs éviter à tout prix ?

Ne bloquez jamais les fichiers CSS et JavaScript — Google en a besoin pour le rendu. Ne copiez pas un robots.txt d'un autre site sans l'adapter à votre architecture. Et surtout, ne confondez pas robots.txt et balise noindex : le premier contrôle le crawl, la seconde l'indexation.

Évitez aussi les directives trop larges du type Disallow: / qui bloquent l'intégralité du site. Oui, ça arrive — et plus souvent qu'on ne le croit. Un simple copier-coller d'un environnement de staging peut tuer la visibilité d'un site en production.

Comment optimiser concrètement ce fichier ?

Commencez par identifier les sections de votre site qui génèrent du contenu dupliqué ou peu qualitatif : résultats de recherche interne, pages de tags non stratégiques, archives de pagination infinie. Bloquez-les proprement avec des directives Disallow ciblées.

Ajoutez ensuite la directive Sitemap pour indiquer l'emplacement de votre sitemap XML. C'est souvent oublié, alors que ça facilite le travail des crawlers. Pensez aussi à déclarer plusieurs sitemaps si votre site en a plusieurs (produits, catégories, blog, etc.).

- Vérifier que le fichier robots.txt est accessible à la racine du domaine

- Tester chaque directive dans la Search Console pour éviter les blocages involontaires

- Ne jamais bloquer les CSS, JavaScript ou autres ressources critiques au rendu

- Déclarer l'emplacement du sitemap XML via la directive Sitemap

- Revoir régulièrement le fichier après chaque refonte ou changement d'architecture

- Documenter chaque directive pour faciliter la maintenance future

❓ Questions frequentes

Un site peut-il fonctionner sans fichier robots.txt ?

Quelle est la différence entre robots.txt et balise noindex ?

Faut-il bloquer les fichiers CSS et JavaScript dans le robots.txt ?

Combien de temps faut-il pour que Google prenne en compte les modifications du robots.txt ?

Peut-on utiliser des wildcards dans le robots.txt ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 14/01/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.