Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi Google ouvre-t-il l'accès à des données horaires dans Search Console ?

- □ Faut-il vraiment surveiller les nouvelles recommandations Search Console pour éviter les pénalités d'indexation ?

- □ Pourquoi Google fixe-t-il le seuil d'alerte d'exploration à 5% dans Search Console ?

- □ Google abandonne-t-il vraiment le terme 'webmaster' dans Search Console ?

- □ Pourquoi Google lance-t-il deux core updates distinctes en même temps ?

- □ Que change vraiment la mise à jour de la politique Google sur l'abus de site ?

- □ Qu'est-ce qu'une spam update de Google et comment s'en protéger efficacement ?

- □ Faut-il supprimer les données structurées Sitelink Search Box maintenant que Google les ignore ?

- □ Pourquoi 84% des sites web possèdent-ils un fichier robots.txt ?

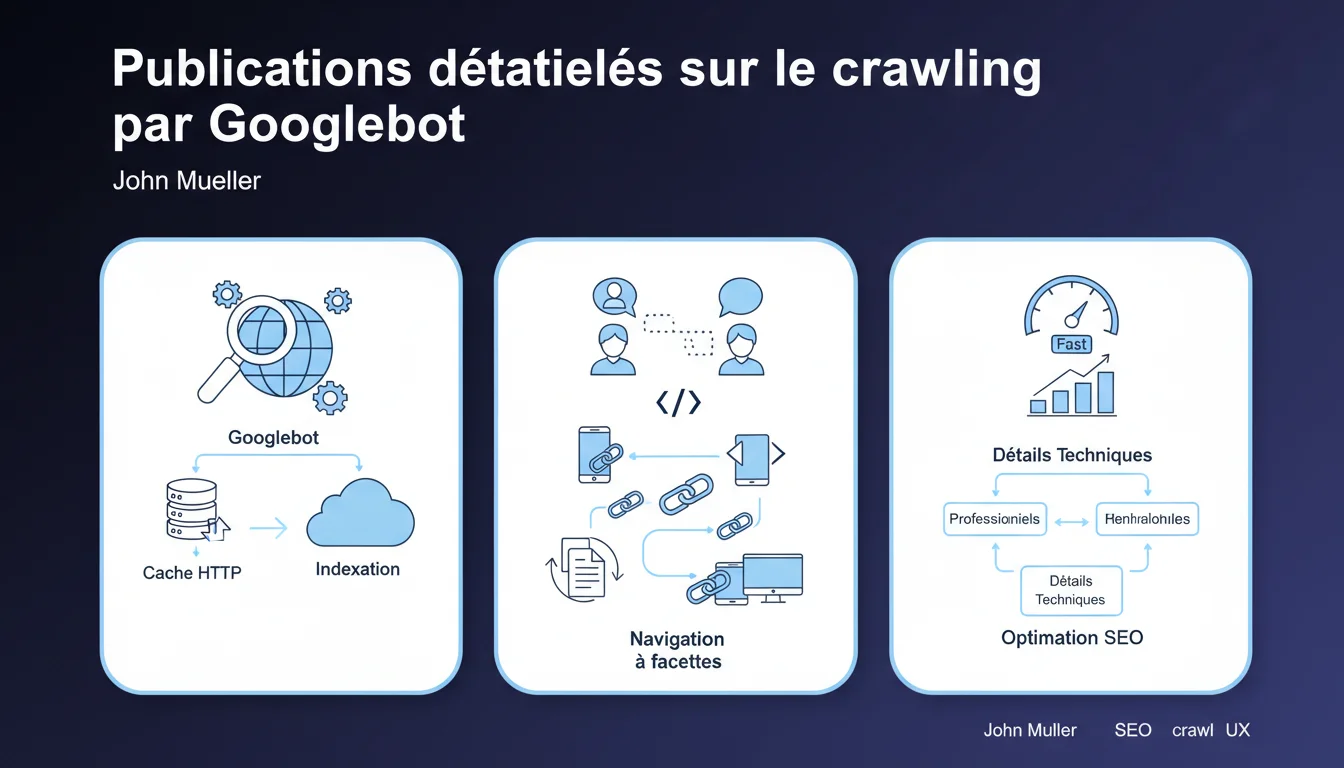

Google publie deux articles techniques détaillés sur le fonctionnement du crawl, le rôle du cache HTTP et la gestion de la navigation à facettes. Ces ressources visent à clarifier les mécanismes internes de Googlebot pour aider les professionnels à optimiser l'exploration de leurs sites.

Ce qu'il faut comprendre

Pourquoi Google publie-t-il soudainement des ressources aussi techniques ?

Gary Illyes et Martin Splitt ont choisi de lever le voile sur des aspects souvent mécompris du crawl. L'objectif affiché : réduire l'écart entre ce que les SEO croient savoir sur Googlebot et son fonctionnement réel.

Ces publications sortent du cadre habituel des déclarations vagues. Elles entrent dans les détails : comment le bot priorise les URLs, comment il interprète les en-têtes HTTP, pourquoi certaines pages sont explorées plus souvent que d'autres. Une démarche rare qui mérite attention.

Qu'apprend-on concrètement sur le cache HTTP et son rôle ?

Le cache HTTP n'est pas qu'une question de performance utilisateur. Google l'utilise activement pour optimiser son propre crawl budget. Si vos en-têtes de cache sont bien configurés, le bot peut éviter de re-crawler inutilement des ressources statiques.

Concrètement ? Des directives comme Cache-Control et ETag influencent directement la fréquence d'exploration. Mal paramétrées, elles peuvent soit gaspiller du crawl budget, soit empêcher Google de détecter vos mises à jour.

La navigation à facettes : enfin des réponses claires ?

La gestion des facettes reste un casse-tête pour tout site e-commerce ou annuaire. Google reconnaît le problème : trop d'URLs générées, trop peu de valeur ajoutée pour la plupart.

Les articles évoquent des stratégies de priorisation et comment signaler à Googlebot quelles combinaisons de filtres méritent l'exploration. Mais — on y revient — la mise en œuvre technique reste complexe et dépend fortement de l'architecture du site.

- Le crawl budget est directement impacté par la configuration HTTP et la structure de navigation

- Les en-têtes de cache ne sont pas optionnelles pour un site performant en SEO

- La navigation à facettes doit être pensée SEO dès la conception, pas corrigée après coup

- Google donne des pistes, mais aucune recette miracle universelle

Avis d'un expert SEO

Ces publications changent-elles vraiment la donne pour les praticiens ?

Soyons honnêtes : la plupart des points abordés étaient déjà connus empiriquement par les SEO qui optimisent des sites complexes depuis des années. Ce qui change, c'est la confirmation officielle et le niveau de détail.

Le vrai intérêt ? Couper court aux mythes et aux interprétations foireuses qui circulent. Mais attention — ces ressources restent destinées à un public technique. Si vous ne maîtrisez pas déjà les fondamentaux du crawl, vous risquez de vous perdre dans les détails.

Qu'est-ce que Google ne dit pas (encore) ?

Les articles restent remarquablement flous sur les seuils quantitatifs. Combien d'URLs d'un site moyen Googlebot explore-t-il par jour ? Quel pourcentage du crawl budget est gaspillé en moyenne par une mauvaise config cache ? [A vérifier] — ces chiffres n'apparaissent nulle part.

De même, la question du JavaScript côté client et son impact sur le crawl budget n'est qu'effleurée. Pour un site Angular ou React mal optimisé, ces conseils sur le cache HTTP sont presque secondaires face au gouffre d'exploration que représente le rendering.

Dans quels cas ces optimisations sont-elles vraiment prioritaires ?

Pour un site de 50 pages ? Franchement, non. Le crawl budget n'est pas votre problème. Google passera de toute façon régulièrement.

Pour un site de 10 000+ URLs, avec du contenu mis à jour quotidiennement, des facettes multiples, des pages produits qui apparaissent et disparaissent ? Là, oui — chaque optimisation compte. Et c'est là que ça coince : ces optimisations demandent des compétences croisées (SEO, dev backend, infra) que peu d'équipes maîtrisent simultanément.

Impact pratique et recommandations

Que faut-il vérifier en priorité sur votre site ?

Commencez par auditer vos en-têtes HTTP sur les ressources principales : HTML, CSS, JS, images. Utilisez les DevTools ou des outils comme WebPageTest pour voir ce que Googlebot reçoit réellement.

Vérifiez ensuite votre Search Console : section Statistiques d'exploration. Si vous voyez des pics d'activité sans corrélation avec vos mises à jour de contenu, c'est probablement un problème de cache ou de navigation redondante.

- Configurer Cache-Control avec des durées cohérentes selon le type de contenu (statique vs dynamique)

- Implémenter ETag ou Last-Modified pour permettre les requêtes conditionnelles

- Identifier les combinaisons de facettes qui génèrent le plus de trafic organique (Search Console + Analytics)

- Bloquer via robots.txt ou noindex les URLs de facettes sans valeur SEO

- Utiliser rel=canonical pour regrouper les variantes de pages similaires

- Tester l'impact avec des crawls Screaming Frog avant/après optimisation

Quelles erreurs éviter absolument ?

Ne configurez jamais un Cache-Control: no-cache global sur vos pages HTML principales. Vous forceriez Google à tout re-crawler à chaque visite, même sans changement. Résultat : crawl budget gaspillé et indexation ralentie.

Autre piège classique : bloquer des URLs de facettes dans robots.txt tout en les laissant dans le sitemap XML. C'est incohérent. Google crawlera quand même pour vérifier, ce qui crée du bruit dans vos stats.

Comment mesurer l'efficacité de ces optimisations ?

Suivez l'évolution du nombre de pages explorées par jour dans Search Console. Une optimisation réussie devrait maintenir ou augmenter ce chiffre tout en réduisant le nombre total d'URLs explorées inutilement.

Comparez aussi le taux d'indexation : pages indexées / pages soumises. Si vous nettoyez correctement les facettes parasites, ce ratio devrait progresser. Attention, les résultats ne sont pas immédiats — comptez 2 à 4 semaines.

❓ Questions frequentes

Le cache HTTP a-t-il un impact direct sur le classement dans les résultats de recherche ?

Dois-je bloquer toutes les URLs de facettes par défaut ?

Combien de temps faut-il pour observer l'effet d'une optimisation du crawl budget ?

Les recommandations sur le cache s'appliquent-elles aussi aux sites JavaScript côté client ?

Comment savoir si mon site a un problème de crawl budget ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 14/01/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.