Declaration officielle

Autres déclarations de cette vidéo 5 ▾

- □ Pourquoi Google a-t-il open sourcé son parser robots.txt officiel ?

- □ Pourquoi votre robots.txt peut-il être interprété différemment par Search Console et Google Search ?

- □ Pourquoi Google a-t-il développé une version Java de son parser robots.txt ?

- □ Pourquoi Google considère-t-il votre fichier robots.txt comme une menace potentielle ?

- □ Pourquoi Google teste-t-il son parser robots.txt avec autant de rigueur ?

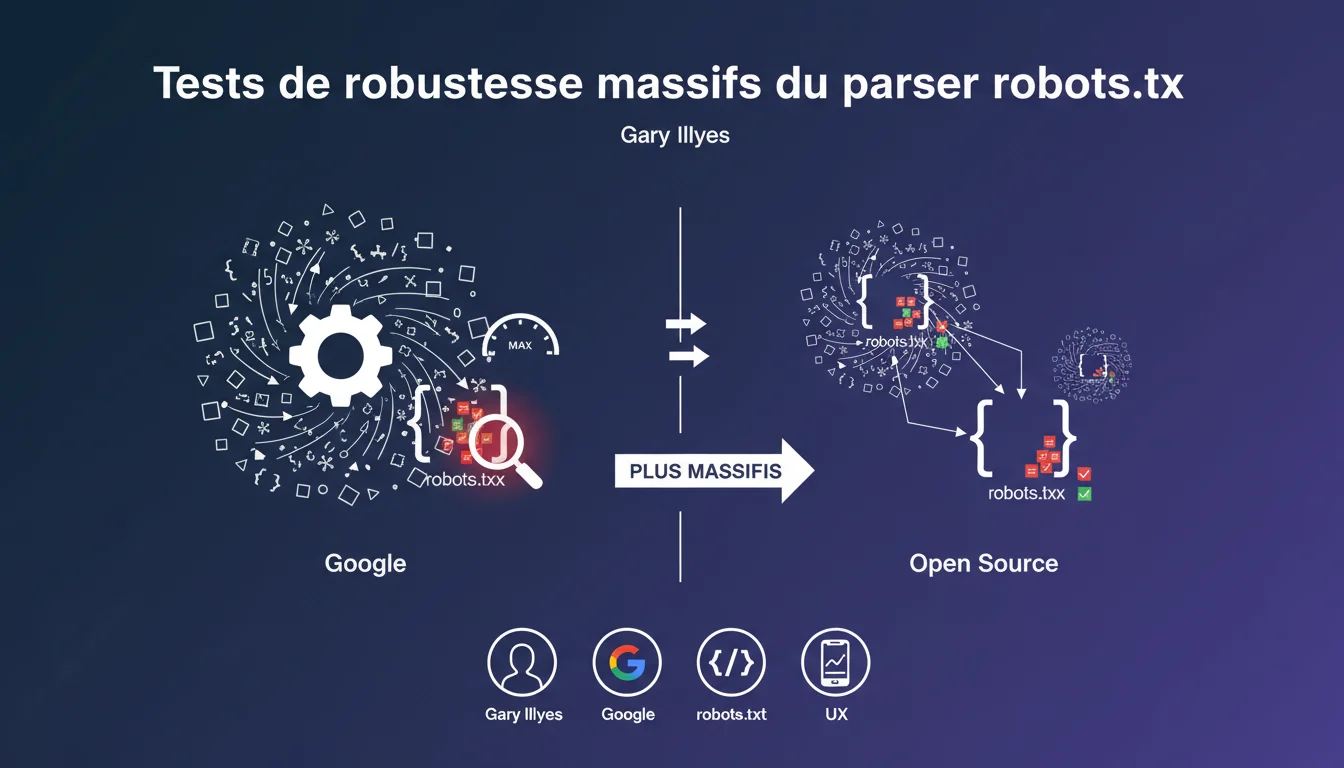

Google soumet son parser robots.txt à des fuzzer tests internes massifs qui bombardent la bibliothèque d'inputs aléatoires pour détecter bugs et failles de sécurité. Ces tests sont beaucoup plus poussés que la version open source disponible publiquement, ce qui signifie que le moteur en production est bien plus résilient aux fichiers robots.txt malformés que ce qu'on peut tester nous-mêmes.

Ce qu'il faut comprendre

Qu'est-ce qu'un fuzzer test exactement ?

Un fuzzer test est une méthode de test de robustesse qui consiste à envoyer des données aléatoires, incorrectes ou malformées à un programme pour identifier les vulnérabilités. Dans le cas du parser robots.txt, Google génère des milliers de variations de fichiers robots.txt — certains valides, d'autres complètement déformés — pour voir si la bibliothèque crashe, plante ou présente des failles de sécurité.

L'objectif ? Détecter les dépassements de mémoire, les erreurs de parsing qui pourraient bloquer le crawl, ou les exploits potentiels. C'est une pratique courante en développement logiciel pour les composants critiques exposés à des inputs externes non contrôlés.

Pourquoi cette précision sur les tests internes vs open source ?

Gary Illyes souligne que les tests publics (ceux disponibles dans le repo GitHub du parser robots.txt) ne représentent qu'une fraction de la couverture de test réelle. En interne, Google déploie une infrastructure de fuzzing bien plus agressive, probablement avec des outils comme OSS-Fuzz ou des frameworks propriétaires.

Concrètement ? Si ton fichier robots.txt contient des erreurs de syntaxe ou des structures bizarres, il y a de très fortes chances que Google les gère correctement en production. Le parser a été bombardé de millions de scénarios edge-cases que tu n'imagines même pas.

Quelles sont les implications pour un fichier robots.txt en production ?

Cette déclaration nous dit que Google a investi massivement dans la tolérance aux erreurs de son parser. Ça ne signifie pas qu'il faut bâcler ton robots.txt, mais que des erreurs mineures de syntaxe ne vont probablement pas casser ton crawl.

Le parser va tenter de faire de son mieux pour interpréter les directives, même si tu as oublié un espace, utilisé des caractères bizarres ou mélangé des encodages. Soyons honnêtes : c'est rassurant, mais ça ne dispense pas de tester proprement.

- Fuzzer tests : technique de bombardement du parser avec des inputs aléatoires pour détecter bugs et failles

- Tests internes massifs : bien plus poussés que la version open source disponible publiquement

- Tolérance aux erreurs : le parser Google gère probablement mieux les syntaxes malformées qu'on ne le pense

- Dépassements de mémoire : objectif principal détecté par ces tests pour éviter crashes et exploits

- Pas d'excuse pour bâcler : robustesse du parser ne signifie pas qu'il faut négliger la qualité de son fichier robots.txt

Avis d'un expert SEO

Cette transparence change-t-elle notre approche du robots.txt ?

Pas vraiment. On savait déjà empiriquement que Google était tolérant face aux erreurs de robots.txt — on voit régulièrement des fichiers mal formatés qui ne bloquent pas le crawl. Ce que cette déclaration apporte, c'est la confirmation officielle que cette tolérance est intentionnelle et testée massivement.

La nuance ? Ça ne nous dit rien sur comment Google interprète les directives ambiguës. Tolérer une syntaxe cassée, c'est une chose. Comprendre correctement une directive mal formulée, c'en est une autre. Si ton fichier contient des règles contradictoires ou floues, le parser ne crashera probablement pas — mais rien ne garantit qu'il fera ce que tu veux.

Faut-il se fier aveuglément à cette robustesse ?

Non. Et c'est là que le discours de Gary peut être trompeur. Oui, Google teste massivement son parser en interne. Mais ces tests cherchent des crashs et des failles de sécurité, pas des erreurs d'interprétation logiques.

Un exemple concret : si tu écris une règle Disallow avec une faute de frappe dans le chemin, le parser ne plantera pas — il va juste bloquer le mauvais chemin. Le fuzzer test ne détecte pas ce type d'erreur métier. [À vérifier] : on n'a aucune donnée publique sur la couverture exacte de ces tests ni sur les scénarios qu'ils couvrent vraiment.

Que nous dit cette déclaration sur les priorités de Google ?

Que Google prend la sécurité et la stabilité de son infrastructure de crawl très au sérieux. Le robots.txt est un point d'entrée externe non authentifié — n'importe quel site peut servir n'importe quoi. C'est une surface d'attaque potentielle.

En investissant autant dans le fuzzing, Google se protège contre des exploits qui pourraient compromettre Googlebot ou ralentir le crawl global. Pour nous, ça signifie que des erreurs techniques accidentelles ont peu de chances de casser quoi que ce soit. Mais ça ne dispense pas d'une validation fonctionnelle rigoureuse.

Impact pratique et recommandations

Que faut-il faire concrètement avec cette information ?

Continue à valider ton robots.txt avec les outils officiels — le testeur de robots.txt dans Search Console et le validateur en ligne. Le fait que Google teste massivement son parser ne t'exempte pas de tester tes propres fichiers.

Concentre-toi sur la clarté des directives plutôt que sur la robustesse syntaxique. Google gère probablement bien les erreurs de formatage, mais une directive ambiguë ou contradictoire sera interprétée selon la logique du parser — pas nécessairement selon ton intention.

Quelles erreurs faut-il absolument éviter ?

Même avec un parser ultra-robuste, certaines erreurs restent critiques. Les chemins mal échappés ou les wildcards mal placés peuvent bloquer des sections entières de ton site sans que tu t'en rendes compte.

Les directives contradictoires (Allow puis Disallow sur le même chemin) sont gérées par un ordre de priorité spécifique — si tu ne le maîtrises pas, le comportement peut surprendre. Et surtout : un robots.txt qui bloque accidentellement des ressources critiques (CSS, JS) impacte directement le rendering et l'indexation.

Comment vérifier que ton robots.txt est correctement interprété ?

Utilise le testeur de robots.txt dans Search Console pour vérifier que tes URL critiques ne sont pas bloquées. Teste plusieurs scénarios : pages produits, catégories, ressources statiques.

Surveille les erreurs de crawl dans Search Console. Si Google rencontre des ressources bloquées qui empêchent le rendering, tu seras alerté. Cross-check avec les logs serveur pour identifier les patterns de crawl réels vs. ce que tu penses avoir autorisé.

- Valider le robots.txt avec le testeur Search Console avant chaque mise en production

- Tester les URL critiques individuellement pour vérifier qu'elles ne sont pas bloquées

- Éviter les directives contradictoires ou ambiguës — privilégier la simplicité

- Vérifier que les ressources critiques (CSS, JS, images) ne sont pas bloquées accidentellement

- Surveiller les erreurs de crawl dans Search Console après chaque modification

- Croiser les données Search Console avec les logs serveur pour identifier les écarts

- Documenter la logique de chaque directive pour faciliter les audits futurs

❓ Questions frequentes

Les fuzzer tests de Google garantissent-ils que mon robots.txt malformé sera correctement interprété ?

Puis-je accéder aux tests internes dont parle Gary Illyes ?

Est-ce que cela signifie que je peux bâcler mon robots.txt ?

Comment savoir si mon robots.txt contient des directives contradictoires ?

Quelle différence entre la version open source du parser et celle en production ?

🎥 De la même vidéo 5

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 08/03/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.