Declaration officielle

Autres déclarations de cette vidéo 5 ▾

- □ Pourquoi Google a-t-il open sourcé son parser robots.txt officiel ?

- □ Pourquoi votre robots.txt peut-il être interprété différemment par Search Console et Google Search ?

- □ Pourquoi Google a-t-il développé une version Java de son parser robots.txt ?

- □ Comment Google teste-t-il vraiment la robustesse de son parser robots.txt ?

- □ Pourquoi Google considère-t-il votre fichier robots.txt comme une menace potentielle ?

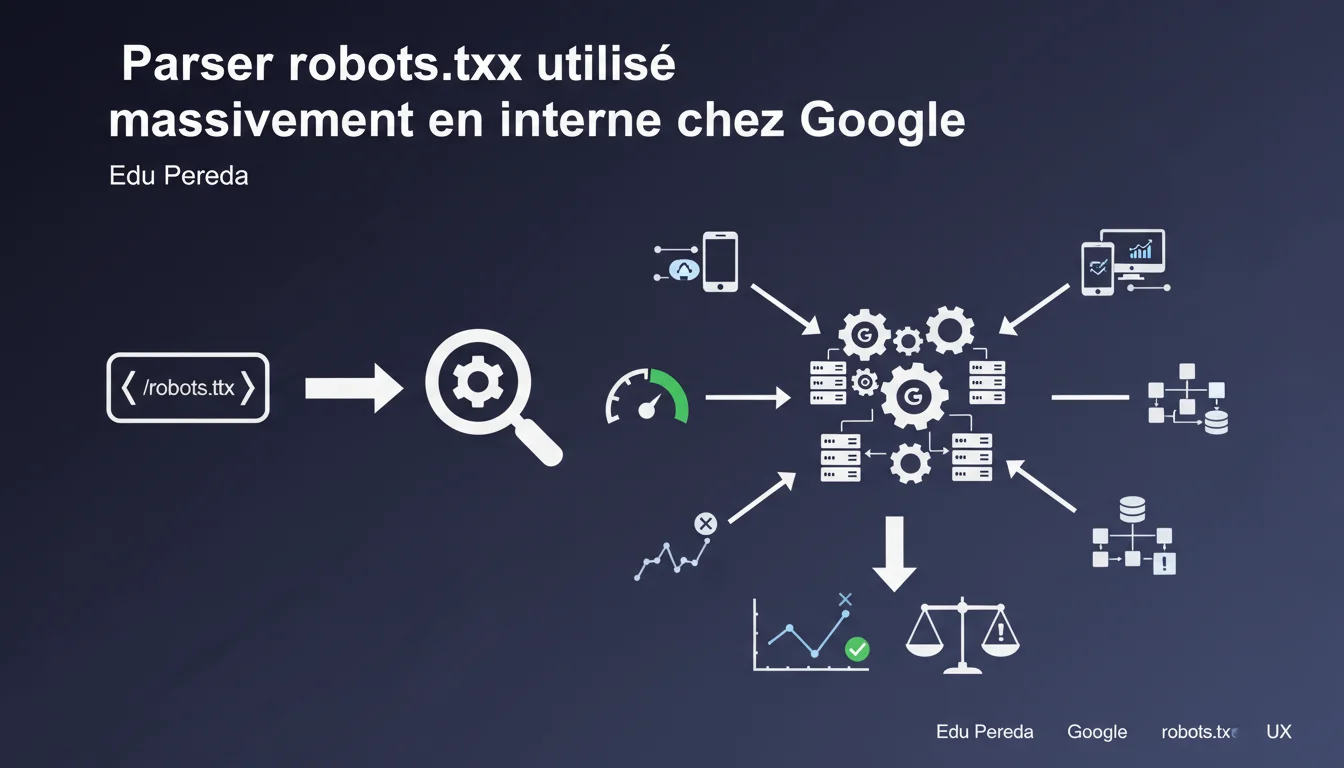

Le parser robots.txt de Google est utilisé massivement dans l'infrastructure interne du moteur de recherche. Toute modification du code nécessite des tests exhaustifs pour éviter des régressions de performance sur des systèmes critiques. Cette déclaration révèle l'importance stratégique du fichier robots.txt dans l'architecture de Google.

Ce qu'il faut comprendre

Qu'est-ce qu'un parser robots.txt et pourquoi est-il si central chez Google ?

Le parser robots.txt est le composant logiciel qui lit, analyse et interprète les instructions contenues dans le fichier robots.txt de chaque site web. Chez Google, ce n'est pas un simple script isolé — c'est une bibliothèque logicielle partagée par de nombreux systèmes internes.

Cette déclaration d'Edu Pereda révèle que cette bibliothèque est utilisée massivement à travers l'infrastructure de Google. Concrètement : Googlebot, les systèmes de crawl, les outils de validation, les serveurs de rendu JavaScript… tous s'appuient sur ce même composant pour décider ce qu'ils ont le droit de crawler ou non.

Pourquoi toute modification nécessite-t-elle autant de tests ?

Si la bibliothèque du parser contient un bug ou une régression de performance, ce n'est pas un seul service qui tombe — ce sont des dizaines de systèmes critiques qui peuvent être impactés simultanément. Un ralentissement de quelques millisecondes multiplié par des milliards de requêtes quotidiennes = un coût opérationnel massif.

Google doit donc tester chaque modification dans des conditions réelles, sur des volumes de données colossaux, avant de la déployer en production. C'est ce qui explique pourquoi certaines évolutions du standard robots.txt mettent du temps à être implémentées.

Quelles implications pour les professionnels SEO ?

Cette déclaration confirme que le fichier robots.txt reste un point de contrôle absolument central dans la relation entre un site et Google. Ce n'est pas un fichier "legacy" en voie de disparition — c'est au contraire un composant critique de l'infrastructure de crawl.

- Le parser robots.txt est une bibliothèque partagée par de nombreux systèmes Google

- Toute modification du code doit être testée rigoureusement pour éviter les régressions

- Cette prudence explique la lenteur d'implémentation de nouvelles directives robots.txt

- Le fichier robots.txt conserve une importance stratégique majeure chez Google

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Absolument. On observe depuis des années que Google est extrêmement prudent avec les évolutions du robots.txt. Par exemple, le support du crawl-delay (largement utilisé par Bing ou Yandex) n'a jamais été implémenté chez Google, malgré des demandes récurrentes.

De même, certaines directives comme le noindex dans robots.txt ont été dépréciées après avoir fonctionné pendant des années — et Google a pris le temps de communiquer longuement avant de retirer le support. Cette prudence s'explique désormais clairement : toucher au parser, c'est toucher à des dizaines de systèmes en production.

Quelles nuances faut-il apporter à cette affirmation ?

La déclaration reste volontairement vague sur un point : quels sont exactement ces "nombreux systèmes critiques" qui dépendent du parser ? Googlebot oui, mais quoi d'autre ? Les outils Search Console ? Les systèmes de rendu JavaScript ? Les crawlers de Google Images, Google News ?

Sans cette précision, difficile d'évaluer l'ampleur réelle de la "massivité" évoquée. [A vérifier] : est-ce que chaque service Google (Ads, Analytics, etc.) utilise aussi ce parser pour respecter les directives robots.txt, ou seulement les services liés au Search ?

Autre point : Pereda parle de "régressions de performance", mais pas de bugs fonctionnels. Or, les deux types de problèmes existent. Un parser qui ralentit est problématique, mais un parser qui interprète mal une directive l'est tout autant — et on a vu des cas concrets de mauvaise interprétation de wildcards ou de patterns complexes.

Que révèle cette déclaration sur l'architecture technique de Google ?

Elle confirme une approche de bibliothèque partagée plutôt que de micro-services indépendants pour le parsing robots.txt. C'est une architecture classique mais qui crée des dépendances fortes : un seul composant sert de nombreux clients internes.

Cela signifie aussi que Google ne peut pas facilement A/B tester des modifications du parser sur un sous-ensemble de sites — le déploiement doit être global et immédiat. D'où la nécessité de tests exhaustifs en amont.

Impact pratique et recommandations

Que faut-il faire concrètement avec son fichier robots.txt ?

Première implication : votre fichier robots.txt doit être ultra-fiable. Pas de syntaxe approximative, pas de directives exotiques, pas de patterns ambigus. Si le parser Google est aussi sensible, autant lui faciliter la tâche.

Testez systématiquement vos modifications avec l'outil de test robots.txt de la Search Console avant de les mettre en production. Une erreur de syntaxe ou un pattern mal formé peut bloquer Googlebot de manière inattendue.

Évitez les fichiers robots.txt trop volumineux ou trop complexes. Si vous avez des centaines de lignes de directives, c'est peut-être le signe d'un problème d'architecture — mieux vaut corriger à la source qu'empiler des règles de blocage.

Quelles erreurs éviter absolument ?

Ne vous appuyez pas sur des directives non-standard ou peu documentées. Si Google ne les a jamais officiellement supportées, c'est probablement parce que les ajouter au parser nécessiterait des tests trop lourds pour un bénéfice marginal.

N'utilisez plus le noindex dans robots.txt — cette directive a été officiellement dépréciée. Utilisez la balise meta robots ou l'en-tête HTTP X-Robots-Tag à la place.

Attention aux wildcards complexes dans les patterns : certains parsers (dont celui de Google) peuvent les interpréter différemment. Préférez des règles simples et explicites.

- Testez chaque modification de robots.txt dans la Search Console avant mise en production

- Évitez les syntaxes non-standard ou ambiguës

- Supprimez les directives obsolètes (noindex, crawl-delay)

- Privilégiez des règles simples et explicites plutôt que des wildcards complexes

- Documentez chaque directive pour comprendre son impact ultérieurement

- Surveillez les logs de crawl après chaque changement de robots.txt

❓ Questions frequentes

Pourquoi Google ne supporte-t-il pas la directive crawl-delay dans robots.txt ?

Le parser robots.txt de Google est-il open source ?

Un fichier robots.txt mal formé peut-il pénaliser mon site ?

Dois-je bloquer les ressources CSS et JavaScript dans robots.txt ?

À quelle fréquence Google recrawle-t-il le fichier robots.txt d'un site ?

🎥 De la même vidéo 5

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 08/03/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.