Declaration officielle

Autres déclarations de cette vidéo 17 ▾

- 7:02 GoogleBot crawle-t-il des URLs que votre site n'a jamais générées ?

- 7:27 Pourquoi Search Console et Google Analytics affichent-ils des chiffres différents ?

- 7:27 GoogleBot crawle-t-il vraiment des URLs que votre site n'a jamais générées ?

- 8:07 Pourquoi Search Console et Google Analytics affichent-ils des données différentes ?

- 8:51 Combien de temps Google met-il vraiment à reconnaître une correction de balise noindex ?

- 9:49 Pourquoi Google met-il autant de temps à reconnaître la suppression d'une balise noindex ?

- 11:11 L'encodage des caractères spéciaux dans le code source nuit-il vraiment au référencement ?

- 11:11 L'encodage des caractères spéciaux dans le code source pose-t-il un problème pour le SEO ?

- 11:47 Comment bloquer efficacement les PDF du crawl Google sans risquer l'indexation ?

- 11:51 Faut-il vraiment bloquer les PDF avec robots.txt ou utiliser noindex ?

- 14:14 Combien de temps Google met-il vraiment à afficher votre nouveau nom de site ?

- 14:14 Comment forcer Google à afficher le bon nom de votre site dans les SERP ?

- 14:59 Pourquoi Google pénalise-t-il les noms de marque trop similaires dans les SERP ?

- 15:14 Faut-il éviter les noms de marque similaires pour ne pas nuire à son référencement naturel ?

- 19:01 Pourquoi Google refuse-t-il de détailler ses critères de classification adulte ?

- 20:13 Un site 100% HTTPS sans version HTTP est-il pénalisé par Google ?

- 20:30 Un site HTTPS-only pose-t-il un problème SEO ?

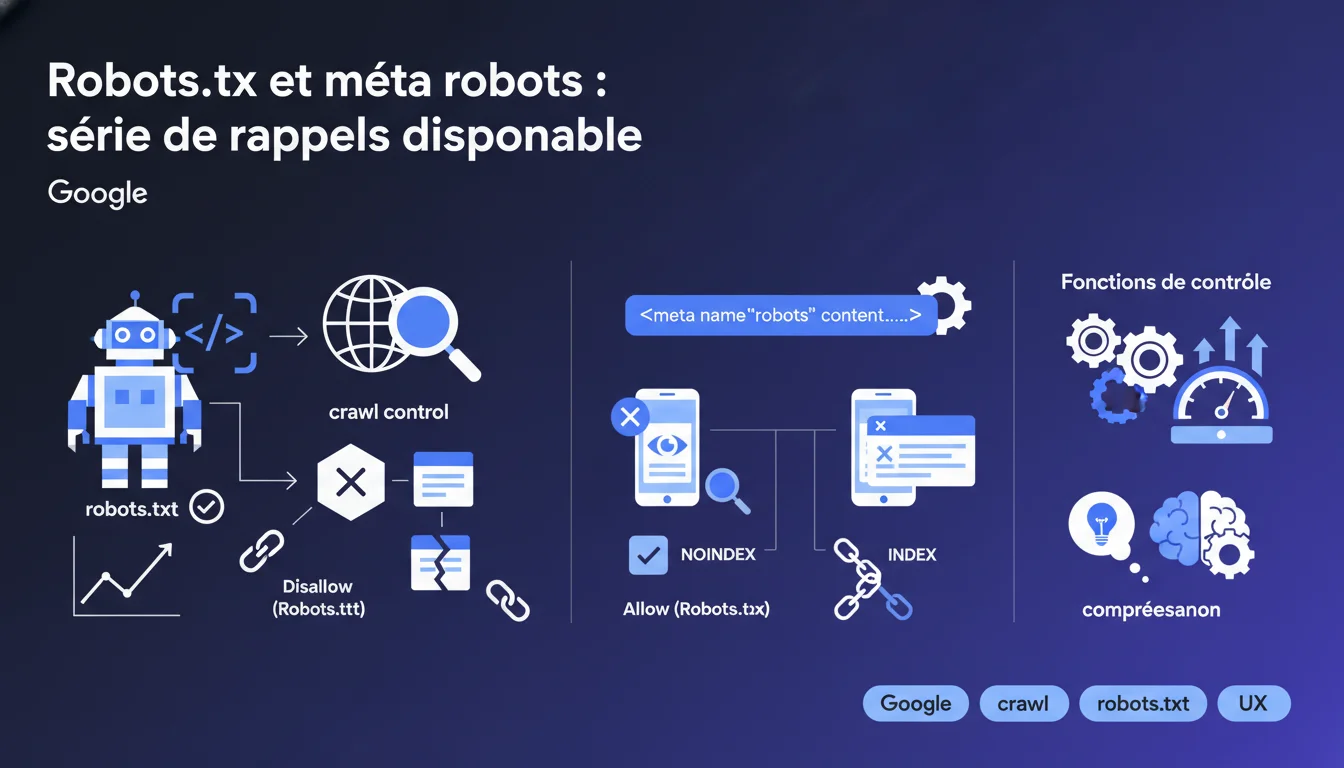

Google a publié une série d'articles de rappel sur robots.txt et les balises meta robots, dans la lignée de leur série sur les données de crawl. L'objectif affiché : aider les webmasters à mieux maîtriser ces outils de contrôle fondamentaux. Rien de révolutionnaire, mais un signal que ces mécanismes de base restent mal compris ou mal utilisés par une partie des praticiens.

Ce qu'il faut comprendre

Qu'est-ce qui motive cette nouvelle série de rappels ?

Google ne publie pas ce genre de contenu par hasard. Si l'entreprise prend le temps de rappeler les bases sur robots.txt et les balises meta robots, c'est probablement parce que ces mécanismes sont encore mal utilisés à grande échelle. On parle d'outils qui existent depuis des décennies, mais les erreurs de configuration restent fréquentes : pages stratégiques bloquées par inadvertance, directives contradictoires entre robots.txt et meta robots, confusion entre noindex et disallow.

Cette série s'inscrit dans une approche pédagogique déjà amorcée avec les articles sur les informations de crawl en décembre. Google semble vouloir systématiser la diffusion de bonnes pratiques — soit pour réduire le nombre de tickets support, soit parce que l'usage de ces directives impacte la qualité globale de l'index.

Que recouvrent concrètement robots.txt et meta robots ?

Le fichier robots.txt contrôle l'accès des crawlers aux URLs d'un site. Il dit « viens ici » ou « ne viens pas ici », mais ne garantit pas qu'une URL ne sera jamais indexée — si elle reçoit des liens externes, elle peut apparaître dans les résultats sans que Google n'ait crawlé son contenu.

Les balises meta robots (ou en-têtes HTTP X-Robots-Tag) interviennent une fois la page crawlée. Elles disent à Google s'il peut indexer le contenu, suivre les liens, afficher un snippet, etc. Contrairement à robots.txt, elles permettent un contrôle fin de l'indexation et du comportement du moteur sur chaque page.

- Robots.txt : contrôle le crawl, pas l'indexation.

- Meta robots : contrôle l'indexation, l'affichage et le comportement du crawler une fois sur la page.

- Les deux mécanismes peuvent coexister mais ne se substituent pas l'un à l'autre.

- Une URL bloquée par robots.txt mais recevant des backlinks peut être indexée sans contenu.

- Une balise noindex nécessite que Googlebot puisse accéder à la page pour être lue et appliquée.

Pourquoi cette confusion persiste-t-elle encore ?

Parce que l'écosystème SEO n'a pas toujours fait preuve de rigueur pédagogique sur ces points. Trop d'articles approximatifs, de CMS configurés par défaut de manière bancale, de développeurs qui touchent à robots.txt sans comprendre les implications. Résultat : des sites qui bloquent leur propre crawl tout en espérant être indexés, ou qui mettent du noindex sur des pages stratégiques par erreur.

Google rappelle ces fondamentaux parce que le niveau moyen reste faible. C'est un signal qu'il faut auditer régulièrement ces aspects sur chaque projet, même les plus matures.

Avis d'un expert SEO

Cette démarche de Google est-elle cohérente avec leurs pratiques observées ?

Oui, globalement. Google a toujours été assez transparent sur le fonctionnement de robots.txt et des balises meta robots — ce sont des standards ouverts, documentés depuis longtemps. Le problème n'est pas le manque d'informations, mais leur dispersion et la multiplication des interprétations erronées relayées par des blogs SEO peu rigoureux.

En revanche, [A verifier] : Google ne précise pas toujours les cas limites ni les délais d'application réels. Par exemple, combien de temps faut-il pour qu'une balise noindex soit prise en compte après déblocage dans robots.txt ? Quelle est la tolérance du moteur face à des directives contradictoires (noindex dans la meta ET allow dans robots.txt) ? Ces zones grises persistent.

Quelles nuances faut-il apporter à ces rappels ?

La principale nuance, c'est que robots.txt n'empêche pas l'indexation. Google le rappelle régulièrement, mais sur le terrain, beaucoup de praticiens confondent encore « bloquer le crawl » et « empêcher l'indexation ». Si vous voulez vraiment éviter qu'une page soit indexée, il faut utiliser noindex — et pour que Google lise cette directive, il faut que la page soit crawlable. C'est contre-intuitif pour certains.

Autre point : les directives de crawl (crawl-delay, par exemple) dans robots.txt ne sont pas respectées par Googlebot. Google utilise ses propres algorithmes pour gérer le rythme de crawl. Si vous voulez ralentir Googlebot, il faut passer par la Search Console, pas par robots.txt.

Dans quels cas ces outils ne suffisent-ils pas ?

Quand vous avez besoin d'un contrôle granulaire de l'indexation à grande échelle, notamment sur des sites e-commerce ou des plateformes de contenu généré par utilisateurs. Robots.txt et meta robots sont binaires : on indexe ou on indexe pas. Mais ils ne permettent pas de prioriser, de moduler la fréquence de crawl selon les sections, ou de gérer la désindexation progressive de contenu obsolète.

Dans ces contextes, il faut souvent combiner plusieurs leviers : pagination contrôlée, canonicalisation stratégique, gestion des paramètres d'URL, voire des techniques plus avancées comme le lazy-loading côté serveur pour certaines sections. Les balises meta robots restent essentielles, mais elles ne sont qu'une brique d'une stratégie plus globale.

Impact pratique et recommandations

Que faut-il faire concrètement après cette annonce ?

Profiter de ce rappel pour auditer votre fichier robots.txt et vos balises meta robots. Trop de sites accumulent des directives héritées de configurations passées, jamais nettoyées. Vérifiez que vous ne bloquez pas par inadvertance des sections stratégiques, que vos directives noindex sont cohérentes avec votre stratégie de contenu, et que vous n'avez pas de conflits entre robots.txt et meta robots.

Testez votre robots.txt dans la Search Console pour identifier les URLs bloquées. Croisez cette liste avec vos pages les plus importantes : si une page critique est bloquée, vous avez un problème. Vérifiez également que les pages en noindex reçoivent bien du crawl — sinon, la directive ne sera jamais lue.

- Auditer robots.txt : identifier les règles obsolètes ou trop restrictives

- Vérifier que les pages stratégiques ne sont pas bloquées par robots.txt

- Contrôler la cohérence entre robots.txt et balises meta robots

- Tester les URLs bloquées dans la Search Console

- S'assurer que les pages en noindex restent crawlables

- Documenter chaque directive dans robots.txt pour éviter les erreurs futures

- Mettre en place une revue trimestrielle de ces configurations

Quelles erreurs éviter absolument ?

Première erreur classique : bloquer une page dans robots.txt en espérant qu'elle disparaisse de l'index. Si elle a déjà été indexée ou reçoit des backlinks, elle restera visible. Il faut d'abord mettre en noindex, laisser Google la crawler, attendre la désindexation, puis éventuellement la bloquer dans robots.txt.

Deuxième erreur : mettre du noindex sur des pages qui reçoivent des liens internes importants. Cela crée des impasses dans le maillage et affaiblit la distribution du PageRank. Si une page ne doit pas être indexée, demandez-vous pourquoi elle reçoit autant de liens — et si elle ne devrait pas plutôt être fusionnée ou redirigée.

Comment vérifier que votre site est conforme ?

Utilisez la Search Console pour voir les URLs bloquées par robots.txt et celles marquées noindex. Croisez ces données avec votre plan de crawl stratégique : est-ce que les pages bloquées ou désindexées correspondent à vos objectifs ? Si non, ajustez.

Pour un audit plus poussé, scrapez votre site avec un outil comme Screaming Frog en mode « Googlebot » et comparez les résultats avec votre sitemap XML. Toute divergence entre ce que vous soumettez et ce que Google peut réellement crawler est un signal d'alerte. Mettez en place un monitoring automatique si votre site dépasse les 10 000 pages.

❓ Questions frequentes

Peut-on bloquer une page dans robots.txt et la désindexer en même temps ?

Robots.txt empêche-t-il vraiment l'indexation ?

Combien de temps faut-il pour qu'une directive noindex soit appliquée ?

Peut-on utiliser robots.txt pour ralentir Googlebot ?

Faut-il bloquer les pages en noindex dans robots.txt après désindexation ?

🎥 De la même vidéo 17

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 27/03/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.