Declaration officielle

Autres déclarations de cette vidéo 6 ▾

- □ Pourquoi la standardisation du robots.txt par l'IETF change-t-elle la donne pour les crawlers ?

- □ Pourquoi Google limite-t-il la taille de robots.txt à 500 Ko ?

- □ Les flux RSS et Atom sont-ils vraiment utilisés par Google pour découvrir vos contenus ?

- □ Les sitemaps XML sont-ils vraiment indispensables sans standardisation officielle ?

- □ Pourquoi Google a-t-il ouvert le code de son parseur robots.txt ?

- □ Le robots.txt et les sitemaps XML sont-ils désormais officiellement liés ?

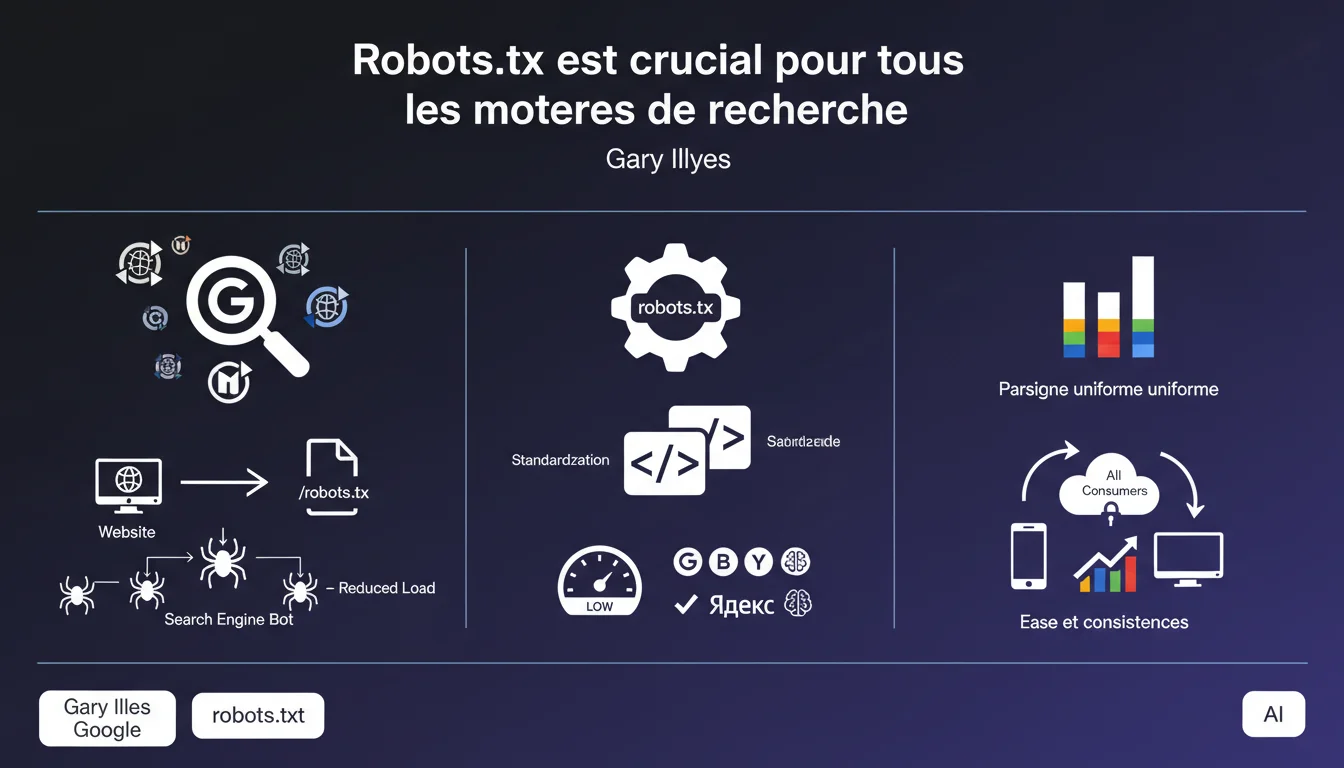

Google confirme que robots.txt demeure un fichier fondamental pour tous les moteurs de recherche, pas une relique du passé. La standardisation de ce protocole simplifie la vie des propriétaires de sites en uniformisant les règles d'écriture pour l'ensemble des crawlers. Ignorer ou négliger ce fichier expose à des problèmes de crawl budget et d'indexation.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il sur l'importance de robots.txt ?

La déclaration de Gary Illyes recadre une idée reçue tenace : robots.txt serait un outil dépassé, remplacé par des méthodes plus modernes comme les balises meta robots ou X-Robots-Tag. C'est faux. Pour Google et les autres moteurs, ce fichier reste la première ligne de défense pour contrôler ce qui doit être crawlé ou non.

La standardisation dont parle Gary fait référence au passage de robots.txt en RFC 9309, qui officialise un protocole utilisé depuis des décennies. Concrètement ? Un seul fichier, une syntaxe claire, et tous les crawlers respectueux du protocole suivent les mêmes règles. Pas besoin de gérer des exceptions par moteur.

Quelle est la portée réelle de cette standardisation ?

Uniformiser robots.txt réduit la charge technique sur les propriétaires de sites. Avant la standardisation, certains moteurs interprétaient différemment les wildcards ou les directives complexes. Aujourd'hui, les règles sont fixes : un Disallow s'applique de la même manière chez Google, Bing, Yandex ou DuckDuckGo.

Pour les SEO, cela signifie moins de tests empiriques et plus de prévisibilité. Une directive mal écrite bloque tout le monde de la même façon — ce qui peut être un problème, mais au moins c'est cohérent.

Robots.txt remplace-t-il d'autres méthodes de contrôle du crawl ?

Non. Et c'est là que beaucoup se trompent. Robots.txt ne désindexe pas : il empêche simplement l'accès. Si une URL est déjà indexée ou possède des backlinks, Google peut la garder dans son index même si elle est bloquée dans robots.txt.

Pour désindexer, il faut utiliser noindex (meta ou X-Robots-Tag). Pour gérer les facettes, les paramètres d'URL ou le crawl budget fin, robots.txt reste un levier essentiel mais complémentaire.

- Robots.txt : empêche l'accès des crawlers à certaines ressources

- Standardisation RFC 9309 : uniformise l'interprétation du fichier par tous les moteurs

- Pas un outil de désindexation : ne retire pas les pages de l'index Google

- Complémentaire aux balises noindex : chaque méthode a son rôle précis

- Impact direct sur le crawl budget : mal configuré, il gaspille des ressources ou bloque des contenus stratégiques

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Oui, complètement. Sur des sites à forte volumétrie — e-commerce, marketplaces, médias — robots.txt reste l'outil de premier niveau pour filtrer le crawl. Les logs serveur confirment que Google respecte scrupuleusement les directives, surtout depuis la standardisation.

Par contre, Gary ne précise pas un point crucial : robots.txt n'empêche pas l'indexation si des backlinks pointent vers une URL bloquée. On voit régulièrement des pages indexées avec la mention « Aucune information disponible sur cette page ». C'est une source de confusion fréquente. [À vérifier] dans les cas de migration ou de refonte où des URLs obsolètes restent visibles dans les SERP.

Quelles nuances faut-il apporter à cette affirmation ?

Premier point : tous les crawlers ne respectent pas robots.txt. Les scrapers malveillants, certains bots aggressifs de monitoring ou d'IA s'en fichent complètement. Le fichier ne protège que contre les acteurs qui jouent le jeu — essentiellement les moteurs de recherche légitimes.

Deuxième point : la standardisation ne règle pas tout. Des divergences subsistent sur les directives non-standard comme Crawl-delay (ignorée par Google) ou Host (Yandex uniquement). Si vous gérez du SEO international, ces nuances comptent.

Dans quels cas ce fichier devient-il contre-productif ?

Bloquer des ressources CSS ou JavaScript dans robots.txt pose problème depuis des années. Google a besoin de ces fichiers pour rendre correctement les pages et évaluer l'expérience utilisateur. Si vous bloquez /assets/ ou /scripts/, vous sabotez potentiellement votre indexation.

Autre piège classique : bloquer des pages paginées ou des filtres utiles en pensant économiser du crawl budget, alors qu'elles génèrent du trafic qualifié. L'intention derrière chaque directive compte plus que la syntaxe.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser son robots.txt ?

Commencez par auditer votre fichier actuel. Beaucoup de sites traînent des directives obsolètes issues de migrations ou de plugins mal configurés. Chaque ligne doit avoir une raison d'être. Si vous ne savez plus pourquoi une règle existe, supprimez-la.

Ensuite, testez avec l'outil Google Search Console. Il simule l'accès de Googlebot et détecte les blocages involontaires. Vérifiez aussi les logs serveur pour repérer les URLs fréquemment crawlées mais bloquées — signe d'une mauvaise priorisation.

Quelles erreurs éviter absolument ?

Ne bloquez jamais les ressources nécessaires au rendu : CSS, JavaScript, polices. Google a besoin de ces fichiers pour évaluer correctement vos Core Web Vitals et l'expérience mobile. Bloquer /wp-content/themes/ sur WordPress est une erreur courante et coûteuse.

Évitez aussi de mélanger robots.txt et noindex. Si vous voulez désindexer une section, utilisez une balise meta robots noindex et laissez le crawl ouvert. Bloquer dans robots.txt empêche Google de voir la directive noindex — résultat : les pages restent indexées.

Comment vérifier que mon site est conforme aux bonnes pratiques ?

Utilisez un validateur de syntaxe pour détecter les erreurs de formatage (espaces mal placés, wildcards incorrects). Comparez ensuite vos directives avec les rapports de couverture dans GSC : des URLs importantes marquées comme « Bloquées par robots.txt » doivent déclencher une alerte.

Enfin, croisez avec les données de crawl budget dans les logs. Si Googlebot tente d'accéder massivement à des URLs que vous avez bloquées, soit votre stratégie de blocage est mal calibrée, soit ces URLs reçoivent des liens qu'il faut traiter autrement.

- Auditer le fichier robots.txt existant et supprimer les directives obsolètes

- Tester chaque modification avec l'outil Google Search Console avant mise en production

- Ne jamais bloquer CSS, JavaScript ou ressources critiques au rendu

- Utiliser noindex pour désindexer, robots.txt uniquement pour contrôler le crawl

- Vérifier régulièrement les logs serveur pour détecter les tentatives de crawl sur URLs bloquées

- Valider la syntaxe avec un outil dédié (wildcards, espaces, casse)

- Surveiller les rapports de couverture GSC pour repérer les blocages involontaires

Robots.txt reste un pilier du SEO technique, mais sa configuration demande rigueur et connaissance fine des interactions entre crawl, indexation et rendu. Une erreur peut coûter cher en visibilité.

Si votre site présente une architecture complexe, des volumes importants ou des enjeux de crawl budget critiques, ces optimisations méritent un regard expert. Faire appel à une agence SEO spécialisée vous garantit un diagnostic précis et une stratégie de crawl adaptée à vos objectifs métier.

❓ Questions frequentes

Robots.txt empêche-t-il vraiment la désindexation d'une page ?

Puis-je bloquer les fichiers CSS et JavaScript dans robots.txt ?

Tous les moteurs de recherche respectent-ils robots.txt ?

Faut-il bloquer les paramètres d'URL ou les pages paginées dans robots.txt ?

Comment vérifier rapidement si mon robots.txt bloque des pages importantes ?

🎥 De la même vidéo 6

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 17/04/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.