Declaration officielle

Autres déclarations de cette vidéo 6 ▾

- □ Pourquoi la standardisation du robots.txt par l'IETF change-t-elle la donne pour les crawlers ?

- □ Les flux RSS et Atom sont-ils vraiment utilisés par Google pour découvrir vos contenus ?

- □ Les sitemaps XML sont-ils vraiment indispensables sans standardisation officielle ?

- □ Pourquoi robots.txt reste-t-il indispensable même pour les sites modernes ?

- □ Pourquoi Google a-t-il ouvert le code de son parseur robots.txt ?

- □ Le robots.txt et les sitemaps XML sont-ils désormais officiellement liés ?

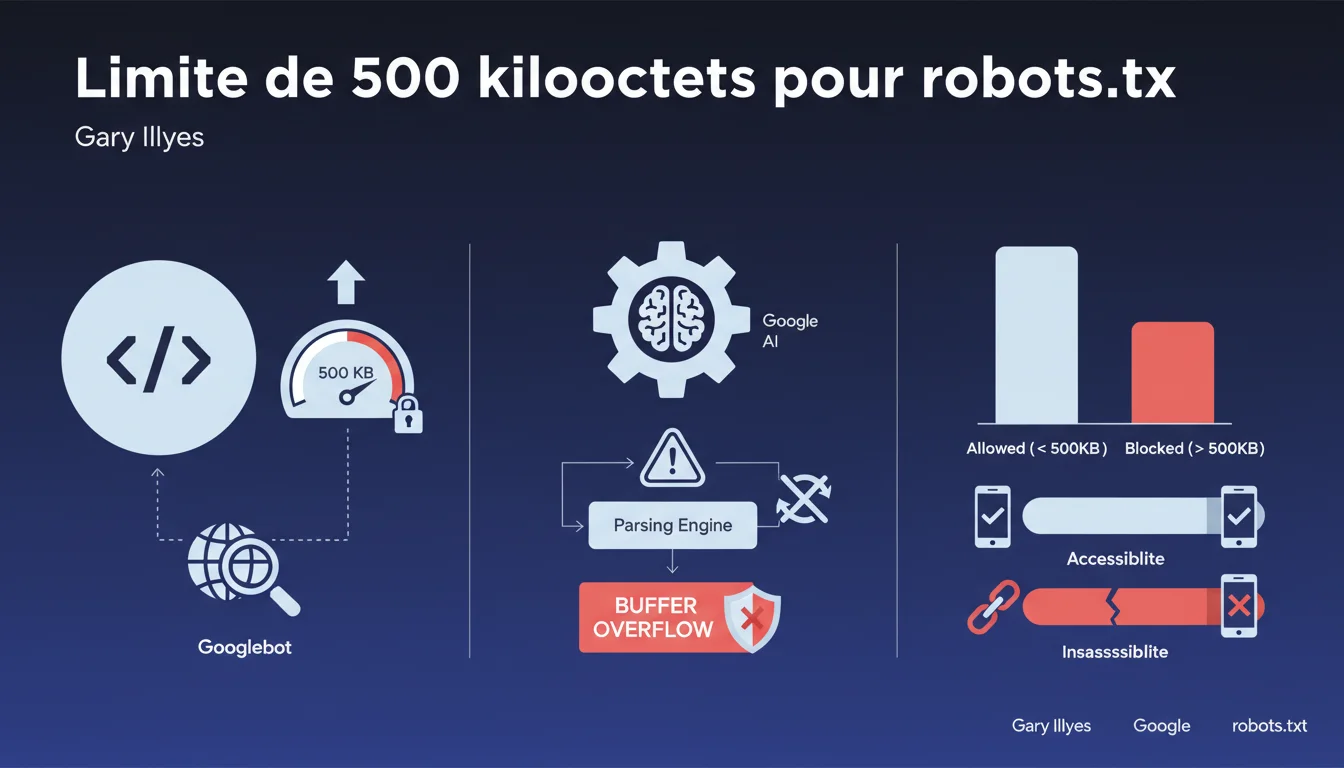

Google impose une limite stricte de 500 ko pour les fichiers robots.txt, principalement pour des raisons de sécurité liées au parsing et pour éviter les buffer overflow. Au-delà de cette taille, le contenu excédentaire est purement et simplement ignoré par le crawler. Si votre fichier dépasse ce seuil, vos directives risquent d'être partiellement ou totalement inefficaces.

Ce qu'il faut comprendre

Quelle est l'origine technique de cette limitation ?

La limite des 500 kilooctets n'est pas arbitraire. Elle découle directement de contraintes liées au parsing du fichier par les robots de Google. Un fichier robots.txt trop volumineux expose le système à des risques de buffer overflow — des vulnérabilités classiques en sécurité informatique où un programme tente de stocker plus de données qu'une zone mémoire ne peut en contenir.

Concrètement, Googlebot doit analyser des millions de fichiers robots.txt chaque jour. Limiter leur taille permet de standardiser les ressources allouées au parsing et d'éviter qu'un fichier anormalement lourd ne vienne perturber le processus de crawl ou, pire, ne serve de vecteur d'attaque.

Que se passe-t-il si mon fichier dépasse 500 Ko ?

Google tronque le fichier. Tout ce qui se trouve au-delà des 500 premiers kilooctets est ignoré. Cela signifie que si vos directives les plus critiques — par exemple des Disallow sensibles ou des Sitemap — apparaissent après cette limite, elles ne seront jamais prises en compte.

Le problème, c'est que vous ne recevrez probablement aucune alerte de la Search Console. Vous penserez que votre fichier fonctionne correctement, alors qu'en réalité une partie de vos règles est caduque. C'est un piège silencieux.

Quels sites sont réellement concernés par cette limite ?

Soyons honnêtes : 500 Ko, c'est énorme pour un fichier robots.txt classique. Un site e-commerce de plusieurs milliers de pages peut très bien tenir dans 10 ou 20 Ko. Les seuls cas problématiques concernent des sites avec des architectures extrêmement complexes, des plateformes multi-domaines, ou — plus souvent — des fichiers mal optimisés bourrés de règles redondantes.

Si vous approchez cette limite, c'est généralement le signe d'un problème structurel plus profond : taxonomies anarchiques, paramètres d'URL incontrôlés, absence de normalisation.

- La limite de 500 Ko est une contrainte de sécurité technique imposée par Google

- Tout contenu au-delà de cette taille est ignoré sans avertissement explicite

- Les sites classiques ne dépassent jamais 20 à 30 Ko — atteindre 500 Ko révèle un problème d'architecture

- Le risque principal : des directives critiques placées après la limite deviennent inopérantes

Avis d'un expert SEO

Cette limite est-elle cohérente avec les pratiques observées sur le terrain ?

Oui, parfaitement. Dans 15 ans de pratique SEO, je n'ai jamais vu un seul site bien structuré dépasser 100 Ko pour son robots.txt. Les rares exceptions concernaient des plateforomes legacy avec des couches d'architecture empilées sur plusieurs décennies, sans jamais avoir été rationalisées.

Google ne communique pas cette limite par hasard. Elle sert aussi de signal d'alerte : si vous y touchez, c'est que votre gestion du crawl est probablement inefficace. Dans la plupart des cas, un fichier démesuré traduit une approche « sparadrap » — on ajoute des règles au fil de l'eau sans jamais nettoyer l'existant.

Quelles nuances faut-il apporter à cette déclaration ?

Gary Illyes évoque la sécurité, mais il y a aussi un enjeu de performance serveur. Un fichier robots.txt est sollicité à chaque crawl, parfois plusieurs fois par seconde sur des sites à fort trafic bot. Un fichier volumineux ralentit le traitement côté Google, mais aussi côté serveur — surtout si le fichier est généré dynamiquement.

Par ailleurs, attention : la limite de 500 Ko s'applique au fichier final servi, pas au fichier source. Si vous utilisez de la compression gzip (ce qui devrait toujours être le cas), le fichier transmis sera bien plus léger. Mais c'est la taille décompressée que Google prend en compte pour le parsing.

Dans quels cas cette règle ne s'applique-t-elle pas ou pose-t-elle problème ?

Techniquement, la règle s'applique toujours. Mais certains cas limites méritent réflexion. Par exemple, les sites multilingues avec robots.txt centralisé peuvent légitimement avoir des fichiers plus lourds si chaque version linguistique nécessite des directives spécifiques.

De même, les plateformes avec des dizaines de milliers de facettes filtrables (marketplace, agrégateurs de contenu) peuvent vouloir bloquer certaines combinaisons paramétriques. Mais — et c'est là que ça coince — un robots.txt n'est jamais la bonne solution dans ces cas. Il faudrait plutôt gérer ça en amont avec des canonicals dynamiques, des règles htaccess ou une refonte de l'architecture d'URL.

Impact pratique et recommandations

Comment vérifier la taille actuelle de mon fichier robots.txt ?

Premier réflexe : accédez à votresite.com/robots.txt et copiez le contenu dans un éditeur de texte. Enregistrez le fichier et vérifiez sa taille. Sous Linux/Mac, la commande curl avec l'option -o permet de télécharger et mesurer directement : curl -o robots.txt https://votresite.com/robots.txt && ls -lh robots.txt.

Attention à ne pas confondre taille compressée et taille réelle. Utilisez des outils comme robots.txt Tester de Google Search Console ou des validateurs en ligne qui affichent la taille brute après décompression.

Que faire si mon fichier approche ou dépasse la limite ?

D'abord, auditez le fichier ligne par ligne. Dans 90 % des cas, vous trouverez des règles redondantes, des wildcards mal utilisés, ou des directives obsolètes datant de plusieurs versions du site. Supprimez impitoyablement tout ce qui n'est plus pertinent.

Ensuite, rationalisez. Plutôt que de lister 500 URLs individuelles à bloquer, utilisez des patterns avec wildcards (Disallow: /*?filtre=* au lieu de 50 lignes différentes). Regroupez les règles par user-agent si nécessaire, et envisagez de déplacer certaines directives vers les balises meta robots ou X-Robots-Tag pour alléger le fichier central.

Quelles erreurs éviter absolument ?

Ne vous contentez jamais de tronquer manuellement le fichier à 500 Ko sans analyser l'impact. Vous risquez de couper une directive critique en plein milieu. Si vous devez réduire, faites-le intelligemment : commencez par éliminer les règles les moins stratégiques.

Évitez également de multiplier les fichiers robots.txt différents par sous-domaine si ce n'est pas justifié. Cela complexifie la gestion sans gain réel. Enfin, ne générez jamais dynamiquement un robots.txt à partir d'une base de données sans mise en cache agressive — c'est la porte ouverte à des temps de réponse catastrophiques et des erreurs 500 en cas de charge.

- Vérifier la taille réelle (décompressée) du fichier robots.txt actuel

- Auditer ligne par ligne pour supprimer les règles obsolètes ou redondantes

- Utiliser des wildcards et patterns pour condenser les directives

- Tester toute modification avec le validateur de la Search Console avant mise en prod

- Surveiller régulièrement la taille du fichier lors des évolutions du site

- Envisager des solutions architecturales (canonicals, htaccess) plutôt que de multiplier les règles robots.txt

❓ Questions frequentes

Est-ce que la limite de 500 Ko s'applique au fichier compressé ou décompressé ?

Google m'alertera-t-il si mon fichier robots.txt dépasse 500 Ko ?

Puis-je contourner la limite en utilisant plusieurs fichiers robots.txt sur différents sous-domaines ?

Quelle est la taille moyenne d'un fichier robots.txt pour un site e-commerce ?

Les commentaires dans le fichier robots.txt comptent-ils dans la limite de 500 Ko ?

🎥 De la même vidéo 6

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 17/04/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.