Declaration officielle

Autres déclarations de cette vidéo 6 ▾

- □ Pourquoi la standardisation du robots.txt par l'IETF change-t-elle la donne pour les crawlers ?

- □ Pourquoi Google limite-t-il la taille de robots.txt à 500 Ko ?

- □ Les flux RSS et Atom sont-ils vraiment utilisés par Google pour découvrir vos contenus ?

- □ Les sitemaps XML sont-ils vraiment indispensables sans standardisation officielle ?

- □ Pourquoi robots.txt reste-t-il indispensable même pour les sites modernes ?

- □ Le robots.txt et les sitemaps XML sont-ils désormais officiellement liés ?

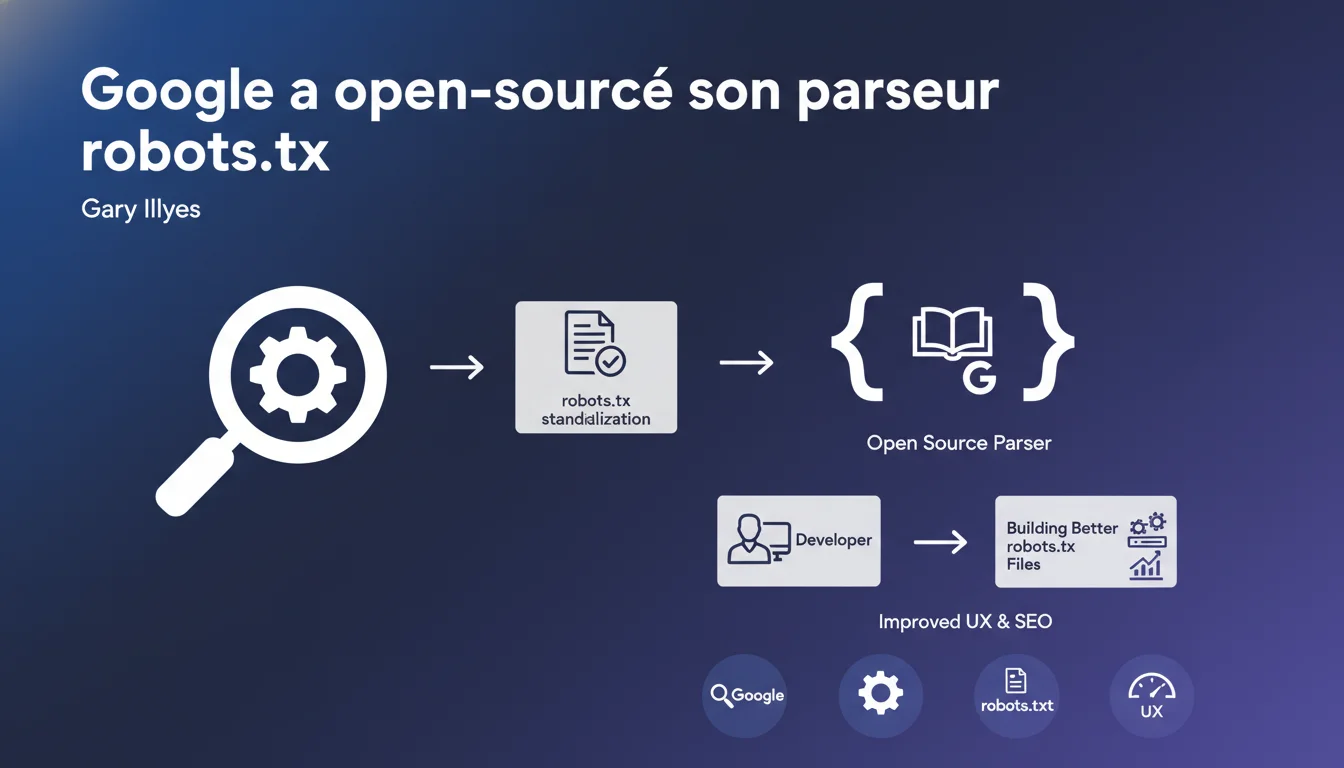

Google a publié en open source son parseur robots.txt officiel, celui-là même qui analyse vos fichiers sur le Googlebot. L'objectif : permettre aux développeurs de tester leurs directives avec exactement la même logique que celle utilisée par Google, et éviter les erreurs d'interprétation. Concrètement, vous pouvez désormais valider vos fichiers robots.txt avec le même moteur que celui qui crawle votre site.

Ce qu'il faut comprendre

Qu'est-ce qu'un parseur robots.txt et pourquoi c'est stratégique ?

Un parseur est le code qui lit et interprète les instructions d'un fichier robots.txt. Chaque moteur de recherche a le sien, et jusqu'ici, celui de Google était une boîte noire. Vous écriviez vos directives sans savoir précisément comment Google allait les comprendre.

La publication en open source change la donne. Vous avez désormais accès au code source exact que Google utilise pour analyser vos instructions de crawl. Fini les approximations — vous pouvez tester vos règles avec la même logique que le Googlebot.

Quel est le lien avec la standardisation du protocole robots.txt ?

Google a d'abord poussé pour faire du robots.txt un standard officiel reconnu par l'IETF (l'organisme qui définit les protocoles Internet). C'était une première étape : transformer un usage de facto vieux de 25 ans en norme technique documentée.

L'open sourcing du parseur est la suite logique. Une norme sans implémentation de référence reste floue. Là, Google fournit le code de référence : si vous voulez savoir comment une directive sera interprétée, vous compilez le parseur et vous testez.

Quels sont les avantages concrets pour les développeurs et SEO ?

- Validation précise : vous pouvez tester vos fichiers robots.txt avec le même moteur que Google, avant mise en production

- Debugging facilité : si une directive ne fonctionne pas comme prévu, vous analysez le code pour comprendre pourquoi

- Interopérabilité : d'autres moteurs peuvent s'appuyer sur cette base pour harmoniser leurs propres parseurs

- Transparence : terminé les zones d'ombre sur la gestion des caractères spéciaux, wildcards ou priorités entre règles

- Formation : idéal pour comprendre les subtilités du protocole en lisant directement l'implémentation

Avis d'un expert SEO

Cette ouverture du code est-elle vraiment utile pour la majorité des SEO ?

Soyons honnêtes : la plupart des fichiers robots.txt sont simples. User-agent, quelques Disallow, un Sitemap. Pour ces cas-là, l'open sourcing du parseur ne change rien à votre quotidien. Vous n'allez pas compiler du C++ pour valider trois lignes de directives.

Par contre, dès que vous gérez un site complexe — architecture multi-facettes, paramètres d'URL dynamiques, règles conditionnelles sophistiquées — avoir accès au parseur officiel devient précieux. Vous pouvez tester des edge cases, vérifier l'ordre de priorité entre règles contradictoires, anticiper le comportement sur des patterns d'URL non standards.

Le parseur open source reflète-t-il vraiment le comportement du Googlebot en production ?

Google affirme que c'est le même code que celui utilisé en production. Mais gardons un œil critique : le parseur ne fait qu'analyser le fichier. Il ne gère ni le crawl budget, ni les décisions de priorisation, ni les timeouts réseau.

Autrement dit, même si votre robots.txt passe tous les tests avec le parseur, cela ne garantit pas que Google crawlera effectivement les URLs autorisées, ni qu'il respectera vos Crawl-delay (qui reste non standard). [À vérifier] : Google ne documente pas comment ce parseur s'intègre dans la stack complète du crawler.

Quels risques à se fier uniquement à cet outil ?

Premier écueil : croire que robots.txt est la solution universelle pour contrôler l'indexation. Ce n'est qu'un outil de contrôle du crawl, pas de l'indexation. Bloquer une URL dans robots.txt n'empêche pas Google de l'indexer si elle reçoit des backlinks.

Deuxième piège : se reposer sur le parseur sans tester en conditions réelles. Le code peut être correct, mais si votre serveur renvoie un 500 quand Googlebot tente de récupérer le fichier, ou si vous avez un CDN qui cache agressivement, le résultat sera différent.

Impact pratique et recommandations

Comment utiliser concrètement le parseur open source de Google ?

Le parseur est disponible sur GitHub (cherchez "google/robotstxt"). C'est du C++, donc vous devrez le compiler ou utiliser une des bibliothèques wrapper disponibles en Python, Node.js ou Go. Si vous n'êtes pas développeur, des outils en ligne commencent à intégrer ce parseur.

L'usage typique : vous écrivez un fichier robots.txt complexe, vous le passez dans le parseur avec différentes URLs de test, et vous vérifiez que les résultats correspondent à vos attentes. Cela remplace avantageusement les vieux testeurs approximatifs qui ne respectaient pas exactement la logique de Google.

Quelles erreurs fréquentes peut-on désormais éviter grâce à cet outil ?

- Wildcards mal placés : tester si votre « * » est correctement interprété dans les chemins complexes

- Ordre des règles : vérifier quelle directive prime quand plusieurs s'appliquent à la même URL

- Caractères spéciaux : valider le comportement avec des URLs contenant %, #, ou des espaces encodés

- Cas de la casse : confirmer que robots.txt est bien case-insensitive pour User-agent mais case-sensitive pour les chemins

- Longueur maximale : tester si votre fichier ne dépasse pas les limites que Google respectera effectivement

Faut-il revoir ses fichiers robots.txt existants à la lumière de cet outil ?

Si votre site fonctionne bien, que vos pages stratégiques sont crawlées et indexées, et que vous n'avez pas de problème de crawl budget, inutile de tout chambouler. Le parseur ne rendra pas votre robots.txt meilleur par magie.

En revanche, si vous constatez des anomalies — pages importantes non crawlées, sections entières ignorées, logs serveur montrant des patterns bizarres — alors oui, passer votre fichier au parseur officiel peut révéler une directive mal formée qui bloque plus que prévu.

❓ Questions frequentes

Le parseur open source de Google fonctionne-t-il exactement comme le Googlebot en production ?

Dois-je savoir programmer pour utiliser ce parseur ?

Tester mon robots.txt avec ce parseur garantit-il que Google crawlera mes pages ?

Puis-je utiliser ce parseur pour d'autres moteurs que Google ?

Quels sont les cas d'usage prioritaires pour cet outil ?

🎥 De la même vidéo 6

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 17/04/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.