Declaration officielle

Autres déclarations de cette vidéo 16 ▾

- □ Faut-il vraiment prévenir Google lors d'une refonte de site ?

- □ Google détecte-t-il vraiment le format WEBP par l'en-tête HTTP plutôt que par l'extension du fichier ?

- □ Comment Google évalue-t-il vraiment la proéminence d'une vidéo sur une page ?

- □ Le contenu dupliqué multilingue pénalise-t-il vraiment votre référencement international ?

- □ Faut-il préférer un ccTLD au .com pour cibler un marché local ?

- □ Pourquoi Google insiste-t-il pour isoler les migrations de site de toute autre refonte ?

- □ Pourquoi AdsBot fausse-t-il vos statistiques de crawl dans Search Console ?

- □ Hreflang : faut-il regrouper toutes les annotations dans un seul sitemap ou les séparer par langue ?

- □ Strong vs Bold : Google fait-il vraiment la différence entre ces deux balises ?

- □ Le LCP ne mesure-t-il vraiment que le viewport visible au chargement ?

- □ Le sitemap XML est-il vraiment indispensable pour être indexé par Google ?

- □ Faut-il utiliser hreflang 'de' ou 'de-de' pour cibler les germanophones ?

- □ Google réessaie-t-il vraiment d'indexer vos pages après une erreur 401 ou serveur down ?

- □ Faut-il vraiment imbriquer ses données structurées pour indiquer le focus principal d'une page ?

- □ Faut-il vraiment privilégier l'attribut alt plutôt que l'OCR pour le texte dans les images ?

- □ Pourquoi le scroll infini pénalise-t-il l'indexation de vos pages e-commerce ?

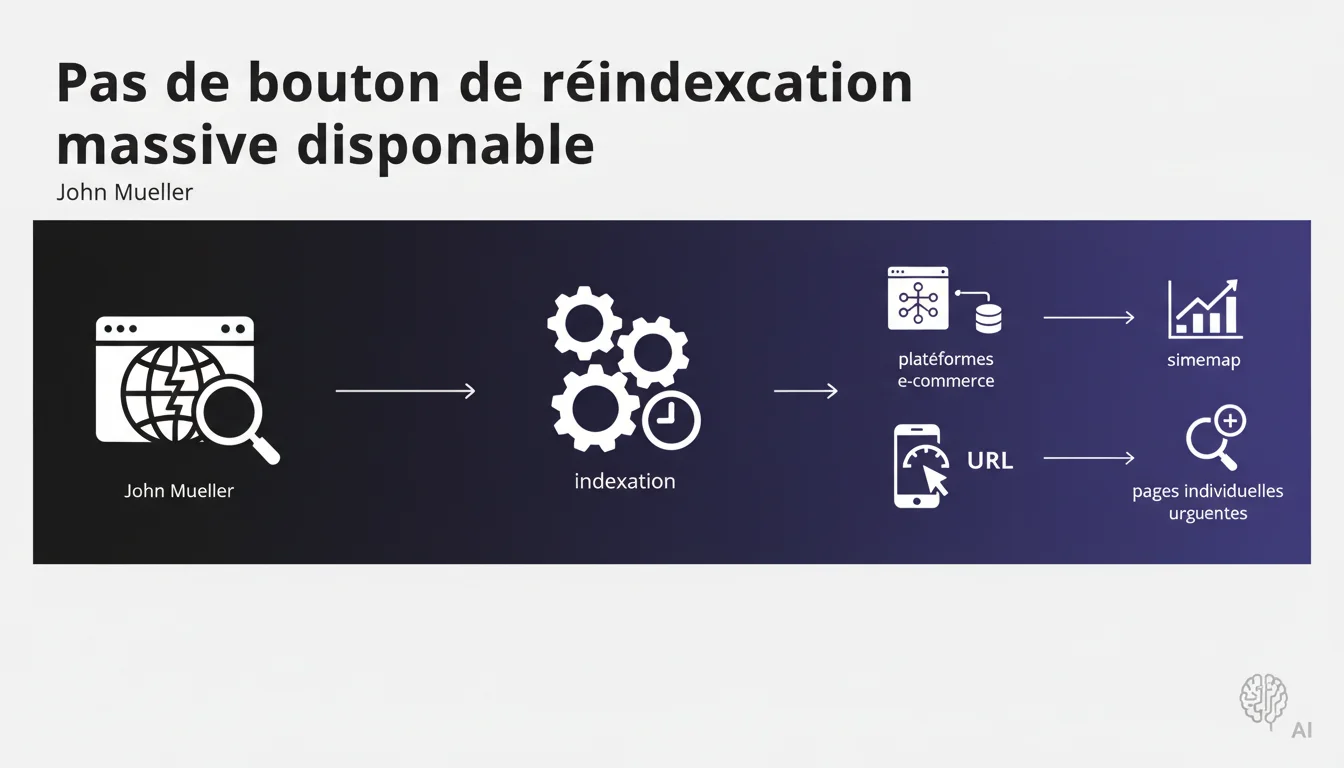

Google ne propose aucun bouton pour forcer le retraitement massif d'un site. Le processus se déroule automatiquement, à son rythme. Pour accélérer ponctuellement l'indexation de pages critiques, seuls le sitemap et l'outil d'inspection d'URL sont disponibles — mais ils ne forcent rien à grande échelle.

Ce qu'il faut comprendre

Cette déclaration répond à une attente récurrente : celle de pouvoir forcer Google à réindexer un site entier après une migration, une refonte ou un changement structurel majeur. La réalité est plus brutale — Google ne met aucun levier entre vos mains pour déclencher ce retraitement global.

Le moteur décide seul du rythme et de la profondeur de son crawl. Vous pouvez signaler, suggérer, mais jamais imposer.

Pourquoi Google refuse-t-il ce type de fonctionnalité ?

Imaginez qu'un bouton "réindexer tout" soit accessible : chaque site pourrait solliciter Googlebot à volonté, y compris pour des raisons injustifiées. Le crawl budget de Google deviendrait ingérable. Des millions de sites déclencheraient cette demande dès le moindre changement, saturant les serveurs et diluant les ressources allouées aux sites réellement prioritaires.

Google privilégie donc une approche déclarative : vous signalez vos contenus via sitemap, lui décide quand et comment les traiter. Ce n'est pas une question de bonne volonté, c'est une contrainte d'infrastructure.

Le sitemap et l'inspection d'URL suffisent-ils vraiment ?

Le sitemap XML sert de signal informatif, pas d'ordre d'exécution. Google le consulte, détecte les modifications de lastmod, mais rien ne garantit un passage immédiat. Sur des sites de plusieurs milliers de pages, certaines URLs peuvent attendre des semaines avant d'être recrawlées, même listées dans le sitemap.

L'outil d'inspection d'URL permet de demander l'indexation d'une page isolée — utile pour une urgence ponctuelle (correction d'erreur, contenu sensible au temps). Mais utiliser cet outil pour 500 URLs manuellement ? Impraticable. Et surtout, Google se réserve le droit de refuser ces demandes s'il estime qu'elles sont trop fréquentes ou injustifiées.

Que signifie concrètement "automatiquement avec le temps" ?

Cette formule floue cache une vérité inconfortable : vous ne maîtrisez pas le calendrier. Le délai de retraitement dépend de votre autorité, de votre crawl budget, de la fréquence de mise à jour habituelle du site, de la charge de Googlebot à l'instant T.

Un site e-commerce bien établi peut voir ses pages stratégiques recrawlées en quelques heures. Un site de niche avec peu de liens entrants et un historique de faible activité peut patienter plusieurs semaines. Google ne donne aucune garantie, aucun SLA. La patience devient une compétence SEO.

- Aucun bouton de réindexation globale n'existe ni n'existera, pour des raisons d'infrastructure.

- Le sitemap XML et l'inspection d'URL sont les seuls leviers officiels, mais restent des suggestions, pas des commandes.

- Le délai de retraitement varie selon l'autorité du site, son historique et son crawl budget.

- Google reste souverain dans ses priorités de crawl — vous signalez, il arbitre.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Totalement. Les remontées des praticiens confirment cette réalité depuis des années : aucune manipulation de sitemap, aucune soumission manuelle ne force un recrawl massif. Les sites qui pensent accélérer l'indexation en soumettant leur sitemap tous les jours perdent leur temps.

En revanche, certaines techniques non officielles — modification des balises structurées, injection de nouveaux backlinks vers des pages stratégiques, mise à jour de contenus connexes — semblent parfois déclencher un passage de Googlebot. Mais ces observations restent anecdotiques et difficilement reproductibles à grande échelle. [A vérifier] si ces corrélations relèvent de la causalité ou du simple hasard calendaire.

Quelles nuances faut-il apporter à cette position officielle ?

Mueller sous-entend que les plateformes e-commerce gèrent automatiquement les sitemaps — c'est vrai pour Shopify, WooCommerce ou PrestaShop dans leurs configurations par défaut. Mais beaucoup de sites custom ou hybrides n'ont pas de génération dynamique du sitemap, ou pire, publient des sitemaps obsolètes que personne ne met à jour.

Autre point : l'outil d'inspection d'URL est présenté comme solution pour "des pages individuelles urgentes". Mais en pratique, Google bride le nombre de requêtes possibles par jour. Sur un site de 10 000 pages en migration, vous ne pourrez en soumettre qu'une poignée. Le reste devra attendre le bon vouloir de Googlebot.

Dans quels cas cette règle pourrait-elle poser problème ?

Lors d'une migration urgente sous contrainte légale ou commerciale, l'absence de levier de réindexation peut devenir critique. Imaginons qu'une marque doive retirer un produit pour raison sanitaire : si Google tarde à désindexer l'ancienne fiche, elle reste accessible dans les SERP pendant des jours.

De même, les sites d'actualité ou événementiels subissent un désavantage structurel : leur contenu perd de la valeur en quelques heures, mais Google peut mettre plusieurs jours à intégrer les nouvelles URLs. Les concurrents qui bénéficient d'un crawl budget supérieur prennent l'avantage mécaniquement. C'est une inégalité de traitement que Google ne reconnaît jamais explicitement.

Impact pratique et recommandations

Que faut-il faire concrètement pour maximiser ses chances de retraitement rapide ?

Soignez la fraîcheur perçue de votre site. Google recrawle plus fréquemment les sites qui publient régulièrement du contenu nouveau. Un blog actif, des mises à jour de fiches produits, des ajouts dans une section actualités — tout signal d'activité augmente la probabilité de passages fréquents de Googlebot.

Ensuite, optimisez votre sitemap pour qu'il soit réellement informatif. Retirez les URLs bloquées par robots.txt, les redirections, les pages en erreur. Utilisez la balise <lastmod> de manière cohérente : si vous la modifiez sans raison, Google finira par l'ignorer. Un sitemap propre et fiable devient un vrai signal.

Enfin, travaillez votre crawl budget. Réduisez les facettes inutiles, les paramètres d'URL redondants, les chaînes de redirections. Plus Googlebot passe de temps sur des pages sans valeur, moins il consacre de ressources aux contenus stratégiques. L'objectif : maximiser l'efficacité de chaque passage.

Quelles erreurs éviter absolument ?

Ne bombardez jamais Google avec des demandes d'indexation manuelle en masse. Certains outils tiers promettent d'automatiser les soumissions via l'API Inspection — Google détecte ces patterns et peut les ignorer, voire sanctionner le site pour abus.

Autre erreur classique : publier un sitemap géant de 50 000 URLs d'un coup après une refonte. Google va le crawler, mais à son rythme. Mieux vaut segmenter les sitemaps par catégorie ou priorité, et soumettre progressivement les sections critiques en premier.

Enfin, ne confondez pas crawl et indexation. Google peut crawler une page sans l'indexer si elle est jugée de faible qualité ou dupliquée. Demander un recrawl ne résout rien si le problème est structurel — contenu thin, cannibalisation, mauvaise architecture.

Comment vérifier que mon site est correctement configuré pour le retraitement automatique ?

- Vérifier que le sitemap XML est déclaré dans

robots.txtet soumis dans Google Search Console. - Contrôler que les dates

<lastmod>sont cohérentes avec les vraies modifications de contenu. - S'assurer qu'aucune URL du sitemap n'est bloquée par robots.txt, en noindex, ou en erreur 4xx/5xx.

- Surveiller les statistiques de crawl dans GSC : une chute brutale signale un problème technique ou de budget.

- Identifier les pages stratégiques et suivre leur fréquence de recrawl via les logs serveur.

- Réduire les redirections en chaîne, les boucles et les paramètres d'URL inutiles pour économiser le crawl budget.

- Publier régulièrement du contenu frais pour maintenir un rythme de visite élevé de Googlebot.

❓ Questions frequentes

Peut-on forcer Google à réindexer un site entier après une refonte ?

Le sitemap XML garantit-il une indexation rapide des nouvelles pages ?

L'outil d'inspection d'URL peut-il remplacer un bouton de réindexation massive ?

Combien de temps faut-il attendre pour qu'un site soit entièrement recrawlé après une migration ?

Modifier les dates lastmod du sitemap accélère-t-il le recrawl ?

🎥 De la même vidéo 16

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 09/03/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.