Declaration officielle

Autres déclarations de cette vidéo 16 ▾

- □ Google détecte-t-il vraiment le format WEBP par l'en-tête HTTP plutôt que par l'extension du fichier ?

- □ Comment Google évalue-t-il vraiment la proéminence d'une vidéo sur une page ?

- □ Le contenu dupliqué multilingue pénalise-t-il vraiment votre référencement international ?

- □ Faut-il préférer un ccTLD au .com pour cibler un marché local ?

- □ Pourquoi Google insiste-t-il pour isoler les migrations de site de toute autre refonte ?

- □ Pourquoi AdsBot fausse-t-il vos statistiques de crawl dans Search Console ?

- □ Hreflang : faut-il regrouper toutes les annotations dans un seul sitemap ou les séparer par langue ?

- □ Google propose-t-il un bouton pour réindexer massivement un site après refonte ?

- □ Strong vs Bold : Google fait-il vraiment la différence entre ces deux balises ?

- □ Le LCP ne mesure-t-il vraiment que le viewport visible au chargement ?

- □ Le sitemap XML est-il vraiment indispensable pour être indexé par Google ?

- □ Faut-il utiliser hreflang 'de' ou 'de-de' pour cibler les germanophones ?

- □ Google réessaie-t-il vraiment d'indexer vos pages après une erreur 401 ou serveur down ?

- □ Faut-il vraiment imbriquer ses données structurées pour indiquer le focus principal d'une page ?

- □ Faut-il vraiment privilégier l'attribut alt plutôt que l'OCR pour le texte dans les images ?

- □ Pourquoi le scroll infini pénalise-t-il l'indexation de vos pages e-commerce ?

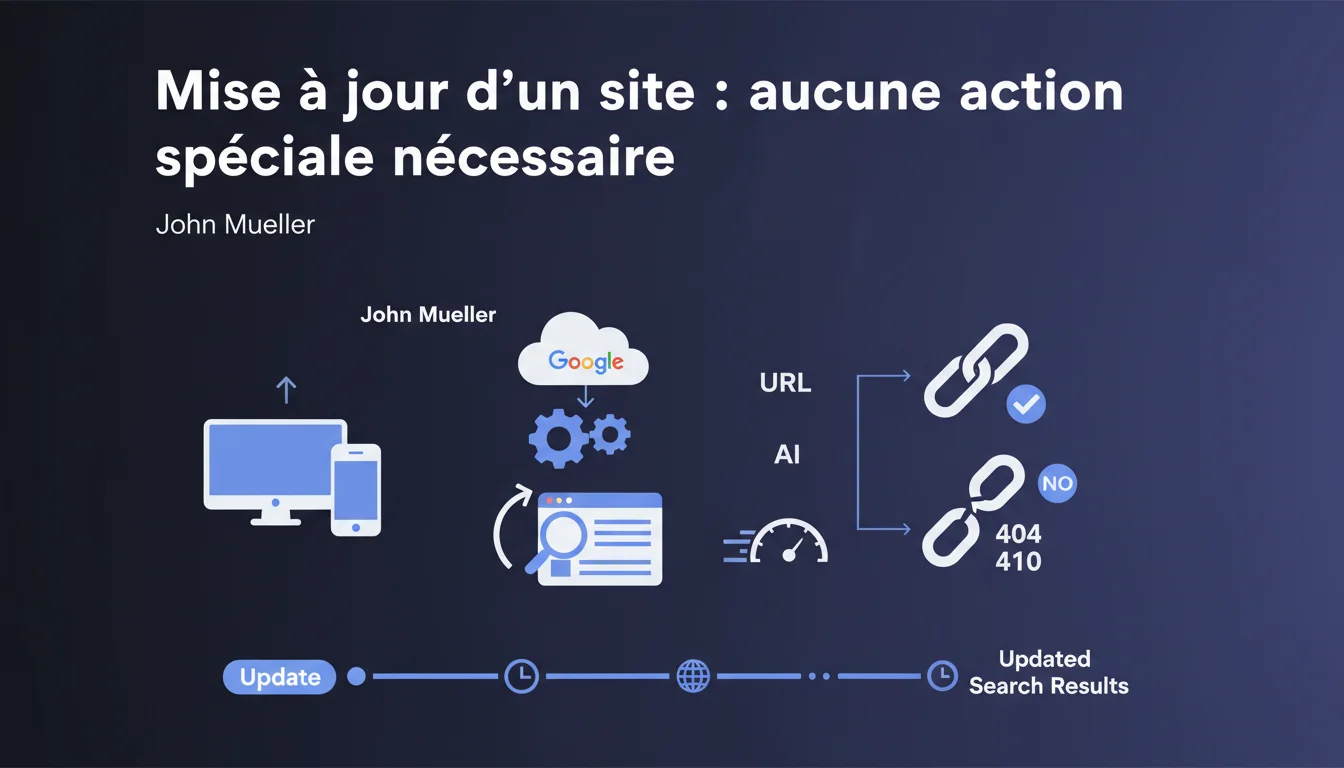

Google ne demande aucune action particulière lors de la mise à jour d'un site. Le moteur recrawle automatiquement les pages et met à jour son index. L'essentiel : mettre en place des redirections 301 pour les URLs modifiées, ou renvoyer un 404/410 si elles disparaissent définitivement.

Ce qu'il faut comprendre

John Mueller rappelle ici un principe fondamental que trop de professionnels compliquent inutilement : Google n'a besoin d'aucune notification spéciale lors d'une mise à jour de site. Pas de ressoumission d'URL via Search Console, pas de ping manuel, rien.

Le moteur découvre naturellement les changements via son processus de crawl habituel. Mais ce message simple cache quelques subtilités qu'il faut bien comprendre.

Google détecte-t-il vraiment tous les changements automatiquement ?

Théoriquement oui. Le Googlebot recrawle régulièrement les pages selon leur fréquence de mise à jour historique et leur importance dans l'architecture du site. Une page stratégique visitée quotidiennement sera mise à jour rapidement, une page profonde oubliée peut attendre des semaines.

C'est là que le discours de Mueller devient imprécis. Il ne précise pas les délais ni les conditions optimales pour que cette détection automatique fonctionne efficacement. En pratique, la vitesse de découverte dépend de votre crawl budget, de votre maillage interne et de vos signaux de fraîcheur.

Pourquoi insister sur les redirections et les codes d'erreur ?

Parce que c'est le seul point où l'action humaine compte vraiment. Quand vous modifiez l'URL d'une page, Google doit comprendre ce qui s'est passé : redirection 301 si le contenu a déménagé, code 404 ou 410 si la page n'existe plus.

Sans cela, vous créez des liens cassés, perdez l'équité des liens pointant vers les anciennes URLs, et générez une mauvaise expérience utilisateur. C'est le strict minimum technique à respecter.

Qu'est-ce qui n'est donc pas nécessaire selon Google ?

Toutes les actions « magiques » que certains conseillent encore : resoumettre l'intégralité du sitemap, forcer l'indexation page par page via Search Console, utiliser des outils tiers pour « notifier » Google. Rien de tout cela n'accélère significativement le processus selon cette déclaration.

- Google recrawle automatiquement les sites mis à jour sans intervention manuelle

- Les redirections 301 sont indispensables pour préserver l'équité des liens lors de changements d'URLs

- Les codes 404/410 doivent être renvoyés pour les pages définitivement supprimées

- Aucune notification via Search Console n'est requise pour déclencher le recrawl

- La vitesse de mise à jour dépend du crawl budget et de la fréquence historique de crawl

Avis d'un expert SEO

Cette déclaration correspond-elle aux observations terrain ?

Oui et non. Dans l'absolu, Google recrawle effectivement les sites sans qu'on ait besoin de le supplier. Mais le délai peut être catastrophique si vous ne comprenez pas les mécaniques sous-jacentes. J'ai vu des migrations où Google a mis 3 semaines à découvrir certaines redirections, simplement parce que le maillage interne était défaillant.

Mueller simplifie à l'extrême. Il omet volontairement de mentionner les facteurs d'accélération du crawl : sitemap XML à jour, liens internes vers les nouvelles URLs, fréquence de publication, popularité des pages concernées. « Aucune action spéciale » ne signifie pas qu'il ne faut rien faire — ça signifie juste qu'il ne faut pas faire de démarches administratives auprès de Google.

Quelles nuances faut-il apporter à ce message ?

Première nuance : cette recommandation vaut pour des mises à jour « normales ». Si vous migrez 50 000 URLs d'un coup ou changez de domaine, l'approche passive de Mueller est suicidaire. Vous devez absolument préparer le terrain : sitemap propre, redirections testées, monitoring de l'indexation. [A vérifier] : Mueller ne précise pas à partir de quel volume de changements cette approche devient insuffisante.

Deuxième nuance : renvoyer un 404 ou un 410 « si ce n'est pas possible » de rediriger est un conseil dangereux sans contexte. Si une page recevait des backlinks de qualité, la laisser en 404 c'est gaspiller de l'équité. Il fallait préciser qu'un 404 n'est acceptable que si la page n'a aucune valeur SEO résiduelle ou si aucune alternative logique n'existe.

Dans quels cas cette approche ne suffit-elle pas ?

Migration de domaine, refonte complète avec changement de CMS, passage HTTP vers HTTPS à grande échelle, restructuration d'arborescence massive — tous ces scénarios demandent bien plus qu'une attitude passive. Vous devez monitorer activement l'indexation, vérifier la bonne prise en compte des redirections, traquer les erreurs 404 dans Search Console.

L'autre cas critique : les sites à faible crawl budget. Si Google ne visite vos pages que toutes les deux semaines, attendre passivement que les changements soient détectés peut vous coûter des semaines de visibilité.

Impact pratique et recommandations

Que faut-il faire concrètement lors d'une mise à jour de site ?

Première action : mapper toutes vos anciennes URLs vers les nouvelles. Fichier Excel, script, peu importe — mais vous devez avoir une correspondance claire. Ensuite, configurez les redirections 301 côté serveur (pas en JavaScript, pas en meta refresh). Testez-les avec un outil comme Screaming Frog avant la mise en ligne.

Deuxième action : identifiez les pages qui n'ont pas d'équivalent dans la nouvelle version. Si elles reçoivent des backlinks ou du trafic organique, créez une page alternative pertinente et redirigez. Sinon, laissez-les renvoyer un 404 propre avec un message clair et des suggestions de navigation.

Troisième action : mettez à jour votre sitemap XML avec les nouvelles URLs uniquement. Supprimez les anciennes. Soumettez-le via Search Console — non pas pour « notifier » Google, mais pour faciliter la découverte rapide des nouvelles pages par le crawler.

Quelles erreurs éviter absolument ?

Ne créez pas de chaînes de redirections (A → B → C). Google suit les redirections, mais chaque saut dilue l'équité et ralentit le crawl. Redirigez toujours directement vers la destination finale.

Ne laissez pas d'anciennes URLs dans votre sitemap XML. C'est un signal contradictoire qui embrouille le crawler et peut ralentir la mise à jour de l'index. Votre sitemap doit refléter exactement l'état actuel du site.

N'attendez pas passivement que Google découvre vos changements si vous avez modifié des pages stratégiques. Utilisez l'outil d'inspection d'URL dans Search Console pour demander une réindexation des URLs critiques — même si Mueller dit que ce n'est pas nécessaire, ça peut accélérer la prise en compte.

Comment vérifier que tout fonctionne correctement ?

Surveillez vos rapports de couverture dans Search Console. Vous devez voir les anciennes URLs sortir progressivement de l'index (marquées comme redirigées) et les nouvelles apparaître. Si des anciennes URLs restent indexées après 2-3 semaines, c'est qu'il y a un problème de crawl ou de maillage interne.

Vérifiez que vos positions organiques se maintiennent pour vos mots-clés stratégiques. Une baisse temporaire peut être normale, mais une chute brutale indique souvent des redirections manquantes ou mal configurées.

- Établir un mapping complet anciennes URLs → nouvelles URLs

- Configurer des redirections 301 côté serveur pour toutes les URLs modifiées

- Tester les redirections avec un crawler avant mise en ligne

- Mettre à jour le sitemap XML avec uniquement les nouvelles URLs

- Soumettre le nouveau sitemap via Search Console

- Renvoyer un 404/410 propre pour les pages définitivement supprimées sans équivalent

- Monitorer les rapports de couverture pendant 4-6 semaines post-migration

- Vérifier l'évolution des positions organiques sur les mots-clés stratégiques

- Corriger rapidement toute chaîne de redirection ou erreur détectée

❓ Questions frequentes

Dois-je resoumettre mon sitemap après chaque mise à jour de contenu ?

Combien de temps Google met-il à détecter une redirection 301 ?

Quelle différence entre un code 404 et un code 410 pour Google ?

Faut-il garder les anciennes URLs en 404 ou supprimer complètement les pages ?

Les redirections 302 sont-elles acceptables lors d'une refonte ?

🎥 De la même vidéo 16

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 09/03/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.